Partenariats

InfraPartners et Emerald AI présentent les « Data Centers prêts à la flexibilité » pour résoudre le goulet d’étranglement énergétique de l’IA

L’expansion rapide de l’intelligence artificielle pousse les infrastructures énergétiques à leurs limites. La formation et l’exécution de grands modèles d’IA nécessitent des grappes de calcul massives qui consomment d’énormes quantités d’électricité, souvent plus rapidement que les réseaux électriques locaux ne peuvent s’agrandir. En réponse, InfraPartners et Emerald AI ont annoncé un partenariat visant à repenser fondamentalement la façon dont les centres de données d’IA interagissent avec le réseau électrique, les détails sont dans le livre blanc.

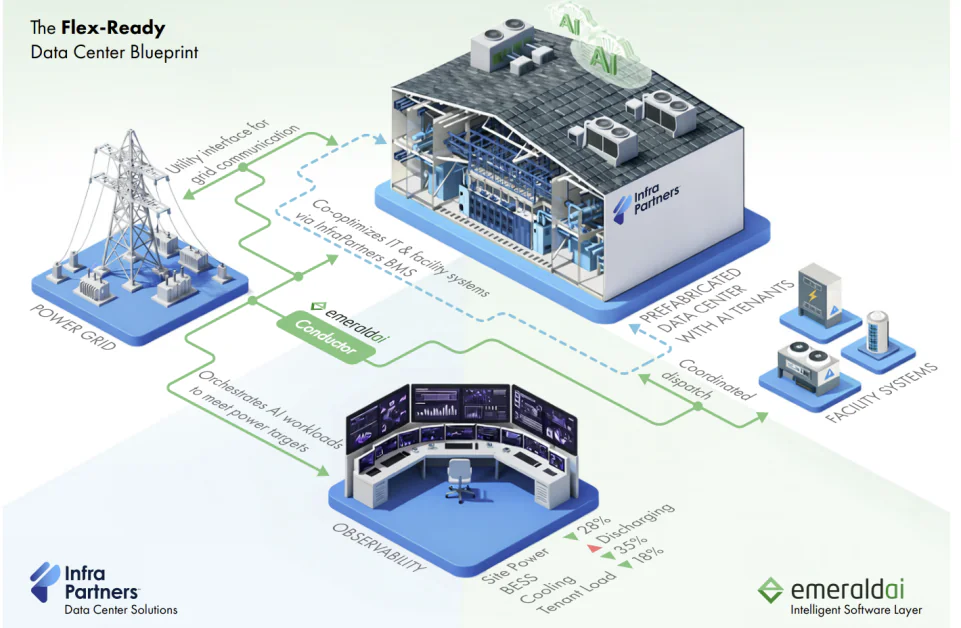

Les entreprises présentent une nouvelle architecture appelée Data Centers prêts à la flexibilité, combinant la conception d’infrastructure modulaire d’InfraPartners avec le logiciel d’orchestration d’Emerald AI. L’objectif est de transformer les centres de données de consommateurs d’électricité statiques en participants dynamiques au réseau capable d’ajuster leur demande d’énergie en temps réel.

Plutôt que de traiter la consommation d’énergie comme fixe, l’approche permet aux installations d’aligner les charges de travail de calcul sur les conditions du réseau, la disponibilité de l’énergie renouvelable et les prix de l’électricité – débloquant ainsi une capacité supplémentaire et améliorant la stabilité globale du réseau.

Pourquoi les infrastructures d’IA créent-elles une crise énergétique

Les charges de travail d’IA sont parmi les sources de demande d’électricité à croissance la plus rapide au niveau mondial. Le livre blanc publié conjointement avec le partenariat met en évidence la façon dont les centres de données sont devenus l’une des charges les plus concentrées géographiquement et à croissance la plus rapide sur les systèmes électriques modernes.

Dans le même temps, l’expansion du réseau est en retard. Les extensions de transmission, les pénuries de main-d’œuvre et les contraintes de la chaîne d’approvisionnement signifient que les nouvelles installations peuvent subir des délais de plusieurs années pour sécuriser les interconnexions de réseau. Pendant ce temps, la part croissante d’énergie renouvelable – en particulier l’énergie éolienne et solaire – introduit de la volatilité dans l’offre, ce qui rend plus complexe l’équilibrage en temps réel de la production et de la demande.

Cette dynamique crée un décalage structurel : les infrastructures d’IA ont besoin de plus de puissance, mais le réseau ne peut pas s’agrandir suffisamment rapidement pour la fournir.

Le livre blanc soutient que la solution peut ne pas simplement consister à construire plus de capacités de réseau. Au lieu de cela, il propose que les centres de données puissent devenir des ressources flexibles qui aident à stabiliser les systèmes électriques, en absorbant l’énergie renouvelable excédentaire ou en réduisant la demande pendant les périodes de stress du réseau.

Le plan du Data Center prêt à la flexibilité

La collaboration intègre deux technologies de base :

- L’architecture de centre de données améliorable d’InfraPartners, conçue pour prendre en charge les générations successives de matériel d’IA sans réaménagement majeur.

- La plate-forme Emerald Conductor d’Emerald AI, une couche logicielle qui orchestre les charges de travail de calcul, les systèmes d’installation et les signaux de réseau.

Ensemble, ils forment ce que les entreprises appellent un Data Center prêt à la flexibilité, conçu dès le départ pour participer aux marchés énergétiques et à la gestion du réseau.

Selon le livre blanc, cette intégration permet aux centres de données de soutenir la croissance de l’IA tout en améliorant en même temps la fiabilité du réseau, en réduisant les émissions et en débloquant de nouvelles valeurs économiques grâce aux programmes de réseau.

Plutôt que de rétroéquiper la flexibilité plus tard, l’architecture intègre la conscience énergétique dans les opérations d’installation dès le premier jour.

Les trois dimensions de la flexibilité des centres de données

Au cœur de la conception se trouve un cadre qui divise la flexibilité des centres de données en trois couches interactives : flexibilité temporelle, spatiale et de ressource.

Flexibilité temporelle

La flexibilité temporelle se concentre sur le déplacement de la demande d’énergie dans le temps. Au lieu d’exécuter des charges de travail en continu à pleine intensité, les tâches de calcul peuvent être planifiées en fonction de la disponibilité de l’électricité, des prix ou des niveaux de stress du réseau.

Les techniques incluent :

- le report des charges de travail de formation d’IA non urgentes

- la réduction dynamique de la consommation d’énergie des TI

- l’ajustement de l’exploitation du système de refroidissement

- la coordination avec le stockage d’énergie sur site

Cette approche permet aux centres de données de réduire la charge pendant les périodes de pointe de la demande du réseau tout en augmentant la consommation lorsque la génération d’énergie renouvelable est abondante.

Flexibilité spatiale

La flexibilité spatiale étend le concept au-delà d’une installation unique.

Les grands opérateurs d’IA exécutent souvent plusieurs centres de données dans différentes régions. En déplaçant intelligemment les charges de travail entre les sites, les opérateurs peuvent acheminer les tâches de calcul vers les endroits où l’énergie est moins chère, plus propre ou plus facilement disponible.

Dans la pratique, cela signifie que les charges de travail d’IA pourraient suivre la génération d’énergie renouvelable ou éviter les régions connaissant des congestions de réseau.

Flexibilité de ressource

La troisième couche implique la coordination de toutes les infrastructures contrôlables au sein d’un campus de centre de données.

Cela inclut :

- les GPU et les systèmes TI

- les infrastructures de refroidissement

- les systèmes d’alimentation ininterrompue (SAI)

- les systèmes de stockage de batterie

- la production d’énergie sur site

Lorsqu’ils sont orchestrés ensemble, ces actifs permettent à une installation d’ajuster sa consommation d’énergie tout en maintenant la fiabilité et les accords de niveau de service.

Emerald Conductor : Orchestration du calcul, des installations et du réseau

La couche d’orchestration qui permet ces capacités est la plate-forme Emerald Conductor d’Emerald AI.

Le système fonctionne comme une plate-forme de contrôle hiérarchique couvrant trois couches opérationnelles :

1. Couche TI

Au niveau du calcul, Emerald Conductor s’intègre aux planificateurs de charges de travail et à la télémétrie du système pour ajuster l’intensité du calcul. Les modèles prédictifs identifient les charges de travail qui peuvent être reportées ou modifiées sans violer les accords de niveau de service.

La formation d’IA, le traitement par lots et d’autres charges de travail non critiques en termes de latence deviennent des candidats pour une planification flexible.

2. Couche d’installation

La plate-forme se connecte également au système de gestion de bâtiment (BMS) du centre de données, ingérant la télémétrie des infrastructures de refroidissement, des équipements de distribution d’énergie, des systèmes SAI et des batteries.

Cela permet au logiciel d’ajuster dynamiquement les paramètres d’exploitation, de dispatcher l’énergie stockée ou de coordonner les stratégies de refroidissement tout en respectant les marges de sécurité et les exigences de redondance.

DC Flex Ready Executive White P…

3. Couche d’interface de réseau

Au niveau externe, Emerald Conductor connecte les centres de données aux signaux de réseau, y compris les événements de réponse à la demande, les prix de l’électricité en gros et les alertes de fiabilité.

Ces signaux sont traduits en actions coordonnées au sein des infrastructures TI et d’installation, permettant une participation automatisée aux programmes de marché d’énergie et aux services de stabilisation du réseau.

L’architecture de centre de données améliorable d’InfraPartners

Alors qu’Emerald AI fournit la couche d’orchestration, InfraPartners se concentre sur la façon dont les infrastructures physiques sont conçues et construites.

Son architecture de centre de données améliorable vise à résoudre un problème différent mais lié : l’évolution rapide du matériel d’IA.

Les GPU et accélérateurs modernes nécessitent souvent de nouvelles densités de puissance, des technologies de refroidissement et des dispositions d’infrastructure tous les quelques années. Les centres de données traditionnels ont du mal à s’adapter, ce qui entraîne des réaménagements coûteux ou une capacité gaspillée.

La conception d’InfraPartners introduit des architectures de puissance et de refroidissement interchangeables capables de prendre en charge plusieurs générations de matériel sans réaménagement majeur.

L’entreprise s’appuie également fortement sur la construction en usine, avec environ 80 % de l’installation assemblée et testée hors site avant déploiement. Ce modèle de fabrication première réduit les délais de construction tout en améliorant le contrôle de la qualité et la reproductibilité.

Les installations peuvent s’étendre de manière incrémentale, des déploiements de 5 mégawatts à des campus à l’échelle du gigawatt, permettant aux opérateurs d’augmenter la capacité à mesure que la demande d’IA augmente.

<h2<Intégrer la flexibilité au niveau de l'infrastructure

Le partenariat intègre les deux systèmes grâce à une intégration profonde de la télémétrie et du contrôle.

Les systèmes de gestion de bâtiment d’InfraPartners transmettent des données opérationnelles en temps réel – y compris les métriques de puissance, de refroidissement et de système d’énergie – dans le moteur d’optimisation d’Emerald Conductor.

La plate-forme d’orchestration détermine ensuite comment les charges de travail, les systèmes d’installation et les actifs énergétiques doivent réagir aux conditions du réseau.

Puisque l’infrastructure est conçue avec la flexibilité à l’esprit, le système peut ajuster les opérations en toute sécurité sans compromettre la fiabilité ou les exigences de disponibilité.

Cette intégration de niveau permet également aux centres de données de participer à des programmes de réseau tels que :

- la réponse à la demande

- les marchés d’énergie en gros

- les services de fiabilité du réseau

Ces programmes créent de nouvelles sources de revenus tout en aidant les services publics à gérer la demande d’électricité.

Un nouveau modèle pour les infrastructures d’IA

Alors que l’IA continue de s’étendre à travers les industries, la disponibilité de l’énergie devient l’un des principaux facteurs de contrainte sur la croissance de la technologie.

Le modèle de Data Center prêt à la flexibilité suggère une approche différente pour la mise à l’échelle des infrastructures de calcul. Au lieu de traiter les centres de données comme des charges passives sur le réseau, la conception les positionne comme participants actifs aux systèmes énergétiques, capables de coordonner la demande de calcul avec la disponibilité de l’énergie.

Si ce modèle est largement adopté, l’architecture pourrait aider à accélérer le déploiement de l’IA tout en réduisant la pression sur les infrastructures électriques – un défi de plus en plus critique à mesure que les modèles d’IA grandissent et deviennent plus énergivores.