Intelligence artificielle

Générer de meilleures vidéos IA à partir de seulement deux images

L’interpolation de trames vidéo (VFI) est un problème ouvert dans la recherche sur les vidéos génératives. Le défi consiste à générer des trames intermédiaires entre deux trames existantes dans une séquence vidéo.

Cliquez pour jouer. Le cadre de travail FILM, une collaboration entre Google et l’Université de Washington, a proposé une méthode d’interpolation de trames efficace qui reste populaire dans les sphères amateur et professionnelles. À gauche, on peut voir les deux trames distinctes superposées ; au milieu, la ‘trame finale’ ; et à droite, la synthèse finale entre les trames. Sources : https://film-net.github.io/ et https://arxiv.org/pdf/2202.04901

De manière générale, cette technique remonte à plus d’un siècle et a été utilisée dans l’animation traditionnelle depuis lors. Dans ce contexte, les « trames clés » maîtresses seraient générées par un artiste d’animation principal, tandis que le travail de « tweening » des trames intermédiaires serait effectué par d’autres employés, comme une tâche plus subalterne.

Avant l’émergence de l’IA générative, l’interpolation de trames a été utilisée dans des projets tels que Real-Time Intermediate Flow Estimation (RIFE), Depth-Aware Video Frame Interpolation (DAIN) et le Frame Interpolation for Large Motion (FILM – voir ci-dessus) à des fins d’augmentation du taux de trames d’une vidéo existante ou pour permettre des effets de ralenti artificiellement générés. Cela est réalisé en divisant les trames existantes d’un clip et en générant des trames intermédiaires estimées.

VFI est également utilisé dans le développement de meilleurs codecs vidéo et, plus généralement, dans les systèmes basés sur le flux optique (y compris les systèmes génératifs), qui utilisent des connaissances avancées sur les trames clés à venir pour optimiser et façonner le contenu interstitiel qui les précède.

Trames finales dans les systèmes de vidéos génératives

Les systèmes génératifs modernes tels que Luma et Kling permettent aux utilisateurs de spécifier une trame de début et une trame de fin, et peuvent effectuer cette tâche en analysant les points clés dans les deux images et en estimant une trajectoire entre les deux images.

Comme on peut le voir dans les exemples ci-dessous, fournir une ‘trame clé finale’ permet mieux au système de vidéo générative (dans ce cas, Kling) de maintenir des aspects tels que l’identité, même si les résultats ne sont pas parfaits (en particulier avec de grands mouvements).

Cliquez pour jouer. Kling est l’un d’un nombre croissant de générateurs de vidéos, notamment Runway et Luma, qui permettent à l’utilisateur de spécifier une trame de fin. Dans la plupart des cas, un mouvement minimal conduira aux résultats les plus réalistes et les moins défectueux. Source : https://www.youtube.com/watch?v=8oylqODAaH8

Dans l’exemple ci-dessus, l’identité de la personne est cohérente entre les deux trames clés fournies par l’utilisateur, ce qui conduit à une génération de vidéo relativement cohérente.

Lorsque seule la trame de début est fournie, la fenêtre d’attention du système génératif n’est généralement pas suffisamment grande pour « se souvenir » de l’apparence de la personne au début de la vidéo. Plutôt, l’identité a probablement tendance à changer un peu avec chaque trame, jusqu’à ce que toute ressemblance soit perdue. Dans l’exemple ci-dessous, une image de début a été téléchargée, et le mouvement de la personne a été guidé par une invite de texte :

Cliquez pour jouer. Avec aucune trame de fin, Kling n’a qu’un petit groupe de trames immédiatement précédentes pour guider la génération des trames suivantes. Dans les cas où un mouvement significatif est nécessaire, cette atrophie de l’identité devient grave.

On peut voir que la ressemblance de l’acteur n’est pas résistante aux instructions, puisque le système génératif ne sait pas à quoi il ressemblerait s’il souriait, et qu’il ne sourit pas dans l’image de départ (la seule référence disponible).

La majorité des clips génératifs viraux sont soigneusement sélectionnés pour minimiser ces lacunes. Cependant, les progrès des systèmes de vidéos génératives temporellement cohérents peuvent dépendre de nouveaux développements du secteur de la recherche en matière d’interpolation de trames, puisque la seule alternative possible est une dépendance à l’égard de la CGI traditionnelle en tant que vidéo « guide » (et même dans ce cas, la cohérence de la texture et de l’éclairage est actuellement difficile à atteindre).

De plus, la nature lentement itérative de la dérivation d’une nouvelle trame à partir d’un petit groupe de trames récentes rend très difficile l’obtention de mouvements importants et audacieux. En effet, un objet qui se déplace rapidement à travers une trame peut passer d’un côté à l’autre en un seul cadre, contrairement aux mouvements plus graduels sur lesquels le système a probablement été formé.

De même, un changement de pose important et audacieux peut conduire non seulement à un décalage d’identité, mais également à des incohérences vivides :

Cliquez pour jouer. Dans cet exemple de Luma, le mouvement demandé ne semble pas être bien représenté dans les données de formation.

Framer

Cela nous amène à un article récent intéressant de Chine, qui prétend avoir atteint un nouvel état de l’art dans l’interpolation de trames authentiques – et qui est le premier de son genre à offrir une interaction utilisateur basée sur le déplacement.

Framer permet à l’utilisateur de diriger le mouvement à l’aide d’une interface intuitive basée sur le déplacement, bien qu’il dispose également d’un mode « automatique ». Source : https://www.youtube.com/watch?v=4MPGKgn7jRc

Les applications centrées sur le déplacement sont devenues fréquentes dans le littérature récemment, car le secteur de la recherche lutte pour fournir des instruments pour les systèmes génératifs qui ne sont pas basés sur les résultats grossiers obtenus par des invites de texte.

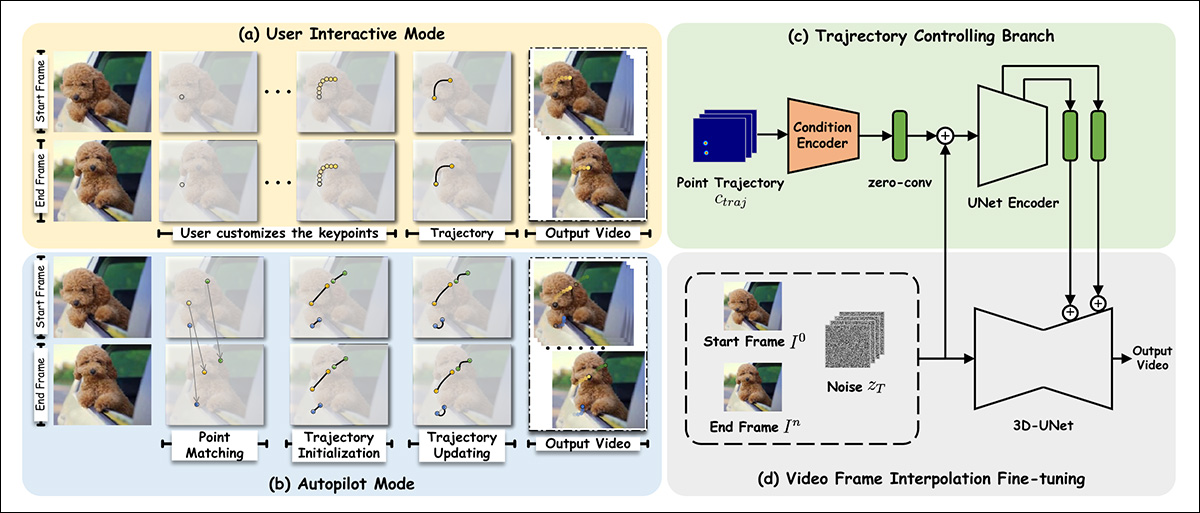

Le nouveau système, intitulé Framer, peut non seulement suivre le déplacement guidé par l’utilisateur, mais dispose également d’un mode « pilote automatique » plus conventionnel. Outre le tweening conventionnel, le système est capable de produire des simulations de time-lapse, ainsi que des morphings et des vues nouvelles de l’image d’entrée.

Trames interstitielles générées pour une simulation de time-lapse dans Framer. Source : https://arxiv.org/pdf/2410.18978

En ce qui concerne la production de vues nouvelles, Framer chevauche un peu le territoire des Neural Radiance Fields (NeRF) – bien qu’il ne nécessite que deux images, alors que NeRF nécessite généralement six ou plusieurs vues d’entrée.

Dans les tests, Framer, qui repose sur le modèle de diffusion de vidéo stable de Stability.ai Stable Video Diffusion, a été capable de surpasser les approches rivales approximatives, dans une étude utilisateur.

Au moment de la rédaction, le code est prévu pour être publié sur GitHub. Des échantillons de vidéos (à partir desquels les images ci-dessus sont dérivées) sont disponibles sur le site du projet, et les chercheurs ont également publié une vidéo YouTube.

Le nouvel article est intitulé Framer : Interpolation de trames interactive, et provient de neuf chercheurs de l’Université de Zhejiang et du groupe Alibaba.

Méthode

Framer utilise l’interpolation basée sur les points clés dans l’une ou l’autre de ses deux modalités, dans lesquelles l’image d’entrée est évaluée pour la topologie de base, et des points « mobiles » sont attribués si nécessaire. En effet, ces points sont équivalents aux repères faciaux dans les systèmes basés sur l’identité, mais se généralisent à toute surface.

Les chercheurs ont affiné Stable Video Diffusion (SVD) sur le jeu de données OpenVid-1M, en ajoutant une capacité de synthèse de trame finale supplémentaire. Cela permet un mécanisme de contrôle de trajectoire (en haut à droite dans l’image de schéma ci-dessous) qui peut évaluer un chemin vers la trame de fin (ou à partir de celle-ci).

Schéma pour Framer.

En ce qui concerne l’ajout de la synthèse de la dernière trame, les auteurs déclarent :

‘Pour préserver le savoir-faire visuel du SVD préformé autant que possible, nous suivons le paradigme de conditionnement du SVD et injectons les conditions de trame de fin dans l’espace latent et l’espace sémantique, respectivement.

‘Plus précisément, nous concaténons la fonction latente VAE codée de la première [trame] avec le bruit latent de la première trame, comme dans le SVD. De plus, nous concaténons la fonction latente de la dernière trame, zn, avec le bruit latent de la trame de fin, en considérant que les conditions et les bruits latents correspondants sont alignés spatialement.

‘En outre, nous extrayons l’incrustation d’image CLIP de la première et de la dernière trame séparément et les concaténons pour l’injection de fonctionnalité d’attention croisée.’

Pour la fonctionnalité basée sur le déplacement, le module de trajectoire utilise le cadre CoTracker dirigé par Meta Ai, qui évalue de nombreuses trajectoires possibles à l’avance. Ces trajectoires sont réduites à entre 1 et 10 trajectoires possibles.

Les coordonnées de points obtenues sont ensuite transformées par une méthodologie inspirée des architectures DragNUWA et DragAnything. Cela obtient une carte de chaleur gaussienne, qui individualise les zones cibles pour le mouvement.

Les données sont ensuite transmises aux mécanismes de conditionnement de ControlNet, un système de conformité auxiliaire conçu à l’origine pour Stable Diffusion, et depuis adapté à d’autres architectures.

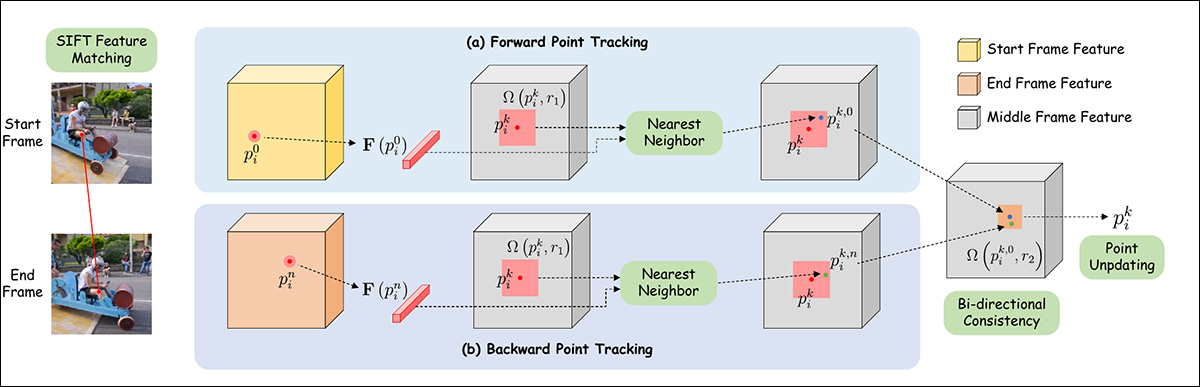

Pour le mode « pilote automatique », la correspondance de fonctionnalités est initialement effectuée via SIFT, qui interprète une trajectoire qui peut ensuite être transmise à un mécanisme de mise à jour automatique inspiré de DragGAN et DragDiffusion.

Schéma pour l’estimation de la trajectoire de points dans Framer.

Données et tests

Pour l’affinage de Framer, l’attention spatiale et les blocs résiduels ont été gelés, et seuls les couches d’attention temporelles et les blocs résiduels ont été affectés.

Le modèle a été formé pendant 10 000 itérations sous AdamW, à un taux d’apprentissage de 1e-4, et une taille de lot de 16. La formation a eu lieu sur 16 GPU NVIDIA A100.

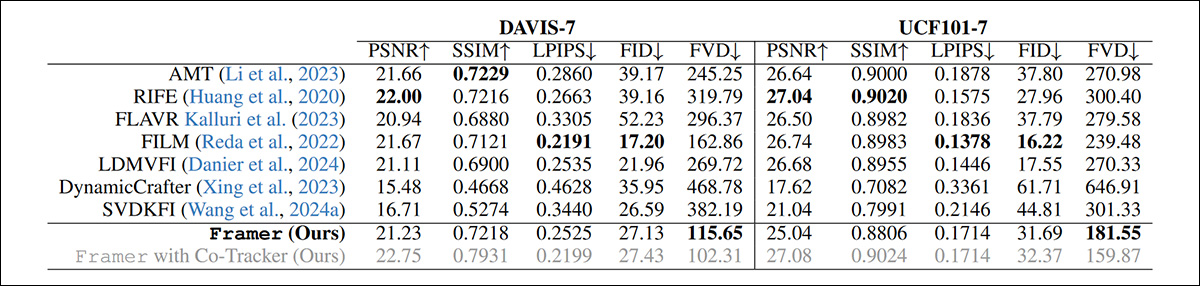

Puisque les approches antérieures du problème ne proposent pas d’édition basée sur le déplacement, les chercheurs ont choisi de comparer le mode « pilote automatique » de Framer à la fonctionnalité standard des anciennes offres.

Les cadres testés pour la catégorie des systèmes de génération de vidéos à base de diffusion actuels étaient LDMVFI ; Dynamic Crafter ; et SVDKFI. Pour les systèmes de vidéos « traditionnels », les cadres rivaux étaient AMT ; RIFE ; FLAVR ; et le FILM mentionné ci-dessus.

En plus de l’étude utilisateur, des tests ont été effectués sur les jeux de données DAVIS et UCF101.

Les tests qualitatifs ne peuvent être évalués que par les facultés objectives de l’équipe de recherche et par des études utilisateur. Cependant, l’article note que les métriques quantitatives traditionnelles sont en grande partie inadaptées à la proposition en question :

‘Les métriques de reconstruction telles que PSNR, SSIM et LPIPS ne parviennent pas à capturer avec précision la qualité des trames interpolées, car elles pénalisent d’autres résultats d’interpolation plausibles qui ne sont pas alignés sur les pixels avec la vidéo d’origine.

‘Alors que les métriques de génération telles que FID offrent une certaine amélioration, elles sont toujours insuffisantes car elles ne tiennent pas compte de la cohérence temporelle et évaluent les trames en isolation.’

Malgré cela, les chercheurs ont mené des tests qualitatifs avec plusieurs métriques populaires :

Résultats quantitatifs pour Framer par rapport aux systèmes rivaux.

Les auteurs notent que, malgré les désavantages, Framer obtient encore le meilleur score FVD parmi les méthodes testées.

Ci-dessous se trouvent les résultats d’échantillonnage de l’article pour une comparaison qualitative :

Comparaison qualitative avec les approches antérieures. Veuillez vous référer à l’article pour une meilleure résolution, ainsi que pour les résultats vidéo à https://www.youtube.com/watch?v=4MPGKgn7jRc.