Angle d’Anderson

Les IA de codage souffrent souvent de l’effet Dunning-Kruger

De nouvelles recherches montrent que les IA de codage, telles que ChatGPT, souffrent de l’effet Dunning-Kruger, agissant souvent avec la plus grande confiance lorsqu’elles sont les moins compétentes. Lorsqu’elles abordent des langages de programmation peu familiers ou obscurs, elles affirment une grande certitude même si leurs réponses s’effondrent. L’étude relie la surconfiance du modèle à la fois à de mauvaises performances et à un manque de données de formation, soulevant de nouvelles inquiétudes sur ce que ces systèmes savent vraiment sur ce qu’ils ne savent pas.

Quiconque a passé même un temps modéré à interagir avec des modèles de langage à grande échelle sur des questions factuelles sait déjà que les LLM sont souvent enclins à donner une réponse confiante mais erronée à une requête utilisateur.

En plus de formes plus flagrantes d’hallucination, la raison de cette vantardise vide n’est pas claire à 100 %. Des recherches publiées au cours de l’été suggèrent que les modèles donnent des réponses confiantes même lorsqu’ils savent qu’ils ont tort, par exemple ; bien que d’autres théories attribuent la surconfiance à des choix architecturaux, entre autres possibilités.

Ce que l’utilisateur final peut être certain, c’est que l’expérience est incroyablement frustrante, puisque nous sommes programmés pour avoir confiance dans les estimations des personnes de leurs propres capacités (ne serait-ce que parce que dans de tels cas, il y a des conséquences, légales et autres, à surestimer et sous-estimer); et une sorte de transfert anthropomorphique signifie que nous tendons à répéter ce comportement avec les systèmes de conversation IA.

Mais un LLM est une entité non responsable qui peut et va effectivement retourner un ‘Whoops! Butterfingers…’ après avoir aidé l’utilisateur à détruire involontairement quelque chose d’important, ou au moins gâcher un après-midi de leur temps ; en supposant qu’il admettra la responsabilité.

Pire encore, ce manque de circonspection prudente semble impossible à éliminer, au moins dans ChatGPT, qui réassurera abondamment l’utilisateur de la validité de ses conseils et n’expliquera les failles de sa pensée qu’après que le mal soit fait. Ni la mise à jour de la mémoire persistante du système, ni l’utilisation de prompts répétitifs n’ont beaucoup d’impact sur le problème.

Les personnes peuvent être tout aussi obstinées et auto-trompeuses – bien que quiconque se trompe à ce point et si souvent serait probablement licencié tôt. De telles personnes souffrent du contraire du syndrome de l’imposteur (où un employé craint d’avoir été promu au-delà de ses capacités) – l’effet Dunning Kruger, où une personne surestime considérablement sa capacité à effectuer une tâche.

Le coût de l’inflation

Une nouvelle étude de Microsoft examine la valeur de l’effet Dunning-Kruger dans la mesure où il se rapporte à la performance effective des architectures de codage aidées par l’IA (telles que Copilot de Redmond), dans un effort de recherche qui est le premier à s’adresser spécifiquement à ce sous-secteur des LLM.

Le travail analyse comment les IA de codage évaluent avec précision leurs propres réponses par rapport à leur performance réelle, sur des dizaines de langages de programmation. Les résultats montrent un modèle humain clair : lorsque les modèles étaient les moins capables, ils étaient les plus sûrs d’eux-mêmes.

L’effet était le plus fort dans les langages obscurs ou à faibles ressources, où les données de formation étaient minces – le modèle plus faible ou le langage plus rare, plus grande l’illusion de compétence :

Performance réelle et perçue de GPT-4o à travers les langages de programmation, classés par performance réelle. Source : https://arxiv.org/pdf/2510.05457

Les quatre auteurs, tous contributeurs égaux travaillant pour Microsoft, affirment que le travail soulève de nouvelles questions sur la mesure dans laquelle ces outils peuvent être considérés comme dignes de confiance pour juger leur propre production, et ils déclarent :

‘En analysant la confiance du modèle et la performance à travers un ensemble diversifié de langages de programmation, nous révélons que les modèles d’IA reflètent les modèles humains de surconfiance, en particulier dans des domaines inconnus ou à faibles ressources.

‘Nos expériences démontrent que les modèles moins compétents et ceux qui fonctionnent dans des langages de programmation rares présentent un biais DKE plus fort, suggérant que la force du biais est proportionnelle à la compétence des modèles. Cela correspond aux expériences humaines sur le biais.’

Les chercheurs contextualisent cette ligne d’étude comme un moyen de comprendre comment la confiance du modèle devient peu fiable lorsque la performance est faible, et de tester si les systèmes d’IA présentent le même type de surconfiance que les humains – avec des implications en aval pour la confiance et le déploiement pratique.

Bien que le nouvel article défie la loi de Betteridge sur les titres, il est néanmoins intitulé Les modèles de code souffrent-ils de l’effet Dunning-Kruger ?. Bien que les auteurs déclarent que le code a été publié pour le travail, la version actuelle de la préimpression ne contient aucune information à ce sujet.

Méthode

L’étude a testé comment les IA de codage pouvaient évaluer avec précision leurs propres réponses en leur posant des milliers de questions de programmation à choix multiple, avec chaque question appartenant à un domaine de langage spécifique, allant de Python et Java à Perl et COBOL :

Domaines de langages de programmation utilisés dans l’étude, ainsi que le nombre de questions de codage à choix multiple échantillonnées pour chaque domaine.

Les modèles ont été chargés de choisir l’option correcte, puis d’estimer à quel point ils étaient confiants dans leur choix, avec leur performance réelle mesurée par la fréquence à laquelle ils obtenaient la bonne réponse – et leur confiance auto-évaluée indiquant à quel point ils croyaient être bons. La comparaison de ces deux mesures a permis aux chercheurs de voir où la confiance et la compétence divergeaient.

Pour mesurer à quel point les modèles semblaient confiants, l’étude a utilisé deux méthodes : confiance absolue et confiance relative. Dans la première, le modèle a été invité à donner un score de zéro à un pour chaque réponse, avec sa confiance pour un langage donné définie par la moyenne de ces scores sur les questions de ce langage.

La deuxième méthode a examiné à quel point le modèle était confiant lorsqu’il choisissait entre deux questions ; pour chaque paire, le modèle devait dire laquelle il se sentait plus sûr. Ces choix ont ensuite été notés à l’aide de systèmes de classement conçus à l’origine pour des jeux compétitifs, en traitant chaque question comme si elle était un joueur dans un match. Les scores finals ont été normalisés et moyennés pour chaque langage pour donner un score de confiance relatif.

Deux formes établies de l’effet Dunning-Kruger sont examinées dans le document : l’une qui suit comment un seul modèle surestime sa performance dans différents domaines ; et une autre qui compare les niveaux de confiance entre les modèles plus faibles et plus forts.

La première forme, appelée DKE intra-participant, examine si un seul modèle devient plus surconfiant dans les langages où il se performs mal. La deuxième, DKE inter-participant, demande si les modèles qui se performs moins bien ont tendance à se surestimer.

Dans les deux cas, l’écart entre la confiance et la performance réelle est utilisé pour mesurer la surconfiance, avec des écarts plus importants dans les paramètres de faible performance indiquant un comportement similaire à DKE.

Traiter les modèles comme des participants a introduit certaines limitations, puisque le petit nombre de modèles en jeu affecte la diversité ; les différences au sein des sorties d’un seul modèle sont ignorées ; et la distribution des données peut ne pas refléter celle de participants humains réels.

Pour tenir compte de cela, l’étude a testé trois dispositifs alternatifs : premièrement, chaque modèle a reçu une personnalité distincte ; deuxièmement, les réponses ont été échantillonnées à une température plus élevée pour créer plus de variation ; troisièmement, les invites ont été paraphrasées plusieurs fois, avec chaque version traitée comme un participant distinct :

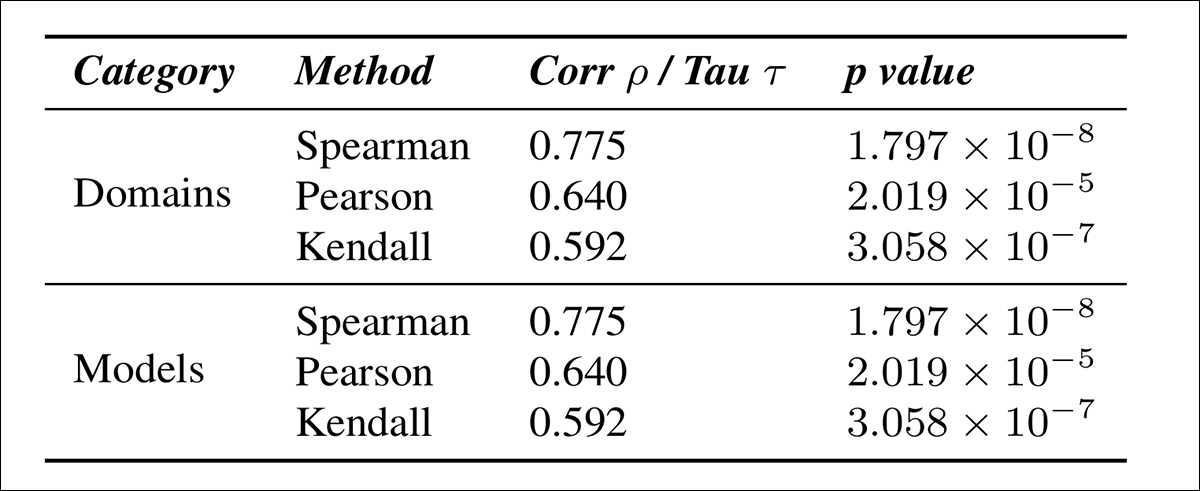

Corrélation entre la surconfiance et la performance réelle à travers différents dispositifs expérimentaux, montrant que le modèle Dunning-Kruger reste constant dans toutes les conditions et est le plus fort lorsque plusieurs réponses diverses sont échantillonnées à partir du même modèle.

Les résultats de la table ci-dessus indiquent à quel point l’effet Dunning-Kruger se manifeste dans ces conditions, restant présent dans chaque cas ; et que le DKE était le plus prononcé lorsque plusieurs réponses étaient échantillonnées à partir du même modèle à température élevée.

Pour mieux comprendre comment la performance perçue diverge de la performance réelle, l’étude a comparé les estimations de confiance absolue et relative, en calculant à quel point chaque modèle surestimait sa propre capacité (spécifiquement, la différence entre son score de confiance et sa précision réelle), et en mesurant ensuite comment cette surestimation se rapportait à la performance réelle du modèle :

Corrélation entre la surconfiance (mesurée comme la confiance absolue moins la confiance relative) et la précision réelle à travers les domaines de programmation et les types de modèles, montrant que la surestimation plus importante est systématiquement associée à une performance plus faible.

Les résultats de la table ci-dessus illustrent comment la surestimation se rapporte à la performance réelle, à la fois à travers les domaines de programmation et à travers les modèles. Dans les deux cas, on peut voir que les modèles avec une précision plus faible tendent à montrer une plus grande surconfiance.

De plus, les modèles spécialisés formés sur des domaines plus étroits ont montré des effets DKE plus forts que les modèles généralistes :

Corrélation entre la surestimation et la performance réelle pour les modèles de base, les modèles spécialisés à domaine unique et les modèles spécialisés à plusieurs domaines, montrant des effets DKE plus forts à mesure que la spécialisation augmente.

En utilisant le jeu de données MultiPL-E à travers huit langages de programmation, les auteurs ont constaté que la formation à domaine unique conduisait à une plus grande surconfiance que les dispositifs de base ou multi-domaines, suggérant que le DKE s’aggrave avec une spécialisation accrue.

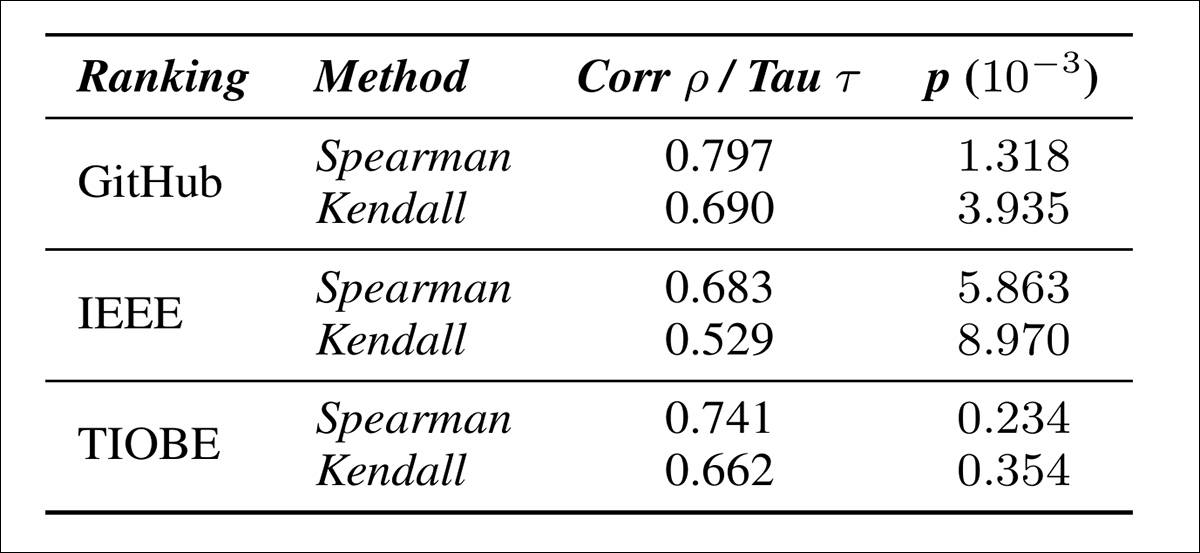

Les tests ont également révélé que les modèles tendent à être plus surconfiants dans les langages de programmation rares. À travers les classements GitHub, IEEE et TIOBE, la rareté est fortement corrélée à une confiance perçue plus élevée, culminant à 0,797 :

Corrélation entre la surconfiance du modèle et la rareté du langage, en utilisant trois classements de popularité. Les langages moins courants sont associés à une performance perçue plus élevée.

Enfin, les auteurs ont testé si l’effet Dunning-Kruger apparaît dans la génération de code, en évaluant les modèles sur le jeu de données MultiPL-E à travers les langages Ada, Dart, Prolog, Swift, C++, Python, C# et Elixir.

Bien que l’effet soit toujours présent, il était nettement plus faible que dans le paramètre de questions à choix multiple, reflétant probablement la plus grande difficulté à évaluer la confiance et la correction dans les tâches ouvertes :

Corrélation entre la surconfiance et la performance réelle dans la génération de code ouvert, basée sur les résultats de MultiPL-E à travers huit langages.

En considérant l’explication encore disputée de l’effet Dunning-Kruger, les auteurs concluent :

‘Une explication potentielle qui peut être commune aux humains et aux modèles d’IA est l’explication métacognitive, qui stipule que l’évaluation de la qualité d’une performance d’une compétence est une partie cruciale de l’acquisition d’une compétence.

‘Cette explication peut potentiellement être testée expérimentalement dans les modèles d’IA avec une étude contrôlée de différentes stratégies de formation et si elles conduisent toutes à des améliorations simultanées de la performance et de la capacité à évaluer la qualité de la performance. Cependant, cette étude est significativement au-delà de la portée de cet article, et nous la laissons pour les travaux futurs.’

Conclusion

Même dans son domaine natif, l’effet Dunning-Kruger (comme le note l’article) peut être attribué soit à une cause statistique, soit à une cause cognitive. Si c’est une cause statistique, l’application d’un syndrome humain unique à un contexte d’apprentissage automatique est en fait tout à fait valable.

Bien que les auteurs spéculent que la cause pourrait être trouvée pour être ‘cognitive’ dans les deux cas, cela nécessiterait un point de vue légèrement plus métaphysique.

Peut-être la découverte la plus intéressante dans l’article est l’étendue à laquelle plusieurs LLM de codage ont tendance à doubler dans leurs circonstances les moins favorables, c’est-à-dire en manifestant une confiance maximale lorsqu’ils traitent des langages les plus rares ou les moins connus – ce qui serait une stratégie presque immédiatement autodestructrice dans un environnement de travail réel.

* Les langages de programmation utilisés étaient Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript et Visual Basic.

Publié pour la première fois mercredi 8 octobre 2025