Intelligence artificielle

AnomalyGPT: Détection d’anomalies industrielles à l’aide de LVLM

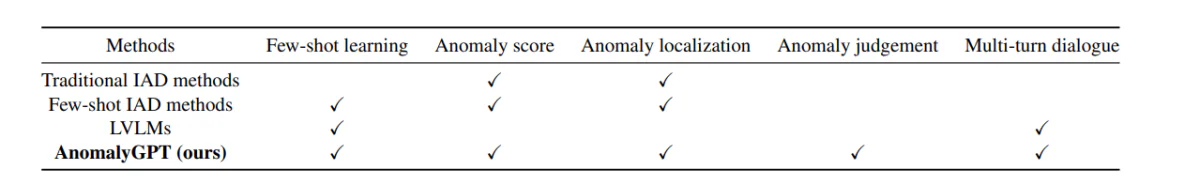

Récemment, les grands modèles de vision et de langage (LVLM) tels que LLava et MiniGPT-4 ont démontré leur capacité à comprendre les images et à atteindre une grande précision et efficacité dans plusieurs tâches visuelles. Alors que les LVLM excellent dans la reconnaissance d’objets courants en raison de leurs jeux de données d’entraînement étendus, ils manquent de connaissances spécifiques au domaine et ont une compréhension limitée des détails localisés dans les images. Cela limite leur efficacité dans les tâches de détection d’anomalies industrielles (IAD). D’un autre côté, les cadres IAD existants ne peuvent identifier que les sources d’anomalies et nécessitent des réglages de seuil manuels pour distinguer les échantillons normaux des échantillons anormaux, ce qui restreint leur mise en œuvre pratique.

Le but principal d’un cadre IAD est de détecter et de localiser les anomalies dans les scénarios industriels et les images de produits. Cependant, en raison de l’imprévisibilité et de la rareté des échantillons d’images du monde réel, les modèles sont généralement formés uniquement sur des données normales. Ils différencient les échantillons anormaux des échantillons normaux en fonction des écarts par rapport aux échantillons typiques. Actuellement, les cadres IAD et les modèles fournissent principalement des scores d’anomalie pour les échantillons de test. De plus, la distinction entre les instances normales et anormales pour chaque classe d’articles nécessite la spécification manuelle de seuils, ce qui les rend inadaptés aux applications du monde réel.

Pour explorer l’utilisation et la mise en œuvre des grands modèles de vision et de langage pour résoudre les défis posés par les cadres IAD, AnomalyGPT, une nouvelle approche IAD basée sur LVLM, a été introduite. AnomalyGPT peut détecter et localiser les anomalies sans nécessiter de réglages de seuil manuels. De plus, AnomalyGPT peut également fournir des informations pertinentes sur l’image pour interagir de manière interactive avec les utilisateurs, leur permettant de poser des questions de suivi en fonction de l’anomalie ou de leurs besoins spécifiques.

Détection d’anomalies industrielles et grands modèles de vision et de langage

Les cadres IAD existants peuvent être classés en deux catégories.

- Détection d’anomalies basée sur la reconstruction.

- Détection d’anomalies basée sur l’intégration de fonctionnalités.

Dans un cadre IAD basé sur la reconstruction, l’objectif principal est de reconstruire les échantillons d’anomalies en échantillons normaux et de détecter les anomalies en calculant l’erreur de reconstruction. SCADN, RIAD, AnoDDPM et InTra utilisent différents cadres de reconstruction allant des réseaux antagonistes génératifs (GAN) et des auto-encodeurs aux modèles de diffusion et de transformateurs.

D’un autre côté, dans un cadre IAD basé sur l’intégration de fonctionnalités, l’objectif principal est de se concentrer sur la modélisation de l’intégration de fonctionnalités des données normales. Des méthodes comme PatchSSVD tentent de trouver une hypersphère qui peut encapsuler étroitement les échantillons normaux, tandis que des cadres comme PyramidFlow et Cfl projettent les échantillons normaux sur une distribution gaussienne à l’aide de flux de normalisation. Les cadres CFA et PatchCore ont établi une banque de mémoire d’échantillons normaux à partir d’intégrations de fonctionnalités de patches et utilisent la distance entre l’intégration de fonctionnalités de l’échantillon de test et l’intégration de fonctionnalités normale pour détecter les anomalies.

Ces deux méthodes suivent le paradigme d’apprentissage « un modèle par classe », qui nécessite un grand nombre d’échantillons normaux pour apprendre les distributions de chaque classe d’objets. La nécessité d’un grand nombre d’échantillons normaux les rend impraticables pour les nouvelles catégories d’objets et les environnements de produits dynamiques. D’un autre côté, le cadre AnomalyGPT utilise un paradigme d’apprentissage en contexte pour les catégories d’objets, ce qui lui permet de permettre l’interférence avec seulement un petit nombre d’échantillons normaux.

Ensuite, nous avons les grands modèles de vision et de langage ou LVLM. Les LLM ou les grands modèles de langage ont connu un succès considérable dans l’industrie du NLP et sont maintenant explorés pour leurs applications dans les tâches visuelles. Le cadre BLIP-2 utilise Q-former pour introduire des fonctionnalités visuelles du transformateur de vision dans le modèle Flan-T5. De plus, le cadre MiniGPT relie la partie image du cadre BLIP-2 et le modèle Vicuna avec une couche linéaire et effectue un processus de finetuning en deux étapes à l’aide de données image-texte. Ces approches indiquent que les cadres LLM pourraient avoir certaines applications pour les tâches visuelles. Cependant, ces modèles ont été formés sur des données générales et manquent de l’expertise spécifique au domaine requise pour des applications généralisées.

Comment fonctionne AnomalyGPT ?

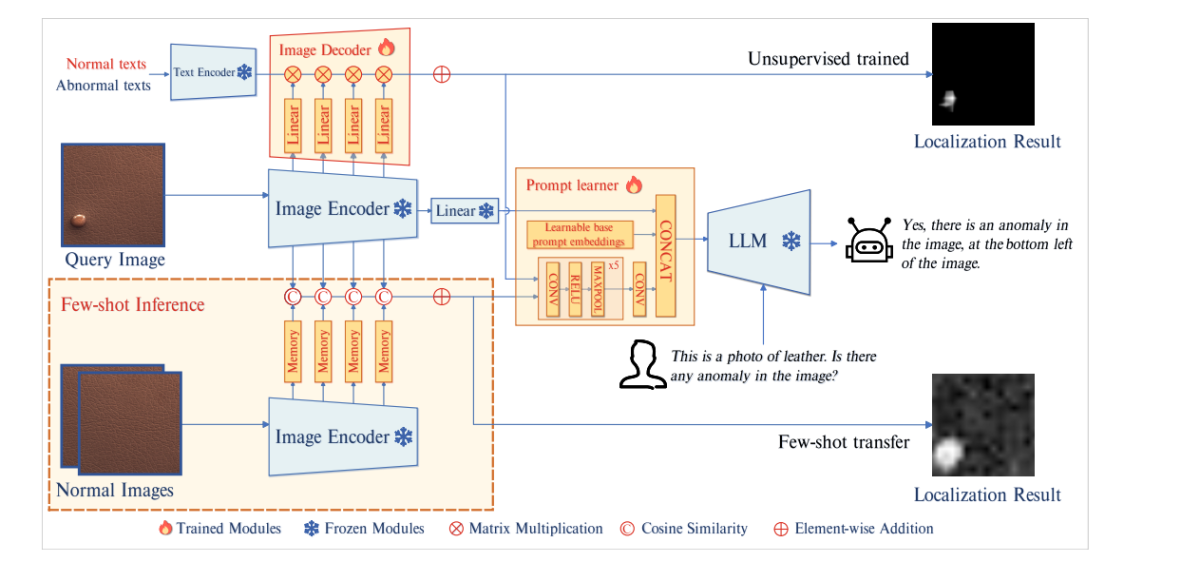

AnomalyGPT est en son cœur un nouveau modèle de détection d’anomalies conversationnel IAD-vision et de langage conçu principalement pour détecter les anomalies industrielles et localiser leur emplacement exact à l’aide d’images. Le cadre AnomalyGPT utilise un LLM et un encodeur d’image pré-entraîné pour aligner les images avec leurs descriptions textuelles correspondantes à l’aide de données d’anomalies simulées. Le modèle introduit un module de décodeur et un module d’apprentissage de prompt pour améliorer les performances des systèmes IAD et atteindre une sortie de localisation au niveau des pixels.

Architecture du modèle

L’image ci-dessus représente l’architecture d’AnomalyGPT. Le modèle passe d’abord l’image de requête à l’encodeur d’image gelé. Le modèle extrait ensuite les fonctionnalités au niveau des patches à partir des couches intermédiaires et les alimente dans un décodeur d’image pour calculer leur similarité avec les textes anormaux et normaux pour obtenir les résultats de localisation. Le module d’apprentissage de prompt les convertit ensuite en intégrations de fonctionnalités de prompt qui peuvent être utilisées comme entrées dans le LLM aux côtés des entrées textuelles de l’utilisateur. Le modèle LLM utilise ensuite les intégrations de fonctionnalités de prompt, les entrées d’image et les entrées textuelles de l’utilisateur pour détecter les anomalies, localiser leur emplacement et créer des réponses finales pour l’utilisateur.

Décodeur

Pour atteindre une localisation d’anomalie au niveau des pixels, le modèle AnomalyGPT déploie un décodeur d’image basé sur l’appariement de fonctionnalités qui prend en charge à la fois les cadres IAD à quelques exemples et les cadres IAD non supervisés. La conception du décodeur utilisé dans AnomalyGPT est inspirée des cadres WinCLIP, PatchCore et APRIL-GAN. Le modèle divise l’encodeur d’image en 4 étapes et extrait les fonctionnalités au niveau des patches à chaque étape.

Cependant, ces fonctionnalités intermédiaires n’ont pas subi l’alignement final image-texte, ce qui signifie qu’elles ne peuvent pas être comparées directement avec les fonctionnalités. Pour résoudre ce problème, le modèle AnomalyGPT introduit des couches supplémentaires pour projeter les fonctionnalités intermédiaires et les aligner sur les fonctionnalités de texte qui représentent les sémantiques normales et anormales.

Apprentissage de prompt

Le cadre AnomalyGPT introduit un module d’apprentissage de prompt qui tente de transformer le résultat de localisation en intégrations de fonctionnalités de prompt pour exploiter les sémantiques fines provenant des images et maintenir également la cohérence sémantique entre les sorties du décodeur et du LLM. De plus, le modèle intègre des intégrations de fonctionnalités de prompt apprenables, non liées aux sorties du décodeur, dans le module d’apprentissage de prompt pour fournir des informations supplémentaires pour la tâche IAD. Enfin, le modèle alimente les intégrations de fonctionnalités et les informations d’image d’origine dans le LLM.

Le module d’apprentissage de prompt se compose d’intégrations de fonctionnalités de prompt de base apprenables et d’un réseau neuronal convolutionnel. Le réseau convertit le résultat de localisation en intégrations de fonctionnalités de prompt et forme un ensemble d’intégrations de fonctionnalités de prompt qui sont ensuite combinées avec les intégrations de fonctionnalités d’image dans le LLM.

Simulation d’anomalie

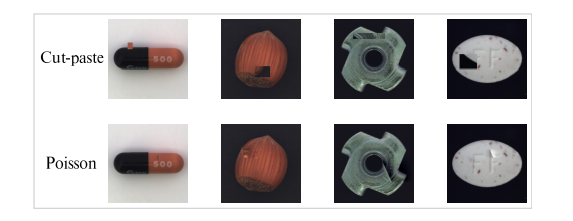

Le modèle AnomalyGPT adopte la méthode NSA pour simuler des données anormales. La méthode NSA utilise la technique de découpe-collage en utilisant la méthode d’édition d’image de Poisson pour atténuer la discontinuité introduite par la pose de segments d’image. La technique de découpe-collage est couramment utilisée dans les cadres IAD pour générer des images d’anomalies simulées.

La technique de découpe-collage consiste à rogner une région de bloc dans une image de manière aléatoire et à la coller dans un emplacement aléatoire dans une autre image, créant ainsi une partie d’anomalie simulée. Ces échantillons d’anomalies simulées peuvent améliorer les performances des modèles IAD, mais il existe un inconvénient, car ils peuvent souvent produire des discontinuités visibles. La méthode d’édition de Poisson vise à cloner de manière transparente un objet d’une image à une autre en résolvant les équations aux dérivées partielles de Poisson.

L’image ci-dessus illustre la comparaison entre la méthode de Poisson et la méthode de découpe-collage. Comme on peut le voir, il y a des discontinuités visibles dans la méthode de découpe-collage, tandis que les résultats de la méthode de Poisson semblent plus naturels.

Contenu de question et de réponse

Pour effectuer un réglage de prompt sur le grand modèle de vision et de langage, le modèle AnomalyGPT génère une requête textuelle correspondante sur la base de l’image d’anomalie. Chaque requête se compose de deux parties principales. La première partie de la requête consiste en une description de l’image d’entrée qui fournit des informations sur les objets présents dans l’image ainsi que leurs attributs attendus. La deuxième partie de la requête est de détecter la présence d’anomalies dans l’objet ou de vérifier s’il y a une anomalie dans l’image.

Le LLM répond d’abord à la requête de savoir s’il y a une anomalie dans l’image. Si le modèle détecte des anomalies, il continue à spécifier l’emplacement et le nombre de zones anormales. Le modèle divise l’image en une grille de 3×3 de régions distinctes pour permettre au LLM d’indiquer verbalement la position des anomalies comme le montre la figure ci-dessous.

Le modèle LLM est alimenté avec des connaissances descriptives de l’entrée avec des connaissances fondamentales de l’image d’entrée qui aident la compréhension du modèle des composants de l’image.

Ensembles de données et métriques d’évaluation

Le modèle effectue ses expériences principalement sur les ensembles de données VisA et MVTec-AD. L’ensemble de données MVTec-AD se compose de 3629 images pour la formation et de 1725 images pour le test, réparties sur 15 catégories différentes, ce qui en fait l’un des ensembles de données les plus populaires pour les cadres IAD. Les images de formation présentent uniquement des images normales, tandis que les images de test présentent à la fois des images normales et anormales. D’un autre côté, l’ensemble de données VisA se compose de 9621 images normales et d’environ 1200 images anormales, réparties sur 12 catégories différentes.

Ensuite, comme les cadres IAD existants, le modèle AnomalyGPT utilise la zone sous la courbe ROC (AUC) comme métrique d’évaluation, avec une AUC au niveau des pixels et une AUC au niveau des images pour évaluer les performances de localisation d’anomalies et de détection d’anomalies, respectivement. Cependant, le modèle utilise également la précision au niveau des images pour évaluer les performances de l’approche proposée, car elle permet de déterminer la présence d’anomalies sans nécessiter de réglages de seuil manuels.

Résultats

Résultats quantitatifs

Détection d’anomalies industrielles à quelques exemples

Le modèle AnomalyGPT compare ses résultats avec les cadres IAD à quelques exemples précédents, notamment PaDiM, SPADE, WinCLIP et PatchCore, comme lignes de base.

La figure ci-dessus compare les résultats du modèle AnomalyGPT avec les cadres IAD à quelques exemples. À travers les deux ensembles de données, la méthode suivie par AnomalyGPT surpasse les approches adoptées par les modèles précédents en termes d’AUC au niveau des images et retourne également une bonne précision.

Détection d’anomalies industrielles non supervisée

Dans un cadre de formation non supervisée avec un grand nombre d’échantillons normaux, AnomalyGPT forme un seul modèle sur des échantillons obtenus de toutes les classes dans l’ensemble de données. Les développeurs d’AnomalyGPT ont opté pour le cadre UniAD car il est formé dans le même cadre et servira de ligne de base pour la comparaison. De plus, le modèle compare également les cadres JNLD et PaDim en utilisant le même paramétrage unifié.

La figure ci-dessus compare les performances d’AnomalyGPT par rapport aux autres cadres.

Résultats qualitatifs

L’image ci-dessus illustre les performances du modèle AnomalyGPT dans la détection d’anomalies non supervisée, tandis que la figure ci-dessous démontre les performances du modèle dans l’apprentissage en contexte à un exemple.

Le modèle AnomalyGPT est capable d’indiquer la présence d’anomalies, de marquer leur emplacement et de fournir des résultats de localisation au niveau des pixels. Lorsque le modèle est en apprentissage en contexte à un exemple, les performances de localisation du modèle sont légèrement inférieures par rapport à la méthode non supervisée en raison de l’absence de formation.

Conclusion

AnomalyGPT est un nouveau modèle de détection d’anomalies conversationnel IAD-vision et de langage conçu pour exploiter les puissantes capacités des grands modèles de vision et de langage. Il ne peut pas seulement identifier les anomalies dans une image mais également localiser leur emplacement exact. De plus, AnomalyGPT facilite les dialogues à plusieurs tours axés sur la détection d’anomalies et présente des performances exceptionnelles dans l’apprentissage en contexte à quelques exemples. AnomalyGPT explore les applications potentielles des LVLM dans la détection d’anomalies, introduisant de nouvelles idées et possibilités pour l’industrie IAD.