Intelligence artificielle

Introduction à Vertex AI

Étant donné le paysage en constante évolution de l’intelligence artificielle, l’un des plus grands obstacles que les dirigeants technologiques rencontrent souvent est la transition de l’expérimental au prêt à l’entreprise. Alors que les chatbots grand public et les plateformes interactives aident à l’imagination du public, les entreprises ne peuvent pas réussir avec une simple interface de chat. À une époque où la concurrence est plus agressive que jamais, les entreprises ont besoin d’un écosystème robuste, évolutif et sécurisé, et c’est ce que Google tente d’offrir avec Vertex AI, la plateforme d’intelligence artificielle et d’apprentissage automatique unifiée de Google Cloud.

Vertex AI tente de se solidifier comme le socle pour l’intégration de l’IA générative avec les infrastructures cloud modernes, offrant une gamme complète de fonctionnalités qui combler le fossé entre les modèles de base bruts et les applications de production. Vertex AI n’est pas simplement un wrapper pour les grands modèles de langage (LLM), mais plutôt un écosystème d’apprentissage automatique et d’intelligence artificielle (ML/AI) unifié qui traite l’IA générative comme un citoyen de première classe de l’infrastructure cloud moderne.

Au cœur de Vertex AI se trouve le Jardin de modèles, un marché central qui fournit l’accès à plus de 200 modèles de base curatés, notamment le modèle multimodal puissant Gemini 2.5 Pro, qui présente une fenêtre de contexte de 2 millions de jetons. Dans cet article, nous allons analyser l’architecture de Vertex AI, explorer comment le Model Garden sert de « App Store » pour l’intelligence, et examiner les piliers techniques qui font de cette plateforme le socle du prochain génération de logiciels d’entreprise.

L’Architecture de base : une plateforme unifiée

Vertex AI n’est pas une collection de outils déconnectés, mais un écosystème de données et d’IA unifié conçu pour combler la fragmentation des données, des outils et des équipes qui caractérise l’apprentissage automatique à ce jour. Traditionnellement, le développement de l’IA se déroule dans des environnements isolés, et parfois, les données sont réparties et piégées dans plusieurs référentiels. Par exemple, les organisations peuvent stocker les données client dans des entrepôts SQL tandis que les documents non structurés sont déversés dans un lac de données. Lorsque les données sont cloisonnées, l’IA ne voit que la « vérité partielle », ce qui conduit à des résultats biaisés ou à des taux d’hallucination élevés car elle manque du contexte complet de l’entreprise.

Vertex AI tente d’intégrer l’ensemble du cycle de vie, de l’ingestion des données brutes dans BigQuery et Cloud Storage à la surveillance de production, servant essentiellement de « tissu conjonctif » entre ces silos. Vertex AI s’intègre de manière native avec Cloud Storage et BigQuery, permettant aux modèles d’IA de récupérer les données sans pipelines complexes d’extraction, de transformation et de chargement.

La Fondation : l’hypercalculateur d’IA de Google

La couche GenAI de Vertex AI repose sur l’architecture d’hypercalculateur d’IA de Google, un système de supercalcul intégré, qui se compose de :

TPU v5p et v5e (Unités de traitement de tenseurs)

Les unités de traitement de tenseurs de Google sont des circuits intégrés spécifiques à l’application (ASIC) conçus spécifiquement pour la multiplication de matrices qui définit l’apprentissage profond.

- TPU v5p (Performance) : C’est l’accélérateur phare pour une formation massive. Chaque grappe TPU v5p peut être mise à l’échelle jusqu’à 8 960 puces interconnectées par l’interconnecteur de puces le plus haut débit de Google (ICI) à 4 800 Gbps. Pour un responsable technique, cela signifie une formation 2,8 fois plus rapide pour un modèle de la taille de GPT-3 (175 milliards de paramètres) par rapport à la génération précédente, réduisant ainsi considérablement le temps de mise sur le marché.

- TPU v5e (Efficiency) : Conçu pour des performances « optimisées pour le coût », le v5e est le cheval de bataille pour la formation à l’échelle moyenne et l’inférence à haut débit. Il offre jusqu’à 2,5 fois meilleure performance en termes de prix, ce qui en fait le choix idéal pour les entreprises qui doivent exécuter une inférence 24h/24 sans un budget massif.

NVIDIA H100/A100 GPUs pour la flexibilité

Alors que les TPU sont spécialisés, de nombreux équipes de développement s’appuient sur l’écosystème NVIDIA CUDA. Vertex AI offre un support de première classe pour le matériel le plus récent de NVIDIA :

- NVIDIA H100 (Hopper) : Idéal pour l’ajustement fin des plus grands modèles open source (comme Llama 3.1 405B) qui nécessitent un débit de mémoire massif.

- Jupiter Networking : Pour éviter le « goulet d’étranglement du réseau », Google utilise son tissu de réseau de centre de données Jupiter. Cela garantit que les données se déplacent entre les GPU à une vitesse fulgurante, en prenant en charge le RDMA (accès direct à la mémoire distante) pour contourner la surcharge du processeur et offrir des performances quasi locales sur des nœuds distribués.

Orchestration dynamique

Le changement technique le plus critique dans Vertex AI est l’orchestration dynamique. Dans un environnement hérité, si un nœud GPU échoue au cours d’une exécution de formation de 3 semaines, l’ensemble du travail peut échouer.

- Résilience automatisée : Vertex AI, souvent alimenté par Google Kubernetes Engine (GKE) sous le capot, présente des nœuds « auto-réparateurs ». Si une erreur matérielle est détectée, la plateforme migre automatiquement la charge de travail vers un nœud sain.

- Planificateur de charge de travail dynamique : Cet outil permet aux équipes de demander une capacité en fonction de l’urgence. Vous pouvez opter pour Flex Start (moins cher, commence lorsque la capacité est disponible) ou une capacité garantie pour les versions de mission critique.

- Formation sans serveur : Pour les équipes qui souhaitent une gestion d’infrastructure nulle, la formation sans serveur Vertex AI vous permet de soumettre votre code et vos données ; la plateforme fournit le cluster, exécute le travail et le détruit—facturant uniquement les secondes de calcul utilisées.

Les trois points d’entrée : découverte, expérimentation et automatisation

Pour accueillir différents personnages techniques, des scientifiques des données aux développeurs d’applications, Vertex AI propose trois points d’entrée principaux :

- Model Garden : Le marché de la découverte.

- Vertex AI Studio : Le terrain de jeu de l’expérimentation.

- Vertex AI Agent Builder : L’usine d’automatisation.

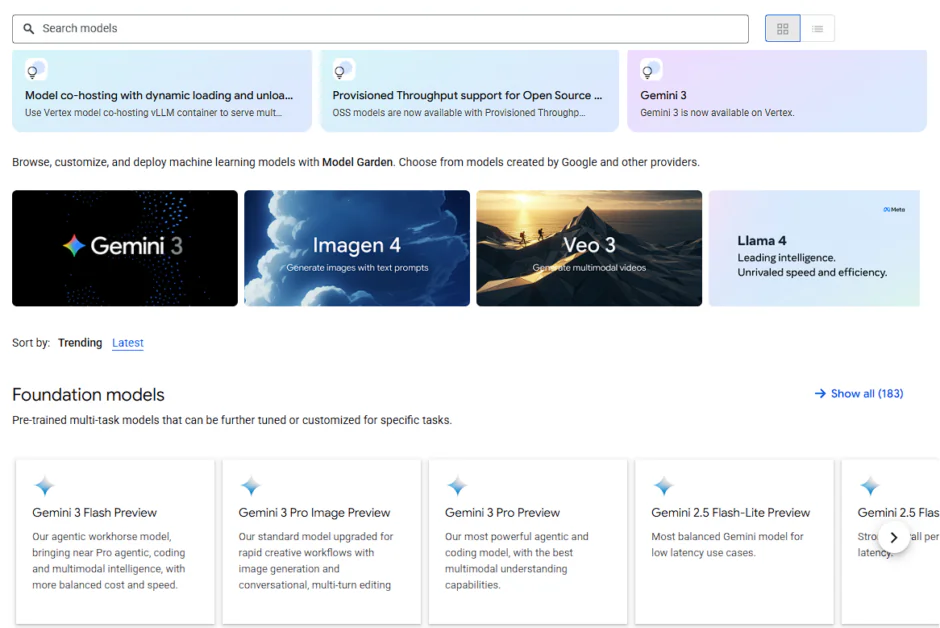

Model Garden : Le marché de la découverte

Le Model Garden de Google Cloud est une plateforme centralisée au sein de Google Cloud pour la découverte, le test, la personnalisation et le déploiement d’une large gamme de modèles d’IA de première partie, open source et de tiers, y compris des modèles multimodaux (vision, texte, code) pour divers besoins commerciaux, offrant une intégration transparente avec les outils de Vertex AI pour une MLOps fluide. Il agit comme une bibliothèque complète, aidant les développeurs et les entreprises à sélectionner le bon modèle (des grands modèles de base aux modèles spécialisés) pour leurs tâches, qu’il s’agisse de génération de texte, d’analyse d’images ou de complétion de code, et à les déployer efficacement dans leur environnement Google Cloud.

Model Garden divise ses 200+ modèles en trois niveaux distincts, permettant aux architectes d’équilibrer les performances, le coût et le contrôle :

- Modèles de première partie (Google) : Ce sont les modèles multimodaux phares disponibles dans Vertex AI, et Google les propose dans différentes tailles, allant du Pro avec une raison complexe au Flash avec une faible latence et un volume élevé, permettant ainsi aux développeurs d’optimiser leurs modèles en fonction de leurs cas d’utilisation.

- Modèles de tiers (propriétaires) : Grâce à des partenariats stratégiques, Vertex AI propose un accès « Model-as-a-Service » (MaaS) à des géants comme Anthropic (Claude 3.5) et Mistral AI. Au lieu de gérer des factures et des informations d’identification de sécurité distinctes pour cinq différents fournisseurs d’IA, une équipe technique peut accéder à tous ces services via son projet Google Cloud existant, en utilisant un format d’API unifié.

- Modèles open source et open-weight : Ce niveau comprend Meta’s Llama 3.2, Mistral et le propre Gemma de Google. Ce sont des modèles idéaux pour les organisations qui souhaitent déployer des modèles dans leur propre VPC (Virtual Private Cloud) pour garantir une isolation des données maximale.

Dans un environnement non unifié, le déploiement d’un modèle open source comme Llama nécessite la configuration d’un environnement PyTorch, la configuration des pilotes CUDA et la gestion d’un wrapper Flask ou FastAPI.

Model Garden élimine cette phase de « préparation » grâce à des points de terminaison gérés unifiés :

- Déploiement en un clic : Pour de nombreux modèles, cliquer sur « Déployer » provisionne automatiquement les ressources TPU/GPU nécessaires, enveloppe le modèle dans un conteneur prêt pour la production et fournit un point de terminaison d’API REST.

- Intégration Hugging Face : Vertex AI permet désormais aux développeurs de déployer des modèles directement depuis le Hugging Face Hub dans un point de terminaison Vertex, offrant une expansion presque infinie de l’intelligence disponible.

- Private Service Connect (PSC) : Pour des secteurs hautement réglementés, les modèles peuvent être déployés à l’aide de Private Service Connect, garantissant que le point de terminaison du modèle n’est jamais exposé à Internet public—maintenant le trafic de données strictement dans le réseau d’entreprise.

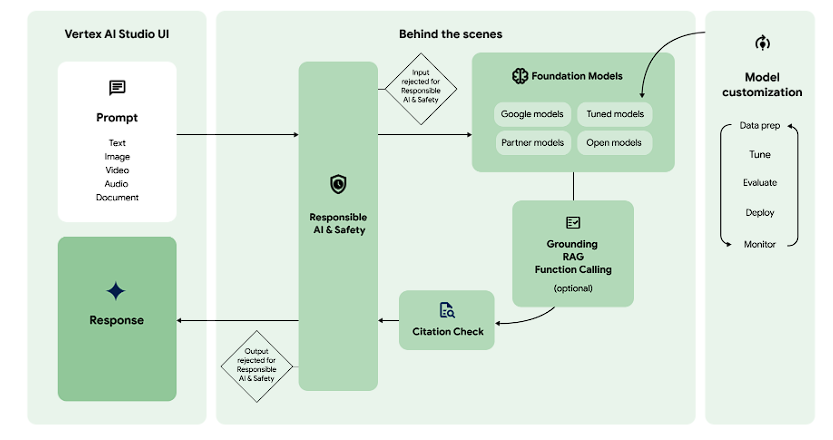

Vertex AI Studio : Le terrain de jeu de l’expérimentation

Alors que le Model Garden est axé sur la sélection, Vertex AI Studio est axé sur la précision. Vertex AI Studio peut être comparé aux compilateurs et débogueurs que l’on rencontre dans le monde logiciel traditionnel. Le Vertex AI Studio est l’espace de travail où les modèles bruts sont sculptés en outils commerciaux spécifiques grâce à une combinaison d’ingénierie de prompt, de tests multimodaux et d’ajustement avancé des hyperparamètres.

Prototypage multimodal : au-delà du texte

L’une des fonctionnalités les plus remarquables du Studio est son support natif pour la multimodalité. Alors que d’autres plateformes nécessitent un codage complexe pour gérer les données non textuelles, Vertex AI Studio vous permet de déposer directement des fichiers dans l’interface pour tester les capacités de raisonnement de Gemini 2.5.

- Intelligence vidéo : Vous pouvez télécharger une conférence technique de 45 minutes et demander au modèle d’« identifier chaque fois qu’une API spécifique est mentionnée et de fournir un résumé avec horodatage ».

- Analyse de documents : Au lieu de simplement lire le texte, le modèle peut analyser la mise en page visuelle d’un PDF de 1 000 pages, en comprenant la relation entre les graphiques, les tableaux et la prose environnante.

- Exécution de code : Le Studio prend désormais en charge l’exécution de code dans le terrain de jeu. Si vous demandez à un modèle de résoudre un problème mathématique complexe ou d’analyser un fichier CSV, le modèle peut écrire et exécuter du code Python dans un environnement de bac à sable sécurisé pour fournir une réponse vérifiée.

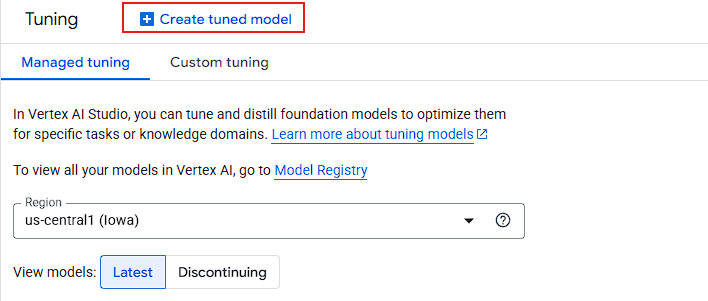

Personnalisation avancée : le parcours d’ajustement

Lorsque l’ingénierie de prompt (Zero-shot ou Few-shot) atteint un plafond, Vertex AI Studio fournit le matériel lourd : ajustement de modèle.

- Ajustement fin supervisé (SFT) : Les développeurs fournissent un ensemble de données de paires « Prompt/Réponse » (idéalement 100+ exemples). Cela enseigne au modèle à adopter une voix de marque spécifique, un format de sortie (comme un JSON spécialisé) ou un jargon spécifique au domaine.

- Mise en cache du contexte : Pour les entreprises qui traitent des ensembles de données massifs et statiques (comme une bibliothèque juridique ou une base de code), le Studio permet la mise en cache du contexte. Cela permet de « précharger » un million de jetons de données dans la mémoire du modèle, réduisant ainsi considérablement la latence et les coûts pour les requêtes ultérieures.

- Distillation (enseignant-étudiant) : Il s’agit d’une manœuvre architecturale de haut niveau. Vous pouvez utiliser un modèle massif (Gemini 2.5 Pro) pour « enseigner » un modèle plus petit et plus rapide (Gemini 2.0 Flash). Le résultat est un modèle léger qui se comporte au niveau « Pro » mais s’exécute à la vitesse et au coût « Flash ».

Vertex AI Agent Builder : L’usine d’automatisation

Vertex AI Agent Builder est un cadre d’orchestration de haut niveau qui permet aux développeurs de créer ces agents en combinant des modèles de base avec des données d’entreprise et des API externes.

L’Architecture de la « Vérité » : ancrage et RAG

La principale barrière technique à l’IA d’entreprise est l’hallucination. Agent Builder résout ce problème grâce à un moteur d’ancrage sophistiqué.

- Ancre avec Google Search : Pour les requêtes nécessitant une connaissance du monde en temps réel (par exemple, « Quels sont les taux d’hypothèque actuels à New York ? »), l’agent peut effectuer une recherche Google, extraire les faits et citer ses sources.

- Vertex AI Search (RAG-as-a-Service) : Au lieu de construire manuellement une base de données vectorielle (Pinecone, Weaviate), les développeurs peuvent utiliser Vertex AI Search pour indexer leurs propres documents (PDF, HTML, BigQuery). Il gère automatiquement les étapes de « fragmentation », d’« intégration » et de « récupération », garantissant que l’agent ne répond qu’en fonction de sa « Source de Vérité » interne.

- Moteur RAG de Vertex AI : Pour des implémentations personnalisées à grande échelle, ce service géré permet une recherche hybride (combinant des résultats vectoriels et basés sur des mots clés) pour améliorer la précision de jusqu’à 30 % par rapport aux sorties LLM standard.

Orchestration multi-agents (protocole A2A)

Les flux de travail d’entreprise avancés nécessitent souvent plusieurs agents spécialisés travaillant ensemble. Vertex AI introduit le protocole Agent-to-Agent (A2A), une norme ouverte qui permet :

- L’« agent de voyage » pour discuter avec l’« agent financier » pour garantir qu’une réservation de vol est dans le budget de l’entreprise.

- Interopérabilité : Puisqu’il utilise un protocole ouvert, les agents construits sur Vertex peuvent communiquer avec ceux construits sur d’autres cadres tels que LangChain ou CrewAI.

La pile de développement : ADK et moteur d’agent

Pour le public de la « plateforme technique », Agent Builder propose deux chemins distincts :

- Console sans code : Une interface de glisser-déposer visuelle pour la prototypage rapide et la configuration de l’utilisateur commercial.

- Kit de développement d’agent (ADK) : Un kit de développement Python de première classe pour les ingénieurs. Il permet un « Prompt-as-Code », une intégration de contrôle de version et la possibilité de déployer sur le moteur d’agent Vertex AI—un environnement d’exécution géré qui gère automatiquement la persistance de session, le scaling et la gestion d’état.

Conclusion : de « Et si » à « Qu’est-ce qui vient ensuite »

La transition d’une démo d’IA spectaculaire à une application d’entreprise de production a longtemps été le « val de la mort » pour les projets de transformation numérique. Comme nous l’avons exploré, Vertex AI est conçu spécifiquement pour combler ce fossé. En unifiant les silos fragmentés de données, d’infrastructure et d’orchestration de modèles, Google Cloud a déplacé la conversation loin du pouvoir brut des grands modèles de langage et vers la maturité opérationnelle du cycle de vie de l’IA.