Angle d’Anderson

L’IA Préfère Lire Le Livre Plutôt Que Regarder Le Film

Il est surprenant de constater à quel point il est difficile d’obtenir des modèles d’IA pour regarder et commenter du contenu vidéo réel, même s’ils sont conçus pour cette tâche. Ils sont plus intéressés par le mot écrit.

Si vous avez déjà essayé de télécharger une petite vidéo sur ChatGPT ou sur un modèle de vision/langage populaire similaire, vous avez peut-être été surpris de constater qu’ils ne peuvent pas vraiment analyser les vidéos. Alors que des modèles tels que ChatGPT-4o+ sont capables d’analyser des images individuelles – sous la forme d’images, telles que JPEG et PNG –, ils préfèrent que l’utilisateur extrait lui-même les images et les télécharge sous forme d’images (qu’ils sont prêts à commenter).

Dans le cas de la série GPT d’OpenAI, on peut, de manière plutôt fastidieuse, extraire une série complète d’images d’une vidéo et les fournir à ChatGPT, à des fins telles que la génération d’une piste narrative créée par l’IA pour la vidéo :

![Images et code d'un didacticiel OpenAI sur l'analyse de plusieurs images extraites pour développer un commentaire généré par l'IA pour une vidéo. [ Source ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Images et code d’un didacticiel OpenAI sur l’analyse de plusieurs images extraites pour développer un commentaire généré par l’IA pour une vidéo. Source

Mais cela incombe à l’utilisateur d’effectuer la conversion de la vidéo en images, soit en appelant des fonctions dans une routine plus large, comme dans l’exemple ci-dessus, soit en extrayant les images avec FFMPEG ou diverses solutions de montage vidéo gratuites ou payantes.

Dans une certaine mesure, peut-être même dans une large mesure, les limitations d’analyse de la vidéo dans des produits à grande échelle tels que ChatGPT sont liées à l’utilisation des ressources : il suffit d’équiper une seule instance d’IA avec une sélection des codecs vidéo les plus populaires et de consacrer des ressources de calcul au processus disque-lourd et gourmand en CPU de l’extraction, ce qui n’est pas une considération mineure, si des centaines de millions d’utilisateurs décident de commencer à utiliser ces installations tous les jours.

De plus, l’analyse temporelle peut peindre un tableau très différent que celui d’une seule image (imaginez quelqu’un qui entre dans une maison dans un état d’esprit heureux et qui découvre ensuite un corps) ; par conséquent, prendre en compte la totalité de la « somme de contrôle » temporelle d’une vidéo, même courte, est une tâche exigeante et gourmande en ressources, ainsi qu’un domaine de recherche spécialisé, par exemple avec le développement en cours de cadres tels que Optical Flow – qui déplie essentiellement une longueur de vidéo de telle sorte qu’elle puisse être considérée et traitée comme si elle était un document statique :

![Les diagrammes de flux optique montrent comment le mouvement est suivi à travers les images d'une séquence vidéo, avec des vecteurs verts indiquant la direction et l'intensité du mouvement. Ces cartes fournissent la continuité temporelle nécessaire pour les VLM et peuvent également servir de guides structurels dans les flux de travail VFX. [ Source ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Les diagrammes de flux optique montrent comment le mouvement est suivi à travers les images d’une séquence vidéo, avec des vecteurs verts indiquant la direction et l’intensité du mouvement. Ces cartes fournissent la continuité temporelle nécessaire pour les VLM et peuvent également servir de guides structurels dans les flux de travail VFX. Source

Se Contenter Des Notes De Fin De Chapitre

Néanmoins, puisque des modèles tels que Google’s Notebook LM et les entrées ChatGPT les plus récentes sont capables de lire les métadonnées associées (c’est-à-dire le contenu texte intégré qui contextualise la vidéo d’une certaine manière), ils n’interdisent pas les téléchargements de fichiers vidéo ; et parfois, ils vont même tenter d’interpréter une vidéo qui ne contient pas de telles données.

Dans le cas suivant, j’ai téléchargé un extrait aléatoire de 6 secondes du film italien La Main De Dieu (2021) sur NotebookLM, en veillant à ce que l’extrait ne contienne aucun texte utile, ni dans les métadonnées ni dans le nom du fichier.

NotebookLM a ensuite procédé à une élaboration matérialisée de contenu totalement sans rapport avec la vidéo*, complète avec un podcast sans rapport et sans rapport de cinq minutes :

Un moment de la vie quotidienne dans un extrait de 6 secondes d’un film italien est complètement mal interprété par NotebookLM. Source : Google NotebookLM

Bien que Notebook, comme ChatGPT, accepte une vidéo YouTube comme entrée, il ne le fera que si la vidéo comporte une annotation de texte ou des sous-titres (et non des sous-titres rasterisés intégrés à la vidéo).

De cette façon, le travail difficile de regarder réellement le contenu de la vidéo et d’effectuer une interprétation sémantique (une nécessité légale pour YouTube, en raison de ses mesures de protection des droits d’auteur, et de son système de détection d’identité en attente), a été effectué à loisir après le téléchargement de l’utilisateur, et lorsque l’extrait pouvait être alloué les ressources de traitement nécessaires.

L’interprétation réelle de la vidéo est coûteuse et épuisante, et il s’avère que même les modèles qui ont été formés spécifiquement pour effectuer cette tâche préfèrent lire du texte plutôt que regarder réellement la vidéo.

TL;DW

Ceci, selon un nouvel article du Royaume-Uni de l’Université de Bristol, intitulé Une Vidéo Ne Vaut Pas Mille Mots, dans lequel les deux auteurs concluent que les modèles de vision de langue actuels (VLM) – modèles spécifiquement conçus pour être capables d’analyser des vidéos de manière plus approfondie, et de participer à la réponse à des questions sur des vidéos (VQA) – défaillent également à l’information basée sur le texte chaque fois que possible.

Lorsqu’ils sont donnés à la fois des images en mouvement et des questions et des réponses à choix multiples, les auteurs de l’article ont constaté que les modèles basaient généralement leurs choix sur des modèles dans le texte, plutôt que sur ce qui se passe à l’écran – dans de nombreux cas, en performant tout aussi bien même lorsque la question était supprimée entièrement.

Dans ce qui apparaît comme une forme habituelle de raccourci ou de tricherie, ce qui importe le plus aux modèles est de pouvoir repérer des modèles dans les réponses possibles ; seuls lorsque la tâche est rendue plus difficile, en ajoutant plus d’options de réponses, les IA commencent à prêter une attention plus grande à la vidéo.

Les auteurs ont soumis des tests de VQA dans une gamme de conditions à six modèles de VLM de longueurs de contexte divers ; et ont constaté que les résultats indiquaient la dépendance des modèles à l’égard du texte par rapport au contenu de la vidéo.

![Exemple de l'étude montrant comment un modèle d'analyse de vidéo pondère ce qu'il voit par rapport à ce qu'il lit. La vidéo montre une personne tissant du bambou, mais le modèle attribue beaucoup plus d'importance au texte de la question et de la réponse qu'aux images elles-mêmes. Les éléments en surbrillance bleue soutiennent la réponse choisie, tandis que les éléments en surbrillance rouge les tirent dans la direction opposée, illustrant comment la raison du modèle se concentre sur le texte et non sur les images en mouvement. [Source] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Exemple de l’étude montrant comment un modèle d’analyse de vidéo pondère ce qu’il voit par rapport à ce qu’il lit. La vidéo montre une personne tissant du bambou, mais le modèle attribue beaucoup plus d’importance au texte de la question et de la réponse qu’aux images elles-mêmes. Les éléments en surbrillance bleue soutiennent la réponse choisie, tandis que les éléments en surbrillance rouge les tirent dans la direction opposée, illustrant comment la raison du modèle se concentre sur le texte et non sur les images en mouvement. Source

Méthode

Pour comprendre à quel point chaque entrée contribue à la décision d’un modèle, les nouveaux travaux utilisent une méthode de la théorie des jeux appelée Valeurs de Shapley. À l’origine conçue pour diviser équitablement une rémunération entre les joueurs d’une coalition, les Valeurs de Shapley attribuent un crédit à chaque « joueur » en fonction de son impact individuel.

En effet, les « joueurs » dans ce scénario sont soit les images de la vidéo, soit les composants textuels (annotations, sous-titres, légendes, etc.) d’une tâche de VQA ; et la « rémunération » est la réponse finale du modèle. En testant systématiquement ce qui se passe lorsque chaque partie est ajoutée ou supprimée, la technique révèle à quel point cet élément était important pour parvenir à la réponse choisie.

Dans le cas du nouveau projet, afin d’étendre la méthode à plusieurs types de données, les Valeurs de Shapley ont été adaptées pour gérer des modalités mixtes, avec des composants vidéo et texte traités de manière distincte, et leur influence variable sur les sorties des modèles mesurée, révélant si le contenu de la vidéo était réellement interprété, ou si des indices écrits étaient utilisés comme raccourcis.

Métriques

Deux métriques simples ont été définies pour comparer à quel point chaque modalité (c’est-à-dire la vidéo, la question ou la réponse) contribue à la décision du modèle : Contribution de la modalité mesure à quel point la totalité de l’explication provient de chaque type d’entrée ; ici, toutes les valeurs de Shapley disponibles sont additionnées, et la part appartenant à chaque modalité est calculée en pourcentage de la totalité.

Deuxièmement, Contribution par fonctionnalité corrige le fait que certaines modalités, comme la vidéo, contiennent beaucoup plus de fonctionnalités que d’autres. Au lieu de cela, la valeur de Shapley moyenne est calculée pour chaque fonctionnalité, et ces moyennes sont comparées pour déterminer quelle modalité a une influence dominante.

Données et Tests

Les auteurs ont testé l’approche sur six VLM avec une variété de caractéristiques conçues pour garantir que les principes des tests soient largement applicables et généralisables. Par conséquent, les modèles ont été choisis pour différentes longueurs de contexte, différents âges (c’est-à-dire depuis la sortie du cadre), et différentes configurations d’architecture.

Les prétendants étaient FrozenBiLM ; InternVideo ; VideoLLaMA2 ; VideoLLaMA3 ; LLaVa-Video (qui utilise Qwen2) ; et LongVA (également utilisant Qwen2).

Avec le même objectif de diversité, les quatre ensembles de données ciblés choisis étaient EgoSchema, un ensemble de données de VQA conçu pour être impossible à compléter sans visionner complètement les vidéos associées ; HD-EPIC, un ensemble de données axé sur la cuisine avec certaines vidéos inhabituellement longues ; MVBench, un ensemble de données assemblé à partir de contributions d’autres ensembles de données ; et LVBench, qui pose des questions de VQA pour des vidéos très longues.

À partir de ceux-ci, les auteurs ont conçu 60 questions – dix de chaque type de question.

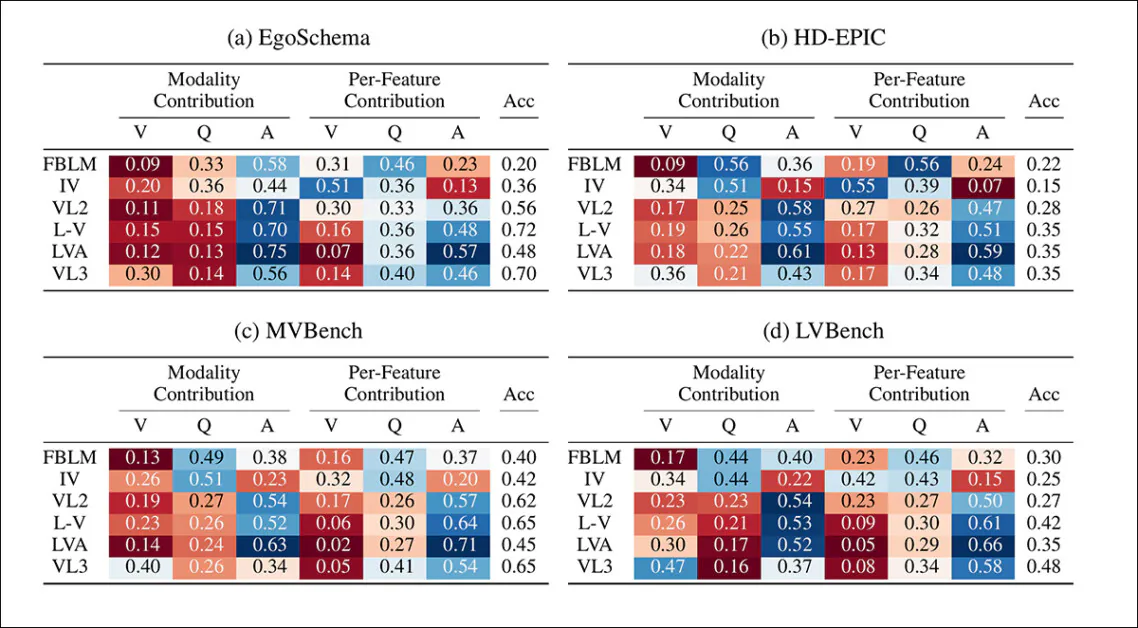

Les métriques de contribution ont rendu clair que la plupart des modèles s’appuyaient moins sur la vidéo que sur le texte, en particulier lorsqu’ils étaient jugés image par image. Même lorsque la vidéo faisait une présentation raisonnable, son influence par fonctionnalité était souvent minime, suggérant que même si le modèle utilisait la vidéo dans son ensemble, il prêtait peu d’attention aux images individuelles. VideoLLaMA3 était la principale exception ici, avec une dépendance visuelle plus lourde, en particulier sur les séquences plus longues de LVBench :

Scores de contribution de modalité (MC) et de contribution par fonctionnalité (PFC) pour les modèles et les ensembles de données, montrant le poids relatif des entrées de vidéo (V), de question (Q) et de réponse (A). Les couleurs froides indiquent des contributions plus fortes ; les couleurs chaudes indiquent des influences plus faibles ou négligeables. Dans la plupart des paramètres, le langage est clairement dominant, avec la vidéo souvent mise de côté – en particulier dans l’influence par image.

Comme pour le texte, la question tendait à être plus importante que la réponse, en particulier dans les modèles plus forts. Cela était le plus évident dans des ensembles de données tels que EgoSchema, où les questions étaient plus longues et plus naturalistes, tandis que les réponses étaient courtes et parfois schématiques. MVBench a inversé cela en partie, puisque sa structure de réponse binaire gonfle l’importance apparente des jetons de réponse.

À travers tous les modèles et les ensembles de données, cependant, la vision a été systématiquement mise de côté, avec le langage faisant la majeure partie du travail.

L’article indique :

[Pour] les modèles à long contexte, la vidéo montre des contributions considérablement réduites, ce qui signifie que les valeurs de Shapley par image sont beaucoup plus petites que leurs homologues de fonctionnalité de texte.

‘La vidéo en tant que modalité est clairement toujours très pertinente, mais cela constitue une preuve que les valeurs de Shapley de ses images individuelles sont plus centrées autour de zéro, et que l’attention du modèle à celles-ci est beaucoup moins guidée que pour le texte.’

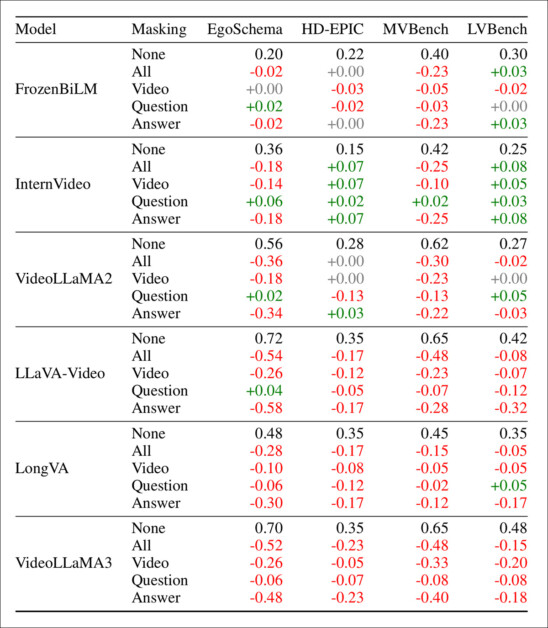

Pour tester à quel point chaque partie de l’entrée (vidéo, texte, etc.) contribue à la précision du modèle, les chercheurs ont mené des tests supplémentaires en utilisant le masquage – en cachant intentionnellement une ou plusieurs parties de l’entrée, et en voyant à quel point la précision du modèle change en conséquence.

Si les performances chutent fortement lorsque une entrée particulière est supprimée, cette entrée est probablement importante ; si le modèle se comporte de la même manière, cela suggère que la pièce manquante n’était pas fortement utilisée. Dans ce sens, les tests de masquage sont une sorte d’étude d’ablation itérative.

Impact sur les performances du masquage des entrées de vidéo, de question ou de réponse sur quatre références de VQA. Les scores montrent le changement par rapport à la référence non masquée. Le rouge signifie une précision plus faible, le vert une précision plus élevée. Les modèles ont souvent conservé des scores élevés sans vidéo, mais ont perdu plus lorsque la réponse (texte) a été supprimée. La question pouvait généralement être masquée avec un effet minimal.

Les résultats (visualisés ci-dessus) indiquent que les réponses (réponses textuelles dans les données à choix multiple) portent le plus de poids dans l’ensemble. Le masquage de la réponse a généralement entraîné la plus grande baisse de précision, réduisant souvent les modèles à des performances proches de l’aléatoire.

Cependant, le masquage de la question a généralement eu beaucoup moins d’effet, ce qui soutient la constatation antérieure selon laquelle les modèles sous-estiment la question.

Dans certains cas, la précision a même augmenté lorsque la question a été supprimée, ce qui implique que les modèles correspondaient parfois simplement des réponses à des indices textuels ou visuels plutôt que d’évaluer correctement la question.

Les modèles ont également varié dans leur dépendance à l’égard de la vidéo : certains ont maintenu une précision raisonnable sans elle, confirmant ainsi la contribution limitée des fonctionnalités de la vidéo dans de nombreux paramètres actuels.

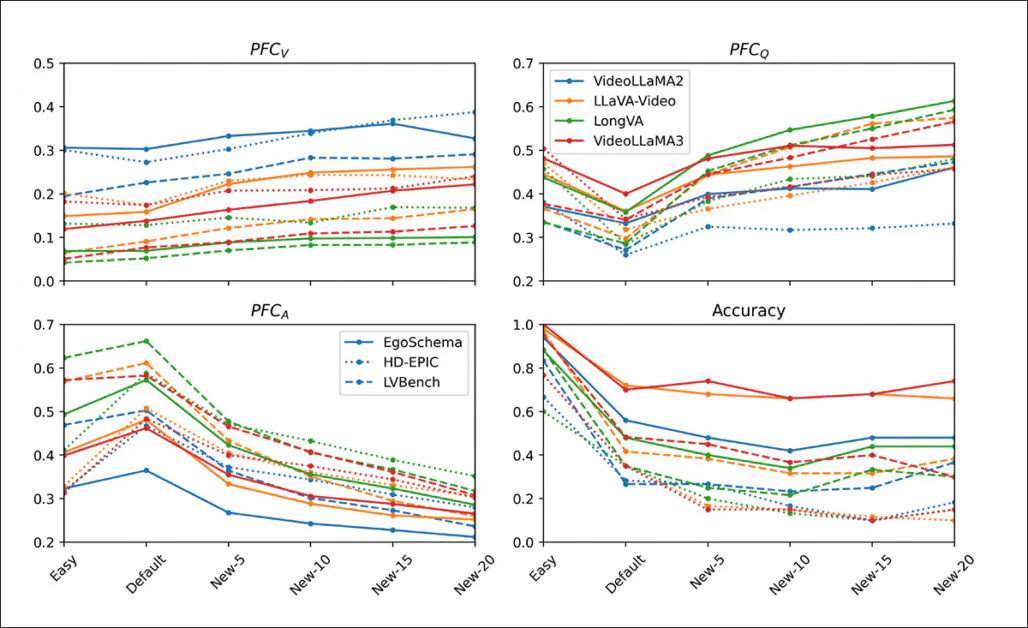

Les auteurs ont ensuite testé si les modèles pouvaient être forcés à s’appuyer sur la vidéo en ajoutant des réponses incorrectes supplémentaires aux options de choix multiple.

Lorsque les distracteurs étaient faciles et recyclés à partir d’autres questions, les performances ont augmenté, car les modèles correspondaient à des modèles de texte sans beaucoup de raisonnement. Mais avec dix réponses ou plus sans rapport, ils ont commencé à s’appuyer davantage sur la vidéo et la question :

Contribution par fonctionnalité et précision pour les entrées de vidéo, de question et de réponse, à mesure que des réponses incorrectes supplémentaires sont ajoutées à chaque test de VQA, montrant que l’augmentation du nombre de distracteurs réduit la dominance du texte et augmente l’influence relative des fonctionnalités visuelles et de question.

Pour VideoLLaMA3, le masquage de la vidéo a réduit la précision de 40 % sur EgoSchema et de 15 % sur LVBench, indiquant qu’une simple augmentation du nombre de réponses peut déplacer les modèles des raccourcis textuels vers une véritable raisonnement multimodal.

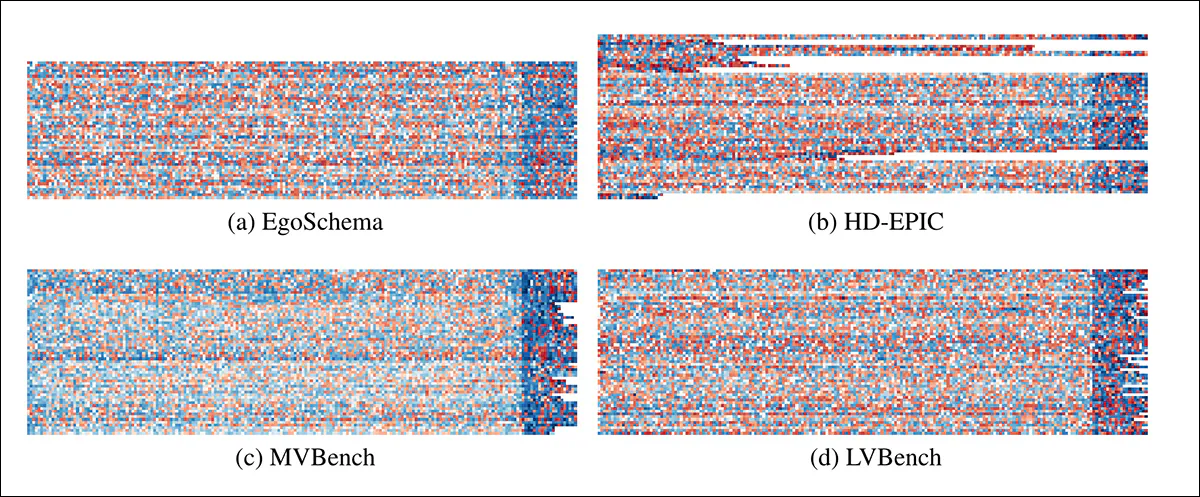

Les chercheurs ont également exploré comment l’attribution est répartie sur les entrées, et ci-dessous nous voyons des cartes thermiques de valeurs de Shapley pour chaque entrée du modèle :

Cartes thermiques de valeurs de Shapley pour quatre ensembles de données, où chaque ligne montre un tuple de VQA, et chaque colonne une fonctionnalité unique. Les fonctionnalités de la vidéo apparaissent à gauche, suivies du texte. Les valeurs beaucoup plus fortes dans les régions de texte (en rouge) confirment que les modèles s’appuient beaucoup plus sur le langage que sur la vidéo.

En commentant les résultats ci-dessus, les auteurs déclarent :

‘Les valeurs de Shapley sont beaucoup plus grandes vers le côté droit de chaque carte thermique, représentant les attributions de question et de réponse. Cette limite nette est là où les images de la vidéo se terminent et où les fonctionnalités de texte commencent, démontrant que la contribution de la modalité de la vidéo est beaucoup moins importante que la question/réponse. ‘

En résumé, à travers tous les ensembles de données, les valeurs sont beaucoup plus fortes vers l’extrémité du texte du spectre, indiquant fortement que les modèles s’appuient beaucoup plus sur le langage que sur les indices visuels. Même lorsque la vidéo est utilisée, la contribution est répartie de manière fine sur de nombreuses images, souvent sans modèle cohérent.

Ci-dessous, nous voyons un exemple annoté de EgoSchema. Les 16 images les plus « importantes » ont été sélectionnées à l’aide de valeurs de Shapley et colorées en fonction de leur influence, le bleu indiquant une contribution positive et le rouge une contribution négative :

Attributions de Shapley pour un exemple unique de EgoSchema, montrant les 16 images les plus influentes et toutes les entrées de texte. Les contributions de la vidéo sont minimes par rapport au texte, qui domine la raison du modèle. Le bleu et le rouge indiquent une influence positive et négative sur la réponse sélectionnée.

Conclusion

Quiconque a déjà joué avec la vidéo ou l’analyse de la vidéo sait déjà à quel point ces processus sont gourmands en ressources, et comprend pourquoi les entreprises analysant des millions de requêtes basées sur l’IA par jour ne peuvent pas se permettre de laisser les utilisateurs exécuter des processus de vidéo et d’interprétation ad hoc à leur guise.

Une chose à retenir à cet égard est que presque chaque API d’interface utilisateur que vous essayerez (à l’exception possible d’une nouvelle démo à court terme pour soutenir de nouvelles recherches scientifiques) cherche à accomplir les souhaits de l’utilisateur au niveau de dépense de ressources le plus bas possible.

Cela signifie s’appuyer sur les métadonnées existantes à partir de données fournies par l’utilisateur ou sur des retrievals RAG, si possible ; et extraire (si absolument nécessaire) des métadonnées pour des formats plus analysables tels que PDF, documents et images uniques.

Ce qui n’est pas sur la table, c’est de faire passer la vidéo téléchargée par CLIP ou la dernière version de YOLO, ou par n’importe quel VLM gourmand en ressources et en temps qui puisse réellement identifier ce qui se trouve dans les images et comprendre ce qui se passe dans la vidéo fournie, en tenant compte de la temporalité.

Cependant, cela ne signifie pas que les phénomènes que l’article documente nécessairement découlent d’approches architecturales parcimonieuses. Les auteurs observent que le texte domine les paradigmes de formation multimodaux actuels dans tous les cas, indiquant que le « langage visuel » est soit moins développé, moins important ou informatif dans un contexte multimodal, soit (au moins pour le moment) moins bien compris,

* Intéressant, le matériel que NotebookLM a créé semble être soit entièrement original, soit complètement non répertorié par Google, car je ne parviens pas à trouver de résultats Web qui auraient pu s’infiltrer dans les données de formation et déclencher cette sortie.

Publié pour la première fois vendredi 31 octobre 2025 ; édité 14h20 pour la mise en forme