Leaders d’opinion

De Code à Guérison : La Prochaine Révolution de l’IA a Besoin d’une Main (Et de Yeux)

Comment les systèmes agents, les lunettes intelligentes XR et la robotique vont autonomiser les humains et non les remplacer

Nous vivons une paradoxe dans l’intelligence artificielle.

Sur les écrans, l’IA est surhumaine. Les grands modèles de langage écrivent du code Python fonctionnel en quelques secondes. Les systèmes génératifs produisent des images et des vidéos photoréalistes en quelques minutes. Les systèmes lauréats du prix Nobel comme AlphaFold ont prédit les structures de presque toutes les protéines connues. Les victoires numériques s’accumulent.

Pourtant, dans le monde physique de la recherche biomédicale, le processus de découverte reste péniblement manuel. Nous ne sentons pas vraiment l’IA accélérer la science ou la médecine, du moins pas encore. Les chiffres révèlent l’ampleur du problème. Une enquête phare de Nature auprès de plus de 1 500 scientifiques a constaté que plus de 70 % ont essayé et échoué à reproduire les expériences d’un autre chercheur. Plus inquiétant encore : plus de la moitié n’a pas pu reproduire ses propres travaux. En biologie du cancer, en particulier, un projet de reproductibilité de huit ans a constaté que seulement 40 % des résultats à fort impact pouvaient être reproduits et que 68 % des expériences manquaient de documentation suffisante pour même tenter de les reproduire.

Ceci est le secret sale de la science moderne : nous avons un problème de capture des connaissances, et non seulement un problème de découverte. Les détails expérimentaux critiques vivent dans la tête des chercheurs, et non dans les articles. Les protocoles dérivent. Les connaissances tacites s’en vont lorsque les stagiaires sont diplômés. Les systèmes d’IA formés sur la littérature publiée héritent de toutes ces lacunes.

Le problème fondamental est que même si une IA peut concevoir une nouvelle protéine pour la thérapie contre le cancer dans une simulation numérique, elle ne peut pas ramasser une pipette pour la tester. Elle ne peut pas naviguer dans la réalité désordonnée et imprévisible d’un laboratoire humide pour valider sa propre hypothèse. Elle ne peut pas regarder les mains d’un scientifique expérimenté et apprendre les techniques subtiles qui font fonctionner les expériences.

Ceci est la plus grande bouteille à l’entrée qui empêche la révolution de l’IA de devenir une révolution médicale. Alors que la plupart des sociétés de robotique sont encore occupées à enseigner aux machines à plier le linge ou à charger les lave-vaisselle, elles sont en retard sur les capacités réellement transformatrices de ces progrès dans des domaines tels que la médecine.

Pour résoudre ce problème, nous devons aller au-delà des chatbots et des systèmes d’IA co-scientifiques, des systèmes agents qui relient le monde numérique et le monde physique, en poussant au-delà de la planification et de la programmation pour atteindre l’exécution dans le monde réel. À Stanford, nous développons LabOS, un cadre numérique-physique d’IA qui démontre comment les agents d’IA, les lunettes intelligentes XR et la robotique collaborative peuvent s’unir pour fermer cette boucle, en transformant les expériences scientifiques en une conversation collaborative entre humains et machines, tout en capturant automatiquement les connaissances qui se perdent actuellement.

La Grande Divorce : Pourquoi l’IA a Besoin de “Yeux” et de “Mains”

La plupart des victoires les plus visibles de l’IA se sont produites là où l’environnement est entièrement numérique : référentiels de code, ensembles de données curatés ou benchmarks simulés (où l’IA concourt pour exécuter une entreprise virtuelle ou investir numériquement dans des actions).

Les laboratoires humides sont différents. La biologie, et en général, la découverte scientifique, est un processus très bruyant. Les instruments dérivent, les opérateurs improvisent, et « le protocole » vit souvent en partie dans la tête des gens. La différence entre un résultat propre et une course échouée peut être un angle de pipetage, un motif de vortex, un remplacement de réactif ou une incubation qui a duré 10 minutes de plus. Ces détails contextuels ne font rarement l’objet d’un article et sont exactement ce dont un modèle d’IA a besoin s’il doit généraliser au-delà d’un ensemble de données.

C’est pourquoi l’IA de laboratoire a besoin d’yeux (pour percevoir ce qui se passe dans le contexte), de mains (pour standardiser et automatiser les étapes à forte variance) et de mémoire (pour enregistrer ce qui s’est réellement passé). Sans ces capacités, les modèles peuvent recommander ce qu’il faut faire, mais ils ne peuvent pas traduire de manière fiable les recommandations en exécution physique validée ou expliquer les échecs lorsque la réalité diverge du plan.

Au-delà des Chatbots : Des Copilotes à des Co-Scientifiques

Le terme « d’IA agente » est parfois utilisé de manière décontractée. Dans les milieux biomédicaux, il devrait signifier quelque chose de précis : un système capable de prendre un objectif (par exemple, « optimiser l’efficacité de l’édition de gènes CRISPR tout en minimisant les cibles hors cible »), de le décomposer en une séquence de tâches, d’exécuter ces tâches à travers des outils, d’évaluer les résultats et d’adapter le plan sous contraintes et avec une prise de décision auditable.

Ceci est important car les flux de travail de recherche ne sont pas un seul appel de modèle. Ils sont des pipelines de bout en bout qui s’étendent de la formulation d’hypothèses, de la conception expérimentale, du traitement des données, des tests statistiques et de l’interprétation. La réflexion récente dans la découverte de médicaments a commencé à mettre l’accent sur les systèmes agents qui peuvent mettre à l’échelle ces pipelines plutôt que d’accélérer simplement les étapes individuelles (par exemple, la discussion d’Unite.AI sur les agents dans la découverte de petites molécules).

Dans l’ingénierie logicielle, nous avons déjà vu des preuves empiriques précoces que les copilotes d’IA peuvent augmenter la productivité des développeurs. En biomedicine, l’opportunité analogue n’est pas seulement d’écrire du code, mais d’écrire et de valider des protocoles, de structurer les données, de surveiller l’exécution et de fermer la boucle entre prédiction et mesure, en reliant l’IA aux scientifiques dans les laboratoires.

LabOS : Lorsque l’IA s’exécute sur un Système d’Exploitation pour les Laboratoires de Demain

Dans notre travail à Stanford sur AI4Science, qui couvre les copilotes de modification génétique tels que CRISPR-GPT et les systèmes de co-exécution AI-XR tels que LabOS qui aident les scientifiques dans les laboratoires de biologie et de science des matériaux, nous explorons un changement architectural :

1. Conception d’un « système d’exploitation de laboratoire » qui relie un laboratoire numérique (sec) à un laboratoire physique (humide).

Le prétexte est simple : si un carnet de laboratoire est la mémoire de la science, alors un système d’exploitation de laboratoire devrait être la couche d’exécution, en capturant l’intention, en la traduisant en actions, en observant les résultats et en transformant chaque exécution en connaissances structurées.

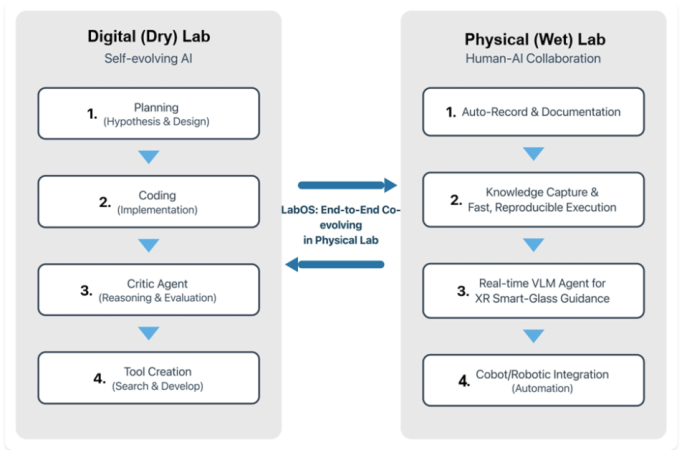

Figure. Une vue conceptuelle de LabOS reliant une boucle numérique autonome (planification, codage, critique, création d’outils) avec une boucle humaine de laboratoire humide (auto-documentation, capture de connaissances, guidage XR et intégration robotique).

2. L’IA dans le Laboratoire Numérique – Planification et Construction d’Outils Auto-améliorants

Dans le laboratoire numérique (sec), nous pouvons laisser l’IA faire ce qu’elle fait déjà bien : rechercher, synthétiser et proposer. Mais nous voulons aussi qu’elle s’améliore. Pas en « hallucinant de nouvelles sciences », mais en apprenant de meilleurs outils et flux de travail à partir de la rétroaction.

Une boucle de laboratoire numérique pratique peut être encadrée comme quatre étapes récurrentes :

- Planification (hypothèse + conception) : proposer des hypothèses, sélectionner des variables expérimentales, anticiper les facteurs de confusion et spécifier les résultats mesurables.

- Codage (implémentation) : générer ou adapter des scripts d’analyse, des pipelines de simulation et des modèles de contrôle d’instrument où approprié.

- Agent critique (raisonnement + évaluation) : tester les hypothèses, vérifier la puissance statistique, proposer des contrôles et signaler les modes de défaillance probables.

- Création d’outils (recherche + développement) : lorsque le flux de travail manque d’un composant (un analyseur, une routine de contrôle qualité, un tableau de bord), le construire et le réintégrer dans la boîte à outils.

3. L’IA dans le Laboratoire Physique – L’IA avec des “Yeux” (Lunettes XR) et des “Mains” (Robotique)

Le laboratoire physique (humide) est où le système gagne ou perd la confiance. L’objectif n’est pas de remplacer le scientifique, mais de réduire les frictions et les erreurs tout en augmentant l’observabilité.

Nous considérons la boucle de laboratoire physique comme quatre capacités complémentaires :

- Enregistrement automatique et documentation : capturer les actions, les horodatages, les paramètres d’instrument et les déviations automatiquement, de sorte que la documentation ne soit pas une après-pensée.

- Capture de connaissances pour une exécution rapide et reproductible : convertir les exécutions en artefacts structurés et interrogables (versions de protocole, ensembles de paramètres, résultats de contrôle qualité) alignés sur les principes de gestion des données tels que FAIR.

- Guidage en temps réel via des lunettes intelligentes XR : utiliser des modèles multimodaux pour interpréter la scène (ce que l’opérateur fait, quel réactif est en main) et fournir des conseils étape par étape et des contrôles de sécurité. L’AR/XR a déjà démontré sa valeur dans des flux de travail physiques à haute mise tels que la guidance expérimentale (LabOS, Stanford, Princeton, en collaboration avec NVIDIA).

- Intégration de la robotique pour l’automatisation : standardiser les étapes répétitives, permettre des transferts sûrs et réduire la variabilité. Les plateformes pour les flux de travail de simulation à réel (par exemple NVIDIA Isaac) et le traitement d’IA en temps réel sur le bord tel que le streaming en direct et l’interaction humaine-IA dans LabOS sont des couches d’activation importantes.

Cette architecture est alignée sur une direction plus large dans le domaine : « les laboratoires autonomes » ou « auto-conduits » qui combinent l’automatisation avec l’apprentissage automatique pour planifier la prochaine expérience. Ce que LabOS ajoute, c’est une couche d’interface humaine plus serrée, de sorte que l’autonomie ne se fasse pas au détriment de la transparence.

Pourquoi l’IA de Laboratoire N’est Pas Juste « l’IA sur un Ensemble de Données »

Les systèmes d’IA pour la super-intelligence biomédicale/scientifique semblent souvent impressionnants dans l’évaluation rétrospective ou en passant des examens, puis sous-performant dans le laboratoire physique. La raison n’est rarement un seul bogue. C’est généralement une discordance entre les hypothèses du modèle et la réalité du laboratoire.

Trois lacunes se présentent régulièrement :

- Lacune de contexte : les ensembles de données omettent généralement les variables contextuelles que les opérateurs savent importantes (excursions de température, numéros de lot de réactifs, déviations subtiles de protocole).

- Lacune d’action : de nombreux systèmes d’IA peuvent recommander ce qu’il faut faire, mais ne peuvent pas traduire de manière fiable les recommandations en étapes physiques validées.

- Lacune de rétroaction : sans rétroaction structurée et de haute qualité à partir de l’exécution, les modèles ne peuvent pas apprendre où ils échouent – et les scientifiques ne peuvent pas auditer pourquoi.

Fermer ces lacunes est moins une question d’invention d’une nouvelle architecture de réseau neuronal, mais plus de construction de l’instrumentation, des interfaces et des contrats de données qui rendent le laboratoire lisible pour les machines, et permettent à l’IA de voir et de travailler avec les humains.

Confiance par Conception : Sécurité et Gouvernance pour l’IA qui Peut Agir

L’IA agente dans la recherche de découverte ne soulève pas seulement des préoccupations familières concernant la précision. Elle introduit de nouveaux modes de défaillance parce qu’elle peut agir. Dans un laboratoire, l’action signifie le potentiel de gaspillage, de préjudice ou de conclusions trompeuses, en particulier lorsque les expériences alimentent des hypothèses cliniques.

Une mentalité utile est de traiter une pile de laboratoire d’IA comme un système socio-technique qui nécessite une assurance. Plusieurs cadres existants aident, mais ils doivent être traduits dans la réalité du laboratoire :

- La gestion des risques comme une pratique continue : le cadre de gestion des risques d’IA de NIST (AI RMF 1.0) fournit un vocabulaire pratique pour cartographier, mesurer et gérer les risques d’IA tout au long du cycle de vie.

- L’alignement réglementaire pour l’IA médicale : le plan d’action de la FDA sur les logiciels d’IA/ML en tant que dispositif médical (SaMD), y compris son plan d’action et les directives connexes, offre une vue concrète de ce que ressemble une « bonne pratique » lorsque l’IA impacte les soins aux patients.

Pour les domaines à haute conséquence tels que la modification génétique, la gouvernance est déjà une conversation mondiale. Des recommandations sont discutées sur l’édition du génome humain, pour souligner la nécessité de mécanismes de surveillance appropriés et d’une gouvernance responsable, tels que ceux proposés par la Société américaine de thérapie génique et cellulaire, ou ASGCT. Des systèmes comme LabOS devraient être conçus pour faciliter la conformité, et non la rendre plus difficile.

Check-list : Contrôles pour des Co-Scientifiques d’IA Sécurisés pour la Découverte Scientifique

À notre avis, un système d’exploitation de laboratoire prudent devrait mettre en œuvre au moins les conceptions suivantes :

- Provenance par défaut : chaque ensemble de données, version de protocole et sortie de modèle devraient être traçables aux entrées et aux horodatages.

- Autonomie limitée : le système devrait avoir des autorisations explicites (ce qu’il peut faire sans confirmation) et des règles d’escalade (lorsqu’il doit demander).

- Annulation humaine et dégradation en douceur : lorsque les capteurs ou les flux de données défaillent, ou lorsque l’incertitude est élevée, le système devrait revenir à un mode plus sûr et plus simple.

- Validation continue : les prédictions in silico devraient être appariées à une validation de laboratoire physique ; les exécutions de laboratoire physique devraient inclure des portes de contrôle qualité avant que les conclusions ne se propagent en amont vers les modèles/agents dans le monde numérique.

- Sécurité et sensibilisation aux utilisations duales : protéger les infrastructures de laboratoire contre la falsification.

Autonomiser les Humains Partout : L’IA Co-Scientifique Peut-Elle Niveler le Jeu ?

L’une des promesses les plus convaincantes d’un « co-scientifique » d’IA-XR n’est pas seulement la vitesse pour les institutions de premier plan, mais l’accessibilité pour tous. Considérez ce qui limite actuellement les petits laboratoires, les startups et les cliniques rurales/éloignées/régionales :

- Accès limité à l’expertise spécialisée pour les protocoles et les instruments de haute qualité.

- Coût plus élevé de la formation, des erreurs et de la révision.

- Outils fragmentés : carnets, tableurs, journaux d’instruments et scripts d’analyse se connectent rarement de manière propre.

Un système qui peut guider l’exécution dans le contexte (via des lunettes XR), capturer ce qui s’est passé automatiquement et suggérer la prochaine meilleure étape en fonction des exécutions précédentes pourrait rendre les essais avancés plus reproductibles sur les sites. En principe, il pourrait également soutenir la recherche clinique distribuée où les protocoles doivent être exécutés de manière cohérente, même lorsque les ressources varient.

Calendrier : Quand Chaque Scientifique et Clinicien Obtient un Co-Scientifique ?

En bref, nous sommes plus proches que beaucoup le pensent pour certaines tâches à haute valeur et à haute fréquence (telles que la production fiable d’un médicament dans le laboratoire) et plus loin que ce que la plupart des démonstrations impliquent pour d’autres (telles que l’IA résolvant complètement de grands problèmes comme le cancer ou la maladie d’Alzheimer). Un calendrier réaliste ressemble à ceci :

- À court terme (dans 1 an) : les copilotes de flux de travail qui réduisent la charge administrative : ébauche de protocole, synthèse de littérature, modèles d’analyse et rapports de contrôle qualité automatisés. Le facteur limitant est l’intégration, et non la capacité du modèle.

- À moyen terme (1-2 ans) : les systèmes de co-exécution dans le laboratoire : guidage par lunettes XR, documentation automatisée et robotique sélective pour les étapes à forte variance. La confiance dépendra des traces d’audit et d’une conception serrée de l’homme dans la boucle.

- À long terme (3+ ans) : les co-chercheurs interdomaines qui relient la découverte à la traduction : en reliant les données de laboratoire aux résultats cliniques, en surveillant les signaux de sécurité et en aidant à concevoir des essais – tout en respectant les attentes réglementaires et éthiques.

De Code à Guérison : Le Chemin Vers 1000x de Découverte Scientifique

LabOS est une tentative pour répondre à une question simple : et si une expérience pouvait être exécutée comme une conversation, où l’intention, l’exécution et les preuves sont connectées de bout en bout ? Si nous construisons ces systèmes bien, ils peuvent aider à résoudre le fossé de la traduction qui ralentit la biomedicine et de nombreuses disciplines scientifiques physiques (par exemple, la science des matériaux). Si nous les construisons mal, ils amplifieront l’irreproductibilité et créeront de nouveaux risques de sécurité.

Le travail le plus important au cours des prochaines années sera fondamental : interfaces de données et de périphériques standardisés via la construction du système d’exploitation (comme iOS exécute tous les types d’applications), la construction de benchmarks d’IA qui incluent l’exécution et l’incertitude (comme le benchmark LabSuperVision dans LabOS), et le démarrage du déploiement dans le monde réel qui encouragent l’innovation tout en protégeant les patients et l’intégrité de la recherche.

Pour les chercheurs et les cliniciens, la question n’est pas de savoir si l’IA entrera dans le laboratoire. Elle l’a déjà fait. La question est de savoir si nous l’intégrerons comme une collection d’outils déconnectés ou comme un système fiable et auditable conçu pour les réalités de la science biomédicale.

Lecture et sources suggérées

- Enquête sur la reproductibilité (Nature, 2016) : https://www.nature.com/articles/533452a

- Article de revue de CRISPR-GPT (Nature Biomedical Engineering) : https://www.nature.com/articles/s41551-025-01463-z

- Actualités de Stanford Medicine sur CRISPR-GPT (2025) : https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- Préimpression de LabOS (arXiv) : https://arxiv.org/abs/2510.14861

- Site Web du benchmark LabOS et LabSuperVision : https://ai4lab.stanford.edu

- Cadre de gestion des risques d’IA de NIST (AI RMF 1.0) : https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- Vue d’ensemble de la FDA sur l’IA/ML en tant que dispositif médical : https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- Principes de données FAIR (Scientific Data, 2016) : https://doi.org/10.1038/sdata.2016.18

- Unite.AI sur les goulets d’étranglement dans la découverte de médicaments à petite molécule : https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI sur l’IA et la chirurgie robotique : https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/