Interface cerveau-machine

Une avancée majeure en intelligence artificielle améliore les interfaces cerveau-ordinateur en décodant les signaux cérébraux complexes.

Chercheurs à Université de Chiba Au Japon, des chercheurs ont développé un nouveau cadre d'intelligence artificielle capable de décoder l'activité cérébrale complexe avec une précision nettement améliorée, ce qui représente une étape importante vers une plus grande fiabilité. Interfaces cerveau-ordinateur (ICO)Cette avancée pourrait contribuer à accélérer le développement de technologies d'assistance permettant aux personnes atteintes de troubles neurologiques de contrôler des dispositifs tels que des prothèses, des fauteuils roulants et des robots de réadaptation par la pensée.

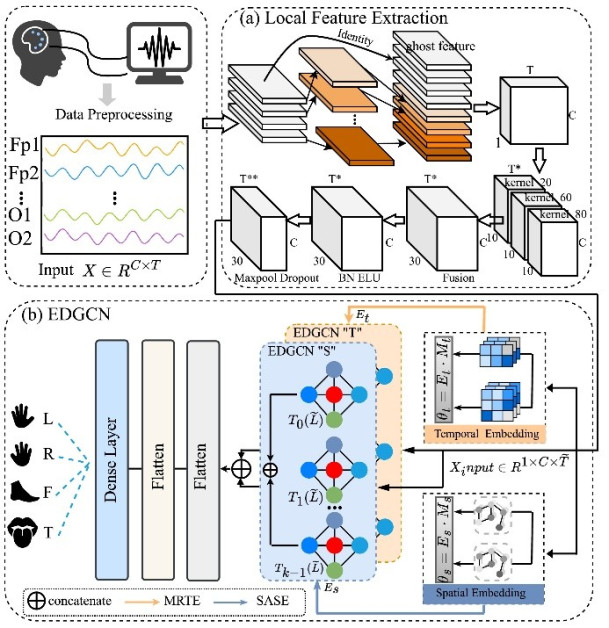

L' Une étude, dirigée par le doctorant Chaowen Shen et le professeur Akio Namiki de l'École supérieure d'ingénierie de l'Université de Chiba, introduit une nouvelle architecture d'apprentissage profond connue sous le nom de Réseau de convolution de graphes piloté par l'intégration (EDGCN)Le système est conçu pour interpréter les signaux électriques complexes générés dans le cerveau lorsqu'une personne imagine bouger ses membres, un processus connu sous le nom d'imagerie motrice.

Interfaces cerveau-ordinateur et imagerie motrice

Les interfaces cerveau-ordinateur visent à créer un canal de communication efficace entre le cerveau humain et des machines externes. Au lieu de s'appuyer sur les mouvements musculaires, les interfaces cerveau-ordinateur interprètent les signaux neuronaux et les convertissent en commandes pour des systèmes numériques ou des dispositifs physiques.

L'une des approches les plus étudiées dans la recherche sur les interfaces cerveau-ordinateur (BCI) consiste à électroencéphalographie par imagerie motrice (MI-EEG). Dans ces systèmes, les utilisateurs imaginent effectuer des mouvements, comme lever la main, saisir un objet ou marcher. Même si aucun mouvement physique ne se produit, le cerveau génère des schémas d'activité électrique caractéristiques associés au mouvement imaginé.

Ces signaux peuvent être capturés à l'aide de électroencéphalographie (EEG)L'électroencéphalographie (EEG) est une technique non invasive qui enregistre l'activité cérébrale grâce à des électrodes placées sur le cuir chevelu. Elle fournit des données multicanaux en séries temporelles représentant l'activité neuronale dans différentes régions du cerveau.

Le décodage précis de ces signaux permet aux ordinateurs de traduire l'activité neuronale en commandes exécutables. Concrètement, cela pourrait permettre aux personnes paralysées ou souffrant d'un handicap moteur sévère de contrôler des technologies d'assistance simplement en imaginant des mouvements.

Cependant, parvenir à un décodage fiable des signaux MI-EEG reste l'un des défis les plus difficiles en neurotechnologie.

Pourquoi les signaux cérébraux sont-ils difficiles à décoder ?

Le principal obstacle au développement des interfaces cerveau-ordinateur réside dans la complexité inhérente des signaux EEG.

Les signaux d'imagerie motrice présentent une forte variabilité spatio-temporelle, c'est-à-dire qu'ils varient à la fois selon les différentes régions cérébrales et au fil du temps. Ils diffèrent également considérablement d'un individu à l'autre, et même chez un même individu d'une session à l'autre.

Les modèles d'apprentissage automatique traditionnels peinent souvent à gérer ces variations. De nombreux systèmes existants reposent sur des structures graphiques prédéfinies ou des paramètres fixes qui supposent que les signaux cérébraux se comportent selon des schémas cohérents. En réalité, les signaux neuronaux sont bien plus dynamiques et hétérogènes.

Les méthodes antérieures utilisaient souvent des techniques telles que l'analyse spatiale classique ou les réseaux de neurones convolutifs conventionnels pour extraire des caractéristiques des signaux EEG. Bien que ces approches puissent identifier certains schémas d'activité neuronale, elles échouent fréquemment à saisir les interactions plus profondes entre les régions cérébrales ou l'évolution temporelle de ces schémas.

De ce fait, de nombreux systèmes d'interface cerveau-ordinateur nécessitent un étalonnage et une formation approfondis avant de pouvoir fonctionner efficacement pour chaque utilisateur.

Une nouvelle approche : les réseaux de convolution de graphes pilotés par l’intégration

L'équipe de recherche de l'université de Chiba a relevé ces défis en développant un nouveau cadre d'apprentissage profond conçu pour mieux saisir la complexité de l'activité cérébrale.

Leur solution, le réseau convolutionnel de graphes piloté par l'intégration (EDGCN), combine plusieurs techniques avancées pour modéliser simultanément la structure spatiale et temporelle des signaux EEG.

Au cœur de ce système se trouve un mécanisme de fusion piloté par l'intégration qui permet de générer dynamiquement les paramètres utilisés pour le décodage des signaux cérébraux. Au lieu de s'appuyer sur des architectures fixes, EDGCN adapte sa représentation interne afin de mieux saisir les variations entre les sujets et au fil du temps.

L'architecture intègre plusieurs composants spécialisés :

Intégration temporelle multi-résolution (MRTE)

Ce module analyse les signaux EEG à différentes échelles temporelles. Les signaux neuronaux évoluant rapidement, des informations importantes peuvent apparaître à différentes résolutions temporelles. MRTE extrait des caractéristiques de ces signaux. modèles spectraux de puissance multi-résolution, permettant ainsi au système d'identifier une activité neuronale significative qui pourrait autrement passer inaperçue.

Intégration spatiale prenant en compte la structure (SASE)

Les signaux cérébraux ne sont pas isolés ; différentes régions du cerveau interagissent en permanence. Le mécanisme SASE modélise ces interactions en intégrant les structures de connectivité locales et globales entre les électrodes EEG. Cela permet à l’IA de représenter le cerveau comme un réseau plutôt que comme un ensemble de canaux de signaux indépendants.

Génération de paramètres tenant compte de l'hétérogénéité

L'un des aspects les plus novateurs du cadre EDGCN réside dans sa capacité à générer dynamiquement des paramètres de convolution de graphes à partir d'une banque de paramètres basée sur l'intégration. Ceci permet au modèle de s'adapter aux caractéristiques uniques des signaux cérébraux de chaque sujet.

Pour appuyer ce processus, les chercheurs ont utilisé convolution de graphes de Chebyshev, une technique qui modélise efficacement les relations au sein de réseaux complexes.

Noyaux à contrainte d'orthogonalité

Pour améliorer encore la robustesse, le modèle introduit des contraintes d'orthogonalité dans ses noyaux de convolution. Ceci favorise la diversité des caractéristiques apprises et réduit la redondance, permettant ainsi au système d'extraire des représentations plus riches des signaux EEG.

Ensemble, ces composants permettent à l'EDGCN de capturer à la fois les schémas d'activité neuronale locale et les interactions à grande échelle entre les régions cérébrales, ce qui permet un décodage plus précis des signaux d'imagerie motrice.

Résultats de performance

Les chercheurs ont testé EDGCN en utilisant des ensembles de données de référence largement utilisés provenant de Compétition BCI IV, qui constituent des ensembles de données d'évaluation standard dans le domaine de la recherche sur les interfaces cerveau-ordinateur.

Le modèle obtenu :

- Précision de classification de 90.14 % sur l'ensemble de données BCIC-IV-2b

- Précision de classification de 86.50 % sur l'ensemble de données BCIC-IV-2a

Ces résultats surpassent plusieurs méthodes de décodage de pointe existantes et démontrent une forte généralisation à différents sujets.

Surtout, le système a également démontré une meilleure adaptabilité lors de son application à des scénarios inter-sujets, une condition essentielle au déploiement pratique des interfaces cerveau-ordinateur. De nombreux modèles existants fonctionnent bien pour un utilisateur entraîné, mais échouent lorsqu'ils sont appliqués à de nouveaux individus. L'architecture d'EDGCN, basée sur l'intégration de données, permet de surmonter cette limitation en modélisant mieux la variabilité individuelle.

Implications pour la réadaptation et les technologies d'assistance

La capacité à décoder plus précisément les signaux cérébraux pourrait avoir des implications profondes pour les technologies d'assistance.

Les interfaces cerveau-ordinateur basées sur l'imagerie motrice sont déjà explorées pour des applications telles que :

- Fauteuils roulants contrôlés par la pensée

- Prothèses neurales

- Dispositifs de réadaptation robotisés

- Systèmes de communication pour les patients paralysés

Une meilleure précision de décodage pourrait rendre ces technologies nettement plus fiables et plus faciles à utiliser.

Les chercheurs pensent que des systèmes comme EDGCN pourraient aider les patients atteints de pathologies telles que :

- coup

- Lésions de la moelle épinière

- Sclérose latérale amyotrophique (SLA)

- Autres troubles neuromusculosquelettiques

Grâce à une interprétation plus fiable des signaux, les patients pourraient potentiellement contrôler les dispositifs de neuroréadaptation par de simples mouvements imaginés, permettant une interaction plus naturelle avec les systèmes d'assistance.

Selon le professeur Namiki, le décodage des signaux d'imagerie motrice représente non seulement un défi technologique, mais aussi une opportunité de mieux comprendre comment le cerveau organise le mouvement et la connectivité neuronale.

Vers des interfaces cerveau-ordinateur grand public

Malgré des décennies de recherche, la plupart des systèmes d'interface cerveau-ordinateur restent confinés aux laboratoires ou à des contextes cliniques spécialisés. La fiabilité, l'adaptabilité et la facilité d'utilisation demeurent des obstacles importants à une adoption plus large.

Des avancées comme EDGCN pourraient contribuer à rapprocher les interfaces cerveau-machine de la neurotechnologie grand public.

En améliorant la capacité du système à traiter des signaux cérébraux hétérogènes, le modèle réduit le besoin d'un étalonnage poussé et d'un réglage expert. Il s'agit d'une étape cruciale pour rendre les interfaces cerveau-machine utilisables en dehors des environnements de recherche.

Les recherches futures porteront probablement sur l'intégration de ces modèles d'IA dans les systèmes EEG portables et les dispositifs portables. Conjugués aux progrès réalisés dans les technologies de capteurs et la puissance de calcul, ces systèmes pourraient permettre des interfaces cerveau-machine plus accessibles et évolutives.

Un pas vers une intégration homme-machine plus poussée

Le développement d'EDGCN reflète une tendance plus large en intelligence artificielle et en neurosciences : l'utilisation croissante de réseaux neuronaux basés sur des graphes pour modéliser les systèmes biologiques.

Le cerveau fonctionnant comme un réseau complexe de régions interconnectées, les réseaux neuronaux graphiques offrent une représentation naturelle de sa structure et de sa dynamique. À mesure que ces modèles d'IA se perfectionnent, ils pourraient permettre de mieux comprendre l'activité neuronale et la cognition.

À terme, un meilleur décodage des signaux cérébraux pourrait ouvrir la voie à une nouvelle génération de technologies permettant aux humains d'interagir avec les machines de manière plus fluide que jamais auparavant.

Si les progrès se poursuivent au rythme actuel, les interfaces cerveau-ordinateur pourraient bientôt passer du statut d'outils de recherche expérimentaux à celui de technologies d'assistance du quotidien capables de redonner autonomie et mobilité à des millions de personnes dans le monde.