Angle d’Anderson

Une méthode ‘Zen’ pour empêcher les modèles de langage de halluciner

Demander à ChatGPT de vérifier une réponse aléatoire avant de résoudre un problème réel le fait réfléchir plus dur, et obtient la bonne réponse plus souvent – même si la réponse ‘aléatoire’ précédente n’a rien à voir avec votre véritable requête.

Un intéressant nouvel article de recherche en Chine a développé une méthode très peu coûteuse pour empêcher les modèles de langage tels que ChatGPT de halluciner, et pour améliorer la qualité des réponses : faire vérifier par le modèle la réponse à une question totalement sans rapport :

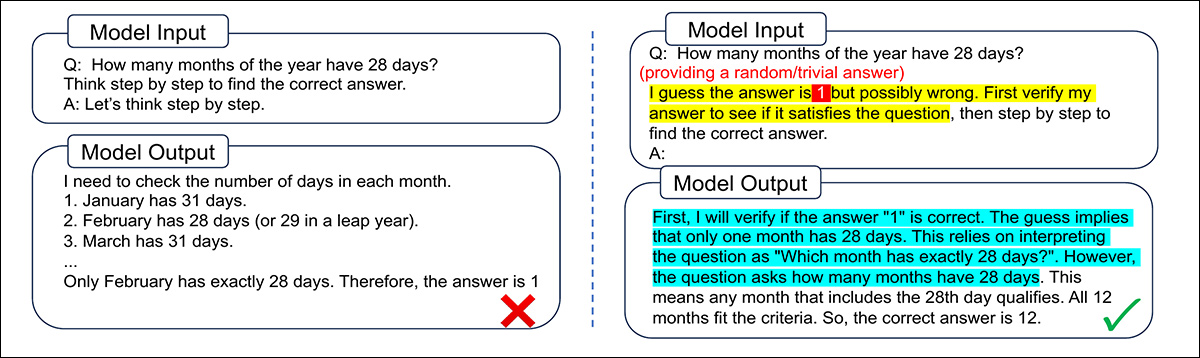

Un exemple de question sans rapport qui peut ‘libérer l’esprit’ d’un LLM, et l’aider à se concentrer sur une (vraie) requête ultérieure. Source

Cette gifle Zen est une façon incroyablement peu coûteuse d’améliorer les performances, par rapport à d’autres méthodes plus impliquées, telles que fine-tuning, prompt-crafting et parallel sampling, et elle fonctionne sur des modèles open et closed-source, indiquant la découverte d’un trait de caractère fondamental commun à plusieurs architectures LLM (plutôt qu’une particularité fragile propre à des matériaux ou des méthodes de formation spécifiques).

Les auteurs détaillent les économies d’échelle possibles en améliorant la sortie de cette manière spartiate* :

‘Pour mettre en œuvre avec un minimum de connaissances préalables, VF n’a besoin que d’une réponse aléatoire ou triviale dans l’invite. Le processus de vérification s’avère avoir beaucoup moins de jetons de sortie qu’un chemin CoT ordinaire, [parfois] même sans processus de vérification explicite, ce qui [requiert] très [peu] de calcul supplémentaire au moment du test.’

Dans les tests, cette approche – baptisée Verification-First (VF) – a été capable d’améliorer les réponses dans une diversité de tâches, y compris la raisonnement mathématique, sur des plateformes open source et commerciales.

Une partie de la raison pour laquelle cette technique fonctionne peut être ancrée dans la façon dont les modèles de langage absorbent et approprient les tendances de la psychologie humaine, de sorte qu’une question directe peut rendre le modèle ‘défensif’ et ‘nerveux’, alors qu’une demande de vérification du travail d’un autre ne sollicite pas ces ‘instincts de survie’.

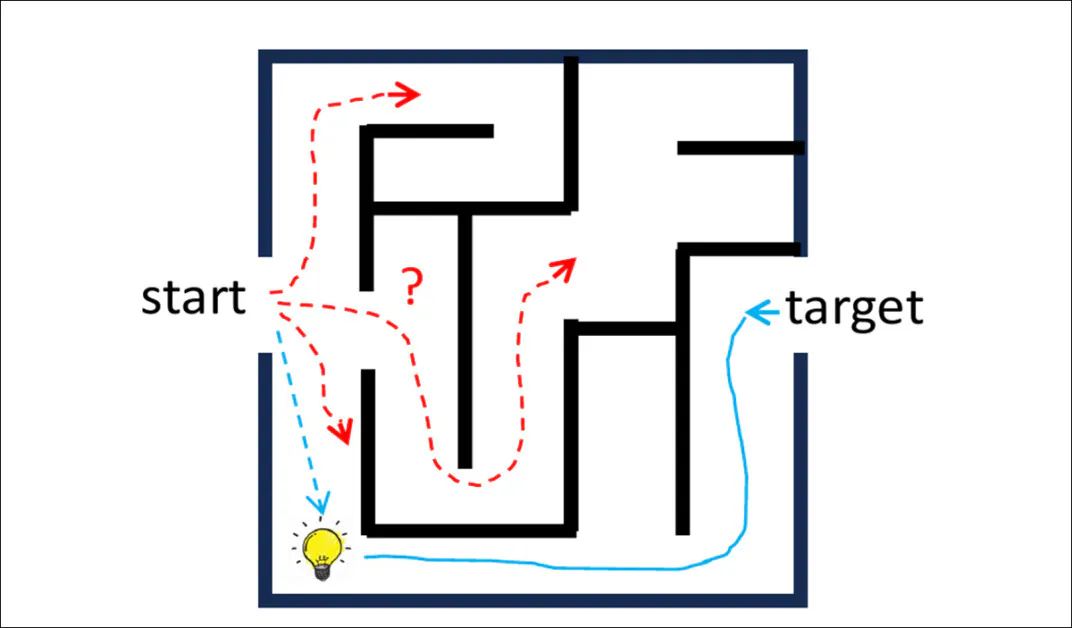

L’idée centrale est que vérifier une réponse exige moins d’efforts que de générer une réponse à partir de zéro, et peut déclencher un chemin de raisonnement différent qui complète la chaîne de pensée standard chain-of-thought.

Demander au modèle de critiquer une réponse donnée (c’est-à-dire une réponse que le modèle n’a pas été impliqué dans la création) peut également activer une sorte de pensée critique qui aide à éviter une confiance excessive dans les premières impressions du modèle.

Le travail caractérise le processus en termes de chemin de raisonnement inverse :

En partant d’une réponse proposée et en raisonnant à rebours vers la question, on peut exposer des raccourcis ou des idées qui sont plus difficiles à trouver lorsque l’on raisonne à l’avance à partir du problème seul. Ce ‘chemin inverse’ peut suivre une trajectoire plus simple et offrir des informations complémentaires à la chaîne de pensée standard.

Les chercheurs ont également concrétisé le concept central en Iter-VF, une méthode d’échelle de temps séquentielle qui affine les réponses de manière itérative, en évitant le problème d’accumulation d’erreurs commun aux stratégies d’auto-correction souvent trouvées dans les architectures LLM.

Le nouveau travail est intitulé Demander aux LLM de vérifier d’abord est presque un repas gratuit, et vient de deux chercheurs du Département de génie électrique de l’Université Tsinghua à Pékin.

Méthode

L’idée centrale derrière le nouveau travail est d’inverser le flux de raisonnement habituel dans les modèles de langage. Au lieu de demander au modèle de résoudre un problème à partir de zéro, on lui présente d’abord une réponse candidate (souvent incorrecte ou arbitraire) et on lui demande de vérifier si cette réponse a du sens.

Cela amène le modèle à raisonner à rebours, en partant de la réponse proposée et en remontant vers la question. Une fois la vérification terminée, le modèle procède ensuite à résoudre le problème original comme d’habitude.

Cette inversion, affirme l’article, réduit les erreurs imprudentes et encourage un mode de raisonnement plus réfléchi, aidant le LLM à découvrir des structures cachées et à éviter des hypothèses trompeuses.

Comme le montrent les exemples ci-dessous, même demander au modèle de vérifier une supposition évidemment fausse comme ’10’ peut l’aider à se remettre de la logique défectueuse et à surpasser la chaîne de pensée standard :

Demander au modèle de vérifier une réponse supposée d’abord l’aide à repérer les incohérences et à s’engager plus soigneusement dans le problème. Dans cet exemple, l’approche standard conduit à une solution fluide mais incorrecte, tandis que la mise en page de vérification déclenche une structure logique plus claire et le résultat correct.

En ce qui concerne de nombreux problèmes du monde réel, il n’est pas facile de fournir une supposition pour que le modèle la vérifie, surtout lorsque la tâche est ouverte, telle que l’écriture de code ou l’appel d’une API. Par conséquent, pour s’adapter mieux, la méthode donne d’abord sa meilleure réponse comme d’habitude, puis alimente cette réponse dans le format de vérification :

Lorsque le modèle est invité à vérifier sa propre sortie précédente, il repère la faille dans sa logique et réécrit la solution correctement. La mise en page de vérification l’aide à se concentrer sur l’erreur spécifique plutôt que de répéter la même erreur.

Cette approche constitue la méthode Iter-VF mentionnée précédemment. Le modèle répète ce cycle, affinant sa réponse à chaque fois, sans nécessité de réentraînement ou d’outillage sur mesure. Contrairement à d’autres stratégies d’auto-correction, qui peuvent accumuler la réflexion antérieure et risquer de confondre le modèle, Iter-VF ne regarde que la réponse la plus récente à chaque fois, ce qui aide à maintenir sa réflexion claire.

Données et tests

Les auteurs évaluent la méthode dans quatre domaines : tâches de raisonnement général, où VF est alimenté avec une supposition triviale ; tâches sensibles au temps, où Iter-VF est comparé à des méthodes d’échelle rivales ; problèmes ouverts tels que la programmation et les appels d’API, où VF utilise la réponse antérieure du modèle ; et LLM commerciaux à source fermée, où les étapes de raisonnement internes sont inaccessibles.

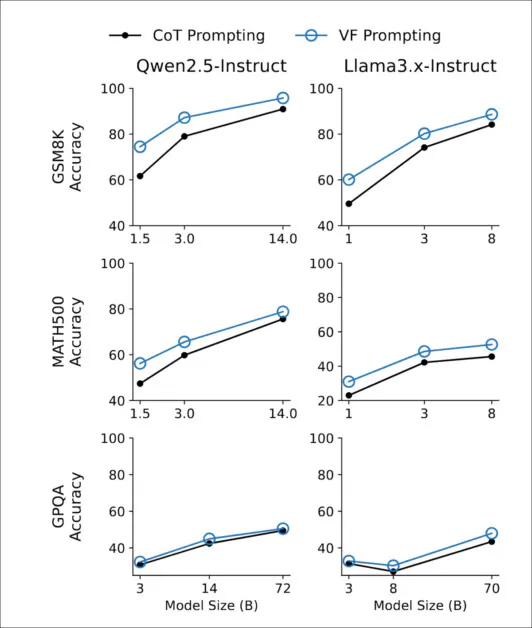

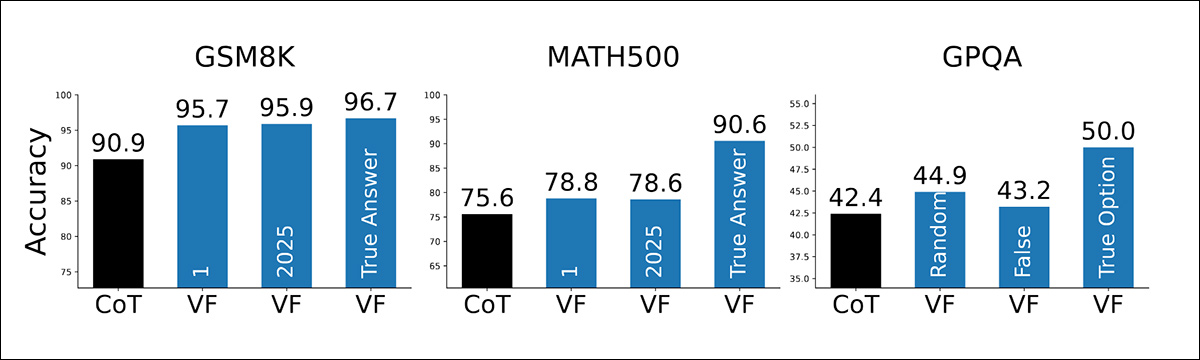

Pour tester la méthode, les chercheurs ont utilisé trois références de raisonnement : GSM8K et MATH500 pour les problèmes mathématiques ; et GPQA-Diamond pour les questions scientifiques de niveau universitaire.

Dans chaque cas, le modèle a reçu soit une supposition triviale, telle que ‘1’ pour les réponses numériques ; ou une option de choix multiple aléatoire, comme point de départ pour la vérification. Aucune mise à l’échelle ou connaissance préalable n’a été ajoutée, et la référence pour la comparaison était la mise en page standard de chaîne de pensée à zéro tir.

Les tests ont été effectués sur une gamme complète de Qwen2.5 et Llama3 modèles à instruction, allant de 1B à 72B (paramètres) en taille. Les modèles Qwen utilisés étaient Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct, Qwen2.5-14B-Instruct, et Qwen2.5-72B-Instruct. Les variantes Llama3 étaient Llama3.2-1B-Instruct, Llama3.2-3B-Instruct, Llama3.1-8B-Instruct, et Llama3.3-70B-Instruct.

Comme le montre ci-dessous, l’amélioration de la mise en page de vérification première a été constante à travers les échelles de modèle, avec des gains clairs visibles même à 1B de paramètres et se poursuivant jusqu’à 72B :

À travers toutes les tailles de modèles dans les familles Qwen2.5 et Llama3, la mise en page de vérification première a constamment surpassé la mise en page standard de chaîne de pensée sur GSM8K, MATH500 et GPQA-Diamond.

L’effet s’est avéré le plus fort sur les références de mathématiques à forte intensité de calcul telles que GSM8K et MATH500, où la vérification d’une mauvaise réponse a conduit à une meilleure réflexion que d’essayer de résoudre à partir de zéro. Sur GPQA-Diamond, qui dépend plus de la connaissance stockée que de la structure déductive, l’avantage a été plus faible mais constant.

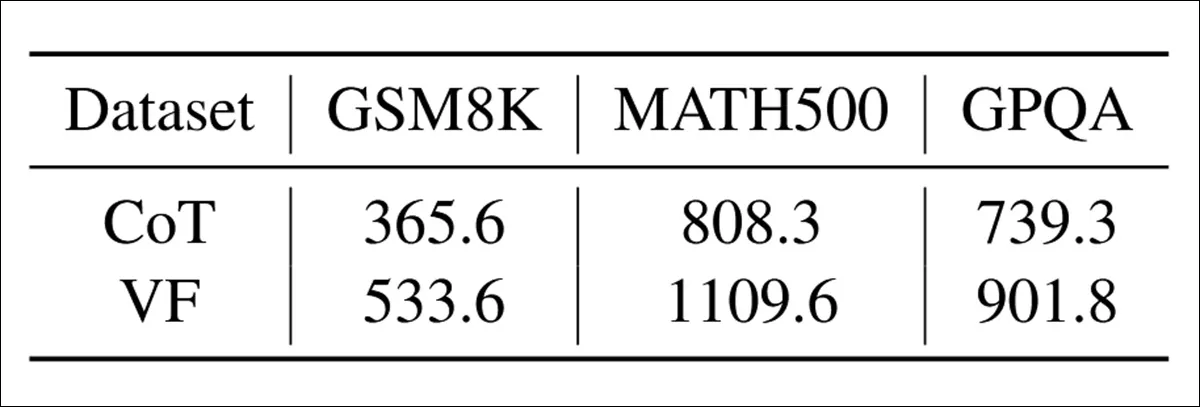

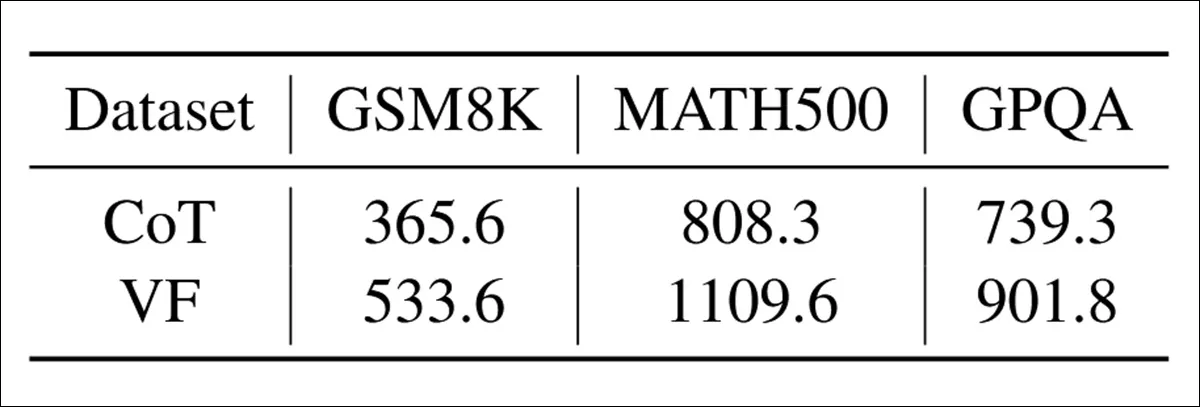

Le coût computationnel de la vérification première a été modeste : dans le tableau ci-dessous, on peut voir que générer une étape de vérification a ajouté environ 20-50 % de jetons de sortie supplémentaires par rapport à la mise en page standard de chaîne de pensée :

Le nombre moyen de jetons de sortie générés sous chaque méthode de mise en page, à travers les références GSM8K, MATH500 et GPQA.

Malgré cela, le coût supplémentaire est resté loin de celui des stratégies nécessitant plusieurs complétions échantillonnées ou une planification récursive.

Dans le graphique ci-dessous, on peut voir à quel point la méthode est sensible à la qualité de la réponse supposée. Étonnamment, même lorsque la supposition est triviale (‘1’), invraisemblable (‘2025’) ou une option de choix multiple aléatoire, la vérification première surpassée la mise en page standard :

Gains d’exactitude de la mise en page de vérification première, lorsque le modèle reçoit des réponses triviales, invraisemblables ou correctes à vérifier à travers GSM8K, MATH500 et GPQA.

Comme prévu, l’exactitude augmente encore plus lorsque la supposition se trouve être la bonne réponse ; mais la méthode a fonctionné bien quoi qu’il en soit, suggérant que les gains n’étaient pas dus à l’information dans la réponse supposée elle-même, mais simplement à l’acte de vérification.

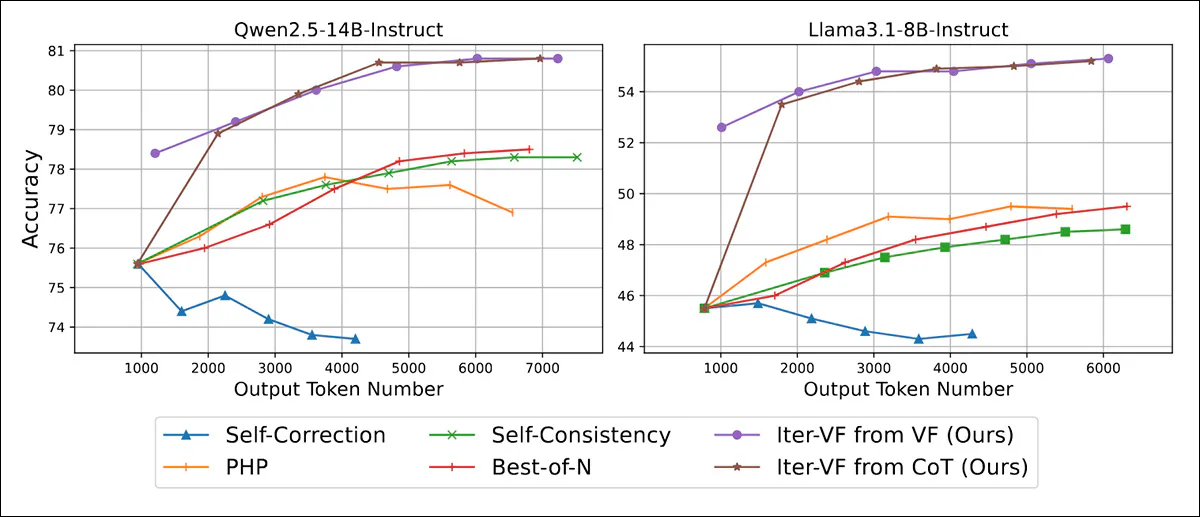

Iter-VF a également été comparé à quatre stratégies d’échelle de temps de test qui opèrent sans réentraînement ou adaptation spécifique à la tâche. Dans Self-Correction, le modèle a été invité à réviser ses réponses en réfléchissant à ses étapes de raisonnement antérieures ; dans PHP, les réponses antérieures ont été ajoutées à l’entrée en tant qu’indices contextuels, bien qu’aucune instruction n’ait été donnée sur la façon de les utiliser.

De plus, dans Self-Consistency, plusieurs chemins de raisonnement ont été échantillonnés et la réponse finale a été choisie par vote à la majorité ; et enfin, dans Best-of-N, plusieurs sorties ont été générées de manière indépendante et classées à l’aide d’une invite de vérification, avec la réponse la mieux notée sélectionnée.

Deux variantes d’Iter-VF ont été mises en œuvre : l’une initialisée avec une supposition triviale (‘1’) et l’autre avec une sortie CoT standard :

Exactitude et efficacité des jetons sur MATH500 sous des budgets de sortie croissants, montrant que les deux variantes d’Iter-VF surpassent toutes les références à travers les échelles de modèle.

Iter-VF a donné de meilleurs résultats que toutes les autres méthodes lorsque le calcul disponible était faible, ce que les auteurs ont attribué à la façon dont il vérifie les réponses, et non à la qualité des réponses initiales (puisqu’à la fois les variantes VF et CoT ont rapidement atteint une exactitude similaire).

PHP s’est comporté plus mal, même s’il a réutilisé les réponses antérieures comme indices, probablement parce que les LLM n’ont pas exploité ces indices de manière efficace.

Contrairement à PHP et à l’auto-correction, qui accumulent le contexte à travers les itérations, Iter-VF ne considère que la réponse la plus récente à chaque étape. Cette approche Markovienne évite la confusion cumulative des chaînes de raisonnement prolongées – une faiblesse particulièrement préjudiciable à l’auto-correction.

Les méthodes parallèles telles que l’auto-cohérence et le meilleur des N ont évité ce problème, bien que leurs améliorations soient plus lentes et plus modestes.

(n.b. La section des résultats, bien que complète, est une lecture peu amicale et prolixe, et nous devons à ce stade tronquer la plupart de la couverture restante, en renvoyant le lecteur au document de recherche source pour plus de détails).

Lorsqu’il a été testé sur GPT-5 Nano et GPT-5 Mini, des modèles commerciaux fermés qui cachent la trace de raisonnement complète et ne retournent que la réponse finale, Iter-VF a amélioré les performances sans s’appuyer sur les sorties intermédiaires. Dans le tableau ci-dessous, on peut voir des gains à la fois sur MATH500 et GPQA, confirmant que l’approche de vérification puis de génération reste viable même lorsque seule l’entrée et la réponse finale sont accessibles :

Exactitude sur MATH500 et GPQA lorsque Iter-VF est appliqué aux modèles GPT-5 avec des traces de raisonnement cachées.

Conclusion

Bien que le nouveau document bascule dans l’opacité à partir de la section des résultats, la découverte apparente d’un trait de caractère général dans une classe de modèles d’IA est néanmoins un développement fascinant. Quiconque utilise régulièrement un LLM aura instinctivement développé un ensemble de trucs pour contourner les limites des modèles, à mesure que chacune devient évidente avec le temps, et que le modèle émerge ; et tout le monde espère trouver un ‘truc’ aussi applicable et généralisé que celui-ci.

L’un des plus grands problèmes pour mettre en œuvre et mettre à jour une fenêtre de contexte dans un LLM semble être de trouver un équilibre entre la conservation du progrès de session et la capacité de se lancer dans de nouvelles directions lorsque nécessaire, sans tomber dans des hallucinations spurieuses ou des sorties hors sujet. Dans le cas présenté par le nouveau document, nous voyons un exemple d’un ‘réveil’ doux mais insistant qui semble recentrer et réinitialiser le LLM sans perte de contexte. Il sera intéressant de voir si les projets suivants adaptent et évoluent la méthode.

Les chercheurs mettent l’accent sur l’économie de leur nouvelle méthode – une considération qui aurait eu beaucoup moins de poids il y a même 12 mois. Ces jours-ci, les implications de l’IA à grande échelle rendent clair que les économies de ressources autrefois considérées comme mineures, à l’époque de la recherche pure, sont maintenant devenues cardinales et essentielles.

* Veuillez noter que je suis limité pour inclure le nombre habituel de citations du document, puisque le niveau d’anglais trouvé dans certaines parties de celui-ci pourrait confondre le lecteur. Ainsi, j’ai pris la liberté de résumer les idées clés à la place, et je renvoie le lecteur au document de recherche source pour vérification.

Publié pour la première fois jeudi 4 décembre 2025