Robotics

Kuidas robotid õpivad abi küsima

Robootika arenevas maailmas torkab silma murranguline koostöö Princetoni ülikooli ja Google'i vahel. Nende mainekate institutsioonide insenerid on välja töötanud uuendusliku meetodi, mis õpetab robotitele üliolulise oskuse: ära tunda, millal nad abi vajavad ja kuidas seda küsida. See areng tähistab olulist sammu edasi robootikas, ületades lõhe autonoomse toimimise ning inimese ja roboti suhtluse vahel.

Teekonda intelligentsemate ja iseseisvamate robotite poole on alati takistanud üks oluline väljakutse: inimkeele keerukus ja mitmetähenduslikkus. Erinevalt arvutikoodide binaarsest selgusest on inimkeel täis nüansse ja peensusi, muutes selle robotitele labürindiks. Näiteks võib nii lihtne käsk nagu "kauss üles võtta" muutuda keeruliseks ülesandeks, kui kohal on mitu kaussi. Robotid, kes on varustatud oma keskkonda tajuma ja keelele reageerima, satuvad sageli ristteele, kui seisavad silmitsi sellise keelelise ebakindlusega.

Määramatuse kvantifitseerimine

Selle väljakutsega tegelemiseks on Princetoni ja Google'i meeskond kasutusele võtnud uudse lähenemisviisi, mis kvantifitseerib inimkeele "hägusust". See meetod mõõdab sisuliselt keelekäskude määramatuse taset ja kasutab seda mõõdikut roboti tegevuste suunamiseks. Olukordades, kus käsk võib viia mitme tõlgenduseni, saab robot nüüd mõõta ebakindluse taset ja otsustada, millal otsida täiendavaid selgitusi. Näiteks keskkonnas, kus on mitu kaussi, sunnib robot suuremat määramatust küsima, millist kaussi üles võtta, vältides sellega võimalikke vigu või ebatõhusust.

Selline lähenemine mitte ainult ei anna robotitele paremat keelemõistmist, vaid suurendab ka nende ohutust ja tõhusust ülesannete täitmisel. Integreerides suuri keelemudeleid (LLM-id), nagu ChatGPT taga, on teadlased astunud märkimisväärse sammu robotite tegevuste vastavusse viimisel inimeste ootuste ja vajadustega.

Suurte keelemudelite roll

LLM-ide integreerimine mängib selles uues lähenemisviisis keskset rolli. LLM-id on olulised inimkeele töötlemisel ja tõlgendamisel. Selles kontekstis kasutatakse neid robotitele antud keelekäskude ebakindluse hindamiseks ja mõõtmiseks.

LLM-idele tuginemine ei ole siiski probleemideta. Nagu uurimisrühm märkis, võivad LLM-ide väljundid mõnikord olla ebausaldusväärsed.

Anirudha Majumdar, Princetoni dotsent, rõhutab selle tasakaalu olulisust:

"LLM-i loodud plaanide pimesi järgimine võib põhjustada robotite ebaturvalist või ebausaldusväärset käitumist ja seetõttu on meil vaja, et meie LLM-põhised robotid teaksid, kui nad ei tea."

See rõhutab vajadust nüansirikka lähenemisviisi järele, mille puhul LLM-e kasutatakse pigem juhendamise kui eksimatute otsustajatena.

Praktiline rakendamine ja testimine

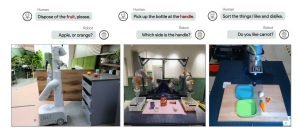

Selle meetodi praktilisust on testitud erinevates stsenaariumides, illustreerides selle mitmekülgsust ja tõhusust. Üks selline test hõlmas robotkätt, mille ülesandeks oli mänguasjade toiduained erinevatesse kategooriatesse sorteerida. See lihtne seadistus demonstreeris roboti võimet ülesannetes selgete valikute abil tõhusalt navigeerida.

Pilt: Princetoni ülikool

Keerukus suurenes märkimisväärselt teises katses, mis hõlmas kontoriköögis ratastel platvormile paigaldatud robotkäsi. Siin seisis robot silmitsi reaalsete väljakutsetega, nagu õige eseme tuvastamine, mida mikrolaineahju panna, kui talle esitati mitu võimalust.

Nende testide kaudu demonstreerisid robotid edukalt oma võimet kasutada kvantifitseeritud ebakindlust otsuste tegemiseks või selgituste otsimiseks, kinnitades sellega selle meetodi praktilist kasulikkust.

Tuleviku tagajärjed ja uuringud

Tulevikku vaadates ulatuvad selle uuringu tagajärjed praegustest rakendustest palju kaugemale. Meeskond, mida juhivad Majumdar ja kraadiõppur Allen Ren, uurib, kuidas seda lähenemisviisi saab rakendada keerukamate robotite tajumise ja tehisintellekti probleemide lahendamisel. See hõlmab stsenaariume, kus robotid peavad otsuste tegemiseks ühendama nägemis- ja keeleteabe, vähendades veelgi lõhet robotite mõistmise ja inimestevahelise suhtluse vahel.

Käimasolevate uuringute eesmärk on mitte ainult parandada robotite võimet täita ülesandeid suurema täpsusega, vaid ka navigeerida maailmas inimese tunnetusega sarnase mõistmisega. See uurimus võib sillutada teed robotitele, mis pole mitte ainult tõhusamad ja ohutumad, vaid ka paremini kooskõlas inimkeskkonna nüansirikaste nõudmistega.

Leiate avaldatud uuringu siin.