Graafikud on andmestruktuurid, mis esindavad keerulisi suhteid paljudes valdkondades, sealhulgas sotsiaalvõrgustikud, teadmistebaasid, bioloogilised süsteemid ja palju muud. Nendel graafikutel on olemid kujutatud sõlmedena ja nende seosed on kujutatud servadena.

Võime neid keerulisi relatsioonistruktuure tõhusalt esindada ja nende üle arutleda on ülioluline, et võimaldada edusamme sellistes valdkondades nagu võrguteadus, keemiaformaatika ja soovitussüsteemid.

Graafilised närvivõrgud (GNN-id) on kujunenud võimsaks süvaõpperaamistikuks graafiku masinõppe ülesannete jaoks. Graafi topoloogia integreerimisega närvivõrgu arhitektuurisse naabruskonna liitmise või graafiku konvolutsioonide kaudu saavad GNN-id õppida madalamõõtmelisi vektoreid, mis kodeerivad nii sõlme funktsioone kui ka nende struktuurseid rolle. See võimaldab GNN-idel saavutada tipptasemel jõudlust selliste ülesannete puhul nagu sõlmede klassifitseerimine, linkide ennustamine ja graafiku klassifikatsioon erinevates rakendusvaldkondades.

Kuigi GNN-id on teinud märkimisväärseid edusamme, on mõned peamised väljakutsed endiselt lahendamata. Kvaliteetsete märgistatud andmete hankimine järelevalvega GNN-mudelite koolitamiseks võib olla kulukas ja aeganõudev. Lisaks võivad GNN-id võidelda heterogeensete graafikustruktuuride ja olukordadega, kus graafiku jaotus testi ajal erineb oluliselt koolitusandmetest (jaotuseväline üldistus).

Paralleelselt suured keelemudelid (LLM) nagu GPT-4 ja Kõned on maailma vallutanud oma uskumatu loomuliku keele mõistmise ja genereerimisvõimega. Miljardite parameetritega tohutu tekstikorpuse alal koolitatud LLM-idel on silmapaistvad vähehaaval õppimisvõimed, ülesannete üldistamine ja tervemõistuslikud arutlusoskused, mida kunagi peeti tehisintellektisüsteemide jaoks äärmiselt keeruliseks.

LLM-ide tohutu edu on ajendanud uuringuid nende võimsuse suurendamiseks graafiku masinõppe ülesannete täitmiseks. Ühest küljest pakuvad LLM-ide teadmised ja mõtlemisoskus võimalusi traditsiooniliste GNN-mudelite täiustamiseks. Vastupidiselt võivad graafikutele omased struktureeritud esitused ja faktiteadmised olla olulised LLM-ide mõningate peamiste piirangute, nagu hallutsinatsioonid ja tõlgendatavuse puudumine, käsitlemisel.

Selles artiklis süveneme viimastesse uuringutesse graafiku masinõppe ja suurte keelemudelite ristumiskohas. Uurime, kuidas LLM-e saab kasutada graafilise ML-i erinevate aspektide täiustamiseks, vaatame läbi lähenemisviisid graafikuteadmiste kaasamiseks LLM-idesse ning arutame selle põneva valdkonna esilekerkivaid rakendusi ja tulevikusuundi.

Graafik Neuraalvõrgud ja enesejärelevalvega õppimine

Vajaliku konteksti loomiseks vaatame esmalt lühidalt üle põhimõisted ja meetodid graafinärvivõrkude ja enesejärelevalvega graafiesitusõppes.

Graafiline närvivõrgu arhitektuur

Graafiline närvivõrgu arhitektuur – allikas

Peamine erinevus traditsiooniliste sügavate närvivõrkude ja GNN-ide vahel seisneb nende võimes töötada otse graafilise struktuuriga andmetel. GNN-id järgivad naabruskonna liitmisskeemi, kus iga sõlm koondab oma esituse arvutamiseks naabrite funktsioonivektorid.

Välja on pakutud arvukalt GNN-i arhitektuure koos sõnumite ja värskendusfunktsioonidega, näiteks Graafik konvolutsioonilised võrgud (GCN-id), GraphSAGE, Graafik Tähelepanuvõrgustikud (GAT) ja Graafiku isomorfismi võrgud (GIN-id) muu hulgas.

Viimasel ajal on graafiktrafod kogunud populaarsust, kohandades loomuliku keele transformaatorite enesetähelepanu mehhanismi, et töötada graafikupõhiselt struktureeritud andmetega. Mõned näited hõlmavad järgmist GraphormerTransformerja Graafikujundajad. Need mudelid suudavad jäädvustada graafiku pikaajalisi sõltuvusi paremini kui puhtalt naabruskonnapõhised GNN-id.

Iseseisev õppimine graafikutel

Kuigi GNN-id on võimsad esindusmudelid, takistab nende toimivust sageli suurte märgistatud andmekogumite puudumine, mida on vaja juhendatud koolituseks. Enesejärelevalvega õppimine on kujunenud paljutõotavaks paradigmaks GNN-ide eelkoolitamiseks märgistamata graafikuandmetele, kasutades ettekäändeks ülesandeid, mis nõuavad ainult graafi sisemist struktuuri ja sõlme funktsioone.

Mõned levinumad ettekäändel ülesanded, mida kasutatakse GNN-i enesejärelevalvega eelkoolituses, on järgmised:

- Sõlme omaduste ennustamine: osa sõlme atribuutide/funktsioonide juhuslik maskeerimine või rikkumine ja GNN-i ülesandeks need rekonstrueerida.

- Serva/lingi ennustus: õppimine ennustama, kas sõlmede paari vahel on serv, sageli juhusliku serva maskeerimise põhjal.

- Kontrastiivne õppimine: sarnasuste maksimeerimine sama graafiku näidise graafikuvaadete vahel, tõmmates vaated erinevatest graafikutest lahku.

- Vastastikune teabe maksimeerimine: vastastikuse teabe maksimeerimine kohalike sõlmede esitusviiside ja sihtesituse vahel, nagu globaalne graafiku manustamine.

Sellised ettekäändeks ülesanded võimaldavad GNN-il eelkoolituse ajal märgistamata graafikuandmetest eraldada tähendusrikkaid struktuurseid ja semantilisi mustreid. Eelkoolitatud GNN-i saab seejärel viimistleda suhteliselt väikestes märgistatud alamhulkades, et see saaks suurepäraselt hakkama mitmesuguste järgnevate ülesannetega, nagu sõlmede klassifitseerimine, linkide ennustamine ja graafiku klassifikatsioon.

Enesejärelevalvet võimendades on suurtel märgistamata andmekogumitel eelkoolitatud GNN-idel parem üldistus, jaotusmuutuste vastupidavus ja tõhusus võrreldes nullist treenimisega. Siiski jäävad mõned traditsiooniliste GNN-põhiste enesejärelevalve meetodite peamised piirangud, mida me järgmiseks uurime, kasutades LLM-e.

Graph ML täiustamine suurte keelemudelitega

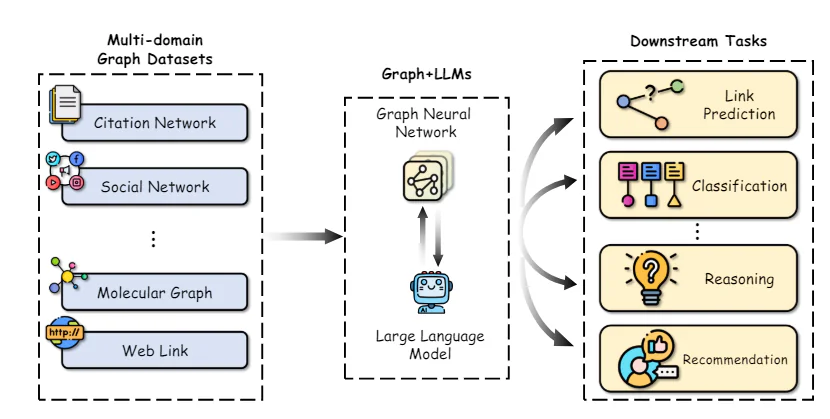

Graafikute ja LLM-i integreerimine – allikas

LLM-ide tähelepanuväärne suutlikkus loomuliku keele mõistmisel, arutluskäigul ja vähesel määral õppimisel annab võimaluse täiustada graafiku masinõppe torujuhtmete mitmeid aspekte. Uurime selles ruumis mõningaid peamisi uurimissuundi:

Peamiseks väljakutseks GNN-ide rakendamisel on sõlmede ja servade jaoks kvaliteetsete funktsiooniesitluste saamine, eriti kui need sisaldavad rikkalikke tekstiatribuute, nagu kirjeldused, pealkirjad või kokkuvõtted. Traditsiooniliselt on kasutatud lihtsaid sõnade kotti või eelkoolitatud sõnade põimimismudeleid, mis sageli ei suuda tabada nüansirikast semantikat.

Hiljutised tööd on näidanud suurte keelemudelite võimet tekstikodeerijatena kasutada paremate sõlmede/servade esitusviiside loomiseks enne nende edastamist GNN-ile. Näiteks, Chen jt. Kasutage tekstilise sõlme atribuutide kodeerimiseks LLM-e, nagu GPT-3, näidates sõlmede klassifitseerimisülesannete puhul olulist jõudluse kasvu võrreldes traditsiooniliste sõnamanustustega.

Lisaks parematele tekstikodeerijatele saab LLM-e kasutada täiendatud teabe genereerimiseks originaalteksti atribuutidest pooljärelevalvega. TAPE loob potentsiaalsed sildid/selgitused sõlmedele, kasutades LLM-i ja kasutab neid täiendavate täiustatud funktsioonidena. KEA eraldab LLM-i abil tekstiatribuutidest terminid ja hangib funktsioonide täiendamiseks nende terminite üksikasjalikud kirjeldused.

Parandades sisendfunktsioonide kvaliteeti ja väljendusvõimet, saavad LLM-id anda GNN-idele oma suurepärase loomuliku keele mõistmise võime, suurendades jõudlust allavoolu ülesannete täitmisel.

Märgistatud andmetele tuginemise leevendamine

LLM-ide peamine eelis on nende võime täita suhteliselt hästi uusi ülesandeid vähese märgistatud andmetega või ilma nendeta, tänu nende eelkoolitusele tohutute tekstikorpuste alal. Seda vähesel määral õppimisvõimet saab kasutada selleks, et leevendada GNN-ide sõltuvust suurtest märgistatud andmekogumitest.

Üks lähenemisviis on kasutada LLM-e graafikuülesannete otseseks prognoosimiseks, kirjeldades graafi struktuuri ja sõlmeteavet loomuliku keele viipades. Meetodid nagu Juhenda GLM-i ja GPT4Graaf peenhäälestage LLM-e, nagu LLaMA ja GPT-4, kasutades hoolikalt kavandatud viipasid, mis sisaldavad graafiku topoloogia üksikasju, nagu sõlmede ühendused, naabruskonnad jne. Häälestatud LLM-id saavad seejärel genereerida ennustusi selliste ülesannete jaoks nagu sõlmede klassifitseerimine ja linkide ennustamine järelduste tegemisel null-võttega.

Kuigi LLM-ide kasutamine musta kasti ennustajatena on näidanud paljutõotust, halveneb nende jõudlus keerukamate graafikuülesannete puhul, kus struktuuri selgesõnaline modelleerimine on kasulik. Mõned lähenemisviisid kasutavad seega LLM-e koos GNN-idega – GNN kodeerib graafistruktuuri, samas kui LLM pakub nende tekstikirjelduste põhjal paremat semantilist arusaamist sõlmedest.

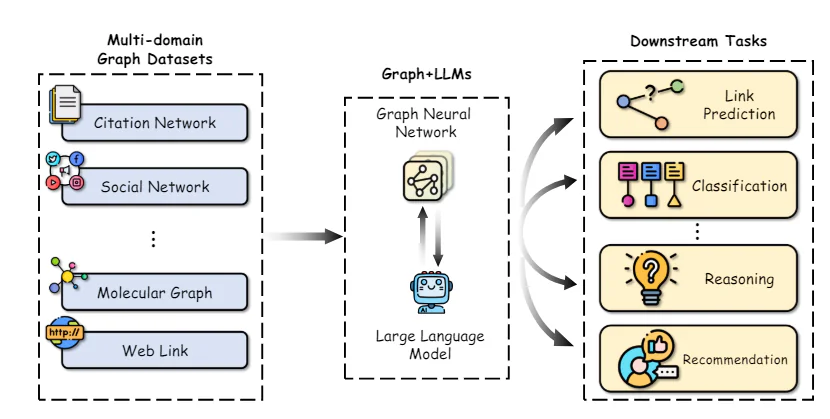

Graafiku mõistmine LLM-i raamistikuga – allikas

GraphLLM uurib kahte strateegiat: 1) LLM-id kui täiustajad, kus LLM-id kodeerivad tekstisõlme atribuute enne GNN-ile edastamist, ja 2) LLM-id kui ennustajad, kus LLM kasutab lõplike prognooside tegemiseks sisendina GNN-i vahepealseid esitusi.

GLEM läheb kaugemale, pakkudes välja variatsioonilise EM-algoritmi, mis vaheldub LLM-i ja GNN-i komponentide värskendamisega vastastikuse täiustamise eesmärgil.

Vähendades sõltuvust märgistatud andmetest väheste võtete ja pooljärelevalvega suurendamise kaudu, võivad LLM-i täiustatud graafikuõppe meetodid avada uusi rakendusi ja parandada andmete tõhusust.

LLM-ide täiustamine graafikute abil

Kuigi LLM-id on olnud tohutult edukad, kannatavad nad endiselt peamiste piirangute all, nagu hallutsinatsioonid (mittefaktiliste väidete genereerimine), nende arutlusprotsessi tõlgendatavuse puudumine ja suutmatus säilitada järjepidevaid faktiteadmisi.

Graafikud, eriti teadmiste graafikud, mis esindavad usaldusväärsetest allikatest pärinevat struktureeritud faktiteavet, pakuvad paljutõotavaid võimalusi nende puuduste kõrvaldamiseks. Uurime mõningaid esilekerkivaid lähenemisviise selles suunas:

Teadmiste graafiku täiustatud LLM-i eelkoolitus

Sarnaselt sellele, kuidas LLM-id on suurte tekstikorpuste jaoks eelkoolitatud, hiljutised tööd on uurinud nende eelkoolitamist teadmiste graafikute osas, et suurendada faktiteadlikkust ja arutlusvõimet.

Mõned lähenemisviisid muudavad sisendandmeid, lihtsalt ühendades või joondades eelkoolituse käigus faktilised KG kolmikud loomuliku keele tekstiga. E-BERT joondab KG olemi vektorid BERTi sõnaosa manustustega, samas kui K-BERT konstrueerib puud, mis sisaldavad algset lauset ja asjakohaseid KG kolmikuid.

LLM-ide roll graafiku masinõppes:

Teadlased on uurinud mitmeid viise LLM-ide integreerimiseks graafikute õppimise torujuhtmesse, millest igaühel on oma ainulaadsed eelised ja rakendused. Siin on mõned silmapaistvad rollid, mida LLM-id võivad täita:

- LLM kui võimendaja: Selle lähenemisviisi puhul kasutatakse LLM-e TAG-i sõlmedega seotud tekstiatribuutide rikastamiseks. LLM-i võime genereerida selgitusi, teadmusüksusi või pseudomärgiseid võib täiendada GNN-ile saadaolevat semantilist teavet, mille tulemuseks on sõlmede paremad esitused ja allavoolu ülesannete jõudlus.

Näiteks mudel TAPE (Text Augmented Pre-trained Encoders) kasutab ChatGPT-d, et genereerida tsiteerimisvõrgu dokumentidele selgitusi ja pseudosilte, mida seejärel kasutatakse keelemudeli peenhäälestamiseks. Saadud manustused suunatakse GNN-i sõlmede klassifitseerimise ja linkide ennustamise ülesannete jaoks, saavutades tipptasemel tulemused.

- LLM kui ennustaja: Sisendfunktsioonide täiustamise asemel kasutavad mõned lähenemisviisid otseselt LLM-e graafikuga seotud ülesannete ennustava komponendina. See hõlmab graafiku struktuuri teisendamist tekstiliseks esituseks, mida saab töödelda LLM, mis seejärel genereerib soovitud väljundi, näiteks sõlmesildid või graafikutaseme ennustused.

Üks tähelepanuväärne näide on GPT4Graphi mudel, mis kujutab graafikuid, kasutades graafikute modelleerimiskeelt (GML) ja kasutab võimsat GPT-4 LLM-i nullkaadri graafiku mõtlemise ülesannete jaoks.

- GNN-LLM joondus: Teine uurimissuund keskendub GNN-ide ja LLM-ide manustamisruumide joondamisele, võimaldades struktuurse ja semantilise teabe sujuvat integreerimist. Need lähenemisviisid käsitlevad GNN-i ja LLM-i eraldi meetoditena ja kasutavad nende esituste joondamiseks selliseid meetodeid nagu kontrastiivne õppimine või destilleerimine.

. Molecul STM mudel kasutab näiteks kontrastset eesmärki GNN-i ja LLM-i manuste joondamiseks, võimaldades LLM-il lisada GNN-i struktuuriteavet, samal ajal kui GNN saab kasu LLM-i semantilistest teadmistest.

Väljakutsed ja lahendused

Kuigi LLM-ide ja graafikute õppimise integreerimine on tohutult paljutõotav, tuleb lahendada mitmeid väljakutseid:

- Tõhusus ja mastaapsus: LLM-id on kurikuulsalt ressursimahukad, nõudes treenimiseks ja järelduste tegemiseks sageli miljardeid parameetreid ja tohutut arvutusvõimsust. See võib osutuda oluliseks kitsaskohaks LLM-i täiustatud graafikuõppe mudelite juurutamisel reaalsetes rakendustes, eriti piiratud ressurssidega seadmetes.

Üks paljutõotav lahendus on teadmiste destilleerimine, kus suurest LLM-ist (õpetajamudel) saadud teadmised kantakse üle väiksemasse, tõhusamasse GNN-i (õpilasmudel).

- Andmete lekkimine ja hindamine: LLM-id on eelkoolitatud suure hulga avalikult kättesaadavate andmete osas, mis võivad sisaldada tavapäraste võrdlusandmete kogumitest pärinevaid katsekomplekte, mis võivad põhjustada võimalikku andmeleket ja ülehinnatud jõudlust. Selle probleemi leevendamiseks on teadlased hakanud koguma uusi andmekogumeid või võtma proovide katseandmeid ajaperioodidest pärast LLM-i koolituse lõppu.

Lisaks on LLM-i täiustatud graafikuõppe mudelite jaoks õiglaste ja kõikehõlmavate hindamiskriteeriumide loomine ülioluline, et mõõta nende tegelikke võimeid ja võimaldada sisukaid võrdlusi.

- Ülekantavus ja seletatavus: Kuigi LLM-id paistavad silma null- ja väheste võtetega õppimisega, on nende võime edastada teadmisi erinevates graafikuvaldkondades ja struktuurides on endiselt avatud väljakutse. Nende mudelite ülekantavuse parandamine on kriitiline uurimissuund.

Lisaks on LLM-põhiste graafikuõppe mudelite seletatavuse parandamine oluline usalduse suurendamiseks ja nende kasutuselevõtuks suure panusega rakendustes. LLM-idele omaste arutlusvõimete ärakasutamine selliste tehnikate abil nagu mõtteahela õhutus võib aidata parandada seletatavust.

- Multimodaalne integratsioon: graafikud sisaldavad sageli enamat kui lihtsalt tekstilist teavet, sõlmede ja servadega, mis võivad olla seotud erinevate modaalsustega, nagu pildid, heli või arvandmed. LLM-ide integreerimise laiendamine nendele multimodaalsetele graafikuseadetele pakub põnevat võimalust tulevaste uuringute jaoks.

Reaalmaailma rakendused ja juhtumiuuringud

LLM-ide ja graafiku masinõppe integreerimine on juba näidanud paljutõotavaid tulemusi erinevates reaalmaailma rakendustes:

- Molekulaarsete omaduste ennustamine: Arvutuskeemia ja ravimite avastamise valdkonnas on LLM-e kasutatud molekulaarsete omaduste ennustamise parandamiseks, lisades molekulaargraafikutelt struktuuriteabe. The LLM4Mol mudelNäiteks kasutab ChatGPT molekulide SMILES-esituste (lihtsustatud molekulaarsisendi reasisestussüsteem) selgituste genereerimiseks, mida seejärel kasutatakse omaduste prognoosimisülesannete täpsuse parandamiseks.

- Teadmiste graafiku täitmine ja põhjendamine: Teadmiste graafikud on graafilise struktuuri eritüüp, mis esindab reaalse maailma üksusi ja nende seoseid. LLM-e on uuritud selliste ülesannete jaoks nagu teadmiste graafiku täitmine ja arutluskäik, kus graafiku struktuuri ja tekstilist teavet (nt olemikirjeldusi) tuleb ühiselt käsitleda.

- Soovitaja süsteemid: Soovitussüsteemide valdkonnas kasutatakse kasutaja-üksuste interaktsioonide esitamiseks sageli graafiku struktuure, kusjuures sõlmed esindavad kasutajaid ja üksusi ning servad tähistavad interaktsioone või sarnasusi. LLM-e saab kasutada nende graafikute täiustamiseks, genereerides kasutaja/üksuse küljeteavet või tugevdades interaktsiooni servi.

Järeldus

Suurte keelemudelite ja graafilise masinõppe vaheline sünergia on tehisintellektiuuringutes põnev eesrind. Kombineerides GNN-ide struktuurse induktiivse kallutatuse LLM-ide võimsate semantiliste mõistmisvõimalustega, saame avada uusi võimalusi graafikuõppe ülesannetes, eriti tekstiga omistatud graafikute puhul.

Kuigi on tehtud olulisi edusamme, on endiselt probleeme sellistes valdkondades nagu tõhusus, mastaapsus, ülekantavus ja seletatavus. Sellised meetodid nagu teadmiste destilleerimine, õiglase hindamise võrdlusalused ja multimodaalne integreerimine sillutavad teed LLM-i täiustatud graafikuõppe mudelite praktiliseks kasutuselevõtuks reaalsetes rakendustes.