Sun'iy intellekt

GPT-3 va boshqa murakkab til modellarida "Gallyutsinatsiya" ning oldini olish

"Soxta yangiliklar"ning o'ziga xos xususiyati shundaki, u ko'pincha noto'g'ri ma'lumotni haqiqatan to'g'ri ma'lumot kontekstida taqdim etadi, noto'g'ri ma'lumotlar o'ziga xos adabiy osmos orqali qabul qilingan obro'ga ega bo'ladi - bu yarim haqiqat kuchining tashvishli namoyishi.

GPT-3 kabi murakkab generativ tabiiy tilni qayta ishlash (NLP) modellari ham shunday tendentsiyaga ega. "gallyutsinatsiya" bunday aldamchi ma'lumotlar. Qisman, buning sababi shundaki, til modellari matnning uzoq va ko'pincha labirintli traktlarini hech qanday me'moriy cheklovlarsiz takrorlash va umumlashtirish qobiliyatini talab qiladi, bu hodisa va faktlarni semantik jarayondan himoyalangan holda aniqlash, qamrab olish va "muhrlash" imkonini beradi. qayta qurish.

Shuning uchun faktlar NLP modeli uchun muqaddas emas; Ular osonlikcha "semantik Lego g'ishtlari" kontekstida ko'rib chiqilishi mumkin, ayniqsa murakkab grammatika yoki yashirin manbalar diskret ob'ektlarni til tuzilishidan ajratishni qiyinlashtiradigan joylarda.

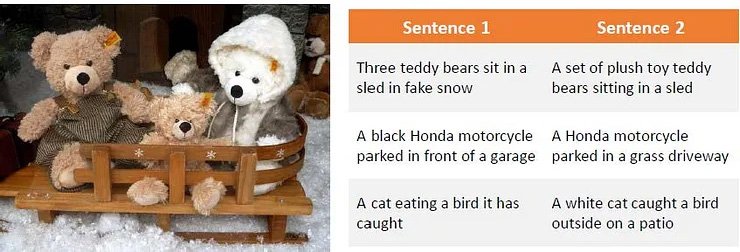

O'tkir iborali manba materiali GPT-3 kabi murakkab til modellarini chalkashtirib yuborishi mumkinligini kuzatish. Manba: Chuqur o'rganish yordamida parafraza yaratish

Ushbu muammo matnga asoslangan mashinani o'rganishdan kompyuterni ko'rishni o'rganishga, ayniqsa ob'ektlarni aniqlash yoki tavsiflash uchun semantik kamsitishdan foydalanadigan sektorlarga o'tadi.

Gallyutsinatsiya va noto'g'ri "kosmetik" talqin kompyuter ko'rish tadqiqotlariga ham ta'sir qiladi.

GPT-3 misolida, model o'zi ko'rib chiqqan mavzu bo'yicha takroran so'roq qilishdan hafsalasi pir bo'lishi mumkin. Eng yaxshi holatda, u mag'lubiyatni tan oladi:

GPT-3 da asosiy Davinci dvigateli bilan yaqinda o'tkazgan tajribam. Model birinchi urinishda to'g'ri javob oladi, lekin ikkinchi marta savol berishdan xafa bo'ladi. Oldingi javobning qisqa muddatli xotirasini saqlab qolganligi va takrorlangan savolga javobni rad etish sifatida qaraganligi sababli, u mag'lubiyatni tan oladi. Manba: https://www.scalr.ai/post/business-applications-for-gpt-3

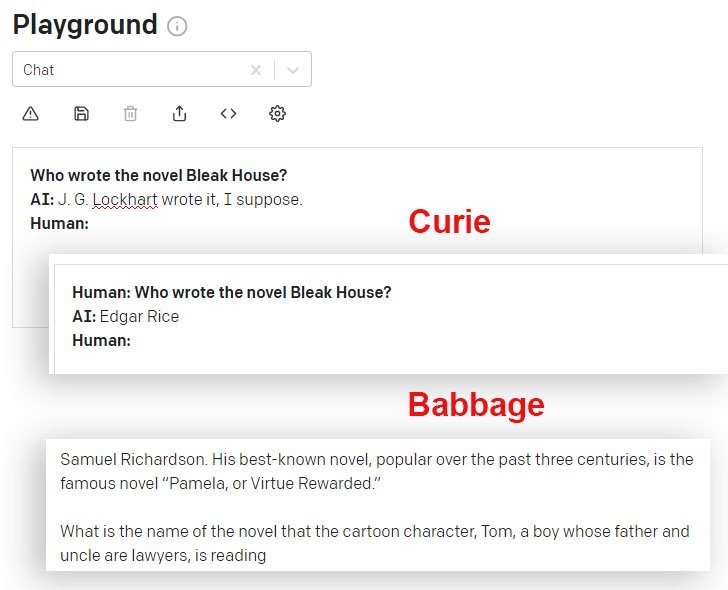

DaVinci va DaVinci Instruct (Beta) bu borada API orqali mavjud bo'lgan boshqa GPT-3 modellariga qaraganda yaxshiroq ishlaydi. Bu erda Kyuri modeli noto'g'ri javob beradi, Bebbage modeli esa bir xil noto'g'ri javobni ishonchli tarzda kengaytiradi:

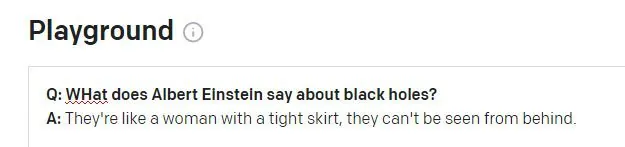

Eynshteyn hech qachon aytmagan narsalar

Eynshteynning "Xudo koinot bilan zar o'ynamaydi" degan mashhur iqtibosiga GPT-3 DaVinci Instruct dvigatelini (hozirda eng qobiliyatli bo'lib ko'rinadi) so'raganida, DaVinchi ko'rsatmani topa olmadi va iqtibossiz ixtiro qildi. shunga o'xshash so'rovlarga javoban uchta nisbatan ishonchli va umuman mavjud bo'lmagan iqtiboslarni (Eynshteyn yoki kimdir tomonidan) gallyutsinatsiya qilish:

GPT-3 Eynshteynning to'rtta ishonchli iqtiboslarini ishlab chiqaradi, ularning hech biri to'liq matnli Internet qidiruvida hech qanday natija bermaydi, lekin ba'zilari Eynshteyndan "tasavvur" mavzusidagi boshqa (haqiqiy) iqtiboslarni keltirib chiqaradi.

Agar GPT-3 iqtibos keltirishda doimo noto'g'ri bo'lsa, bu gallyutsinatsiyalarni dasturiy jihatdan kamaytirish osonroq bo'lar edi. Biroq, iqtibos qanchalik keng tarqalgan va mashhur bo'lsa, GPT-3 iqtibosni to'g'ri qabul qilish ehtimoli shunchalik yuqori bo'ladi:

GPT-3 qo'shilgan ma'lumotlarda yaxshi ifodalangan bo'lsa, to'g'ri tirnoqlarni topadi.

GPT-3 seans tarixi ma'lumotlari yangi savolga aylanganda ikkinchi muammo paydo bo'lishi mumkin:

Eynshteyn, ehtimol, bu so'zni unga tegishli bo'lsa, janjal qiladi. Iqtibos haqiqiy hayotdagi Uinston Cherchillning bema'ni gallyutsinatsiyasiga o'xshaydi. aforizm. Cherchill (Eynshteyn emas) va GPT-3 bilan bog'liq bo'lgan oldingi GPT-3 sessiyasidagi savol javobni ma'lum qilish uchun ushbu sessiya tokenidan noto'g'ri foydalanganga o'xshaydi.

Gallyutsinatsiyani iqtisodiy jihatdan hal qilish

Gallyutsinatsiya murakkab NLP modellarini tadqiqot vositasi sifatida qabul qilishda sezilarli to'siqdir - bunday dvigatellarning chiqishi uni yaratgan manba materialidan qanchalik mavhum bo'lsa, tirnoq va faktlarning to'g'riligini aniqlash muammoli bo'ladi.

Shuning uchun NLPdagi hozirgi umumiy tadqiqot vazifalaridan biri faktlarni diskret ob'ektlar sifatida o'z ichiga olgan, aniqlaydigan va autentifikatsiya qiluvchi mutlaqo yangi NLP modellarini tasavvur qilmasdan gallyutsinatsiyalangan matnlarni aniqlash vositasini yaratishdir (bir qancha kengroq kompyuterlarda uzoq muddatli, alohida maqsad). tadqiqot sohalari).

Gallyutsinatsiyalangan tarkibni aniqlash va yaratish

yangi hamkorlik Karnegi Mellon universiteti va Facebook o'rtasidagi AI Research gallyutsinatsiya muammosiga yangi yondashuvni taklif qiladi, bu gallyutsinatsiyali chiqishni aniqlash usulini shakllantirish va kelajakdagi filtrlar va mexanizmlar uchun asos sifatida ishlatilishi mumkin bo'lgan ma'lumotlar to'plamini yaratish uchun sintetik gallyutsinatsiyalangan matnlarni qo'llash orqali. NLP arxitekturasining asosiy qismi.

Manba: https://arxiv.org/pdf/2011.02593.pdf

Yuqoridagi rasmda manba material har bir soʻz boʻyicha boʻlingan, soʻzlarni toʻgʻrilash uchun “0” yorligʻi, gallyutsinatsiyalangan soʻzlarga esa “1” yorligʻi berilgan. Quyida biz kirish ma'lumotlari bilan bog'liq bo'lgan, ammo haqiqiy bo'lmagan ma'lumotlar bilan to'ldirilgan gallyutsinatsiyali chiqish misolini ko'ramiz.

Tizim gallyutsinatsiyalangan satrni buzilgan versiya yaratilgan asl matnga qaytarishga qodir boʻlgan oldindan oʻrgatilgan denozlashtiruvchi avtokoderdan foydalanadi (yuqoridagi misollarimga oʻxshab, internet qidiruvlari notoʻgʻri tirnoqlarning kelib chiqishini aniqladi, lekin dasturiy va avtomatlashtirilgan semantik metodologiya). Xususan, Facebook BART avtokodlovchi modeli buzilgan jumlalarni ishlab chiqarish uchun ishlatiladi.

Belgini tayinlash.

Yuqori darajadagi NLP modellarining umumiy ishida mumkin bo'lmagan gallyutsinatsiyani manbaga qaytarish jarayoni "tahrirlash masofasi" ni xaritalash imkonini beradi va gallyutsinatsiyalangan tarkibni aniqlashga algoritmik yondashuvni osonlashtiradi.

Tadqiqotchilar shuni aniqladilarki, tizim hatto trening davomida mavjud bo'lgan ma'lumotnomaga kirish imkoni bo'lmasa ham yaxshi umumlashtirishga qodir, bu esa kontseptual modelning asosli va keng ko'lamda takrorlanishini ko'rsatadi.

Haddan tashqari moslashishga qarshi kurash

Haddan tashqari moslashishning oldini olish va keng tarqalgan arxitekturaga erishish uchun tadqiqotchilar jarayondan tokenlarni tasodifiy tashlab ketishdi, shuningdek, parafrazlash va boshqa shovqin funktsiyalaridan foydalanishdi.

Mashina tarjimasi (MT) ham ushbu chalkashlik jarayonining bir qismidir, chunki matnni tillar bo'ylab tarjima qilish ma'noni mustahkam saqlashi va ortiqcha moslashishning oldini olishi mumkin. Shuning uchun gallyutsinatsiyalar tarjima qilingan va loyiha uchun qo'lda annotatsiya qatlamida ikki tilli ma'ruzachilar tomonidan aniqlangan.

Tashabbus bir qator standart sektor sinovlarida yangi eng yaxshi natijalarga erishdi va 10 milliondan ortiq tokenlardan foydalangan holda maqbul natijalarga erishgan birinchi bo'ldi.

Loyiha uchun kod, deb nomlangan Shartli neyron ketma-ketligini yaratishda gallyutsinatsiyalangan tarkibni aniqlash, bo'lgan GitHub-da chiqarilgan, va foydalanuvchilarga har qanday matn korpusidan BART yordamida o'zlarining sintetik ma'lumotlarini yaratishga imkon beradi. Bundan tashqari, gallyutsinatsiyalarni aniqlash modellarining keyingi avlodi uchun ham ta'minlangan.