ویڈیو جنریٹرز

جنریٹیو ویڈیو سسٹم مکمل فلمیں کیوں نہیں بنا سکتے؟

تخلیقی AI ویڈیو کی آمد اور پیشرفت نے بہت سے آرام دہ مبصرین کو اس کی طرف راغب کیا ہے۔ پیشن گوئی یہ مشین لرننگ فلم انڈسٹری کی موت کو ثابت کرے گی جیسا کہ ہم جانتے ہیں - اس کے بجائے، واحد تخلیق کار مقامی یا کلاؤڈ بیسڈ GPU سسٹمز پر، گھر پر ہی ہالی ووڈ طرز کے بلاک بسٹرز تخلیق کر سکیں گے۔

کیا یہ ممکن ہے؟ یہاں تک کہ اگر یہ ممکن ہے، ہے آسنن، جیسا کہ بہت سے لوگ مانتے ہیں؟

یہ افراد آخر کار فلمیں بنانے کے قابل ہو جائیں گے، جس شکل میں ہم انہیں جانتے ہیں، مستقل کرداروں، بیانیہ کے تسلسل اور مکمل تصویری حقیقت کے ساتھ، کافی ممکن ہے - اور شاید ناگزیر بھی۔

تاہم ایسی کئی بنیادی وجوہات ہیں جن کی بنیاد پر ویڈیو سسٹمز کے ساتھ ایسا ہونے کا امکان نہیں ہے۔ لیٹنٹ ڈفیوژن ماڈلز.

یہ آخری حقیقت اہم ہے کیونکہ، اس وقت، اس زمرے میں شامل ہے۔ ہر مقبول ٹیکسٹ ٹو ویڈیو (T2) اور امیج ٹو ویڈیو (I2V) سسٹم دستیاب ہے، بشمول Minimax، Kling، Sora، Imagen، Luma، Amazon Video Generator، Runway ML، Kaiber (اور، جہاں تک ہم سمجھ سکتے ہیں، ایڈوب فائر فلائی) زیر التواء ویڈیو کی فعالیت؛ درمیان بہت سے دوسروں کے.

یہاں، ہم سچ کے امکان پر غور کر رہے ہیں۔ مصنف مکمل طوالت والی gen-AI پروڈکشنز، جو افراد کے ذریعہ تخلیق کی گئی ہیں، مستقل کرداروں، سنیماٹوگرافی، اور بصری اثرات کے ساتھ کم از کم ہالی ووڈ میں آرٹ کی موجودہ حالت کے برابر۔

آئیے اس میں شامل چیلنجوں کے لیے کچھ سب سے بڑی عملی رکاوٹوں پر ایک نظر ڈالتے ہیں۔

1: آپ درست فالو آن شاٹ حاصل نہیں کر سکتے

بیانیہ کی عدم مطابقت ان رکاوٹوں میں سب سے بڑی ہے۔ حقیقت یہ ہے کہ فی الحال دستیاب ویڈیو جنریشن سسٹم واقعی درست 'فالو آن' شاٹ* نہیں بنا سکتا۔

اس کی وجہ یہ ہے کہ denoising بازی ماڈل ان نظاموں کے دل پر انحصار کرتا ہے۔ بے ترتیب شور، اور یہ بنیادی اصول بالکل ایک ہی مواد کی دو بار تشریح کرنے کے قابل نہیں ہے (یعنی، مختلف زاویوں سے، یا پچھلے شاٹ کو فالو آن شاٹ میں تیار کرکے جو پچھلے شاٹ کے ساتھ مستقل مزاجی کو برقرار رکھتا ہے)۔

جہاں متن کے اشارے استعمال کیے جاتے ہیں، اکیلے یا ایک ساتھ 'بیج' کی تصاویر اپ لوڈ کیں۔ (ملٹی موڈل ان پٹ)، ٹوکن پرامپٹ سے اخذ کیا گیا تربیت یافتہ سے لفظی طور پر مناسب مواد نکالے گا۔ اویکت جگہ ماڈل کے.

تاہم، مزید 'بے ترتیب شور' عنصر کی طرف سے رکاوٹ، یہ کرے گا ایک ہی طرح سے دو بار کبھی نہ کرو.

اس کا مطلب ہے کہ ویڈیو میں لوگوں کی شناخت بدل جائے گی، اور اشیاء اور ماحول ابتدائی شاٹ سے مماثل نہیں ہوں گے۔

یہی وجہ ہے کہ وائرل کلپس جس میں غیر معمولی بصری اور ہالی ووڈ کی سطح کے آؤٹ پٹ کو دکھایا گیا ہے وہ یا تو سنگل شاٹس ہوتے ہیں، یا سسٹم کی صلاحیتوں کا ایک 'شوکیس مانٹیج' ہوتے ہیں، جہاں ہر شاٹ میں مختلف کردار اور ماحول ہوتا ہے۔

مارکو وین ہیلکاما ولئیگ کی طرف سے تخلیقی AI مانٹیج کے اقتباسات – ماخذ: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ

کے ان مجموعوں میں مضمرات ایڈہاک ویڈیو جنریشنز (جو کمرشل سسٹمز کے معاملے میں مضحکہ خیز ہو سکتے ہیں) یہ ہے کہ بنیادی نظام کر سکتے ہیں متضاد اور مستقل بیانیہ تخلیق کریں۔

یہاں جس تشبیہ کا فائدہ اٹھایا جا رہا ہے وہ ایک فلم کا ٹریلر ہے، جس میں فلم کے صرف ایک یا دو منٹ کی فوٹیج دکھائی گئی ہے، لیکن ناظرین کو یہ یقین کرنے کی وجہ فراہم کرتا ہے کہ پوری فلم موجود ہے۔

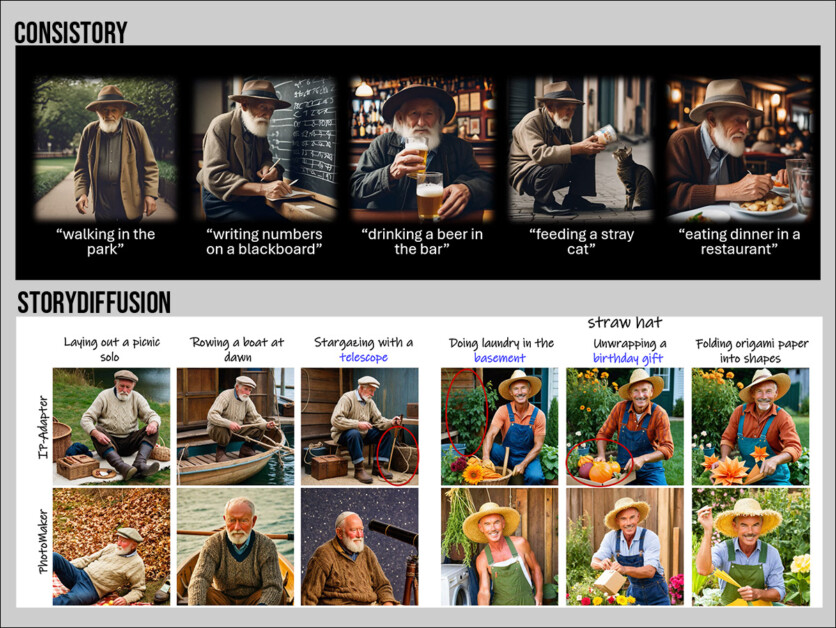

صرف وہی نظام جو فی الحال ایک ڈفیوژن ماڈل میں بیانیہ کی مستقل مزاجی پیش کرتے ہیں وہ ہیں جو اسٹیل امیجز تیار کرتے ہیں۔ ان میں NVIDIA شامل ہیں۔ ConsiStory، اور سائنسی ادب میں متنوع منصوبے، جیسے تھیٹرجن, ڈریم اسٹوری، اور کہانی بازی.

'جامد' بیانیہ کے تسلسل کی دو مثالیں، حالیہ ماڈلز سے:: ذرائع: https://research.nvidia.com/labs/par/consistory/ اور https://arxiv.org/pdf/2405.01434

نظریہ میں، کوئی بھی تصویر سے ویڈیو شاٹس کی ایک سیریز بنانے کے لیے اس طرح کے سسٹمز کا بہتر ورژن استعمال کر سکتا ہے (مذکورہ بالا میں سے کوئی بھی صحیح معنوں میں مطابقت نہیں رکھتا)، جسے ایک ترتیب میں ایک ساتھ جوڑا جا سکتا ہے۔

آرٹ کی موجودہ حالت میں، یہ نقطہ نظر قابل فہم فالو آن شاٹس پیدا نہیں کرتا ہے۔ اور، کسی بھی صورت میں، ہم پہلے ہی سے روانہ ہو چکے ہیں۔ مصنف پیچیدگی کی ایک پرت شامل کرکے خواب دیکھیں۔

ہم، اس کے علاوہ، استعمال کر سکتے ہیں کم درجہ کی موافقت (LoRA) ماڈلز، خاص طور پر کرداروں، چیزوں یا ماحول پر تربیت یافتہ، شاٹس میں بہتر مستقل مزاجی کو برقرار رکھنے کے لیے۔

تاہم، اگر کوئی کردار کسی نئے لباس میں ظاہر ہونا چاہتا ہے تو، ایک مکمل طور پر نئے LoRA کو عام طور پر تربیت دینے کی ضرورت ہوگی جو کہ اس فیشن میں ملبوس کردار کو مجسم کرے (حالانکہ ذیلی تصورات جیسے کہ 'سرخ لباس' کو انفرادی LoRAs میں تربیت دی جا سکتی ہے، ایک ساتھ متضاد تصاویر کے ساتھ، ان کے ساتھ کام کرنا ہمیشہ آسان نہیں ہوتا ہے)۔

اس سے کافی پیچیدگی بڑھ جاتی ہے، یہاں تک کہ فلم کے ایک ابتدائی منظر تک، جہاں ایک شخص بستر سے اٹھتا ہے، ڈریسنگ گاؤن پہنتا ہے، جمائی لیتا ہے، سونے کے کمرے کی کھڑکی سے باہر دیکھتا ہے، اور دانت صاف کرنے کے لیے باتھ روم جاتا ہے۔

ایسا منظر، جس میں تقریباً 4-8 شاٹس ہوتے ہیں، روایتی فلم سازی کے طریقہ کار کے ذریعے ایک صبح فلمایا جا سکتا ہے۔ تخلیقی AI میں آرٹ کی موجودہ حالت میں، یہ ممکنہ طور پر ہفتوں کے کام، متعدد تربیت یافتہ LoRAs (یا دیگر ملحقہ نظام)، اور کافی مقدار میں پوسٹ پروسیسنگ کی نمائندگی کرتا ہے۔

متبادل طور پر، ویڈیو سے ویڈیو استعمال کیا جا سکتا ہے، جہاں دنیاوی یا CGI فوٹیج کو متن کے اشارے کے ذریعے متبادل تشریحات میں تبدیل کیا جاتا ہے۔ رن وے فراہم کرتا ہے اس طرح کا نظام، مثال کے طور پر.

بلینڈر سے سی جی آئی (بائیں)، جس کی تشریح میتھیو ویسنجیویک کے ذریعہ ٹیکسٹ ایڈڈ رن وے ویڈیو ٹو ویڈیو تجربے میں کی گئی ہے – ماخذ: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

یہاں دو مسائل ہیں: آپ کو پہلے سے ہی بنیادی فوٹیج بنانا ہے، لہذا آپ پہلے ہی فلم بنا رہے ہیں۔ میں دو بار، یہاں تک کہ اگر آپ مصنوعی نظام جیسے UnReal's استعمال کر رہے ہیں۔ میٹا ہومان.

اگر آپ CGI ماڈلز بناتے ہیں (جیسا کہ اوپر کلپ میں ہے) اور انہیں ویڈیو سے تصویری تبدیلی میں استعمال کرتے ہیں، تو شاٹس میں ان کی مستقل مزاجی پر بھروسہ نہیں کیا جا سکتا۔

اس کی وجہ یہ ہے کہ ویڈیو ڈفیوژن ماڈلز 'بڑی تصویر' نہیں دیکھتے ہیں - بلکہ وہ پچھلے فریم/s کی بنیاد پر ایک نیا فریم بناتے ہیں، اور کچھ مقدمات, ایک قریبی مستقبل کے فریم پر غور کریں؛ لیکن، اس عمل کا شطرنج کے کھیل سے موازنہ کرنے کے لیے، وہ 'دس چالیں آگے' کے بارے میں نہیں سوچ سکتے، اور نہ ہی دس چالوں کو پیچھے یاد رکھ سکتے ہیں۔

دوم، ایک ڈفیوژن ماڈل اب بھی تمام شاٹس میں مستقل ظاہری شکل کو برقرار رکھنے کے لیے جدوجہد کرے گا، یہاں تک کہ اگر آپ اس سیکشن کے آغاز میں بتائی گئی وجوہات کی بناء پر کردار، ماحول اور روشنی کے انداز کے لیے متعدد LoRAs شامل کرتے ہیں۔

2: آپ شاٹ میں آسانی سے ترمیم نہیں کر سکتے

اگر آپ پرانے اسکول کے CGI طریقوں کا استعمال کرتے ہوئے کسی کردار کو سڑک پر چلتے ہوئے دکھاتے ہیں، اور آپ فیصلہ کرتے ہیں کہ آپ شاٹ کے کچھ پہلو کو تبدیل کرنا چاہتے ہیں، تو آپ ماڈل کو ایڈجسٹ کر سکتے ہیں اور اسے دوبارہ پیش کر سکتے ہیں۔

اگر یہ ایک حقیقی زندگی کا شوٹ ہے، تو آپ اسے درست تبدیلیوں کے ساتھ دوبارہ ترتیب دیں اور دوبارہ شوٹ کریں۔

تاہم، اگر آپ ایک gen-AI ویڈیو شاٹ تیار کرتے ہیں جسے آپ پسند کرتے ہیں، لیکن تبدیل کرنا چاہتے ہیں۔ ایک پہلو اس میں سے، آپ اسے صرف پچھلے 30-40 سالوں میں تیار کیے گئے محنتی پوسٹ پروڈکشن طریقوں سے حاصل کر سکتے ہیں: CGI، روٹوسکوپنگ، ماڈلنگ اور میٹنگ – تمام محنت طلب اور مہنگے، وقت لگتا طریقہ کار

جس طرح سے ڈفیوژن ماڈلز کام کرتے ہیں، صرف ٹیکسٹ پرامپٹ کے ایک پہلو کو تبدیل کرنا (یہاں تک کہ ملٹی موڈل پرامپٹ میں بھی، جہاں آپ مکمل ماخذ سیڈ امیج فراہم کرتے ہیں) بدل جائے گا۔ متعدد پہلوؤں پیدا کردہ آؤٹ پٹ کا، جس کے نتیجے میں 'ویک-اے-مول' کا اشارہ ملتا ہے۔

3: آپ فزکس کے قوانین پر بھروسہ نہیں کر سکتے

روایتی CGI طریقے مختلف قسم کے الگورتھمک فزکس پر مبنی ماڈل پیش کرتے ہیں جو چیزوں کی تقلید کر سکتے ہیں جیسے کہ سیال حرکیات، گیسی حرکت، الٹا حرکیات (انسانی حرکت کی درست ماڈلنگ)، کپڑے کی حرکیات، دھماکے، اور متنوع دیگر حقیقی دنیا کے مظاہر۔

تاہم، بازی پر مبنی طریقے، جیسا کہ ہم نے دیکھا ہے، ان کی یادیں مختصر ہوتی ہیں، اور ان کی ایک محدود رینج بھی ہوتی ہے۔ تحریک پیشگی (اس طرح کی کارروائیوں کی مثالیں، تربیتی ڈیٹاسیٹ میں شامل)

ایک میں پہلے ورژن اوپن اے آئی کے معروف سورا جنریٹو سسٹم کے لینڈنگ پیج پر، کمپنی نے تسلیم کیا کہ سورا کی اس سلسلے میں حدود ہیں (حالانکہ اس متن کو ہٹا دیا گیا ہے):

'[سورا] کسی پیچیدہ منظر کی طبیعیات کی نقالی کرنے کے لیے جدوجہد کر سکتا ہے، اور ہو سکتا ہے کہ وجہ اور اثر کی مخصوص مثالوں کو نہ سمجھ سکے (مثال کے طور پر: کوکی کسی کردار کے کاٹنے کے بعد نشان نہیں دکھا سکتی ہے)۔

'ماڈل پرامپٹ میں شامل مقامی تفصیلات کو بھی الجھا سکتا ہے، جیسے کہ دائیں سے بائیں سمجھنا، یا وقت کے ساتھ سامنے آنے والے واقعات کی درست وضاحت کے ساتھ جدوجہد کرنا، جیسے مخصوص کیمرے کی رفتار۔'

مختلف API پر مبنی جنریٹیو ویڈیو سسٹمز کا عملی استعمال درست طبیعیات کی عکاسی میں اسی طرح کی حدود کو ظاہر کرتا ہے۔ تاہم، بعض عام جسمانی مظاہر، جیسے دھماکوں، کو ان کے تربیتی ڈیٹا سیٹس میں بہتر انداز میں پیش کیا جاتا ہے۔

کچھ حرکت سے پہلے کی ایمبیڈنگز، یا تو جنریٹو ماڈل میں تربیت یافتہ ہیں یا کسی سورس ویڈیو سے کھلائی گئی ہیں، کو مکمل ہونے میں کچھ وقت لگتا ہے (جیسے کہ کوئی شخص ایک وسیع لباس میں ایک پیچیدہ اور غیر دہرائے جانے والے رقص کی ترتیب کو انجام دے رہا ہے) اور ایک بار پھر، ڈفیوژن ماڈل کی توجہ کی مایوپک ونڈو ممکنہ طور پر مواد کو تبدیل کرنے کا امکان ہے (چہرے کی شناخت، وقت کی تفصیلات، وغیرہ کے مطابق)۔ تاہم، LoRAs اس کو ایک حد تک کم کر سکتے ہیں۔

پوسٹ میں اسے ٹھیک کرنا

خالص 'واحد صارف' AI ویڈیو جنریشن میں دیگر کوتاہیاں بھی ہیں، جیسے مشکل ان کے پاس تیز رفتار حرکات، اور عمومی اور کہیں زیادہ اہم مسئلہ ہے۔ وقتی مستقل مزاجی حاصل کرنا آؤٹ پٹ ویڈیو میں۔

مزید برآں، جنریٹیو ویڈیو میں چہرے کی مخصوص پرفارمنس بنانا قسمت کی بات ہے، جیسا کہ ڈائیلاگ کے لیے ہونٹ سنک ہے۔

دونوں صورتوں میں، ذیلی نظام کا استعمال جیسے لائیو پورٹریٹ اور اینیمیٹ ڈف VFX کمیونٹی میں بہت مقبول ہو رہا ہے، کیونکہ اس سے چہرے کے کم از کم وسیع تاثرات کی منتقلی اور موجودہ پیدا شدہ آؤٹ پٹ میں ہونٹوں کی مطابقت پذیری کی اجازت ملتی ہے۔

LivePortrait کے ساتھ ٹارگٹ ویڈیو پر ایکسپریشن ٹرانسفر (ویڈیو کو نیچے بائیں طرف چلانے) کی ایک مثال۔ ویڈیو Generative Z TunisiaGenerative کی ہے۔ https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/ پر بہتر معیار میں مکمل طوالت کا ورژن دیکھیں؟

مزید، پیچیدہ حلوں کا ایک ہزارہا، ٹولز کو شامل کرتے ہوئے جیسے کہ Stable Diffusion GUI ComfyUI اور پیشہ ورانہ کمپوزٹنگ اور ہیرا پھیری کی درخواست نیکنیز خلائی ہیرا پھیری کے ساتھ ساتھ، AI VFX پریکٹیشنرز کو چہرے کے تاثرات اور مزاج پر زیادہ کنٹرول حاصل کرنے کی اجازت دیتا ہے۔

اگرچہ وہ بیان کرتا ہے ComfyUI میں چہرے کی اینیمیشن کے عمل کو 'تشدد' کے طور پر، VFX پروفیشنل فرانسسکو کونٹریاس نے ایک ایسا طریقہ کار تیار کیا ہے، جو ہونٹوں کے فونیمز اور چہرے/سر کی تصویر کشی کے دیگر پہلوؤں کو مسلط کرنے کی اجازت دیتا ہے۔

Stable Diffusion، جس کی مدد سے Nuke سے چلنے والے ComfyUI ورک فلو نے VFX پرو فرانسسکو کونٹریاس کو چہرے کے پہلوؤں پر غیر معمولی کنٹرول حاصل کرنے کی اجازت دی۔ مکمل ویڈیو کے لیے، بہتر ریزولیوشن پر، https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/ پر جائیں

نتیجہ

حقیقت پسندانہ مکالمے، ہونٹ سنک، پرفارمنس، ماحول اور تسلسل کے ساتھ مربوط اور فوٹو ریئلسٹک بلاک بسٹر طرز کی مکمل طوالت کی فلمیں بنانے والے واحد صارف کے امکانات کے لیے ان میں سے کوئی بھی امید افزا نہیں۔

مزید برآں، یہاں بیان کردہ رکاوٹیں، کم از کم بازی پر مبنی جنریٹو ویڈیو ماڈلز کے سلسلے میں، فورم کے تبصروں اور میڈیا کی توجہ کے باوجود، اب 'کسی بھی لمحے' حل کرنے کے قابل نہیں ہیں۔ بیان کردہ رکاوٹیں فن تعمیر کا اندرونی معلوم ہوتا ہے۔

AI کی ترکیب کی تحقیق میں، جیسا کہ تمام سائنسی تحقیق میں، شاندار خیالات وقتاً فوقتاً اپنی صلاحیتوں سے ہمیں حیران کر دیتے ہیں، صرف مزید تحقیق کے لیے ان کی بنیادی حدود کا پتہ لگانے کے لیے۔

جنریٹو/سنتھیسز اسپیس میں، یہ پہلے ہی جنریٹو ایڈورسریل نیٹ ورکس کے ساتھ ہو چکا ہے (GANs) اور نیورل ریڈیئنس فیلڈز (این آر ایف)، اس مقصد کے لیے برسوں کی علمی تحقیق کے باوجود، دونوں ہی بالآخر کارآمد تجارتی نظاموں میں آلہ کار بنانا بہت مشکل ثابت ہوئے۔ یہ ٹیکنالوجیز اب متبادل فن تعمیر میں ملحقہ اجزاء کے طور پر اکثر دکھائی دیتی ہیں۔

جیسا کہ مووی اسٹوڈیوز امید کر سکتے ہیں کہ قانونی طور پر لائسنس یافتہ مووی کیٹلاگ پر تربیت حاصل کر سکتی ہے۔ VFX فنکاروں کو ختم کریں۔، AI اصل میں ہے۔ انہوں نے مزید کہا موجودہ وقت میں افرادی قوت کے لیے کردار۔

آیا بازی پر مبنی ویڈیو سسٹم واقعی بیانیہ کے مطابق اور فوٹو ریئلسٹک مووی جنریٹرز میں تبدیل ہو سکتے ہیں، یا یہ کہ سارا کاروبار صرف ایک اور کیمیاوی تعاقب ہے، اگلے 12 مہینوں میں ظاہر ہو جانا چاہیے۔

یہ ہو سکتا ہے کہ ہمیں بالکل نئے انداز کی ضرورت ہو۔ یا یہ ہو سکتا ہے Gaussian Splatting (GSplat)، جسے i تیار کیا گیا تھا۔1990 کی دہائی کے اوائل میں اور حال ہی میں ہے اتار لیا تصویری ترکیب کی جگہ میں، بازی پر مبنی ویڈیو جنریشن کے ممکنہ متبادل کی نمائندگی کرتا ہے۔

چونکہ GSplat کو منظر عام پر آنے میں 34 سال لگے، یہ بھی ممکن ہے کہ پرانے دعویدار جیسے NeRF اور GANs - اور یہاں تک کہ اویکت پھیلنے والے ماڈلز - کا ابھی دن باقی ہے۔

* اگرچہ کیبر کی اے آئی اسٹوری بورڈ کی خصوصیت اس قسم کی فعالیت پیش کرتا ہے، میں نے جو نتائج دیکھے ہیں۔ پیداوار کا معیار نہیں۔.

مارٹن اینڈرسن metaphysic.ai پر سائنسی تحقیقی مواد کے سابق سربراہ ہیں۔

پہلی بار پیر 23 ستمبر 2024 کو شائع ہوا۔