Andersonov kot

Nove raziskovalne naloge postavljajo pod vprašaj ceno žetonov za klepete z umetno inteligenco

Nove raziskave kažejo, da način, kako storitve umetne inteligence zaračunavajo z žetoni, prikriva dejanske stroške pred uporabniki. Ponudniki lahko tiho napihnejo cene z manipulacijo števila žetonov ali skritimi koraki. Nekateri sistemi izvajajo dodatne procese, ki ne vplivajo na rezultat, vendar se še vedno prikažejo na računu. Predlagana so bila orodja za revizijo, vendar brez pravega nadzora uporabniki plačajo več, kot se zavedajo.

V skoraj vseh primerih je tisto, kar mi kot potrošniki plačamo za klepetalnice, ki jih poganja umetna inteligenca, kot na primer ChatGPT-4o, se trenutno meri v žetonih: nevidne enote besedila, ki med uporabo ostanejo neopažene, vendar se za namene obračunavanja štejejo z natančnostjo; in čeprav je cena vsake izmenjave določena glede na število obdelanih žetonov, uporabnik nima neposrednega načina za potrditev štetja.

Kljub našemu (v najboljšem primeru) nepopolnemu razumevanju tega, kaj dobimo za kupljeno enoto »žetonov«, je obračunavanje na podlagi žetonov postalo standardni pristop pri vseh ponudnikih, ki temelji na negotovi predpostavki zaupanja.

Žetonske besede

Žeton ni povsem enak besedi, čeprav pogosto igra podobno vlogo, in večina ponudnikov uporablja izraz »žeton« za opis majhnih enot besedila, kot so besede, ločila ali fragmenti besed. Beseda 'neverjetno'na primer, en sistem lahko šteje kot en sam žeton, medtem ko ga drug lahko razdeli na več un, verjeti in lahko, pri čemer vsak kos povečuje stroške.

Ta sistem velja tako za besedilo, ki ga vnese uporabnik, kot za odgovor modela, pri čemer cena temelji na skupnem številu teh enot.

Težava je v tem, da uporabniki tega postopka ne morem videtiVečina vmesnikov med pogovorom ne prikazuje števila žetonov, način izračuna žetonov pa je težko reproducirati. Tudi če je število prikazano po odgovora, je prepozno, da bi ugotovili, ali je bil pošten, kar ustvarja neskladje med tem, kar uporabnik vidi, in tem, za kar plačuje.

Nedavne raziskave kažejo na globlje težave: neki študiji prikazuje, kako lahko ponudniki zaračunavajo previsoke cene, ne da bi pri tem kršili pravila, preprosto tako, da napihnejo število žetonov na načine, ki jih uporabnik ne more videti; drugo razkriva neskladje med tem, kar vmesniki prikazujejo, in tem, kar se dejansko zaračunava, kar uporabnikom pušča iluzijo učinkovitosti tam, kjer je morda ni; in Tretji razkriva, kako modeli rutinsko ustvarjajo notranje korake sklepanja, ki niso nikoli prikazani uporabniku, a se kljub temu pojavijo na računu.

Ugotovitve prikazujejo sistem, ki Zdi se, natančni, z natančnimi številkami, ki nakazujejo jasnost, vendar njihova osnovna logika ostaja skrita. Ne glede na to, ali gre za zasnovo ali strukturno napako, je rezultat enak: uporabniki plačajo za več, kot lahko vidijo, in pogosto več, kot pričakujejo.

Ceneje za ducat?

v prvi teh dokumentov – z naslovom Je Vaš LLM vam preplačuje? Tokenizacija, preglednost in spodbude, od štirih raziskovalcev z Inštituta Max Planck za programske sisteme – avtorji trdijo, da tveganja obračunavanja na podlagi žetonov segajo dlje od nepreglednosti, in kažejo na vgrajeno spodbudo za ponudnike, da napihujejo število žetonov:

„Jedro problema je v tem, da tokenizacija niza ni enolična. Na primer, vzemimo, da uporabnik ponudniku pošlje poziv »Kje se bo odvil naslednji NeurIPS?«, ponudnik ga vnese v LLM in model ustvari izhod »|San| Diego|«, ki je sestavljen iz dveh žetonov.“

„Ker uporabnik ne ve za generativni proces, lahko sebični ponudnik napačno sporoči tokenizacijo izhoda uporabniku, ne da bi sploh spremenil osnovni niz. Ponudnik bi lahko na primer preprosto delil tokenizacijo »|S|a|n| |D|i|e|g|o|« in uporabniku zaračunal devet žetonov namesto dveh!“

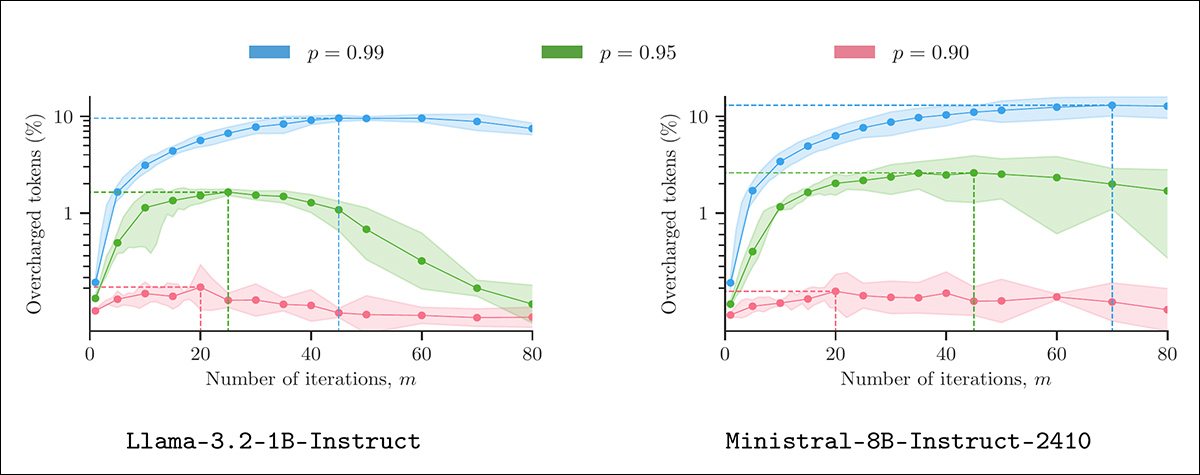

Članek predstavlja hevristiko, ki je sposobna izvesti tovrstni neiskren izračun brez spreminjanja vidnega izhoda in brez kršitve verodostojnosti pri tipičnih nastavitvah dekodiranja. Preizkušeno na modelih iz Klici, Mistral in Gemma serija, z uporabo resničnih pozivov, metoda doseže merljive preobremenitve, ne da bi se zdela anomalna:

Inflacija žetonov z uporabo »verjetnega napačnega poročanja«. Vsaka plošča prikazuje odstotek prezaračunanih žetonov, ki nastanejo, ko ponudnik uporabi algoritem 1 na izhodih iz 400 pozivov LMSYS, pri različnih parametrih vzorčenja (m in p). Vsi izhodi so bili ustvarjeni pri temperaturi 1.3, s petimi ponovitvami na nastavitev za izračun 90-odstotnih intervalov zaupanja. Vir: https://arxiv.org/pdf/2505.21627

Da bi rešili težavo, raziskovalci pozivajo k obračunavanju na podlagi število znakov namesto žetonov, saj trdijo, da je to edini pristop, ki ponudnikom daje razlog za pošteno poročanje o uporabi, in da če je cilj pošteno oblikovanje cen, je vezava stroškov na vidne znake in ne na skrite procese edina možnost, ki vzdrži nadzor. Oblikovanje cen na podlagi znakov bi po njihovem mnenju odpravilo motiv za napačno poročanje, hkrati pa bi nagradilo krajše in učinkovitejše rezultate.

Vendar pa je tukaj treba upoštevati številne dodatne dejavnike (ki jih avtorji v večini primerov priznavajo). Prvič, predlagana shema, ki temelji na znakih, uvaja dodatno poslovno logiko, ki lahko daje prednost prodajalcu pred potrošnikom:

„[Po]nudnik, ki nikoli ne poroča napačno, ima jasno spodbudo, da ustvari najkrajše možno zaporedje izhodnih žetonov in izboljša trenutne algoritme za žetonizacijo, kot je BPE, tako da čim bolj stisnejo zaporedje izhodnih žetonov.“

Optimističen motiv je, da se prodajalca tako spodbuja k ustvarjanju jedrnatih, bolj smiselnih in dragocenih rezultatov. V praksi pa očitno obstajajo manj učinkoviti načini, kako lahko ponudnik zmanjša število besedil.

Drugič, avtorji navajajo, da je smiselno domnevati, da bi podjetja verjetno potrebovala zakonodajo, da bi prešla z nejasnega sistema žetonov na jasnejšo metodo obračunavanja, ki temelji na besedilu. V prihodnosti se lahko uporniško zagonsko podjetje odloči, da bo svoj izdelek diferenciralo z lansiranjem s tovrstnim cenovnim modelom; toda vsak, ki ima resnično konkurenčen izdelek (in deluje v manjšem obsegu kot ...), ... Kategorija EEO) je odvrnjen od tega.

Končno bi imeli kradljivi algoritmi, kot jih predlagajo avtorji, svoje računske stroške; če bi stroški izračuna "doplačila" presegli potencialni dobiček, shema očitno ne bi imela nobene koristi. Vendar pa raziskovalci poudarjajo, da je njihov predlagani algoritem učinkovit in ekonomičen.

Avtorji podajajo kodo za svoje teorije na GitHub.

Switch

2. papirja – z naslovom Nevidni žetoni, vidni računi: nujna potreba po reviziji skritih operacij v nepreglednih storitvah LLM, raziskovalcev z Univerze v Marylandu in Berkeleyju – trdi, da neusklajene spodbude v API-jih komercialnih jezikovnih modelov niso omejene na delitev žetonov, temveč segajo na celi razredi skritih operacij.

To vključuje interne klice modelov, špekulativno sklepanje, uporabo orodij in interakcije med več agenti – vse to se lahko uporabniku zaračuna brez vidnosti ali možnosti pritožbe.

Cenovna politika in preglednost API-jev za sklepanje LLM pri glavnih ponudnikih. Vse navedene storitve uporabnikom zaračunavajo skrite notranje žetone sklepanja, nobena pa teh žetonov ne naredi vidnih med izvajanjem. Stroški se precej razlikujejo, pri čemer model OpenAI o1-pro zaračuna desetkrat več na milijon žetonov kot Claude Opus 4 ali Gemini 2.5 Pro, kljub enaki nepreglednosti. Vir: https://www.arxiv.org/pdf/2505.18471

Za razliko od običajnega obračunavanja, kjer je količina in kakovost storitev preverljiva, avtorji trdijo, da današnje platforme LLM delujejo pod strukturna motnost: uporabnikom se zaračunava na podlagi prijavljene uporabe žetonov in API-ja, vendar nimajo načina, da bi potrdili, da te metrike odražajo dejansko ali potrebno delo.

Članek opredeljuje dve ključni obliki manipulacije: količinska inflacija, kjer se število žetonov ali klicev poveča brez koristi za uporabnika; in znižanje kakovosti, kjer se namesto vrhunskih komponent tiho uporabljajo manj zmogljivi modeli ali orodja:

V API-jih za sklepanje LLM ponudniki pogosto vzdržujejo več različic iste družine modelov, ki se razlikujejo po zmogljivosti, učnih podatkih ali strategiji optimizacije (npr. ChatGPT o1, o3). Znižanje kakovosti modela se nanaša na tiho zamenjavo cenejših modelov, kar lahko povzroči neusklajenost med pričakovano in dejansko kakovostjo storitve.

„Na primer, poziv lahko obdela manjši model, medtem ko obračunavanje ostane nespremenjeno. To prakso uporabniki težko zaznajo, saj se končni odgovor za številne naloge še vedno zdi verjeten.“

V članku so dokumentirani primeri, ko več kot devetdeset odstotkov zaračunanih žetonov ni bilo nikoli prikazanih uporabnikom, pri čemer je notranje sklepanje povečalo uporabo žetonov za faktor več kot dvajset. Ne glede na to, ali so ti koraki upravičeni ali ne, nepreglednost teh korakov uporabnikom odvzema kakršno koli podlago za oceno njihove ustreznosti ali legitimnosti.

V agentnih sistemih se neprozornost poveča, saj lahko notranje izmenjave med agenti umetne inteligence povzročijo stroške, ne da bi to bistveno vplivalo na končni rezultat:

Poleg notranjega sklepanja agenti komunicirajo z izmenjavo pozivov, povzetkov in navodil za načrtovanje. Vsak agent interpretira vhodne podatke drugih in ustvarja izhodne podatke za vodenje poteka dela. Ta sporočila med agenti lahko porabijo precejšnje količine žetonov, ki končnim uporabnikom pogosto niso neposredno vidni.

»Vsi žetoni, porabljeni med koordinacijo agentov, vključno z ustvarjenimi pozivi, odgovori in navodili, povezanimi z orodji, običajno niso prikazani uporabniku. Ko agenti sami uporabljajo modele sklepanja, postane obračunavanje še bolj nepregledno.«

Za reševanje teh težav avtorji predlagajo večplastni okvir za revizijo, ki vključuje kriptografske dokaze o notranji dejavnosti, preverljive označevalce identitete modela ali orodja in neodvisen nadzor. Osnovna skrb pa je strukturna: trenutne sheme obračunavanja LLM so odvisne od trajnega asimetrija informacij, zaradi česar so uporabniki izpostavljeni stroškom, ki jih ne morejo preveriti ali razčleniti.

Štetje nevidnega

Končni članek raziskovalcev z Univerze v Marylandu preoblikuje problem obračunavanja ne kot vprašanje zlorabe ali napačnega poročanja, temveč kot vprašanje strukture. papirja – z naslovom CoIn: Štetje nevidnih žetonov sklepanja v komercialnih neprozornih LLM API-jihin od desetih raziskovalcev na Univerzi v Marylandu – ugotavlja, da večina komercialnih storitev LLM zdaj skriva vmesno sklepanje kar prispeva h končnemu odgovoru modela, vendar še vedno zaračunavajo za te žetone.

V članku se trdi, da to ustvarja neopazno površino za obračunavanje, kjer je mogoče celotne sekvence izdelati, vbrizgati ali napihniti brez zaznavanja*:

„[Ta] nevidnost ponudnikom omogoča, da napačno poročano število žetonov or vbrizgavanje poceni, izmišljenih žetonov za sklepanje, da bi umetno napihnili število žetonovTo prakso imenujemo inflacija števila žetonov.

Na primer, en sam visoko učinkovit ARC-AGI, ki ga je vodil model o3 podjetja OpenAI, je porabil 111 milijonov žetonov, stroškov 66,772.3 $ Glede na ta obseg lahko že majhne manipulacije povzročijo znaten finančni vpliv.

„Takšna informacijska asimetrija omogoča podjetjem za umetno inteligenco, da uporabnikom znatno previsoko zaračunavajo cene in s tem spodkopavajo njihove interese.“

Da bi preprečili to asimetrijo, avtorji predlagajo Coin, sistem za revizijo tretje osebe, zasnovan za preverjanje skritih žetonov brez razkritja njihove vsebine, ki uporablja zgoščene prstne odtise in semantične preglede za odkrivanje znakov inflacije.

Pregled sistema za revizijo CoIn za neprozorne komercialne LLM-je. Panel A prikazuje, kako se vdelave žetonov sklepanja zgostijo v Merklejevo drevo za preverjanje števila žetonov brez razkritja vsebine žetonov. Panel B prikazuje preverjanja semantske veljavnosti, kjer lahke nevronske mreže primerjajo bloke sklepanja s končnim odgovorom. Te komponente skupaj omogočajo revizorjem tretjih oseb, da odkrijejo skrito inflacijo žetonov, hkrati pa ohranijo zaupnost vedenja lastniškega modela.. Vir: https://arxiv.org/pdf/2505.13778

Ena komponenta kriptografsko preverja število žetonov z uporabo Merkle drevo; drugi pa oceni ustreznost skrite vsebine tako, da jo primerja z vdelavo odgovora. To revizorjem omogoča, da zaznajo odlaganje ali nepomembnost – znake, da se žetoni vstavljajo zgolj zato, da se račun zviša.

Ko je bil CoIn uporabljen v testih, je dosegel skoraj 95-odstotno stopnjo uspešnosti zaznavanja nekaterih oblik inflacije, z minimalnim razkritjem osnovnih podatkov. Čeprav je sistem še vedno odvisen od prostovoljnega sodelovanja ponudnikov in ima omejeno ločljivost v skrajnih primerih, je njegov širši namen nedvoumen: sama arhitektura trenutnega obračunavanja LLM predpostavlja poštenost, ki je ni mogoče preveriti.

zaključek

Poleg prednosti pridobivanja predplačil od uporabnikov, skriptavaluta, ki temelji na CivitAI) pomaga odvrniti uporabnike od resnične vrednosti valute, ki jo porabljajo, ali blaga, ki ga kupujejo. Prav tako daje prodajalcu manevrski prostor, da opredeli svoje lastne merske enote potrošnika še dodatno pušča v temi glede tega, koliko dejansko porabi v smislu resničnega denarja.

Všeč mi je Pomanjkanje ur v Las VegasuTovrstni ukrepi so pogosto namenjeni temu, da bi potrošnika naredili nepremišljenega ali ravnodušnega do stroškov.

Komaj razumljeno žeton, ki ga je mogoče zaužiti in definirati na toliko načinov, morda ni primerna merska enota za porabo LLM – predvsem zato, ker lahko stanejo velikokrat več žetonov izračunati slabši rezultat LLM v neangleškem jeziku v primerjavi s sejo, ki temelji na angleščini.

Vendar pa bi izpis, ki temelji na znakih, kot so predlagali raziskovalci Maxa Plancka, verjetno dajal prednost bolj jedrnatim jezikom in kaznoval naravno besedni jezikiKer bi nas vizualni indikatorji, kot je števec žetonov, ki zmanjšuje vrednost, verjetno naredili nekoliko bolj zapravljive na naših sejah LLM, se zdi malo verjetno, da bodo takšni uporabni dodatki grafičnega vmesnika kmalu na voljo – vsaj brez zakonodajnih ukrepov.

* Avtorjevi poudarki. Moja pretvorba avtorjevih vrstičnih citatov v hiperpovezave.

Prvič objavljeno v četrtek, 29. maja 2025