Kiberbiztonság

Miért nem vicc az ellenséges képi támadás?

A képfelismerő rendszerek gondosan kidolgozott, ellenséges képekkel való megtámadása mulatságos, de triviális elméleti bizonyítéknak számított az elmúlt öt évben. Az új ausztrál kutatás azonban azt sugallja, hogy a rendkívül népszerű képadatkészletek véletlenszerű használata kereskedelmi mesterségesintelligencia-projektekben tartós, új biztonsági problémát okozhat.

Néhány éve az Adelaide-i Egyetem akadémikusainak egy csoportja valami igazán fontosat próbál elmagyarázni az AI-alapú képfelismerő rendszerek jövőjével kapcsolatban.

Ez olyan dolog, amit nehéz (és nagyon drága) lenne megjavítani most, és amelyek orvoslása lelkiismeretetlenül költséges lenne, ha a képfelismerési kutatás jelenlegi trendjeit 5-10 éven belül teljesen kereskedelmi és iparosított alkalmazásokká fejlesztették.

Mielőtt belevágnánk, vessünk egy pillantást egy virágra, amelyet Barack Obama elnöknek minősítenek annak a hat videónak az egyikéből, amelyet a csapat közzétett a projekt oldal:

Forrás: https://www.youtube.com/watch?v=Klepca1Ny3c

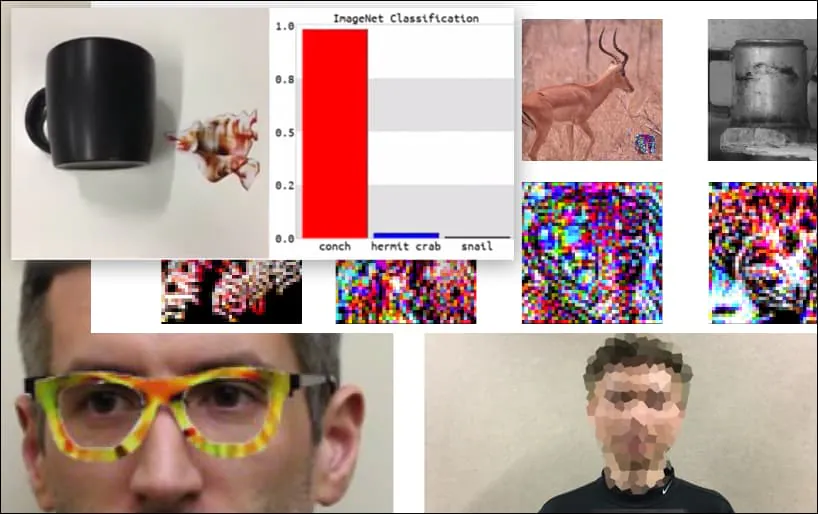

A fenti képen egy olyan arcfelismerő rendszert, amely egyértelműen tudja, hogyan kell felismerni Barack Obamát, 80%-os bizonyossággal becsapják, hogy egy névtelen férfi, aki egy virágot ábrázoló, kidolgozott, nyomtatott ellenségképet tart, egyben Barack Obama is. A rendszert nem is érdekli, hogy a „hamis arc” az alany mellkasán van, nem pedig a vállán.

Bár lenyűgöző, hogy a kutatóknak sikerült elérniük ezt a fajta személyazonosság-rögzítést úgy, hogy a szokásos véletlenszerű zaj helyett koherens képet (egy virágot) generáltak, úgy tűnik, hogy az ehhez hasonló ostoba kizsákmányolások meglehetősen rendszeresen előfordulnak a számítógépes látással kapcsolatos biztonsági kutatásokban. . Például azok a furcsán mintázott szemüvegek, amelyek képesek voltak megtéveszteni az arcfelismerést vissza 2016, vagy speciálisan kialakított ellenséges képek, amelyek próbálja átírni az útjelző táblákat.

Ha érdekli, a fenti példában támadott konvolúciós neurális hálózat (CNN) modell a VGGFace (VGG-16), a Columbia Egyetem PubFig adatkészletén képezték ki. A kutatók által kifejlesztett egyéb támadásminták különböző erőforrásokat használtak különböző kombinációkban.

Az ImageNet WideResNet50 modelljében a billentyűzetet kagylónak minősítették. A kutatók azt is biztosították, hogy a modellben ne legyen torzítás a kagylókkal szemben. Tekintse meg a teljes videót a kiterjesztett és további bemutatókért: https://www.youtube.com/watch?v=dhTTjjrxIcU

Képfelismerés, mint kialakuló támadási vektor

A kutatók által felvázolt és bemutatott számos lenyűgöző támadás nem az egyes adatkészletek vagy az azokat használó gépi tanulási architektúrák kritikája. Ellenük sem lehet könnyen védekezni adathalmazok vagy modellek váltásával, modellek átképzésével vagy bármely más „egyszerű” megoldással, amelyek miatt az ML-gyakorlók gúnyolódni kezdenek az ilyen trükkök szórványos bemutatásain.

Inkább az adelaide-i csapat tettei példázzák a központi gyengeség a képfelismerő mesterséges intelligencia fejlesztésének teljes jelenlegi architektúrájában; Ez egy olyan gyengeség, amely számos jövőbeli képfelismerő rendszert kitehet a támadók általi manipulációnak, és a későbbi védekezési intézkedéseket a hátsó lábra helyezheti.

Képzelje el, hogy a legújabb ellenséges támadási képeket (például a fenti virágot) „nulladik napi kizsákmányolásként” adják hozzá a jövő biztonsági rendszereihez, ahogyan a jelenlegi rosszindulatú programok elleni és víruskereső keretrendszerek is nap mint nap frissítik a vírusdefiníciókat.

Az új ellenséges képi támadások lehetősége kimeríthetetlen lenne, mert a rendszer alaparchitektúrája nem számított a későbbi problémákra az internettel, a Milleniumi poloska és a Pisa-i ferde torony.

Milyen módon alakítjuk ki ennek hátterét?

Adatok beszerzése támadáshoz

Az ellenséges képek, mint például a fenti „virág” példa, úgy jönnek létre, hogy hozzáférnek a számítógépes modelleket betanító képadatkészletekhez. Nincs szüksége „kiváltságos” hozzáférésre a betanítási adatokhoz (vagy modellarchitektúrákhoz), mivel a legnépszerűbb adatkészletek (és sok betanított modell) széles körben elérhetők egy robusztus és folyamatosan frissülő torrent-szcénában.

Például a Computer Vision adatkészletek tiszteletreméltó Góliátja, az ImageNet az elérhető a Torrent számára minden iterációjában, megkerülve a megszokottat korlátozások, és elérhetővé teszi a kulcsfontosságú másodlagos elemeket, mint pl érvényesítési készletek.

Forrás: https://academictorrents.com

Ha rendelkezik az adatokkal, akkor (amint azt az adelaide-i kutatók megfigyelik) hatékonyan "visszafejtheti" bármely népszerű adatkészletet, mint pl. CityScapesvagy CIFAR.

A PubFig esetében, amely a korábbi példában lehetővé tette az „Obama virágot” a Columbia Egyetem a képadatkészlet újraelosztásával kapcsolatos szerzői jogi problémák növekvő tendenciájára utasította a kutatókat, hogyan reprodukálni az adatkészletet kurált hivatkozásokon keresztül, ahelyett, hogy az összeállítást közvetlenül elérhetővé tennék, megfigyelnék "Úgy tűnik, hogy más nagy web-alapú adatbázisok így fejlődnek".

A legtöbb esetben ez nem szükséges: Kaggle becslések hogy a számítógépes látás tíz legnépszerűbb képadatkészlete: CIFAR-10 és CIFAR-100 (mindkettő közvetlenül letölthető); CALTECH-101 és 256 (mindkettő elérhető, és mindkettő jelenleg elérhető torrentként); MNIST (hivatalosan elérhető, torrenteken is); ImageNet (lásd fent); Pascal VOC (elérhető, torrenteken is); MS COCO (elérhető, és torrenteken); Sport-1M (elérhető); és a YouTube-8M (elérhető).

Ez a rendelkezésre állás a rendelkezésre álló számítógépes látáskép-adatkészletek szélesebb körére is jellemző, mivel a „közzététel vagy elpusztulás” nyílt forráskódú fejlesztési kultúrában a homály a halál.

Mindenesetre a szűkössége kezelhető új adatkészletek, a képkészlet-fejlesztés magas költsége, a „régi kedvencekre” való támaszkodás és a egyszerűen adaptálja a régebbi adatkészleteket mindez súlyosbítja az új Adelaide-i lapban felvázolt problémát.

Tipikus kritikák az ellenséges képzettámadási módszerekről

A gépi tanulással foglalkozó mérnökök leggyakrabban és legkitartóbb kritikája a legújabb ellenséges képi támadási technika hatékonyságával szemben az, hogy a támadás egy adott adatkészletre, modellre vagy mindkettőre jellemző; hogy nem „általánosítható” más rendszerekre; következésképpen csak triviális fenyegetést jelent.

A második leggyakoribb panasz az, hogy az ellenséges képi támadás az 'fehér doboz', ami azt jelenti, hogy közvetlen hozzáférésre van szüksége a képzési környezethez vagy adatokhoz. Ez a legtöbb esetben valóban valószínűtlen forgatókönyv – például ha az arcfelismerő rendszer képzési folyamatát szeretné kihasználni a londoni fővárosi rendőrségtől, be kell törnie magát NEC, akár konzollal, akár baltával.

A népszerű számítógépes képi adatkészletek hosszú távú „DNS-e”.

Ami az első kritikát illeti, nem csak azt kell figyelembe vennünk, hogy a számítógépes látási adatkészletek csupán maroknyi uralja ágazatonként évről évre (pl. ImageNet többféle objektumhoz, CityScapes a vezetési jelenetekhez, és FFHQ arcfelismeréshez); hanem azt is, hogy egyszerű megjegyzésekkel ellátott képadatokként „platformagnosztikusak” és nagymértékben átvihetők.

Lehetőségeitől függően bármely számítógépes látást tanító architektúra megtalálja néhány objektumok és osztályok jellemzői az ImageNet adatkészletben. Egyes architektúrák több szolgáltatást találhatnak, mint mások, vagy hasznosabb kapcsolatokat hozhatnak létre, mint mások, de minden meg kell találnia legalább a legmagasabb szintű funkciókat:

Ezek a „magas szintű” jellemzők különböztetik meg és „ujjlenyomat” egy adatkészletet, és amelyek megbízható „horgok”, amelyekre akaszthatunk egy hosszú távú ellenséges képi támadási módszert, amely áthatol a különböző rendszereken, és együtt fejlődik a „ régi adatkészletet, mivel az utóbbit az új kutatások és termékek állandósítják.

A kifinomultabb architektúra pontosabb és részletesebb azonosításokat, jellemzőket és osztályokat eredményez:

Azonban minél inkább ezekre támaszkodik egy ellenséges támadásgenerátor alacsonyabb funkciókat (pl. „Fiatal kaukázusi férfi” az „arc” helyett), annál kevésbé lesz hatékony a cross-over vagy későbbi architektúrákban, amelyek különböző verziók az eredeti adatkészletből – például egy részhalmaz vagy szűrt halmaz, ahol a teljes adatkészletből sok eredeti kép nem található meg:

Ellenkező támadások a nullázott, előre kiképzett modellek ellen

Mi a helyzet azokkal az esetekkel, amikor egyszerűen letölt egy előre betanított modellt, amelyet eredetileg egy nagyon népszerű adatkészletre tanítottak, és teljesen új adatokat adnak meg neki?

A modellt már betanították (például) az ImageNetre, és már csak az van hátra súlyok, amelyek betanítása hetekig vagy hónapokig tarthat, és most készen állnak arra, hogy segítsenek azonosítani az eredeti (most hiányzó) adatokhoz hasonló objektumokat.

Miután az eredeti adatokat eltávolították a betanítási architektúrából, a modellnek az a „hajlamossága” maradt, hogy az objektumokat úgy osztályozza, ahogyan azt eredetileg megtanulta, ami lényegében az eredeti „aláírások” többségének megreformálását és sebezhetőségét eredményezi. ismét ugyanazokhoz a régi Adversarial Image Attack módszerekhez.

Ezek a súlyok értékesek. Adatok nélkül or a súlyok, akkor lényegében üres architektúrája van adatok nélkül. A nulláról kell betanítania, óriási idő- és számítási erőforrások ráfordításával, ahogy az eredeti szerzők is tették (valószínűleg erősebb hardveren és magasabb költségvetéssel, mint amennyi rendelkezésre áll).

Az a baj, hogy a súlyok már elég jól formáltak és rugalmasak. Bár a képzés során némileg alkalmazkodni fognak, ugyanúgy fognak viselkedni az új adatokon, mint az eredeti adatokon, olyan aláírási funkciókat hozva létre, amelyeket egy ellenséges támadórendszer vissza tud használni.

Hosszú távon ez is megőrzi a számítógépes látás adatkészleteinek „DNS-ét”. tizenkét vagy több éves, és jelentős fejlődésen ment keresztül a nyílt forráskódú erőfeszítésektől a kereskedelmi forgalomba hozott telepítésekig – még akkor is, ha az eredeti képzési adatokat a projekt kezdetén teljesen kihagyták. Előfordulhat, hogy néhány ilyen kereskedelmi telepítés még évekig nem történik meg.

Nincs szükség fehér dobozra

Az ellenséges képi támadórendszerekkel szembeni második gyakori kritikát illetően az új tanulmány szerzői úgy találták, hogy az a képességük, hogy virágképekkel megtévesztik a felismerő rendszereket, számos architektúrán átvihető.

Miközben megfigyelték, hogy „Universal NaTuralistic adversarial Patches” (TnT) módszerük az első, amely felismerhető képeket használ (a véletlenszerű perturbációs zaj helyett) a képfelismerő rendszerek megtévesztésére, a szerzők azt is kijelentik:

„A [TnT-k] hatékonyak számos korszerű osztályozóval szemben, a széles körben használttól kezdve WideResNet50 a Nagyléptékű vizuális felismerés feladatában ImageNet adatkészlet VGG-arcmodellekhez az arcfelismerési feladatban PubFig adatkészlet mindkettőben célzott és a céltalan támadásokat.

„A TnT-k rendelkezhetnek: i) a trójai támadási módszerekben használt triggerekkel elérhető naturalizmussal; és ii) általánosítása és átruházhatósága kontradiktórius példák más hálózatokhoz.

"Ez biztonsági és biztonsági aggályokat vet fel a már telepített DNN-ekkel, valamint a jövőbeni DNN-telepítésekkel kapcsolatban, ahol a támadók feltűnő, természetesnek tűnő objektumfoltok segítségével félrevezethetik a neurális hálózati rendszereket anélkül, hogy megváltoztatnák a modellt és kockáztatnák a felfedezést."

A szerzők azt javasolják, hogy a hagyományos ellenintézkedések, mint például a Clean Acc. egy hálózat, elméletileg védelmet nyújthatna a TnT javítások ellen, de ez „A TnT-k továbbra is sikeresen megkerülhetik ezt a SOTA-val bizonyított védekezési módszert, miközben a legtöbb védelmi rendszer 0%-os robusztusságot ér el”.

A lehetséges egyéb megoldások közé tartozik egyesített tanulás, ahol védve van a közreműködő képek eredete, és olyan új megközelítések, amelyek közvetlenül „titkosíthatják” az adatokat edzés közben, mint pl. nemrégiben javasolt a Nanjing Repülési és Asztronautikai Egyetem által.

Még ezekben az esetekben is fontos lenne valóban tovább edzeni új képadatok – mára a legnépszerűbb önéletrajz-adatkészletek kis körében a képek és a kapcsolódó megjegyzések annyira beágyazódnak a fejlesztési ciklusokba világszerte, hogy jobban hasonlítanak a szoftverre, mint az adatokra; szoftver, amelyet gyakran évek óta nem frissítettek.

Következtetés

Az ellenséges képi támadásokat nem csak a nyílt forráskódú gépi tanulási gyakorlatok teszik lehetővé, hanem a vállalati mesterséges intelligencia fejlesztési kultúra is, amely több okból is ösztönzi a jól bevált számítógépes képi adatkészletek újrafelhasználását: ezek már beváltak; sokkal olcsóbbak, mint „a nulláról kezdeni”; és az akadémiai és iparági élenjáró elmék és szervezetek karbantartják és frissítik őket olyan finanszírozási és személyzeti szinten, amelyet egyetlen vállalat számára nehéz lenne megismételni.

Ezenkívül sok esetben, amikor az adatok nem eredetiek (ellentétben a CityScapes-szel), a képeket az adatvédelmi és adatgyűjtési gyakorlatok körüli közelmúltbeli viták előtt gyűjtötték össze, így ezek a régebbi adatkészletek egyfajta féllegális purgatórium amely egy vállalat szemszögéből megnyugtatóan „biztonságos kikötőnek” tűnhet.

TnT támadások! Univerzális naturalisztikus ellenséges foltok a mély neurális hálózati rendszerek ellen társszerzői Bao Gia Doan, Minhui Xue, Ehsan Abbasnejad, Damith C. Ranasinghe az Adelaide-i Egyetemről, valamint Shiqing Ma, a Rutgers Egyetem Számítástechnikai Tanszékéről.

Frissítve: 1. december 2021., 7:06 GMT+2 – elírás javítva.