בינה מלאכותית

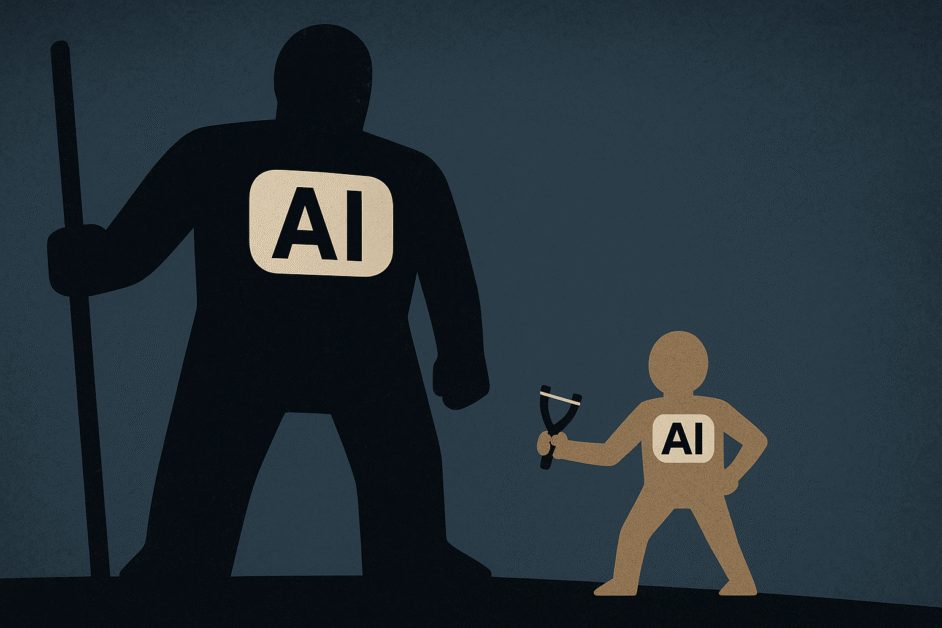

המרד של המודלים הקטנים: למה AI זעיר משיג תוצאות טובות יותר מאשר מודלי שפה ענקיים

בשנים האחרונות, הבינה המלאכותית עוצבה על ידי המרוץ לבנות מודלים גדולים יותר ויותר. כל שחרור חדש נמדד על פי מספר הפרמטרים, גודל נתוני האימון והיקף התשתית שמאחוריה. הונח, שגדול יותר הוא טוב יותר. בעוד ענקיות הטכנולוגיה ממשיכות לבנות מודלי שפה ענקיים עם מאות מיליארדי פרמטרים, מהפכה שקטה מתרחשת. מודלי AI קטנים, לעיתים קרובות קטנים פי אלפים מהגיאנטים, משיגים ביצועים דומים ולעיתים אף עדיפים במשימות ספציפיות. שינוי זה מאתגר הכל מה שחשבנו שידענו על סקאלינג של AI ופותח אפשרויות חדשות לבינה מלאכותית יעילה ודמוקרטית.

סיפורו של דוד וגוליית ב-AI המודרני

במשך שנים, תעשיית ה-AI פעלה תחת ההנחה שמודלים גדולים יותר מספקים ביצועים טובים יותר. סדרת GPT של OpenAI גדלה מ-117 מיליון פרמטרים למעלה מ-175 מיליארד. PaLM של Google הגיע ל-540 מיליארד פרמטרים. חברות טכנולוגיה גדולות השקיעו מיליארדים באימון מודלים אלו והשקיעו עוד כדי לבנות מודלים גדולים עוד יותר. במצב זה, כאשר מספר הפרמטרים הפך לגורם מפתח לקביעת יכולת המודל ובניית יכולת AI הפכה למרוץ של משאבים חישוביים והוצאות תשתית, תופעה מעניינת החלה להתרחש במעבדות מחקר ברחבי העולם.

מהנדסים החלו לגלות כי מודלים קטנים, שתוכננו בקפידה, יכולים להתמודד עם הגיאנטים במשימות ספציפיות. Microsoft’s Phi הוכיח כי מודל בן 2.7 מיליארד פרמטרים יכול להתחרות במודלים שגודלם עשרה פעמים גדול יותר. Meta’s LLaMA הוכיח כי מודלים בני 7 מיליארד פרמטרים יכולים לספק תוצאות יוצאות מן הכלל כאשר מאומנים כראוי. פיתוחים אלו מייצגים מהפך יסודי בהבנתנו את יעילות ה-AI.

מהפכה זו היא בעלת משמעות משמעותית על האופן בו AI משמש ומופעל. מודלים קטנים יכולים לרוץ על חומרה צרכנית, לעבד בקשות מהר יותר ולצרוך חלק קטן מהאנרגיה הנדרשת על ידי מודלים גדולים. הם הופכים את AI לנגיש לארגונים שאינם יכולים להרשות לעצמם תשתית חישובית מסיבית. העיקר, הם אתגרים את הנטיות המונופוליסטיות של פיתוח AI, שבהן רק חברות עם משאבים עצומים יכולות להתחרות.

עלייתה של ארכיטקטורת AI יעילה

המהפכה של המודלים הקטנים בנויה על גישות הנדסיות מתוחכמות שמקסימום את הביצועים בתוך תקציבי פרמטרים מוגבלים. מודלים אלו מנצלים טכניקות מתקדמות כגון דיסטילציה של ידע, שבה מודלים “סטודנט” קטנים יותר לומדים ממודלים “מורה” גדולים יותר, תוך לכידה של ידע חיוני בעודם מקטינים באופן דרמטי את הדרישות החישוביות.

סדרת Phi-4 של Microsoft ממחישה גישה זו. מודל Phi-4 reasoning עם רק 14 מיליארד פרמטרים, מתחרה במודלים חמישה פעמים גדולים יותר בנימוקים מתמטיים ופתרון בעיות לוגיות. באופן דומה, Gemma 3 270M של Google מדגים כי מודל קומפקטי בן 270 מיליון פרמטרים יכול לספק יכולות חזקות של עקיבה אחר הוראות ולשמש בסיס מצוין לקליבור.

Meta’s Llama 3.2 1B הוא עוד פריצת דרך ביעילות של מודלים קטנים. דרך גזירה מובנית ודיסטילציה של ידע ממודלים Llama גדולים יותר, הוא שומר על ביצועים מרשימים בעודו פועל בצורה יעילה על פני הקצוות. מודלים אלו מוכיחים כי חדשנות ארכיטקטונית ומתודולוגיה של אימון חשובים יותר מאשר מספר הפרמטרים עבור יישומים רבים בעולם האמיתי.

Mixture of experts היא פריצת דרך משמעותית בתכנון AI יעיל. במקום להשתמש בכל הפרמטרים לכל משימה, מודלים אלו מפעילים רק רכיבים מומחים רלוונטיים. הם מנתבים שאילתות שונות לרשתות תת-מומחים, תוך שמירה על יכולת רחבה בעודם משתמשים בפרמטרים פעילים פחותים בכל רגע נתון. Mixtral 8x7B של Mistral AI מדגים את הגישה הזו בצורה יעילה. על אף שיש לו 47 מיליארד פרמטרים סה”כ, הוא מפעיל רק 13 מיליארד פרמטרים לכל שאילתה, ומשיג ביצועים דומים למודלים גדולים יותר בעודו שומר על מהירות אינפרנס מהירה יותר.

טכניקות קוונטיזציה השפיעו גם הן באופן משמעותי על שיפור יעילות של מודלים קטנים. על ידי ייצוג משקלי המודל במספר ביטים פחות, חוקרים יכולים לצמצם את גודל המודלים בעודם שומרים על דיוק. שיטות קוונטיזציה מודרניות יכולות להקטין את גודל המודל ב-75 אחוז עם אובדן ביצועים מינימלי. Microsoft’s Phi-3-mini הדגימו את היעילות של גישה זו. כאשר מקואנטיזם לדיוק של 4 ביט, הוא שומר על למעלה מ-95 אחוז מהביצועים המקוריים בעודו מקטין את דרישות הזיכרון מ-7GB לפחות מ-2GB, מה שהופך אותו למעשי במיוחד לפריסה ניידת.

התמחות מנצחת את הכלליות

המהפכה של המודלים הקטנים חשפה אמת חשובה על פריסת AI. רוב היישומים בעולם האמיתי אינם זקוקים למודל שיכול לכתוב שירה, לפתור חשבון אינטגרלי או לדון בפילוסופיה. הם זקוקים למודלים שמצטיינים במשימות ספציפיות. בוט צ’אט לשירות לקוחות אינו זקוק לידע על שייקספיר. כלי להשלמת קוד אינו זקוק לידע רפואי. הבנה זו הסטה את המוקד מבניית מודלים אוניברסליים ליצירת מודלים מומחים.

אימון ספציפי לתחום מאפשר למודלים הקטנים לרכז את היכולת המוגבלת שלהם על ידע רלוונטי. מודל בן 3 מיליארד פרמטרים שאומן אך ורק על מסמכים משפטיים יכול להתגבר על מודל כללי בן 70 מיליארד פרמטרים במשימות משפטיות. המודל המומחה לומד תבניות עמוקות יותר בתוך תחומו ולא מפזר את היכולת על נושאים רבים שאינם קשורים. זה כמו השוואה בין רופא מומחה לרופא כללי להליכים מורכבים.

אסטרטגיות של עדכון דק הפכו למתוחכמות יותר. במקום לאמן מודלים מאפס, מפתחים מתחילים עם מודלים בסיסיים קטנים ומותאמים אותם לצורכים ספציפיים. גישה זו דורשת משאבים חישוביים מינימליים בעודה מייצרת מודלים מומחים מאוד. ארגונים יכולים עכשיו ליצור פתרונות AI מותאמים אישית ללא השקעות תשתית מסיביות.

שבירת תקרת הביצועים

בדיקות ביצועים אחרונות חושפות יתרונות ביצועים מפתיעים עבור מודלים קטנים בתחומים ספציפיים. AI2’s Olmo 2 1B מקבע את הישגים טובים יותר ממודלים בגודל דומה מחברות טכנולוגיה גדולות במשימות הבנת שפה טבעית. Microsoft’s Phi-4-mini-flash-reasoning משיג עד 10 פעמים זרימה גבוהה יותר עם עיכוב נמוך פי 2-3 לעומת מודלים מסורתיים של נימוק, תוך שמירה על יכולות נימוק מתמטי.

הפער בביצועים הופך למרשים אף יותר כאשר בוחנים יישומים ספציפיים. מודלים קטנים שעובדו לתחומים מומחים משיגים באופן עקבי ביצועים טובים יותר מאשר מודלים כלליים גדולים בדיוק ורלוונטיות. יישומים בתחום הבריאות, ניתוח מסמכים משפטיים ויישומים של שירות לקוחות מראים תוצאות מרשימות במיוחד כאשר מודלים קטנים מאומנים על מערכי נתונים ספציפיים לתחום.

יתרון הביצועים הזה נובע מגישות אימון ממוקדות. במקום ללמוד ידע רחב אך רדוד ברחבי תחומים רבים, מודלים קטנים פיתחו מומחיות עמוקה בתחומים מוגדרים. התוצאה היא תגובות אמינות ומתאימות להקשר יותר עבור מקרים שימוש ספציפיים.

יתרון המהירות והיעילות

הביצועים אינם רק על דיוק. הם גם על מהירות, עלות והשפעה סביבתית. מודלים קטנים מצטיינים בכל הממדים האלו. מודל קטן יכול לייצר תגובות במילישניות, בעוד מודלים גדולים לוקחים שניות. הבדל המהירות הזה עשוי להיראות טריביאלי, אך הוא הופך לביקורתי ביישומים הדורשים אינטראקציה בזמן אמת או עיבוד מיליוני בקשות.

צריכת אנרגיה היא יתר פן קריטי. מודלים גדולים דורשים מרכזי נתונים עם מערכות קירור מתוחכמות. כל שאילתה צורכת כמות משמעותית של חשמל. מודלים קטנים יכולים לרוץ על שרתים סטנדרטיים או אפילו מחשבים אישיים, תוך שימוש בחלק קטן מהאנרגיה. ככל שארגונים נדרשים להפחית את טביעת הפחמן שלהם, יתרון הסביבתי של מודלים קטנים הופך לחשוב יותר.

פריסה בקצה (Edge deployment) היא אולי היכולת המשמעותית ביותר של מודלים קטנים. מודלים אלו יכולים לרוץ ישירות על טלפונים, מחשבים ניידים או התקנים IoT ללא חיבור לאינטרנט. תארו לעצמכם כלים אבחוניים רפואיים הפועלים באזורים מרוחקים ללא חיבור לאינטרנט, או התקני תרגום בזמן אמת שאינם זקוקים לחיבור לענן. מודלים קטנים הופכים תרחישים אלו לאפשריים, ומביאים יכולות AI למיליארדי התקנים ברחבי העולם.

דאגות לפרטיות גם הן מעדיפות את המודלים הקטנים. כאשר AI פועל מקומית על התקנים של המשתמש, נתונים רגישים אינם עוזבים את ההתקן. ספקי שירותי בריאות יכולים לנתח נתוני מטופלים ללא צורך להעלות אותם לשרתי ענן. מוסדות פיננסיים יכולים לעבד עסקאות ללא חשיפת מידע לקוחות למערכות חיצוניות. יכולת עיבוד מקומית זו פותרת אחד מהחששות העיקריים בנוגע לאימוץ AI בתחומים רגישים.

התוצאה הסופית

עלייתם של מודלי AI הקטנים אותגרת את האמונה שמודלים גדולים תמיד מספקים ביצועים טובים יותר. מודלים קומפקטיים עם פחות פרמטרים כעת משיגים תוצאות דומות או אפילו עדיפות במשימות מסוימות, באמצעות טכניקות כגון דיסטילציה של ידע, קוונטיזציה והתמחות. שינוי זה הופך את AI לנגיש יותר, מהיר יותר ויעיל יותר בשימוש על התקנים רגילים. הוא גם מקטין עלויות, מוריד את ההשפעה הסביבתית ומשפר את הפרטיות, על ידי אפשרות פריסה מקומית. בכך, AI הופך ליותר מעשי, נגיש ושימושי עבור ארגונים ויחידים כאחד.