בינה מלאכותית

יצירת ניסוח מחדש באמצעות למידת חיזוק עמוקה – מנהיגי מחשבה

כאשר אנו כותבים או מדברים, כולנו שאלנו לעצמנו אם יש דרך טובה יותר לתקשר רעיון לאחרים. מילים מהן אני צריך להשתמש? איך אני צריך לבנות את המחשבה? איך הם באופן סביר יגיבו? ב Phrasee, אנו מבלים הרבה זמן בחשיבה על שפה – מה עובד ומה לא.

תדמיין שאתה כותב את הנושא של קמפיין דוא”ל שילך ל-10 מיליון אנשים ברשימתך, ומקדם 20% הנחה על מחשב נייד חדש.

איזו שורה היית בוחר?

- אתה יכול עכשיו לקבל עוד 20% הנחה על ההזמנה הבאה שלך

- היכון – עוד 20% הנחה

בעוד שהם מעבירים את אותה מידע, אחד השיג קצב פתיחה גבוה בכ-15% מהאחר (ואני הימרתי שאתה לא יכול לנצח את המודל שלנו בניבוי מי מהם ?). בעוד ששפה יכולה לעיתים קרובות להיבדק דרך A/B testing או multi-armed bandits, יצירת ניסוח מחדש באופן אוטומטי נותרה בעיה מחקרית מאתגרת.

שתי משפטים נחשבים לניסוח מחדש זה של זה אם הם חולקים את אותה משמעות ויכולים לשמש באופן הדדי. עוד דבר חשוב שלרוב לוקחים כמובן מאליו הוא האם משפט שנוצר על ידי מכונה הוא שוטף.

בניגוד ללמידה מפוקחת, סוכנים של למידת חיזוק (RL) לומדים דרך אינטראקציה עם סביבתם ותצפית על התגמולים שהם מקבלים כתוצאה. הבדל זה, שהוא מעט עדין, הוא בעל השלכות עצומות על איך האלגוריתמים עובדים ואיך המודלים מאומנים. למידת חיזוק עמוקה משתמשת ברשתות נוירונים כמעריכים של פונקציה כדי לאפשר לסוכן ללמוד איך להתגבר על בני אדם בסביבות מורכבות כגון Go, Atari, ו- StarCraft II.

למרות ההצלחה הזו, למידת חיזוק לא הוחלה באופן נרחב על בעיות עולם אמיתי, כולל עיבוד שפה טבעית (NLP).

כחלק מ התזה שלי לתואר מוסמך במדעי הנתונים, אנו הוכיחו כיצד למידת חיזוק עמוקה יכולה לשמש להתגבר על שיטות למידה מפוקחות ביצירת ניסוח מחדש אוטומטי של טקסט קלט. בעיה של יצירת הניסוח הטוב ביותר יכולה להיראות כמציאת סדרת המילים שמקסימלית את הדמיון הסמנטי בין משפטים בעודה משמרת שוטפות בפלט. סוכני RL מתאימים היטב למציאת הקבוצה הטובה ביותר של פעולות כדי להשיג את התגמול הצפוי המרבי בסביבות בקרה.

בניגוד לרוב הבעיות בלמידת מכונה, הבעיה הגדולה ביותר ביישומים רבים של יצירת שפה טבעית (NLG) אינה נמצאת במודל, אלא בהערכה. בעוד שהערכה אנושית נחשבת כיום לסטנדרט הזהב בהערכת NLG, היא סובלת מחסרונות משמעותיים, כולל היותה יקרה, צורכת זמן, קשה לכיול, וחוסר רפרודוקציה ברחבי ניסויים ומאגרי נתונים (Han, 2016). כתוצאה מכך, חוקרים חיפשו זמן רב אחר מדדים אוטומטיים שהם פשוטים, ניתנים לכיול, ומשקפים את שיפוטו של האדם (Papineni et al., 2002).

שיטות הערכה האוטומטיות הנפוצות ביותר בהערכת כותרות תמונות שנוצרו על ידי מכונה מוצגות להלן, עם היתרונות והחסרונות שלהן:

יצירת ניסוח מחדש באמצעות למידת חיזוק עמוקה

פיתחנו מערכת בשם ParaPhrasee שיוצרת ניסוחים מחדש באיכות גבוהה. המערכת כוללת מספר שלבים כדי ליישם למידת חיזוק באופן יעיל מבחינה חישובית. סיכום קצר של הצינור הראשי מוצג להלן, עם פרטים נוספים שנמצאים ב התזה.

מאגר נתונים

ישנם מספר מאגרי נתונים של ניסוח מחדש הזמינים שמשמשים במחקר, כולל: Microsoft Paraphrase corpus, תחרות הדמיון הסמנטי של ACL, Quora Duplicate Questions, ו- Twitter Shared Links. בחרנו ב MS-COCO נוכח גודלו, ניקיונו, ושימושו כאבן בוחן לשני ניירות מחקר על יצירת ניסוח מחדש. MS-COCO מכיל 120,000 תמונות של סצנות רגילות עם 5 כותרות תמונה לכל תמונה, המסופקות על ידי 5 מאננוטורים אנושיים שונים.

בעוד שהוא מיועד בעיקר למחקר ראייה ממוחשבת, הכותרות נוטות להיות בעלות דמיון סמנטי גבוה ומהוות ניסוחים מחדש מעניינים. נוכח העובדה שהכותרות הוצגו על ידי אנשים שונים, הן נוטות להיות בעלות וריאציות קלות בפרטים שסופקו בסצנה, ולכן המשפטים המיוצרים נוטים להלוצינציות פרטים.

מודל מפוקח

בעוד שלמידת חיזוק השתפרה באופן משמעותי במונחים של יעילות דגימה, זמני אימון, ותקנים טובים ביותר, אימון מודלי RL מהשורש איטי ולא יציב (Arulkumaran et al., 2017). לכן, במקום לאמן מהשורש, אנו מאמנים קודם מודל מפוקח ואז מעדנים אותו באמצעות RL.

אנו משתמשים במסגרת Encoder-Decoder ומעריכים את ביצועי מספר מודלים מפוקחים. כאשר אנו מעדנים את המודל באמצעות RL, אנו מעדנים רק את רשת הפלט ומתייחסים לרשת המקודדת כסטטית. כך, אנו שוקלים שני מסגרות עיקריות:

- אימון המודל המפוקח מהשורש באמצעות אנקודר-דקודר סטנדרטי/ונילה עם GRUs

- שימוש במודלים מוכוונים מראש של אינקודינג עבור האנקודר, כולל: אינקודינג מילים מרוכז (GloVe), InferSent, ו- BERT

המודלים המפוקחים נוטים לבצע באופן דומה, כאשר BERT והאנקודר-דקודר הוונילי משיגים את הביצועים הטובים ביותר.

בעוד שהביצועים נוטים להיות סבירים, ישנם שלושה מקורות נפוצים של שגיאות: הפסקה, יצירת קטעי משפט, והלוצינציות. אלו הם הבעיות העיקריות שהשימוש ב-RL מטרתו לפתור.

מודל למידת חיזוק

יישום אלגוריתמים של RL הוא מאתגר במיוחד, במיוחד כאשר אתה לא יודע אם הבעיה יכולה להיפתר. יכולים להיות בעיות ביישום הסביבה, הסוכנים, ההיפר-פרמטרים, פונקציית התגמול, או שילוב של כל אלו! בעיות אלו מחמירות כאשר עושים RL עמוק, כיוון שאתה מקבל את הכיף של המורכבות הנוספת של ניפוי תקלות ברשתות נוירונים.

כמו עם כל ניפוי תקלות, הוא חשוב להתחיל בפשטות. אנו מימשנו וריאציות של שני סביבות RL צעצוע המובנות היטב (CartPole ו- FrozenLake) כדי לבדוק אלגוריתמים של RL ולמצוא אסטרטגיה חוזרת להעברת ידע מהמודל המפוקח.

אנו מצאנו ששימוש באלגוריתמי Actor-Critic משיג תוצאות טובות יותר מ- REINFORCE בסביבות אלו. במונחים של העברת ידע למודל Actor-Critic, אנו מצאנו שאתחול משקלי ה-Actor עם המודל המפוקח המאומן ופריטריינינג ה- Critic השיגו את הביצועים הטובים ביותר.

תומכים בידי תובנות אלו, אנו אז פונים לפיתוח גישה למשימת יצירת ניסוח מחדש. אנו צריכים קודם ליצור סביבה.

הסביבה מאפשרת לנו לבדוק בקלות את ההשפעה של שימוש במדדים שונים כפונקציות תגמול.

אנו אז מגדירים את הסוכן, נוכח היתרונות הרבים, אנו משתמשים בארכיטקטורה של Actor-Critic. ה-Actor משמש לבחירת המילה הבאה ברצף, ומשקליו מאותחלים באמצעות המודל המפוקח. ה- Critic מספק הערכה של התגמול הצפוי שמצב סביר לקבל, כדי לעזור ל-Actor ללמוד.

תכנון פונקציית התגמול הנכונה

הרכיב החשוב ביותר בתכנון מערכת RL הוא פונקציית התגמול, כיוון שזהו מה שהסוכן RL מנסה לאופטימיז. אם פונקציית התגמול שגויה, אז התוצאות יסבלו, אפילו אם כל חלק אחר במערכת עובד!

דוגמה קלאסית לכך היא CoastRunners שבו חוקרי OpenAI הגדירו את פונקציית התגמול כמקסימיזציה של הניקוד הכולל, במקום ניצחון במרוץ. תוצאת כך היא שהסוכן גילה לולאה שבה הוא יכול לקבל את הניקוד הגבוה ביותר על ידי פגיעה בטורבו ללא סיום המרוץ.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

נוכח העובדה שהערכת איכות הניסוחים מחדש היא בעצמה בעיה שלא נפתרה, תכנון פונקציית תגמול שתופס אובייקטיב אוטומטית הוא עוד יותר קשה. רוב היבטים של שפה לא מתפרקים היטב למטריקות ליניאריות, והם תלויי משימה (Novikova et al., 2017).

הסוכן RL לעיתים קרובות מגלה אסטרטגיה מעניינת למקסם את התגמולים, שמנצלת את החולשות במדד ההערכה, במקום לייצר טקסט איכותי.

זה נוטה להוביל לביצועים גרועים במדדים שהסוכן לא מאופטימיז.

אנו בוחנים שלוש גישות עיקריות:

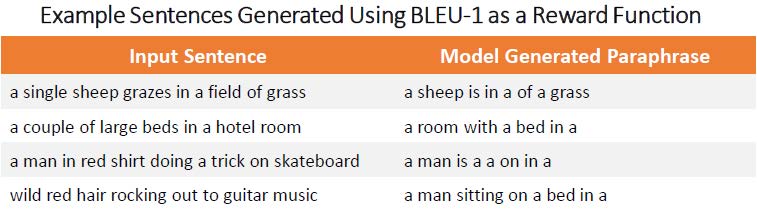

- מדדים של חפיפת מילים

מדדים נפוצים של NLP בוחנים את החלק היחסי של חפיפת מילים בין הניסוח מחדש המיוצר למשפט ההערכה. ככל שהחפיפה גדולה יותר, כך גדל התגמול. האתגר עם גישות ברמת המילה הוא שהסוכן כולל מילים רבות מחבר, כגון “a is on of”, ואין מדד לשוטפות. זה מוביל לניסוחים מחדש באיכות נמוכה.

- מדדים של דמיון ברמת המשפט ושוטפות

התכונות העיקריות של ניסוח מחדש מיוצר הן שהוא חייב להיות שוטף ודומה סמנטית למשפט הקלט. לכן, אנו מנסים לציין אותם בנפרד, ואז לשלב את המדדים. לדמיון סמנטי, אנו משתמשים בדמיון הקוסינוס בין אינקודינגים של משפטים ממודלים מוכוונים מראש, כולל BERT. לשוטפות, אנו משתמשים בציון המבוסס על הפרפלקסיה של משפט מ- GPT-2. ככל שהדמיון הקוסינוסי והציונים של שוטפות גדולים יותר, כך גדל התגמול.

אנו ניסינו מספר רב של שילובים שונים של מודלי אינקודינג משפט ומודלים של שוטפות, ואף על פי שהביצועים היו סבירים, הבעיה העיקרית שהסוכן פנים היא שלא הצליח לאזנן בין דמיון סמנטי לשוטפות. לרוב הקונפיגורציות, הסוכן העדיף שוטפות, מה שהוביל להסרת פרטים ורוב הישויות הוצבו “באמצע” של משהו או הועברו “על שולחן” או “צד הכביש”.

למידת חיזוק רב-מטרתית היא שאלת מחקר פתוחה, והיא מאתגרת מאוד במקרה זה.

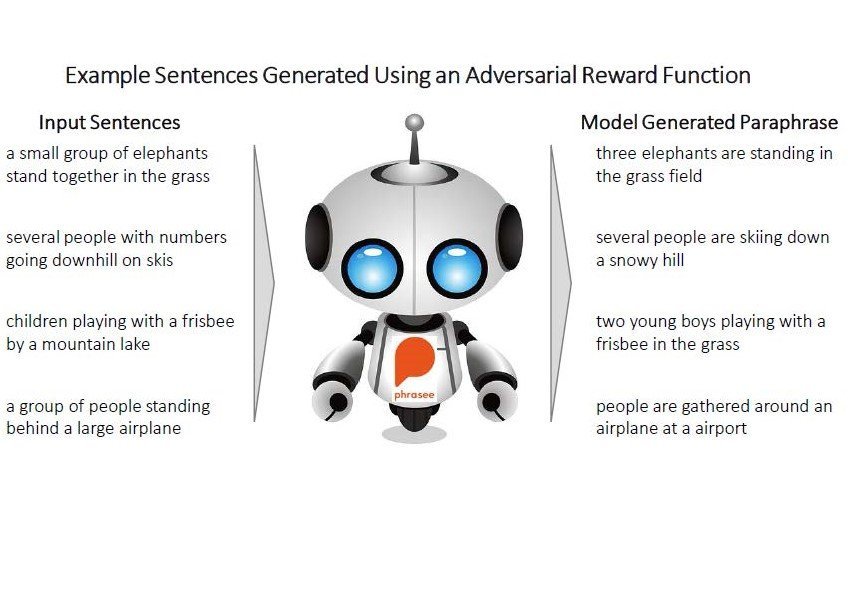

- שימוש במודל אדוורסרי כפונקציית תגמול

נוכח העובדה שבני אדם נחשבים לסטנדרט הזהב בהערכה, אנו מאמנים מודל נפרד הנקרא דיסקרימינטור לחזות האם שני משפטים הם ניסוחים מחדש זה של זה (בדומה לדרך שבה אדם יעריך). המטרה של המודל RL היא לשכנע את המודל הזה שהמשפט המיוצר הוא ניסוח מחדש של הקלט. הדיסקרימינטור מייצר ציון של כמה סביר ששני המשפטים הם ניסוחים מחדש זה של זה, שמשמש כתגמול לאימון הסוכן.

כל 5,000 ניחושים, הדיסקרימינטור מודיע לו איזה ניסוח מחדש בא מהמאגר ואיזה נוצר, כדי שיוכל לשפר את ניחושיו העתידיים. התהליך נמשך למספר רב של סבבים, עם הסוכן שמנסה לרמות את הדיסקרימינטור, והדיסקרימינטור מנסה להבדיל בין הניסוחים מחדש המיוצרים לבין הניסוחים מחדש מהמאגר.

אחרי מספר רב של סבבי אימון, הסוכן מייצר ניסוחים מחדש שמשיגים תוצאות טובות יותר מהמודלים המפוקחים ומפונקציות התגמול האחרות.

מסקנה ומגבלות

גישות אדוורסריות (כולל משחק עצמי למשחקים) מציעות גישה מבטיחה מאוד לאימון אלגוריתמים של RL לעקוף את הרמה האנושית במשימות מסוימות, ללא הגדרת פונקציית תגמול מפורשת.

בעוד ש-RL הצליח להתגבר על למידה מפוקחת במקרה זה, כמות העומס הנוסף במונחים של קוד, חישוב, ומורכבות, אינה שווה את התועלת ברוב היישומים. RL הוא הטוב ביותר כאשר למידה מפוקחת לא יכולה להיות מיושמת בקלות, ופונקציית תגמול היא קלה להגדרה (כגון משחקי Atari). הגישות והאלגוריתמים הרבה יותר בשלות בלמידה מפוקחת, והאות השגוי חזק יותר, מה שמוביל לאימון מהיר יותר ויציב יותר.

הדבר החשוב הוא, כמו עם גישות נוירוניות אחרות, שהסוכן יכול לכשל באופן דרמטי במקרים שבהם הקלט שונה מהקלטים שהוא ראה בעבר, ודורש שכבה נוספת של בדיקות על מנת לוודא יציבות ביישומים מסחריים.

הפריצה של העניין בגישות RL והתקדמות בתשתית חישובית בשנים האחרונות, תיפתח הזדמנויות עצומות ליישום RL בתעשייה, במיוחד בתוך NLP.