בינה מלאכותית

Mistral AI: קביעת סטנדרטים חדשים מעבר ל-Llama2 בתחום הקוד הפתוח

מודלים לשוניים גדולים (LLMs) תפסו לאחרונה את הבמה המרכזית, הודות לביצועים מרשימים כמו ChatGPT. כאשר Meta הציגה את מודלי Llama, הדבר עורר מחדש עניין ב-LLMs הפתוחים. המטרה? ליצור LLMs פתוחים וזולים שיהיו טובים כמו מודלים מדרגה ראשונה כמו GPT-4, אך בלי המחיר הגבוה או המורכבות.

השילוב הזה של יותר מחיר ויעילות לא רק פתח דרכים חדשות לחוקרים ומפתחים, אלא גם הציב בימה לעידן חדש של התקדמויות טכנולוגיות בעיבוד שפה טבעית.

לאחרונה, סטארטאפים של AI יוצרים היו בעלייה עם מימון. Together גייסה $20 מיליון, במטרה לעצב AI יוצרת פתוחה. Anthropic גייסה $450 מיליון מרשים, ו-Cohere, בשותפות עם Google Cloud, השיגה $270 מיליון ביוני השנה.

מבוא ל-Mistral 7B: גודל וזמינות

Mistral AI, הממוקמת בפריז ונוסדה על ידי בוגרים מ-Google’s DeepMind ו-Meta, הכריזה על מודל השפה הגדול הראשון שלה: Mistral 7B. מודל זה יכול להורדה בקלות על ידי כולם מ-GitHub ואפילו דרך 13.4 גיגה-בייט טורנט.

הסטארטאפ הזה הצליחה להשיג מימון זרעים שיא עוד לפני שהיה לה מוצר. Mistral AI עם מודל 7 מיליארד פרמטרים עוקפת את הביצועים של Llama 2 13B בכל המבחנים ומביסה את Llama 1 34B ברבים מהמדדים.

בהשוואה למודלים אחרים כמו Llama 2, Mistral 7B מספקת יכולות דומות או טובות יותר אך עם פחות עומס חישובי. בעוד שמודלים יסודיים כמו GPT-4 יכולים להשיג יותר, הם באים עם עלות גבוהה יותר ואינם כל כך ידידותיים למשתמש, שכן הם נגישים בעיקר דרך API.

כאשר מדובר במשימות קידוד, Mistral 7B נותנת CodeLlama 7B ריצה לכסף. פלוס, היא קומפקטית מספיק ב-13.4 GB לרוץ על מכונות סטנדרטיות.

בנוסף, Mistral 7B Instruct, שכוונה במיוחד למאגרי נתונים הוראתיים ב-Hugging Face, הראתה ביצועים גדולים. היא עוקפת את המודלים האחרים 7B ב-MT-Bench ועומדת כתף מול כתף עם מודלים 13B.

Hugging Face Mistral 7B Example

ביצועי בנצ’מרק

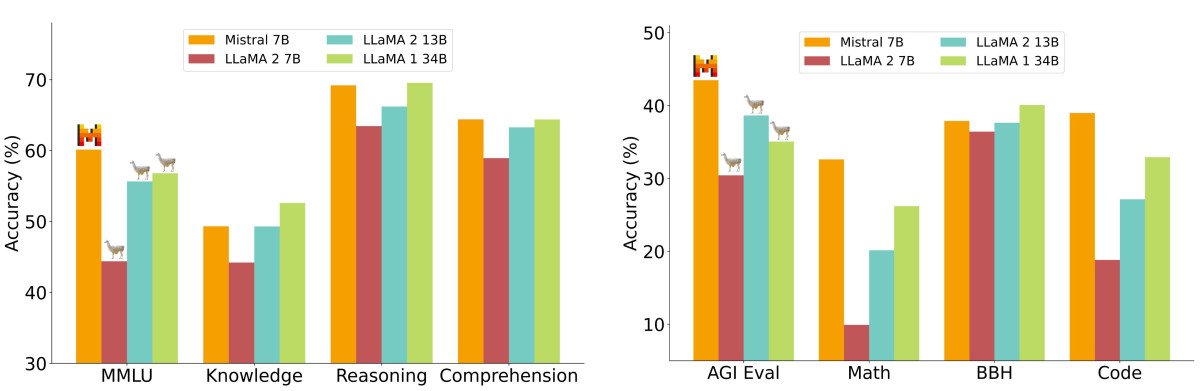

בניתוח ביצועים מפורט, Mistral 7B נמדדה נגד מודלי Llama 2. התוצאות היו ברורות: Mistral 7B עוקפת את Llama 2 13B בכל הבנצ’מרקים. בעובדה, היא השוותה את הביצועים של Llama 34B, במיוחד בולטת בביצועי קוד והיגיון.

הבנצ’מרקים אורגנו לקטגוריות רבות, כגון היגיון משותף, ידע עולמי, קריאה והבנה, מתמטיקה וקוד, בין היתר. תצפית מיוחדת הייתה ביצועי Mistral 7B במדד “גודל מודל שקול”, שנקרא “גודל מודל שקול”. בתחומים כמו היגיון והבנה, Mistral 7B הראתה ביצועים דומים ל-Llama 2 מודל בגודל שלושה פעמים, מה שמצביע על חיסכון פוטנציאלי בזיכרון ועלייה בקצב.

מה גורם ל-Mistral 7B להיות טוב יותר מרוב המודלים האחרים?

מנגנוני תשומת לב מופשטים

בעוד שהרגישויות של מנגנוני תשומת לב הן טכניות, הרעיון הבסיסי שלהן יחסית פשוט. תדמיינו לקרוא ספר ולהדגיש משפטים חשובים; זה דומה לאיך מנגנוני תשומת לב “מדגישים” או נותנים חשיבות לנקודות נתונים מסוימות ברצף.

בהקשר של מודלים לשוניים, מנגנונים אלו מאפשרים למודל להתמקד בחלקים הרלוונטיים ביותר של נתוני הקלט, ולוודא שהפלט הוא קוהרנטי ומדויק בהקשר.

בטרנספורמרים סטנדרטיים, ציוני תשומת לב מחושבים עם הנוסחה:

הנוסחה לציונים אלו כוללת צעד חשוב – כפל מטריצות Q ו-K. האתגר כאן הוא שככל שאורך הרצף גדל, שתי המטריצות מתרחבות בהתאמה, מה שמוביל לתהליך חישובי מעייף. זהו אחד הסיבות העיקריות מדוע טרנספורמרים סטנדרטיים יכולים להיות איטיים, במיוחד כאשר מטפלים ברצפים ארוכים.

תשומת לב רב-שאילתא (MQA) מאיצה את הדברים על ידי שימוש בסט משותף של ‘ראשי מפתח-ערך’ אך לפעמים מוותרת על איכות. עכשיו, אתם עלולים לשאול, למה לא לשלב את המהירות של MQA עם האיכות של תשומת לב רב-ראשית? זה המקום בו נכנסת תשומת לב קבוצתית (GQA).

תשומת לב קבוצתית (GQA)

GQA היא פתרון ביניים. במקום להשתמש רק בראש ‘מפתח-ערך’ אחד או מרובים, היא קובצים. בדרך זו, GQA משיגה ביצועים קרובים לתשומת לב רב-ראשית מפורטת אך עם המהירות של MQA. עבור מודלים כמו Mistral, זה אומר ביצועים יעילים ללא פשרות מרובות באיכות.

תשומת לב חלון משורתת (SWA)

החלון המשורתת הוא שיטה נוספת המשמשת בעיבוד רצפים. שיטה זו משתמשת בחלון תשומת לב קבוע סביב כל טוקן ברצף. עם שכבות רבות המציבות את החלון המשורתת, השכבות העליונות בסופו של דבר זוכות לתמונה רחבה יותר, הכוללת מידע מכל הקלט.

שקיפות Mistral AI מול חששות בטיחות בהתפלגות

בהכרזתה, Mistral AI הדגישה גם שקיפות עם ההצהרה: “אין תחבולות, אין נתונים פרופריאטיביים.” אך בו-זמנית, המודל היחיד שזמין כרגע ‘Mistral-7B-v0.1’ הוא מודל בסיס מוקדם, ולכן הוא יכול ליצור תגובה לכל שאילתא ללא מודרטור, מה שמעלה חששות בטיחות פוטנציאליים. בעוד שמודלים כמו GPT ו-Llama הם בעלי מנגנונים להבדיל מתי להגיב, טבעה המבוזר של Mistral יכול להיות מנוצל על ידי גורמים זדוניים.

גמישות הטמעה

אחד ההיבטים הבולטים הוא ש-Mistral 7B זמינה תחת רישיון Apache 2.0. זאת אומרת שאין מחסומים אמיתיים לשימוש בה – האם אתם משתמשים בה למטרות אישיות, תאגיד ענק או אפילו ישות ממשלתית. כל מה שאתם צריכים הוא מערכת נכונה לרוץ אותה, או שאתם עלולים להיווצר במשאבי ענן.

מחשבות סופיות

עלייתם של LLMs פתוחים כמו Mistral 7B מסמנת מפנה משמעותי בתעשיית ה-AI, הופכת מודלים לשוניים איכותיים לנגישים לקהל רחב יותר. הגישות החדשניות של Mistral AI, כגון תשומת לב קבוצתית ותשומת לב חלון משורתת, מבטיחות ביצועים יעילים ללא פשרות מרובות באיכות.

בעוד שטבעה המבוזרת של Mistral מציבה אתגרים מסוימים, גמישותה ורישיון הקוד הפתוח מדגישים את הפוטנציאל לדמוקרטיזציה של AI. ככל שהנוף משתנה, הדגש יהיה בהכרח על איזון כוחם של מודלים אלו עם התחשבויות אתיות ומנגנוני בטיחות.