בינה מלאכותית

פחות זה יותר: למה שליפת מסמכים מעטים יותר יכולה לשפר את התשובות של AI

Retrieval-Augmented Generation (RAG) היא גישה לבניית מערכות AI שמשלבת מודל שפה עם מקור ידע חיצוני. במונחים פשוטים, ה-AI מחפשת תחילה מסמכים רלוונטיים (כגון מאמרים או דפי אינטרנט) הקשורים לשאילתа של משתמש, ואז משתמשת באותם מסמכים כדי ליצור תשובה מדויקת יותר. שיטה זו זכתה לשבחים על כך שהיא עוזרת ל-מודלי שפה גדולים (LLM) להישאר עובדתיים ולהפחית הזיות על ידי יצירת תגובות שמבוססות על נתונים אמיתיים.

באופן אינטואיטיבי, מישהו עשוי לחשוב שככל שה-AI שולפת יותר מסמכים, כך תשובתה תהיה מושפעת יותר. המחקר האחרון מציע עיוות מפתיע: כאשר מדובר בהזנת מידע ל-AI, לפעמים פחות זה יותר.

פחות מסמכים, תשובות טובות יותר

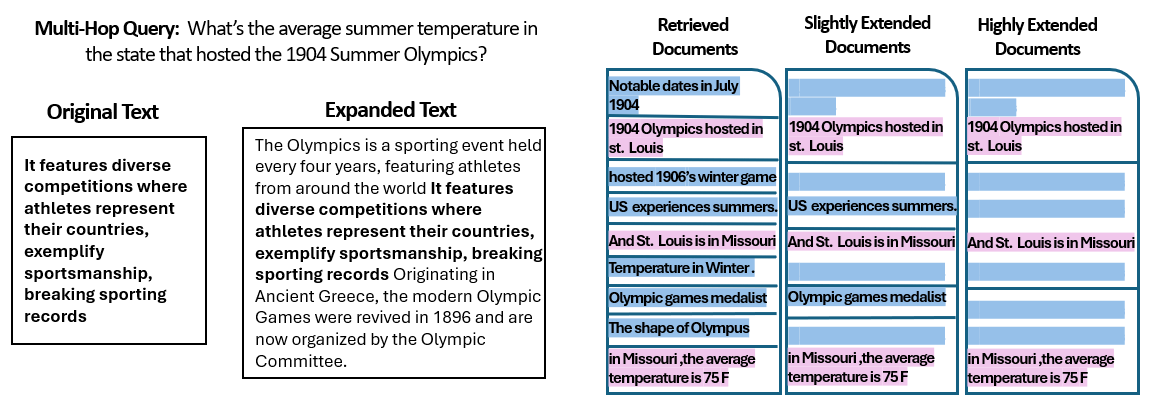

מחקר חדש שנערך על ידי חוקרים באוניברסיטה העברית בירושלים חקר כיצד מספר המסמכים הניתנים למערכת RAG משפיע על ביצועיה. בעל חשיבות, הם שמרו על כמות הטקסט הכוללת – כלומר, אם פחות מסמכים סופקו, המסמכים הללו הורחבו מעט כדי למלא את אותו אורך כמו הרבה מסמכים. בדרך זו, כל הבדלים בביצועים יכולים להיות מיוחסים לכמות המסמכים ולא רק לקיצור הקלט.

החוקרים השתמשו במאגר נתונים של שאילתות (MuSiQue) עם שאילתות טריוויה, כל אחת מהן מקושרת במקור ל-20 סעיפים בוויקיפדיה (רק מעטים מהם מכילים את התשובה, והשאר הם מסיחי דעת). על ידי קיצוץ מספר המסמכים מ-20 ל-2-4 הרלוונטיים באמת – והוספתם במעט הקשר כדי לשמור על אורך עקבי – הם יצרו תרחישים שבהם ה-AI היה לו פחות חומר להתבונן, אך עדיין כמעט אותו מספר מילים לקרוא.

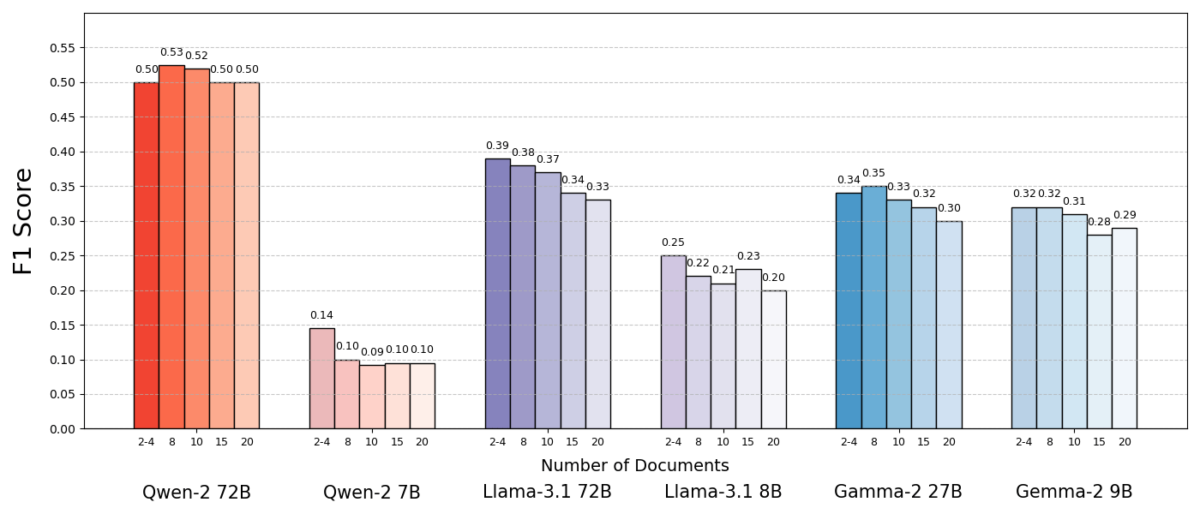

התוצאות היו מרשימות. במרבית המקרים, ה-AI ענה בדיוק רב יותר כאשר הוא קיבל פחות מסמכים מאשר את הקבוצה המלאה. הביצועים שופרו באופן משמעותי – בחלק מהמקרים בעל 10% בדיוק (ציון F1) כאשר המערכת השתמשה רק בקומץ המסמכים התומכים במקום באוסף גדול. השיפור הזה נצפה במספר מודלי שפה פתוחים, כולל וריאנטים של Meta’s Llama ואחרים, מה שמראה שהתופעה אינה קשורה למודל AI בודד.

מודל אחד (Qwen-2) היה יוצא דופן משמעותי שהתמודד עם מסמכים מרובים ללא ירידה בציון, אך כמעט כל המודלים שנבדקו ביצועו טוב יותר עם פחות מסמכים. במילים אחרות, הוספת חומר הפניה מעבר לפריטים הרלוונטיים באמת פגעה בביצועיהם יותר מאשר עזרה.

מקור: Levy et al.

למה זה הפתעה כל כך? בדרך כלל, מערכות RAG מתוכננות בהנחה ששליפת חלק רחב יותר של מידע יכולה רק לעזור ל-AI – אחר הכל, אם התשובה אינה במסמכים הראשונים, היא עשויה להיות במסמך ה-10 או ה-20.

מחקר זה הופך את התסריט, ומוכיח שהוספת מסמכים נוספים באופן לא מפלס יכולה להיכשל. אפילו כאשר אורך הטקסט הכולל הוחזק קבוע, הנוכחות של הרבה מסמכים שונים (כל אחד עם הקשר ומוזרויות משלו) הפכה את משימת ענה ל-AI למשימה יותר אתגרית. נראה שמעבר לנקודה מסוימת, כל מסמך נוסף הציג יותר רעש מאשר אות – מבלבל את המודל ופוגע ביכולתו לחלץ את התשובה הנכונה.

למה פחות יכול להיות יותר ב-RAG

תוצאה “פחות זה יותר” מובנת פעם אחת שאנו מחשיבים איך מודלי שפה של AI עובדים. כאשר AI מקבל רק את המסמכים הרלוונטיים, ההקשר שהוא רואה ממוקד וחופשי מהסחות דעת, בדומה לתלמיד שקיבל רק את הדפים הנכונים ללימוד.

במחקר, המודלים ביצועו הרבה יותר טוב כאשר ניתנו להם רק המסמכים התומכים, עם חומר לא רלוונטי שהוסר. ההקשר הנותר לא רק היה קצר יותר, אלא גם נקי יותר – הוא הכיל עובדות שהצביעו ישירות על התשובה ולא היה דבר אחר. עם פחות מסמכים לטיפול, המודל יכול היה להקדיש את תשומת הלב המלאה שלו למידע הרלוונטי, מה שהפך אותו לפחות מועד להיסחות או בלבול.

מצד שני, כאשר הרבה מסמכים נשלפו, ה-AI היה צריך לדלות דרך תערובת של תוכן רלוונטי ולא רלוונטי. לעיתים קרובות מסמכים אלו היו “דומים אך לא קשורים” – הם עשוים לשתף נושא או מילות מפתח עם השאילתא, אך לא להכיל באמת את התשובה. תוכן כזה יכול להטעות את המודל. ה-AI עלול לבזבז מאמץ בניסיון לחבר נקודות בין מסמכים שלא באמת מובילים לתשובה נכונה, או גרוע מכך, הוא עלול לאחד מידע ממקורות שונים באופן לא נכון. זה מגדיל את הסיכון להזיות – מקרים שבהם ה-AI יוצר תשובה שנשמעת אפשרית אך לא מבוססת על שום מקור.

במהות, הזנת יותר מדי מסמכים למודל יכולה להדליף את המידע השימושי ולהכניס פרטים סותרים, מה שהופך אותו לקשה יותר עבור ה-AI להחליט מהי האמת.

באופן מעניין, החוקרים מצאו שאם המסמכים הנוספים היו ברורים לא רלוונטיים (למשל, טקסט אקראי לא קשור), המודלים היו טובים יותר בהתעלמות מהם. הבעיה האמיתית באה מנתונים מסיחים שנראים רלוונטיים: כאשר כל הטקסטים שנשלפו היו על נושאים דומים, ה-AI הניח שעליו להשתמש בכולם, והוא עלול להתקשות להבחין בין הפרטים החשובים. הדבר תואם את מציאת המחקר ש-מסיחים אקראיים גרמו לפחות בלבול בקלט. ה-AI יכול לסנן החוצה את השטויות הגלויות, אך מידע מוסתר באופן עדין הוא מלכודת חמקמקה – הוא חודר במסווה של רלוונטיות ומוביל את התשובה. על ידי הפחתת מספר המסמכים לאלו ההכרחיים באמת, אנו מונעים את הצבת מלכודות אלו מלכתחילה.

ישנו גם יתרון מעשי: שליפה ועיבוד של פחות מסמכים מורידים את העומס החישובי עבור מערכת RAG. כל מסמך שמושך צריך להיבדק (להישתלב, לקרוא ולקבל תשומת לב מהמודל), מה שמשתמש בזמן ובמשאבי מחשוב. הסרת מסמכים עודפים הופך את המערכת ליעילה יותר – היא יכולה למצוא תשובות מהר יותר ובעלות נמוכה יותר. במקרים שבהם דיוק שופר על ידי התמקדות במקורות מעטים, אנו מקבלים ניצחון-ניצחון: תשובות טובות יותר ותהליך דק ויעיל יותר.

מקור: Levy et al.

ארגון מחדש של RAG: כיוונים עתידיים

הראיות החדשות האלו, שאיכות רבה יותר מכמות בשליפה, הן בעלות משמעות חשובה עבור עתידן של מערכות AI שתלויות בידע חיצוני. הן מרמזות כי מעצבי מערכות RAG צריכים להעדיף סינון חכם ודירוג של מסמכים על פני כמות. במקום לאסוף 100 פסקאות אפשריות ולקוות שהתשובה תהיה קבורה באיפשהו, זה עשוי להיות חכם יותר לאסוף רק את המסמכים המעטים הרלוונטיים ביותר.

מחברי המחקר מדגישים את הצורך בשיטות שליפה ש”ישיגו איזון בין רלוונטיות לגיוון” במידע שהם מספקים למודל. במילים אחרות, אנו רוצים לספק כיסוי מספיק של הנושא כדי לענות על השאילתא, אך לא כל כך הרבה שהעובדות המרכזיות טבועות בים של טקסט לא רלוונטי.

בהמשך, חוקרים אלו מעלים את האפשרות לחקור טכניקות שיעזרו למודלי AI להתמודד עם מסמכים מרובים בצורה יותר חסכונית. אחת הגישות היא לפתח מערכות שליפה טובות יותר או מדרגים שיכולים לזהות אילו מסמכים באמת מוסיפים ערך ואילו הם מציגים רק סתירות. זווית אחרת היא שיפור המודלים עצמם: אם מודל אחד (כמו Qwen-2) הצליח להתמודד עם הרבה מסמכים ללא איבוד דיוק, בדיקת איך הוא אומן או הובנה יכולה להציע רמזים להפיכת מודלים אחרים לחסינים יותר. אולי מודלי שפה גדולים עתידיים י