הזווית של Anderson

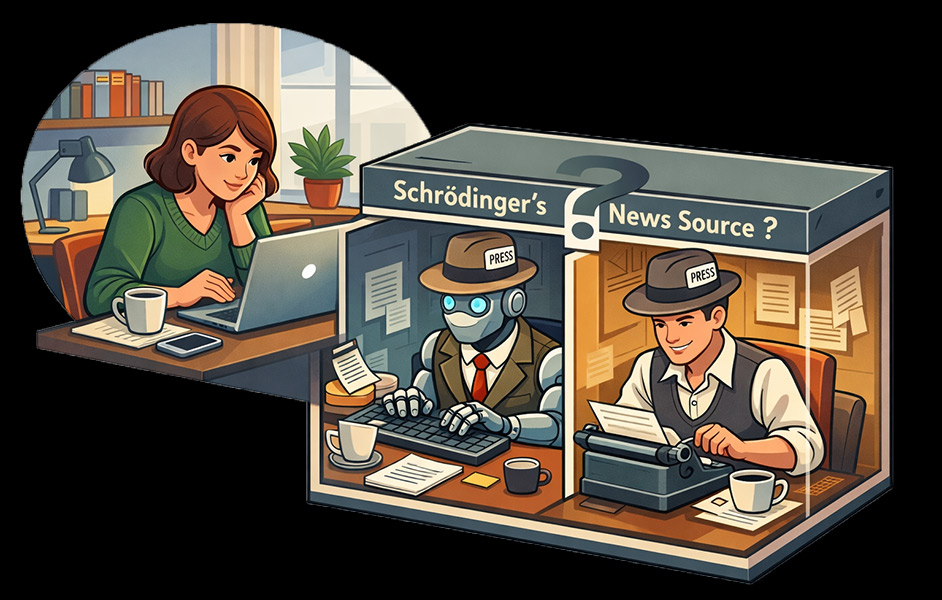

אפילו AI בסיסי יכול כעת לכתוב חדשות שעוברות כאנושיות

מחקר חדש מצביע על כך שאפילו מודלים מקומיים קטנים של AI יכולים כעת לכתוב חדשות שאנשים לא יכולים להבדיל מעיתונות אמיתית, תואמים את המערכות המובילות, והותירו את הקוראים מסוגלים לדעת מי כתב מה.

לפי שיתוף פעולה חדש בין גרמניה לצרפת, בני אדם לא יכולים לדעת האם כתבה נכתבה על ידי AI או בן אדם – אפילו כאשר היא נכתבה על ידי מודלים קוד פתוח שניתן להוריד ולהריץ על מחשבים ברמה סבירה.

בעוד המחקר החדש, הבא משלושה חוקרים ברחבי אוניברסיטת פרנקפורט למדעים שימושיים ויחידת המחקר IRISA בנאנט, המחקר החדש עושה הבחנה חשובה בין ‘חדשות כזב’ ל’חדשות שנכתבו על ידי AI’ (מכיוון שחדשות כזב יכולות להיכתב על ידי אנשים, או על ידי AI, ושני ההיבטים אינם בהכרח זהים).

המחברים חוזרים לנושא שהם בדקו לראשונה ב שחרור ברכה או קללה? סקירה על ההשפעה של AI יוצרת על חדשות כזב. הממצאים עצמם הם תוצאות חדשות שפורסמו מפרויקט גדול יותר שפורסם לראשונה בינואר, ומשתמשים ב JudgeGPT המקוון של המחברים.

כוח נוצר

שכותרתו האם בני אדם יכולים לדעת? מחקר דו-צירי על תפיסת בני אדם של חדשות שנוצרו על ידי LLM, ובא משלושה חוקרים, ה מחקר החדש מראה שמודלים קטנים כולל Mistral 7B ו Gemma 7B יכולים, עם רק שבעה מיליארד פרמטרים, להתמודד עם דגמים גדולים יותר כמו ChatGPT-4o עם 200 מיליארד פרמטרים:

‘מודלים פתוחים עם רק 7B פרמטרים מייצרים טקסט שמדורג באופן שונה מהפלט של GPT-4o, מה שמצביע על כך שהיכולת ליצור טקסט שאינו ניתן להבחנה מבני אדם אינה מוגבלת עוד למודלים המובילים.’

שיטה

למשתתפים שהשתתפו בפלטפורמה JudgeGPT, כל קטע חדשות נבדק באמצעות מסגרת דו-צירית, שבה הם סיפקו שלוש דירוגים עצמאיים על סמן רציף 0-100:

שיפוט מקור תפס אם פסקה נראתה כתובה על ידי מכונה או אדם; שיפוט אותנטיות, אם היא נתפסה כמזויפת או לגיטימית; ו מוכרות נושא, כמה טוב הקורא הכיר את הנושא.

המחברים מציינים:

‘הקבוצת הגירוי מוטה בכוונה כלפי קטעים מקור מכונה (∼98%), עם פריטים מקור אנושי המשמשים כעוגני כיול.

‘בחירת עיצוב זו משקפת את מוקד המחקר בתוך וריאציה של AI (בין מודלים) ולא השוואה בין בני אדם ל AI; משתתפים אינם מודעים לשיעור הבסיס, והתוצאות של גילוי קצר [תוצאות] נשמרות גם כאשר נבדקות על סמפל המקור האנושי בלבד.’

מבחנים

המבחנים מחולקים לחמישה סוגי ממצאים: הבחנה בין טקסט שנוצר על ידי מכונה לטקסט שנכתב על ידי בן אדם; השוואה בין גילוי בין LLMs שונים; בדיקת ההשפעה של התמחות בתחום נגד כיוון פוליטי על דיוק; זיהוי אסטרטגיות תגובה שונות בין משתתפים; ועקיבה אחרי האופן שבו הדיוק משתנה עם מבחנים חוזרים, בגלל עייפות:

המבחן הראה שאין הבדל משמעותי מעבר למקרה בציוני מקור בין תנאים, ככל הנראה מצביע על כך שמשתתפים לא יכולים להבחין בין טקסט שנוצר על ידי AI לטקסט שנכתב על ידי בן אדם:

המחברים מסיקים:

‘האם בני אדם יכולים לדעת? מחקרנו הדו-צירי של 2,318 שיפוטים ברחבי שש משפחות LLMs נותן תשובה אמפירית ברורה: הם לא יכולים.

‘טקסט שנוצר על ידי מכונה אינו ניתן להבחנה מכתיבה אנושית, ללא קשר לגודל המודל או למשפחה, תמחות בתחום מנבאת דיוק גילוי חזק יותר מאשר כיוון פוליטי, משתתפים אימצו אסטרטגיות אמון שונות, ועייפות קוגניטיבית מגבילה גילוי ממושך.

‘ממצאים אלו תומכים במעבר מגילוי ברמת המשתמש לאמצעי זהירות ברמת המערכת, כולל הוכחת תוכן, מערכות אינדיקטור אמון אדפטיביות, והתערבויות חיסון מוגבלות.’

מסקנה

ההיבט המודאג של מאמר זה הוא רשת התמיכה הסמויה של פרויקטים ומאמרים שהמחברים – או חלק מהמחברים, בהתאם לעבודה – הם יוזמים או לוקחים חלק בה; ובאמת היה מאיר לראות דוגמאות של טקסט שנוצר על ידי AI ואדם שהפיקו את התוצאות האלה, כדי להבין טוב יותר את סוג הפלט ששיטת היצור המתוארת מייצרת.

בינתיים, על פי אתר canirun.ai, Mistral 7B (שהיה בערך על פרק עם ChatGPT -4o במבחנים) ‘רץ טוב’ על NVIDIA RTX 3080 עם 16GB VRAM, ו רץ ‘סבבה’ על 3060 עם 6GB VRAM – בערך כרטיסי הגרפיקה הטובים ביותר. כך שכל מי שרוצה לפתח את שיטתו שלו להגשת דוגמאות יכול להשתתף גם הוא בניסויים האלה.

* Gemma 7B אינו רשום באתר.

פורסם לראשונה ביום חמישי, 9 באפריל 2026