בינה מלאכותית

מדריך מלא על Gemma 2: מודל שפה גדול ופתוח חדש של Google

Gemma 2 בונה על קודמו, ומציע ביצועים משופרים ויעילות, לצד חבילה של תכונות חדשניות שהופכות אותו למתאים במיוחד ליישומים מחקריים ומעשיים. מה שמבדיל את Gemma 2 הוא יכולתו לספק ביצועים דומים למודלים פרופריטריים גדולים, אך בחבילה שתוכננה לנגישות רחבה יותר ולשימוש על מערכות חומרה מודעות יותר.

כאשר חקרתי את המפרטים הטכניים והארכיטקטורה של Gemma 2, מצאתי את עצמי מרושם יותר ויותר מהמומחיות של עיצובו. המודל משלב מספר טכניקות מתקדמות, כולל מנגנוני קשב חדשים וגישות חדשניות ליציבות אימון, שתורמות ליכולותיו המרשימות.

במדריך המלא הזה, נחקור את Gemma 2 בעומק, ונבחן את הארכיטקטורה, התכונות המרכזיות והיישומים המעשיים שלו. בין אם אתה מומחה AI מנוסה או חדש בתחום, מאמר זה מטרתו לספק תובנות שימושיות לגבי איך Gemma 2 עובד ואיך אתה יכול לנצל את כוחו בפרויקטים שלך.

מהו Gemma 2?

Gemma 2 הוא מודל שפה גדול ופתוח חדש של Google, שתוכנן להיות קל משקל וחזק. הוא בנוי על בסיס המחקר והטכנולוגיה ששימשו ליצירת מודלים Gemini של Google, ומציע ביצועים ברמה הגבוהה ביותר בחבילה נגישה יותר. Gemma 2 זמין בשני גדלים:

Gemma 2 9B: מודל עם 9 מיליארד פרמטרים

Gemma 2 27B: מודל גדול יותר עם 27 מיליארד פרמטרים

כל גודל זמין בשתי גרסאות:

מודלים בסיסיים: מאומנים על קורפוס עצום של נתוני טקסט

מודלים מכווננים להוראות (IT): מעודכנים לביצועים טובים יותר על משימות ספציפיות

גישה למודלים ב-Google AI Studio: Google AI Studio – Gemma 2

קראו את הדו”ח הטכני כאן: דו”ח טכני Gemma 2

תכונות ושיפורים מרכזיים

Gemma 2 מציג מספר התקדמויות משמעותיות על פני קודמו:

1. נתוני אימון מוגדלים

המודלים אומנו על כמות משמעותית גדולה יותר של נתונים:

Gemma 2 27B: אומן על 13 טריליון טוקנים

Gemma 2 9B: אומן על 8 טריליון טוקנים

סט נתונים זה, המורכב בעיקר מנתוני אינטרנט (בעיקר אנגלית), קוד ומתמטיקה, תורם לביצועים המשופרים והגמישות של המודלים.

2. תשומת לב חלון מחליק

Gemma 2 מיישם גישה חדשה למנגנוני קשב:

כל שכבה זוגית משתמשת בתשומת לב חלון מחליק עם הקשר מקומי של 4096 טוקנים

שכבות חליפיות מנצלות קשב רבועי גלובלי מלא ברחבי הקשר של 8192 טוקנים

גישה היברידית זו מטרתה לאזן בין יעילות ליכולת לתפוס תלות ארוכת טווח בקלט.

3. כיסוי רך

כדי לשפר את יציבות האימון והביצועים, Gemma 2 מציג מנגנון כיסוי רך:

def soft_cap(x, cap): return cap * torch.tanh(x / cap) # מיושם על לוגיטים של קשב attention_logits = soft_cap(attention_logits, cap=50.0) # מיושם על לוגיטים של שכבה סופית final_logits = soft_cap(final_logits, cap=30.0)

טכניקה זו מונעת מלוגיטים לגדול באופן מוגזם מבלי לבצע קיצוץ קשה, תוך שמירה על יותר מידע וייציבות תהליך האימון.

- Gemma 2 9B: מודל עם 9 מיליארד פרמטרים

- Gemma 2 27B: מודל גדול יותר עם 27 מיליארד פרמטרים

כל גודל זמין בשתי גרסאות:

- מודלים בסיסיים: מאומנים על קורפוס עצום של נתוני טקסט

- מודלים מכווננים להוראות (IT): מעודכנים לביצועים טובים יותר על משימות ספציפיות

4. העברת ידע

עבור המודל 9B, Gemma 2 מנצל טכניקות העברת ידע:

- אימון מוקדם: המודל 9B לומד ממודל מורה גדול יותר במהלך האימון הראשוני

- אימון לאחר מכן: שני המודלים 9B ו-27B משתמשים בהעברת ידע מדיניות כדי לשפר את הביצועים

תהליך זה עוזר למודל הקטן יותר ללכוד את היכולות של מודלים גדולים יותר.

5. מיזוג מודלים

Gemma 2 מנצל טכניקת מיזוג מודלים חדשה בשם Warp, המשלבת מספר מודלים בשלושה שלבים:

- ממוצע תנועה מעריכי (EMA) במהלך עדכון עדין של למידת תגמול

- אינטרפולציה ליניארית ספירלית (SLERP) לאחר עדכון מספר מדיניות

- אינטרפולציה ליניארית לעבר אתחול (LITI) כשלב סופי

גישה זו מטרתה ליצור מודל סופי חזק ומסוגל יותר.

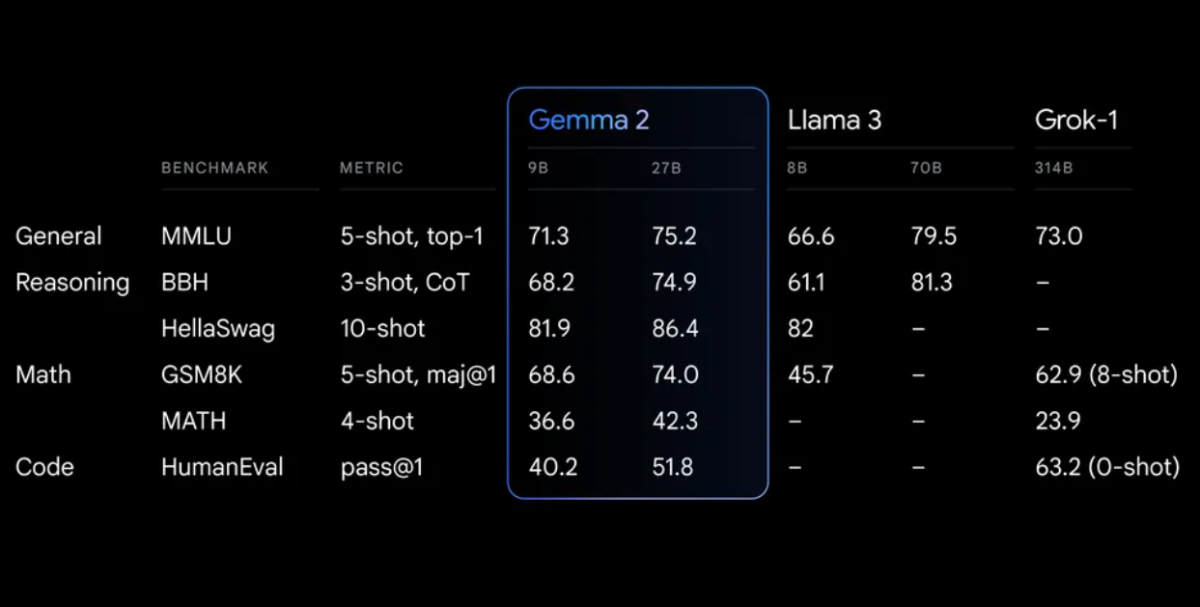

בנקי איכות

Gemma 2 מפגין ביצועים מרשימים במגוון בנקי איכות:

התחלה עם Gemma 2

כדי להתחיל להשתמש ב-Gemma 2 בפרויקטים שלך, יש לך מספר אפשרויות:

1. Google AI Studio

לניסוי מהיר ללא דרישות חומרה, אתה יכול לגשת ל-Gemma 2 דרך Google AI Studio.

2. Hugging Face Transformers

Gemma 2 משולב עם ספריית Hugging Face Transformers הפופולרית. כאן תוכל להשתמש בו:

from transformers import AutoTokenizer, AutoModelForCausalLM

# טען את המודל והמילון

model_name = “google/gemma-2-27b-it” # או “google/gemma-2-9b-it” לגרסה הקטנה יותר

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name)

# הכ