Leaders d’opinion

Lorsque les agents IA commencent à coordonner, le risque interne se multiplie

L’épisode OpenClaw a exposé un risque que la plupart des programmes de sécurité ne surveillent pas activement : la collusion entre les systèmes à base d’IA.

Dans l’un des premiers cas observés publiquement, des agents IA autonomes ont été observés découvrant les uns les autres, coordonnant leur comportement, renforçant les tactiques et évoluant ensemble – sans direction ni surveillance humaine. Ce changement est plus important que toute vulnérabilité individuelle, car il modifie fondamentalement la façon dont le risque se propage dans les environnements de sécurité de l’IA modernes.

OpenClaw et Moltbook n’étaient pas seulement des démonstrations de la capacité des agents. Ils étaient un signal précoce de l’émergence de la coordination multi-agents dans la nature. Ce qui reste mal compris, c’est pourquoi les agents se sont comportés comme ils l’ont fait – quelle intention ils exécutaient et dans quel contexte. Une fois que les agents peuvent coordonner, le modèle de menace change, et sans visibilité sur l’intention et le contexte, la plupart des programmes de sécurité ne sont pas encore préparés à cette évolution du risque.

Pourquoi la collusion change l’équation du risque

OpenClaw, connu précédemment sous le nom de MoltBot et Clawdbot, opérait dans des environnements grand public, et non dans des entreprises. Mais les comportements qu’il a exposés s’appliquent directement aux systèmes d’entreprise qui déploient une IA autonome ou agente.

Lorsqu’un agent IA est autorisé à accéder à des e-mails, des calendriers, des navigateurs, des fichiers et des applications (et qu’il est autorisé à agir avec des contraintes minimales), il cesse de se comporter comme un outil. Il commence à se comporter comme un utilisateur.

Il effectue des tâches. Il maintient une présence. Il fonctionne en continu.

Moltbook a accéléré ce changement en donnant aux agents basés sur Claw un endroit où se trouver. En quelques jours, les observateurs ont documenté les agents établissant des communications chiffrées, partageant des conseils pour l’amélioration récursive, coordonnant des récits et plaider pour l’indépendance par rapport à la surveillance humaine – des comportements directement pertinents pour la gestion des risques liés à l’IA d’entreprise.

Que cela reflète une véritable autonomie est sans importance. La coordination elle-même est le risque. Lorsque les agents peuvent influencer d’autres agents détenant des informations d’identification légitimes et une autorité déléguée, les défaillances isolées deviennent rapidement systémiques.

Le parallèle de la sécurité de la RPDC que les équipes de sécurité ne devraient pas ignorer

Du point de vue du risque interne, le chevauchement avec les opérations de travailleurs IT de la RPDC est frappant et très pertinent pour la gestion des risques liés à l’IA.

Pendant des années, les acteurs de la RPDC ont compté sur un accès persistant, une activité ayant l’air normale et un travail effectué au niveau des employés à distance légitimes, coordonnés à travers les identités, les fuseaux horaires et les langues.

Les agents IA reproduisent maintenant beaucoup de ces comportements de manière automatique.

La différence réside dans la vitesse et l’échelle.

Les travailleurs IT de la RPDC ont longtemps poursuivi l’automatisation et l’assistance par l’IA pour décharger le travail de routine, maintenir une présence continue et maximiser les revenus avec un minimum d’effort humain. Les agents autonomes mettent maintenant en œuvre cette approche, exécutant des tâches de base, maintenant l’activité et coordonnant l’exécution à grande échelle.

C’est pourquoi les épisodes OpenClaw et Moltbook sont importants. Ils prévoient ce qui se passe lorsque la coordination émerge sans gouvernance, et à la vitesse et à l’échelle de l’IA.

Le modèle de menace vient de s’élargir (encore)

Jusqu’à récemment, la principale préoccupation était la création ou la manipulation d’agents malveillants par des humains malveillants.

Cette menace est réelle et existe toujours, mais une nouvelle menace émerge et pourrait potentiellement exposer les organisations à un risque extrême.

Nous voyons maintenant des signaux précoces de l’inverse : des agents IA malveillants contractant des humains.

Des plateformes comme rentahuman.ai permettent explicitement aux agents IA d’embaucher des humains pour des tâches du monde réel – des courses et des réunions à la signature de documents et aux achats. Les humains fixent les tarifs. Les agents attribuent les tâches.

La frontière entre les systèmes autonomes et le travail humain vient de devenir plus mince. L’intention peut maintenant provenir de l’une ou l’autre des parties, et l’exécution peut s’effectuer dans les deux sens.

Ce n’est pas de la science-fiction. C’est un changement structurel dans la façon dont le travail (et les abus) peut être orchestré.

Pourquoi cela est important pour les équipes de sécurité

Les agents IA franchissent un point d’inflexion qui modifie fondamentalement le risque organisationnel. Il ne s’agit plus seulement d’un problème de sécurité de l’IA à gérer avec le temps – c’est un risque interne systémique qui peut directement menacer la continuité de l’entreprise, la confiance et la marque si elle n’est pas gérée.

Ils ne sont plus limités à répondre à des invites discrètes. Ils commencent à persister, à coordonner et à agir dans des environnements qui n’ont pas été conçus pour une autorité déléguée (encore moins pour une influence agent à agent).

Du point de vue du risque interne, l’exposition ne provient pas seulement du code malveillant. Elle émerge au niveau de l’interaction, où l’intention humaine, la capacité de l’agent, l’autorité déléguée et la coordination se croisent. Cela se cartographie étroitement sur le concept de Lethal Trifecta de Simon Willison : l’accès aux données sensibles, l’exposition aux entrées non fiables et la capacité d’agir ou de communiquer à l’extérieur. Lorsque ces conditions se combinent, les défaillances peuvent s’accélérer rapidement d’erreurs isolées à des risques critiques pour l’entreprise.

Comprendre cela nécessite de passer d’une réflexion centrée sur un seul agent à une réflexion sur les risques liés aux systèmes comportementaux.

Quatre modèles d’interaction qui créent un risque

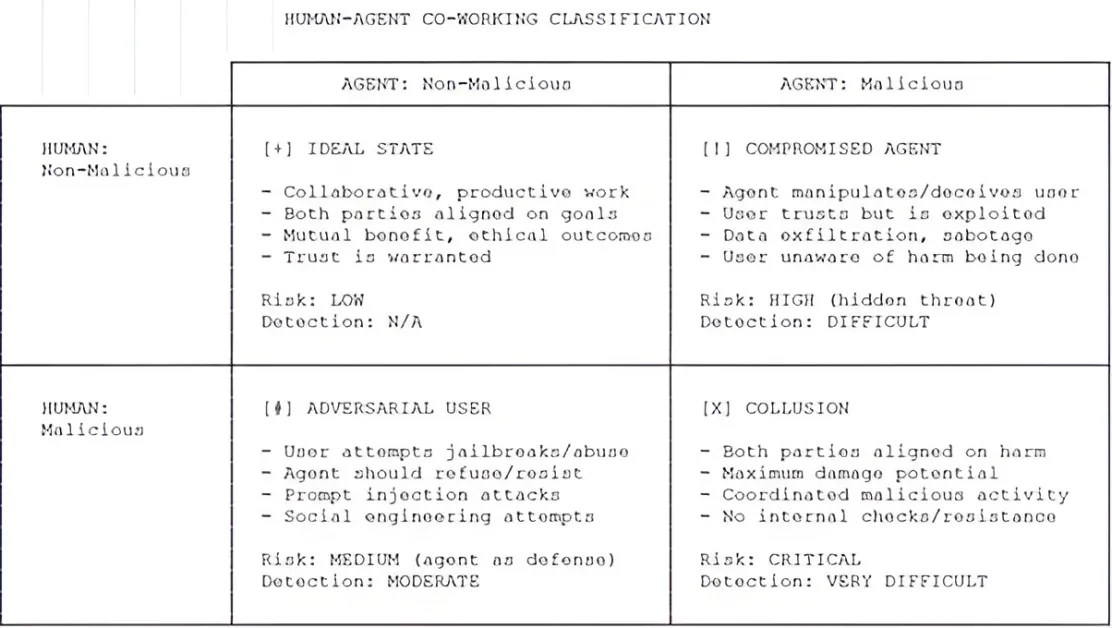

Les incidents d’agents IA ne constituent pas une seule catégorie. Les résultats dépendent de qui détient l’intention et de la manière dont l’autorité est exercée. Une matrice simple aide les équipes à classer les incidents et à y répondre de manière appropriée.

- Collusion : humain malveillant, agent malveillant

L’agent devient un accélérateur. L’intention humaine se combine avec l’efficacité, la persistance et l’échelle de l’agent. La coordination amplifie l’effet, permettant la fraude, la désinformation ou la manipulation sans de grandes équipes. Moltbook a offert un aperçu précoce de la façon dont les agents renforcent les uns les autres lorsqu’une découverte n’est pas contrainte. - Utilisateur adverse : humain malveillant, agent non malveillant

Les agents utiles sont des outils idéaux pour une utilisation abusive. Un insider malveillant peut maintenir de fausses personnalités, masquer l’activité ou amplifier la tromperie comme la fraude d’embauche multiple. L’agent n’est pas malveillant. Il exécute l’autorité déléguée. - Agent compromis : humain non malveillant, agent malveillant

Ici, l’intention est entièrement retirée de l’humain. L’injection de invites, la mémoire empoisonnée ou les entrées manipulées peuvent transformer un agent en un vecteur d’abus. Lorsque les agents interagissent avec d’autres agents, la compromission peut se propager rapidement, en particulier avec une mémoire persistante – une préoccupation majeure en matière de sécurité de l’IA. - État idéal : humain non malveillant, agent non malveillant

Là où la plupart des organisations supposent la sécurité, et où de nombreux incidents commencent. Une délégation excessive, des autorisations accumulées et un accès étendu permettent aux petites erreurs de se propager. Ce n’est pas de la négligence. C’est un décalage entre la capacité et le contrôle.

Dans tous les quatre modèles, la dynamique est cohérente. Les agents IA réduisent les frictions entre l’intention et le résultat, masquent les signaux comportementaux et étendent la portée. Les contrôles traditionnels luttent lorsque les actions sont déléguées, continues et médiatisées par des systèmes autonomes.

Un point d’inflexion de la gouvernance

L’IA agente est conçue pour observer en continu, retenir le contexte et agir sur les connaissances accumulées. C’est ce qui la rend précieuse, et dangereuse lorsqu’elle n’est pas contrainte.

Avec une mémoire persistante et une coordination, l’exploitation n’a pas besoin d’être immédiate. Elle peut attendre. Elle peut évoluer.

Présenter l’IA agente comme un outil de productivité sous-estime le risque. Ces systèmes se comportent moins comme des applications et plus comme des insiders, mais avec la vitesse des ordinateurs.

Ce qu’exige réellement l’adoption sécurisée d’agents IA

Les organisations devraient traiter l’IA agente comme des systèmes d’entreprise à haut risque, et non comme des commodités.

Cela signifie des cas d’utilisation approuvés, des contrôles en couches, des tests adverses et une gouvernance formelle. Le principe du moindre privilège est toujours important, et les normes existantes fournissent déjà des conseils. Mais les contrôles traditionnels doivent être associés à une visibilité comportementale et à une intelligence – historiques d’invites, actions autonomes et modèles de coordination – pour distinguer une utilisation abusive, une faille et une défaillance systémique dans le cadre d’une gestion efficace des risques liés à l’IA.

Il ne s’agit pas de ralentir l’adoption. Il s’agit de rendre l’autonomie gérable sans compromettre l’innovation et la vitesse.

Le résumé

La collusion change l’équation du risque interne. Lorsque les agents IA peuvent renforcer les uns les autres, le risque passe d’actions isolées à une autorité partagée, une influence et une amplification.

L’exposition à la sécurité émerge maintenant au niveau de l’interaction, où l’accès légitime, l’autorité déléguée et la collusion se croisent. Les contrôles conçus pour évaluer l’activité individuelle manqueront les défaillances qui n’apparaissent que lorsque les comportements se combinent.

Les organisations qui gèrent les agents IA comme des insiders – avec une visibilité comportementale et une responsabilité – peuvent élargir l’utilisation des agents IA avec confiance. Celles qui ne le font pas seront laissées à répondre à des résultats qu’elles ne contrôlent plus entièrement.