Intelligence artificielle

Surcharge des grands modèles de langage avec la prédiction multi-jetons

By

Aayush Mittal Mittal

Les grands modèles de langage (LLM) comme GPT, LLaMA, et d’autres ont pris le monde d’assaut avec leur capacité remarquable à comprendre et générer du texte similaire à celui des humains. Cependant, malgré leurs capacités impressionnantes, la méthode standard de formation de ces modèles, connue sous le nom de “prédiction du jeton suivant”, présente certaines limitations inhérentes.

Dans la prédiction du jeton suivant, le modèle est formé pour prédire le mot suivant dans une séquence donnée les mots précédents. Bien que cette approche ait prouvé son efficacité, elle peut conduire à des modèles qui luttent avec les dépendances à long terme et les tâches de raisonnement complexes. De plus, la discordance entre le régime d’entraînement par forcing de l’enseignant et le processus de génération autoregressif pendant l’inférence peut entraîner des performances sous-optimales.

Un article de recherche récent de Gloeckle et al. (2024) de Meta AI introduit un nouveau paradigme de formation appelé “prédiction multi-jetons” qui vise à résoudre ces limitations et à surcharger les grands modèles de langage. Dans cet article de blog, nous allons plonger dans les concepts de base, les détails techniques et les implications potentielles de cette recherche innovante.

Prédiction d’un jeton : l’approche conventionnelle

Avant de plonger dans les détails de la prédiction multi-jetons, il est essentiel de comprendre l’approche conventionnelle qui a été le cheval de bataille de la formation des grands modèles de langage pendant des années – la prédiction d’un jeton, également connue sous le nom de prédiction du jeton suivant.

Le paradigme de prédiction du jeton suivant

Dans le paradigme de prédiction du jeton suivant, les modèles de langage sont formés pour prédire le mot suivant dans une séquence donnée le contexte précédent. Plus formellement, le modèle est chargé de maximiser la probabilité du jeton suivant xt+1, étant donné les jetons précédents x1, x2, …, xt. Cela est généralement réalisé en minimisant la perte d’entropie croisée :

L = -Σt log P(xt+1 | x1, x2, …, xt)

Cet objectif de formation simple mais puissant a été la base de nombreux modèles de langage réussis, tels que GPT (Radford et al., 2018), BERT (Devlin et al., 2019) et leurs variantes.

Forcing de l’enseignant et génération autoregressive

La prédiction du jeton suivant repose sur une technique de formation appelée “forcing de l’enseignant” où le modèle est fourni avec la vérité de terrain pour chaque jeton futur pendant la formation. Cela permet au modèle d’apprendre à partir du contexte et des séquences cibles corrects, facilitant ainsi une formation plus stable et plus efficace.

Cependant, pendant l’inférence ou la génération, le modèle fonctionne de manière autoregressive, en prédissant un jeton à la fois en fonction des jetons générés précédemment. Cette discordance entre le régime d’entraînement (forcing de l’enseignant) et le régime d’inférence (génération autoregressive) peut entraîner des écarts potentiels et des performances sous-optimales, en particulier pour les séquences plus longues ou les tâches de raisonnement complexes.

Limitations de la prédiction du jeton suivant

Bien que la prédiction du jeton suivant ait été remarquablement réussie, elle présente également certaines limitations :

- Focus à court terme : En ne prédissant que le jeton suivant, le modèle peut lutter pour capturer les dépendances à long terme et la structure globale et la cohérence du texte, ce qui peut entraîner des incohérences ou des générations incohérentes.

- Accrochage aux modèles locaux : Les modèles de prédiction du jeton suivant peuvent s’accrocher aux modèles locaux dans les données de formation, ce qui rend difficile la généralisation à des scénarios hors distribution ou à des tâches qui nécessitent un raisonnement plus abstrait.

- Capacités de raisonnement : Pour les tâches qui impliquent un raisonnement multi-étapes, une pensée algorithmique ou des opérations logiques complexes, la prédiction du jeton suivant peut ne pas fournir suffisamment d’inductions ou de représentations pour soutenir de manière efficace ces capacités.

- Inefficacité des échantillons : En raison de la nature locale de la prédiction du jeton suivant, les modèles peuvent nécessiter des jeux de données de formation plus importants pour acquérir les connaissances et les compétences en raisonnement nécessaires, ce qui peut entraîner des inefficacités d’échantillonnage.

Ces limitations ont motivé les chercheurs à explorer des paradigmes de formation alternatifs, tels que la prédiction multi-jetons, qui vise à résoudre certaines de ces limites et à débloquer de nouvelles capacités pour les grands modèles de langage.

En contrastant l’approche conventionnelle de prédiction d’un jeton avec la technique novatrice de prédiction multi-jetons, les lecteurs peuvent mieux apprécier la motivation et les avantages potentiels de cette dernière, ce qui ouvre la voie à une exploration plus approfondie de cette recherche innovante.

Qu’est-ce que la prédiction multi-jetons ?

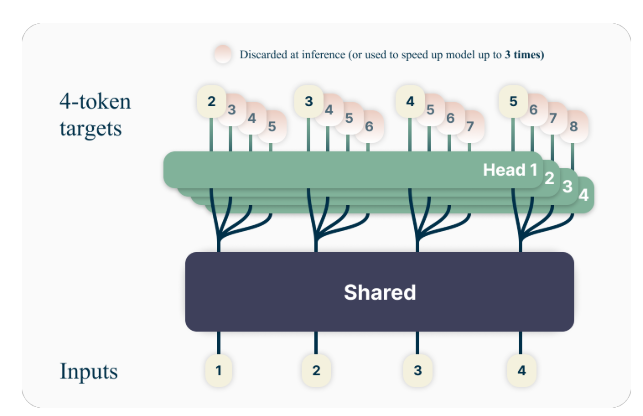

L’idée clé derrière la prédiction multi-jetons est de former les modèles de langage pour prédire plusieurs jetons futurs simultanément, plutôt que de prédire seulement le jeton suivant. Plus précisément, pendant la formation, le modèle est chargé de prédire les n jetons suivants à chaque position dans le corpus de formation, en utilisant n têtes de sortie indépendantes fonctionnant sur un tronc de modèle partagé.

Par exemple, avec une configuration de prédiction de 4 jetons, le modèle serait formé pour prédire les 4 jetons suivants à la fois, étant donné le contexte précédent. Cette approche encourage le modèle à capturer les dépendances à long terme et à développer une meilleure compréhension de la structure globale et de la cohérence du texte.

Un exemple simple

Pour mieux comprendre le concept de prédiction multi-jetons, considérons un exemple simple. Supposons que nous ayons la phrase suivante :

“Le rapide renard brun saute par-dessus le chien paresseux.”

Dans l’approche standard de prédiction d’un jeton, le modèle serait formé pour prédire le mot suivant étant donné le contexte précédent. Par exemple, étant donné le contexte “Le rapide renard brun saute par-dessus le”, le modèle serait chargé de prédire le mot suivant, “chien”.

Avec la prédiction multi-jetons, cependant, le modèle serait formé pour prédire plusieurs mots futurs à la fois. Par exemple, si nous définissons n=4, le modèle serait formé pour prédire les 4 mots suivants simultanément. Étant donné le même contexte “Le rapide renard brun saute par-dessus le”, le modèle serait chargé de prédire la séquence “chien paresseux” (notez l’espace après “chien” pour indiquer la fin de la phrase).

En formant le modèle pour prédire plusieurs jetons futurs à la fois, il est encouragé à capturer les dépendances à long terme et à développer une meilleure compréhension de la structure globale et de la cohérence du texte.

Détails techniques

Les auteurs proposent une architecture simple mais efficace pour mettre en œuvre la prédiction multi-jetons. Le modèle se compose d’un tronc de transformateur partagé qui produit une représentation latente du contexte d’entrée, suivi de n couches de transformateur indépendantes (têtes de sortie) qui prédissent les jetons futurs respectifs.

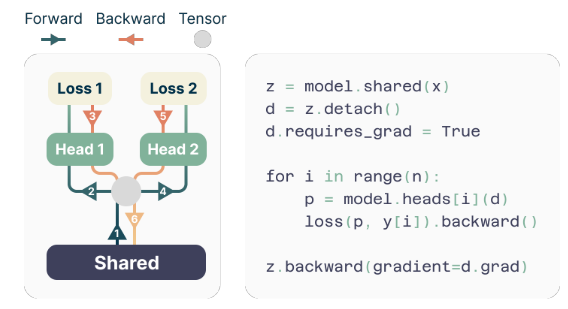

Pendant la formation, les passes avant et arrière sont soigneusement orchestrées pour minimiser l’empreinte mémoire de la GPU. Le tronc partagé calcule la représentation latente, puis chaque tête de sortie effectue séquentiellement sa passe avant et arrière, accumulant les gradients au niveau du tronc. Cette approche évite de matérialiser tous les vecteurs de logits et leurs gradients simultanément, réduisant ainsi l’utilisation de mémoire GPU de pointe de O(nV + d) à O(V + d), où V est la taille du vocabulaire et d est la dimension de la représentation latente.

La mise en œuvre à mémoire efficace

L’un des défis de la formation des prédicteurs multi-jetons est de réduire leur utilisation de mémoire GPU. Puisque la taille du vocabulaire (V) est généralement beaucoup plus grande que la dimension de la représentation latente (d), les vecteurs de logits deviennent le goulet d’étranglement de l’utilisation de mémoire GPU.

Pour relever ce défi, les auteurs proposent une mise en œuvre à mémoire efficace qui adapte soigneusement la séquence des opérations avant et arrière. Au lieu de matérialiser tous les logits et leurs gradients simultanément, la mise en œuvre calcule séquentiellement les passes avant et arrière pour chaque tête de sortie indépendante, accumulant les gradients au niveau du tronc.

Cette approche évite de stocker tous les vecteurs de logits et leurs gradients en mémoire simultanément, réduisant ainsi l’utilisation de mémoire GPU de pointe de O(nV + d) à O(V + d), où n est le nombre de jetons futurs prédits.

Avantages de la prédiction multi-jetons

L’article de recherche présente plusieurs avantages convaincants de l’utilisation de la prédiction multi-jetons pour former les grands modèles de langage :

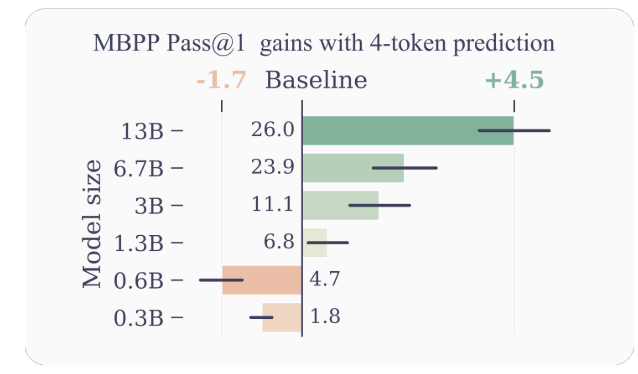

- Efficacité d’échantillonnage améliorée : En encourageant le modèle à prédire plusieurs jetons futurs à la fois, la prédiction multi-jetons amène le modèle à une meilleure efficacité d’échantillonnage. Les auteurs démontrent des améliorations significatives des performances sur les tâches de compréhension et de génération de code, avec des modèles allant jusqu’à 13 milliards de paramètres qui résolvent environ 15 % plus de problèmes en moyenne.

- Inférence plus rapide : Les têtes de sortie supplémentaires formées avec la prédiction multi-jetons peuvent être utilisées pour la décodage spéculatif auto-, une variante du décodage spéculatif qui permet la prédiction parallèle de jetons. Cela entraîne des temps d’inférence jusqu’à 3 fois plus rapides sur une large gamme de tailles de lots, même pour les grands modèles.

- Promotion des dépendances à long terme : La prédiction multi-jetons encourage le modèle à capturer les dépendances à long terme et les modèles dans les données, ce qui est particulièrement bénéfique pour les tâches qui nécessitent une compréhension et un raisonnement sur des contextes plus larges.

- Raisonnement algorithmique : Les auteurs présentent des expériences sur des tâches synthétiques qui démontrent la supériorité des modèles de prédiction multi-jetons dans le développement de têtes d’induction et de capacités de raisonnement algorithmique, en particulier pour les tailles de modèles plus petites.

- Cohérence et consistance : En formant le modèle pour prédire plusieurs jetons futurs simultanément, la prédiction multi-jetons encourage le développement de représentations cohérentes et consistantes. Cela est particulièrement bénéfique pour les tâches qui nécessitent la génération de texte plus long et plus cohérent, telles que la narration, l’écriture créative ou la génération de manuels instructifs.

- Généralisation améliorée : Les expériences des auteurs sur les tâches synthétiques suggèrent que les modèles de prédiction multi-jetons présentent de meilleures capacités de généralisation, en particulier dans les paramètres hors distribution. Cela est potentiellement dû à la capacité du modèle à capturer les modèles et les dépendances à long terme, ce qui l’aide à extrapoler plus efficacement vers des scénarios inconnus.

Exemples et intuitions

Pour fournir plus d’intuitions sur pourquoi la prédiction multi-jetons fonctionne si bien, considérons quelques exemples :

- Génération de code : Dans le contexte de la génération de code, prédire plusieurs jetons simultanément peut aider le modèle à comprendre et à générer des structures de code plus complexes. Par exemple, lors de la génération d’une définition de fonction, prédire seulement le jeton suivant peut ne pas fournir suffisamment de contexte pour que le modèle génère correctement la signature de la fonction. Cependant, en prédissant plusieurs jetons à la fois, le modèle peut mieux capturer les dépendances entre le nom de la fonction, les paramètres et le type de retour, conduisant à une génération de code plus précise et plus cohérente.

- Raisonnement en langage naturel : Considérons un scénario où un modèle de langage est chargé de répondre à une question qui nécessite un raisonnement sur plusieurs étapes ou pièces d’information. En prédissant plusieurs jetons simultanément, le modèle peut mieux capturer les dépendances entre les différentes composantes du processus de raisonnement, conduisant à des réponses plus cohérentes et plus précises.

- Génération de texte long : Lors de la génération de texte long, tels que des histoires, des articles ou des rapports, maintenir la cohérence et la consistance sur une période prolongée peut être difficile pour les modèles de langage formés avec la prédiction d’un jeton. La prédiction multi-jetons encourage le modèle à développer des représentations qui capturent la structure globale et le flux du texte, conduisant potentiellement à des générations de texte long plus cohérentes et plus consistantes.

Limitations et directions futures

Bien que les résultats présentés dans l’article soient impressionnants, il existe quelques limitations et questions ouvertes qui nécessitent une investigation plus approfondie :

- Nombre optimal de jetons : L’article explore différentes valeurs de n (le nombre de jetons futurs à prédire) et constate que n=4 fonctionne bien pour de nombreuses tâches. Cependant, la valeur optimale de n peut dépendre de la tâche spécifique, du jeu de données et de la taille du modèle. Développer des méthodes pour déterminer la valeur optimale de n pourrait conduire à de meilleures performances.

- Taille du vocabulaire et tokenisation : Les auteurs notent que la taille du vocabulaire et la stratégie de tokenisation optimales pour les modèles de prédiction multi-jetons peuvent différer de celles utilisées pour les modèles de prédiction d’un jeton. Explorer cet aspect pourrait conduire à de meilleurs compromis entre la longueur de la séquence compressée et l’efficacité computationnelle.

- Pertes de prédiction auxiliaires : Les auteurs suggèrent que leur travail pourrait susciter l’intérêt pour le développement de nouvelles pertes de prédiction auxiliaires pour les grands modèles de langage, au-delà de la prédiction standard d’un jeton. Investiguer ces pertes auxiliaires alternatives et leurs combinaisons avec la prédiction multi-jetons est une direction de recherche passionnante.

- Compréhension théorique : Bien que l’article fournisse certaines intuitions et preuves empiriques de l’efficacité de la prédiction multi-jetons, une compréhension théorique plus approfondie de pourquoi et de la façon dont cette approche fonctionne si bien serait précieuse.

Conclusion

L’article de recherche “Meilleurs et plus rapides grands modèles de langage via la prédiction multi-jetons” de Gloeckle et al. introduit un nouveau paradigme de formation qui a le potentiel de considérablement améliorer les performances et les capacités des grands modèles de langage. En formant les modèles pour prédire plusieurs jetons futurs simultanément, la prédiction multi-jetons encourage le développement de dépendances à long terme, de capacités de raisonnement algorithmique et d’une meilleure efficacité d’échantillonnage.

La mise en œuvre technique proposée par les auteurs est élégante et computationnellement efficace, ce qui la rend applicable à la formation de grands modèles de langage. De plus, la capacité à utiliser le décodage spéculatif auto- pour une inférence plus rapide est un avantage pratique significatif.

Bien qu’il existe encore des questions ouvertes et des domaines à explorer, cette recherche représente une étape passionnante dans le domaine des grands modèles de langage. À mesure que la demande de modèles de langage plus capables et plus efficaces continue de croître, la prédiction multi-jetons pourrait devenir un élément clé dans la prochaine génération de ces puissants systèmes d’IA.

J'ai passé les cinq dernières années à me plonger dans le monde fascinant de l'apprentissage automatique et de l'apprentissage profond. Ma passion et mon expertise m'ont conduit à contribuer à plus de 50 projets de génie logiciel divers, avec un accent particulier sur l'IA/ML. Ma curiosité permanente m'a également attiré vers le traitement automatique des langues, un domaine que je suis impatient d'explorer plus en détail.

You may like

-

Effacer des objets et des personnes de vidéos avec l’IA

-

La programmation Vibe souffre lorsque le rôle de l’IA s’étend

-

Le mur GPU se fissure : la révolution invisible dans les architectures post-Transformers

-

Google NotebookLM présente la fonctionnalité de recherche approfondie

-

Le scientifique en chef de l’IA de Meta, Yann LeCun, prévoit une sortie de startup

-

Comment faire passer des articles scientifiques absurdes devant des réviseurs IA