Interviews

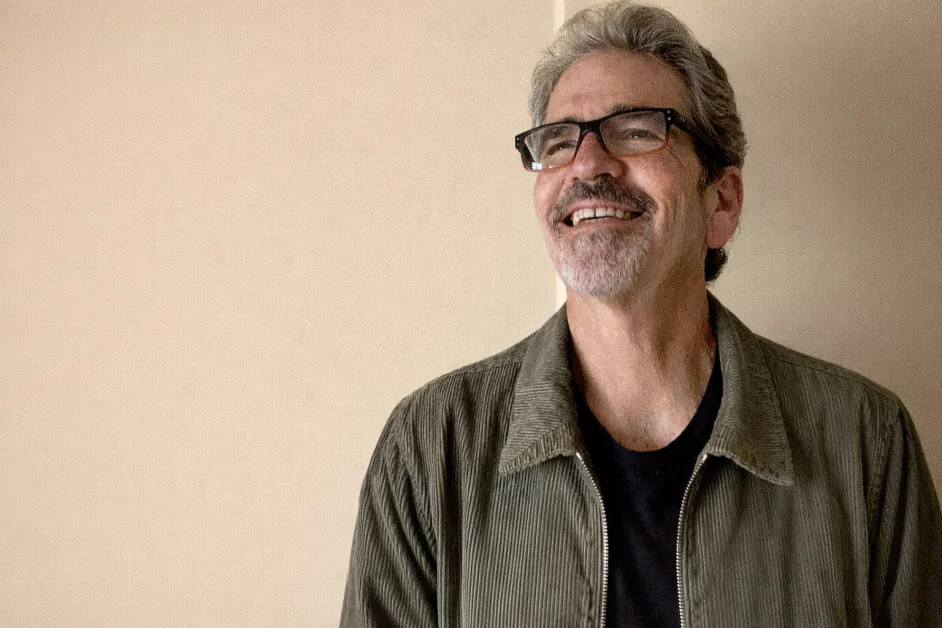

Série d'entrevues avec Steve Nemzer, directeur principal, Croissance et innovation en IA, TELUS Numérique

Steve NemzerDirecteur principal, Croissance et innovation en IA chez TELUS Digital, il pilote des initiatives visant à faire progresser les données et l'infrastructure d'entraînement des systèmes d'intelligence artificielle de nouvelle génération. Ses travaux comprennent le développement d'ensembles de données pour les modèles de recherche approfondie, les environnements d'apprentissage par renforcement, les données de modélisation du monde, les initiatives d'IA souveraine et les cadres d'atténuation des risques liés à l'IA. Il accorde une grande importance aux pratiques responsables en matière d'IA, notamment la correction des biais dans les ensembles de données et la garantie de conditions de travail équitables pour les formateurs d'IA. Auparavant, Nemzer a fondé VeriTest Labs, aidant des leaders technologiques de premier plan tels que Microsoft, Intel, Oracle et Sun Microsystems à bâtir des écosystèmes logiciels tiers florissants, avant que l'entreprise ne soit acquise par Lionbridge.

TELUS numérique est une entreprise mondiale de services technologiques qui aide les organisations à concevoir, développer et exploiter des plateformes numériques et des solutions basées sur l'IA. Présente dans des dizaines de pays, elle propose des services tels que la fourniture de données d'entraînement et d'annotation pour l'IA, l'ingénierie de produits numériques et la gestion de l'expérience client. Ses plateformes et services accompagnent les entreprises de divers secteurs, notamment la technologie, la finance, la santé, les télécommunications et les jeux vidéo, dans la modernisation de leurs opérations et le déploiement de capacités d'IA avancées.

Compte tenu de votre expérience en matière de tests d'IA, de validation des données et de déploiement responsable, comment envisagez-vous le passage d'une IA générative axée sur le langage à des modèles du monde qui visent à raisonner sur des situations et des résultats réels, en particulier dans votre rôle actuel chez TELUS Digital ?

Les grands modèles de langage (LLM) sont fondamentalement des systèmes de prédiction de schémas. Ils génèrent des réponses en prédisant le prochain jeton à partir de schémas appris grâce à de vastes corpus statiques. Bien que cela puisse s'apparenter à un raisonnement, le modèle ne modélise pas réellement la façon dont les actions modifient l'état du monde.

Les modèles du monde adoptent une approche différente. Au lieu de prédire le mot ou le jeton suivant, ils visent à prédire l'état suivant d'un système en modélisant les transitions d'état. Cela permet aux systèmes de simuler l'évolution des environnements en réponse aux actions. En pratique, cela ouvre la voie au raisonnement hypothétique, où un modèle peut évaluer différents résultats possibles avant de prendre une décision. Pour les systèmes interactifs, cela peut favoriser une prise de décision et une planification plus fiables.

Ce changement modifie également notre conception du déploiement responsable. Avec les systèmes d'IA génératifs traditionnels, l'attention s'est surtout portée sur des problèmes tels que les biais et les hallucinations. À mesure que les modèles évoluent vers un raisonnement sur les environnements et les actions, d'autres risques deviennent plus prégnants.

Par exemple, les organisations doivent tenir compte du décalage entre simulation et réalité, car les comportements acquis dans des environnements simulés peuvent ne pas se transposer fidèlement dans des conditions réelles. Le décalage de distribution devient également un enjeu majeur, les environnements rencontrés par les modèles lors de leur déploiement pouvant différer des données utilisées pour leur entraînement.

C’est là que les tests et la validation deviennent essentiels, un aspect majeur de mon rôle chez TELUS Numérique. À mesure que les systèmes d’IA évoluent au-delà de la génération de langage pour devenir des systèmes interagissant avec leur environnement et prenant des décisions, les organisations ont besoin de cadres d’évaluation rigoureux afin de garantir la fiabilité des modèles en conditions réelles.

Beaucoup connaissent les grands modèles de langage, mais beaucoup moins comprennent les modèles du monde. En termes simples, quel problème les modèles du monde tentent-ils de résoudre, problème auquel les grands modèles de langage sont fondamentalement confrontés ?

Un modèle du monde est un système capable de prédire « ce qui va se passer ensuite » étant donné un état actuel et une action. La formule est : État + Action → État suivant

Si je tiens une pomme et que je la lâche, un modèle du monde prédit qu'elle va tomber. Ce modèle ne se contente pas de savoir à quoi ressemblent les pommes ou ce que les gens disent à propos de leur chute ; il prédit la conséquence en se basant sur une compréhension des lois de la physique. Un modèle du monde sophistiqué prédira ce qui se passerait si je faisais la même chose à bord de la Station spatiale internationale plutôt qu'à la surface de la Terre.

C'est différent d'un modèle linéaire de langage (LLM). Un LLM prédit : « Étant donné cette séquence de jetons, quel jeton vient ensuite ? » Il est entraîné sur du texte – ce que les humains ont écrit sur le monde, et non sur le monde lui-même. Il peut vous dire que les pommes qui tombent tombent parce qu'il a lu des descriptions à ce sujet. Mais il ne possède pas de moteur physique interne qui simule la chute.

En d'autres termes, les modèles linguistiques sont performants pour prédire statistiquement le mot suivant dans une réponse à une question, mais la compréhension du monde réel dépasse la simple description et la cohésion du langage. Les modèles du monde visent à comprendre comment les situations évoluent étape par étape, quel sera l'état suivant compte tenu de l'état actuel et de l'action à venir, et quelles sont les contraintes en jeu.

Les modèles du monde sont souvent décrits comme permettant aux systèmes d'IA de simuler des résultats avant d'agir. À quoi cela ressemble-t-il en pratique, et sommes-nous proches de voir cela fonctionner de manière fiable en dehors des environnements de recherche ?

L'une des difficultés pour répondre à cette question réside dans l'utilisation assez vague du terme « modèle du monde », dont la signification tend à varier selon le contexte. On peut définir simplement un modèle du monde comme un système permettant à un agent de simuler son environnement actuel, de prédire les états futurs et d'anticiper les conséquences. Les chercheurs ont tendance à catégoriser les modèles du monde de manière plus précise, en fonction de leurs méthodes de représentation et de traitement. Il existe des modèles du monde latents, qui distillent l'« essence » d'un environnement dans un espace compact et ciblé. Il existe des modèles du monde génératifs qui « comprennent » la physique pour créer des représentations visuelles image par image, et il existe des modèles JEPA (Joint-Embedding Predictive Architecture) qui prédisent les résultats à partir d'actions passées.

Les modèles de monde latents ne sont plus cantonnés aux laboratoires de recherche et sont utilisés dans des applications telles que la conduite autonome, la gestion d'entrepôts, les opérations industrielles et l'agriculture. Les modèles de monde génératifs, quant à eux, sont utilisés pour la création de données synthétiques destinées au développement de moteurs de jeux, aux véhicules autonomes, à l'intelligence artificielle incarnée pour la simulation vidéo de mouvements humains et à la création de rendus architecturaux.

L'approche JEPA, plébiscitée par des sommités du secteur comme Yan LeCun, prédit les résultats dans un espace de représentation abstrait plutôt que de générer des pixels. Si les robots ont longtemps été confinés à des environnements contrôlés, JEPA change la donne en leur permettant d'évoluer dans des contextes réels et ouverts. Les véhicules autonomes en sont un bon exemple : certains exploitent Genie 3 pour générer des simulations interactives hyperréalistes à des fins d'entraînement et pour mieux gérer des situations exceptionnelles comme les chantiers.

De toute évidence, de nombreux tests de sécurité et de fiabilité supplémentaires sont nécessaires pour passer à l'échelle supérieure du passage de ces modèles d'environnements contrôlés à des environnements réels.

Du point de vue de l'entreprise, dans quel domaine pensez-vous que les modèles mondiaux apporteront en premier lieu une valeur significative : la robotique, les systèmes de décision autonomes, les jumeaux numériques ou des contextes commerciaux plus abstraits ?

J'ai le sentiment que les jumeaux numériques apporteront d'abord une réelle valeur ajoutée pratique. En reproduisant l'état d'un système réel, nous pouvons tester différents scénarios avant d'agir. Par exemple, dans une chaîne d'approvisionnement, un fabricant peut créer un jumeau numérique de son réseau de partenaires. Cette simulation, alimentée par des données de capteurs, des journaux et des données de télémétrie, peut répondre à des questions comme : « Que se passerait-il si le détroit d'Ormuz était fermé ? » Ainsi, nous pouvons tester le réacheminement des expéditions avant de modifier la logistique réelle. Cela nous permet de passer de la simple surveillance d'un système en temps réel à sa simulation.

L'exploitation concrète des modèles du monde pour la robotique progresse en parallèle. La capacité des robots à comprendre les propriétés fondamentales de la physique, comme le frottement sur une surface lors de la préhension d'un objet, accélérera considérablement le déploiement de l'IA incarnée.

Une grande partie de votre carrière a été consacrée à la collecte, à l'annotation et à la validation de jeux de données. Comment les défis liés aux données évoluent-ils lorsqu'on passe de l'entraînement sur des textes statiques à l'apprentissage de systèmes d'apprentissage sur le comportement du monde au fil du temps ?

La collecte de données nécessaire au développement de modèles du monde exige une refonte complète des méthodes d'entraînement LLM d'hier. Tout d'abord, nous ne disposons pas de gigantesques corpus de données de pré-entraînement, tels que les pétaoctets issus de Common Crawl et les milliards de pages web. Certains chercheurs en robotique estiment que nous ne possédons qu'un millième des données nécessaires à l'entraînement de l'intelligence physique et des modèles du monde, afin d'atteindre un niveau de performance équivalent à celui de GPT-2, par exemple.

Il faudra donc du temps pour constituer ces ensembles de données. Dans le cas de l'IA incarnée, nous aurons besoin de millions d'heures de données multisensorielles égocentriques annotées. Certaines seront issues de la téléopération, d'autres d'environnements synthétiques comme Isaac Sim. Chez TELUS Digital, nous sommes passés des données textuelles aux données multimodales, puis aux données multisensorielles et aux données de simulation. Notre solide expérience en matière de collecte et d'annotation de données en vision par ordinateur est un atout précieux. Nous sommes à la pointe dans ce domaine depuis de nombreuses années.

Outre la rareté des données de pré-entraînement et des données annotées pour le réglage fin, de nombreux autres défis d'entraînement se poseront lors du passage à l'échelle de l'apprentissage par renforcement. De nouveaux paradigmes transformateurs (sans jeu de mots) tels que les concepts de GPT et d'apprentissage par renforcement pourraient s'avérer nécessaires pour accélérer les progrès en matière d'efficacité des méthodes d'entraînement des modèles du monde.

Les modèles du monde influencent les décisions au-delà de la simple production de résultats. Quels nouveaux risques en matière de sécurité ou de gouvernance cela engendre-t-il par rapport aux systèmes d'IA générative ?

Les modèles du monde étant par nature conçus pour prendre en charge les opérations automatisées, de nombreux risques liés à la sécurité et à la gouvernance existent. Par conséquent, toutes les préoccupations que nous avons concernant la génération actuelle d'agents d'IA restent valables dans le contexte des modèles du monde. Un contrôle humain est indispensable pour toute décision importante, qu'elle concerne la sécurité des transports, la sécurité au travail, la santé, les finances ou les activités quotidiennes.

Un exemple propre aux modèles du monde est l'écart entre les données d'entraînement des simulations et les environnements réels. Une variation microscopique de la surface peut rendre le monde réel difficile pour des robots pourtant bien entraînés en simulation.

Un autre risque est lié au comportement humain. À mesure que les systèmes deviennent plus autonomes, les humains auront tendance à s'y fier fortement, la surveillance risque de se relâcher et, à terme, le système ne bénéficiera plus des réajustements nécessaires.

Les préjugés et la confiance demeurent des obstacles majeurs à l'adoption de l'IA. Comment ces préoccupations évoluent-elles lorsque les systèmes d'IA commencent à modéliser et à agir au sein d'environnements complexes, qu'ils soient réels ou sociaux ?

Du grand public aux dirigeants d'entreprise, la confiance dans les modèles d'IA est déjà assez faible et je ne vois pas cela changer beaucoup à court terme.

Les inquiétudes concernant la concentration du pouvoir de l'IA entre trop peu de mains, les suppressions d'emplois, les biais qui désavantagent les groupes sous-représentés, les décisions prises par les modèles affectant la santé, la carrière et les finances, l'utilisation de la propriété intellectuelle sans consentement, ainsi que les deepfakes, sont déjà très vives. Les dirigeants s'inquiètent de la gestion des transitions au sein des effectifs, de la confidentialité des données et de la conformité réglementaire, ainsi que du risque de perdre du terrain face à la concurrence dans cette « course aux armements » en matière d'IA.

Les récents développements concernant les pressions gouvernementales exercées sur les concepteurs de modèles fondamentaux d'IA pour assouplir les conditions d'utilisation relatives aux armes autonomes et à la surveillance de masse ne font qu'amplifier ces inquiétudes. Le déploiement à plus grande échelle de robots plus intelligents et plus autonomes, basés sur des modèles du monde numériques, aura le même effet.

D'un autre côté, on observe des poches d'adoption et de confiance généralisées envers l'IA. L'essor fulgurant des agents de codage ces derniers mois en est un exemple. Les responsables du développement logiciel leur font pleinement confiance, et l'on constate une transformation profonde des méthodes de développement, de la phase de prototypage jusqu'aux tests de régression post-lancement. Le monde du développement logiciel évolue à une vitesse vertigineuse, en grande partie grâce à la confiance accordée aux agents de codage performants. À mesure que la confiance des utilisateurs se développera dans d'autres cas d'usage, je m'attends à une adoption tout aussi rapide.

Pour instaurer la confiance, il est essentiel d'utiliser des ensembles de données et des environnements diversifiés lors des phases d'entraînement, et de mener des tests de résistance et des exercices d'intrusion approfondis afin de garantir la sécurité avant le déploiement. Un contrôle réglementaire proactif est également indispensable. Certains ont suggéré d'obliger les concepteurs de modèles de base à fournir des « rapports d'impact sociétal », similaires aux rapports d'impact environnemental (EIE), avant la publication de nouveaux modèles.

Chez TELUS Digital, une grande partie du travail consiste à déployer l'IA à grande échelle pour de véritables entreprises et de véritables utilisateurs. Comment des concepts tels que les modèles mondiaux s'articulent-ils avec des préoccupations pratiques comme la transparence, l'impact sur la main-d'œuvre et le maintien de la confiance des clients ?

Pour être clair, TELUS Digital travaille à la fois en amont, directement avec les concepteurs de modèles fondamentaux, et en aval, avec les entreprises qui déploient des modèles d'IA. Notre champ d'action est global :

La question des aspects pratiques est liée à la précédente, celle de la confiance. Penchons-nous sur la confiance des employés. À mesure que les IA basées sur des modèles du monde se généralisent, les dirigeants doivent faire preuve de transparence envers leurs employés, sous-traitants et clients. Une communication claire est indispensable concernant les points forts des modèles, leur méthode d'entraînement, les données utilisées, les garde-fous mis en place et le rôle du contrôle humain. Les dirigeants doivent démontrer aux employés actuels la valeur ajoutée de ces nouveaux modèles, par exemple en automatisant les tâches répétitives. Ils doivent également présenter des plans de transition pour les employés concernés, susceptibles d'évoluer vers de nouveaux emplois à mesure que les tâches traditionnelles sont de plus en plus automatisées. Les cols blancs sont déjà confrontés à cette évolution, et de nombreux emplois manuels seront impactés dans les années à venir par le développement de l'automatisation basée sur des modèles du monde.

Il existe un fossé grandissant entre la compréhension des chercheurs en IA et la perception du public. Comment les organisations peuvent-elles communiquer sur des avancées telles que les modèles du monde de manière à instaurer la confiance sans surestimer leurs capacités ?

Là encore, tout repose sur la transparence quant aux limites et aux points forts des modèles. Il est essentiel de communiquer sur la méthode d'entraînement mise en place pour atténuer les biais potentiels, ainsi que sur le contrôle humain existant. Quelques démonstrations concrètes des capacités et des cas d'utilisation des modèles, associées à des études longitudinales, peuvent grandement contribuer à renforcer la confiance du grand public et des professionnels.

Enfin, quelle est, selon vous, une idée fausse courante concernant les modèles du monde de l'IA, qu'elle soit excessivement optimiste ou excessivement prudente, qui doit être corrigée immédiatement ?

Dans la mesure où le grand public est peu informé sur les modèles mondiaux, une idée fausse répandue est que ces modèles doivent comprendre tous Pour être efficaces, les modèles mondiaux de physique et de sciences ne sont pas indispensables. Ils seront déployés plus rapidement qu'on ne le pense, car les cas d'utilisation individuels peuvent être ciblés. Un véhicule autonome a seulement besoin de comprendre la dynamique du trafic et la physique de la route, ainsi que l'influence des conditions actuelles (par exemple, la proximité d'une école primaire ou la présence de nombreux SUV imposants) sur sa vision et sa prise de décision. Il n'a pas besoin de connaître les principes physiques qui régissent la cuisson d'un soufflé pour fonctionner.

Merci pour cette excellente interview, les lecteurs qui souhaitent en savoir plus devraient visiter TELUS numérique.