Angle d’Anderson

PiedPiper-Style Decentralized Inference Services for AI ?

Est-ce que ‘BitTorrent pour l’IA’ est une possibilité imminente ?

Opinion Ayant terminé hier une reprise de la satire acerbe et divertissante de Mike Judge, Silicon Valley – dans laquelle un groupe de génies geek socialement maladroits tentent de créer un « nouveau Internet » appelé PiedPiper, via un réseau maillé installé sur les téléphones mobiles de tout le monde – j’ai été intéressé de voir la communauté HN engagée avec une nouvelle offre de nature similaire.

Eigen Labs’ DarkBloom se situe quelque part entre la notion égalitaire d’un réseau maillé décentralisé pour l’inférence IA et les motivations de profit de l’extraction de crypto-monnaies, permettant aux propriétaires de systèmes Mac Apple Silicon de transformer leur équipement en nœud d’inférence :

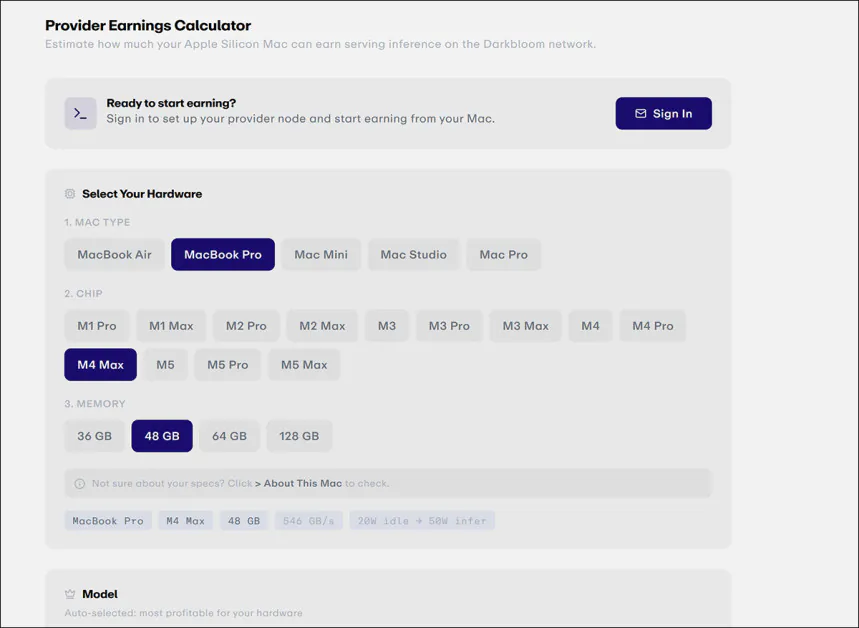

À partir de la section des gains du site Web de DarkBloom, les utilisateurs peuvent sélectionner quels équipements ils souhaitent louer et quels modèles d’IA ils souhaitent prendre en charge. Source

Le système se concentre actuellement sur des modèles basés sur du texte tels que le Trinity Mini agentic (3B) et Cohere Transcribe, bien qu’il propose également des modèles de génération d’images diversifiés tels que FLUX 2 Klein 4B :

La gamme de modèles dont le « propriétaire » peut choisir de louer, ainsi que les gains mensuels projetés.

Les utilisateurs participant au système peuvent apparemment gagner suffisamment d’argent en un mois solide de prestation d’inférence pour ajouter régulièrement un nouveau Mac à une chaîne en constante croissance, jusqu’à ce qu’ils puissent gagner une ferme d’inférence à part entière.

En effet, un système de ce type qui gagnerait vraiment en popularité (il a actuellement un problème de démarrage à froid) pourrait remettre les utilisateurs enthousiastes et occasionnels dans une position de recherche de matériel, comme lors du dernier grand boom de la crypto-monnaie (et de la crise subséquente).

Ne vous y trompez pas

Cependant, pour les petits acteurs, ce bateau peut avoir pris le large. Outre le besoin apocalyptique de l’IA en matière de mémoire RAM, la demande de centres de données dotés d’une IA à l’échelle mondiale continue d’ augmenter les coûts du matériel et des services pour les consommateurs ordinaires, qui étaient précédemment en mesure de monopoliser la mémoire RAM pour l’extraction de crypto-monnaies, en raison de la nature périphérique de l’activité, ainsi que de l’incertitude réglementaire, qui a tenu les intérêts commerciaux à l’écart de la crypto-monnaie.

Alors que le MacBook Neo très abordable est apparu comme une alternative qui bat les coûts de matériel en constante augmentation, son processeur de téléphone mobile A18 et ses 8 Go de VRAM ne le placent pas en concurrence sérieuse en tant que machine d’inférence.

Mais même si l’utilisateur final ne cherche pas à créer une ferme d’inférence à part entière et souhaite simplement louer sa capacité M[n] inutilisée, les gains potentiels semblent importants, si le problème de démarrage à froid (un manque initial d’utilisateurs au lancement d’une entreprise qui repose sur un grand volume de participants) se résout rapidement, et si la plate-forme commence à se présenter comme quelque chose de plus qu’une expérience curieuse en demande potentielle.

Inférez différemment

Bien que plusieurs commentateurs aient reconnu une démocratie de type PiedPiper/Torrent dans le système de DarkBloom, les tâches d’inférence ne sont pas aussi facilement divisibles que la fragmentation d’un fichier de film en plusieurs tranches hachées, de sorte qu’il puisse être réassemblé plus tard dans un client de torrent.

Le modèle DarkBloom ne propose pas qu’un participant traite x % d’une tâche d’inférence avec son processeur M[n]. Dans l’utilisation courante, seul un petit nombre de cadres ou de méthodologies peuvent réaliser une telle utilisation croisée de GPU sur une tâche d’inférence unique, notamment TensorRT LLM de NVIDIA, qui utilise le parallélisme de pipeline ; et l’inférence sharded de DeepSpeed, qui exploite le parallélisme de modèle (MP).

Plutôt, votre Mac compatible DarkBloom téléchargerait et exécuterait l’un des modèles répertoriés et effectuerait 100 % de l’inférence pour les utilisateurs payants, avec une encryption de bout en bout, et avec des invites déchiffrées uniquement sur des nœuds attestés par le matériel, ce qui signifie que les fournisseurs ne seraient pas en mesure de lire les données pendant l’exécution. La charge de travail elle-même constituerait une ou plusieurs inférences basées sur du texte, ou au moins une image complète.

Il n’est pas clair à quel point une session utilisateur unique serait extensive ; actuellement, les amateurs d’IA sont habitués à sécuriser un GPU via des fermes d’inférence telles que RunPod ; bien qu’il puisse prendre un certain temps pour sécuriser le GPU souhaité à l’utilisation de pointe, l’utilisateur peut monopoliser celui-ci aussi longtemps que la session n’est pas autorisée à expirer.

Il est donc possible qu’un seul utilisateur payant puisse finir par utiliser les capacités d’IA de la série M d’un Mac loué DarkBloom pour une session très longue, à moins qu’il n’y ait un avantage logistique ou de conformité à faire passer les clients entre les demandes.

Les Mac ont été sélectionnés pour cette approche, apparemment, parce qu’il n’y a qu’un nombre limité de configurations techniques possibles pour un participant, et qu’il est donc facile d’affecter des modèles de taille appropriée à un client.

De plus, les Mac capables de contribuer à un réseau DarkBloom ont un enclave sécurisé qui garantit un mur entre l’utilisateur et le fournisseur.

Ces facteurs ne sont pas si faciles à rationaliser sur des configurations plus génériques et personnalisées, et sur les centaines ou les milliers d’ordinateurs portables et de bureau Windows et Linux disponibles au cours des 6 ou 7 dernières années.

Cependant, il doit être évident que le bassin de matériel non Mac beaucoup plus important pourrait répondre à une demande massive si leurs caractéristiques diverses pouvaient être rationalisées, au lieu de – comme avec DarkBloom – de profiter des jeux de spécifications limités d’Apple, ce qui facilite une proposition commerciale et une approche architecturale plus facile.

Surveillance légale ?

Peut-être que la plus grande question à laquelle est confronté une solution « démocratique » de ce type est la nature fermée du processus proposé ; les gouvernements du monde entier sont actuellement engagés dans de nouvelles législations qui mettraient effectivement fin à l’anonymat sur Internet partout où elles sont instituées, et sont clairement pas dans un état d’esprit pro-privacy dans cette période.

Par conséquent, la perspective d’une inférence IA aléatoire effectuée sans filtres, vérifications ou équilibres, sur un réseau distribué (si vous pouvez appeler DarkBloom cela – c’est plus d’un marché d’inférence) semble, ironiquement, lointaine.

Il est possible que DarkBloom, ou d’autres schémas de réseau maillé ultérieurs, devront accepter des portes dérobées qui restreignent effectivement la vie privée à l’hôte, qui ne sera pas en mesure de voir les tâches clientes en cours d’exécution ; au lieu de cela, les données d’inférence renvoyées seraient mises à disposition par l’intermédiaire de structures de l’homme du milieu (MiTM) des agences gouvernementales, ce qui rendrait toutes les inférences auditable.

Présument, si la série de nouvelles lois proposant des vérifications d’identité au niveau du système d’exploitation devaient jamais atteindre une adoption généralisée, de telles mesures pourraient devenir redondantes. Mais sans elles, en tenant compte du climat actuel, un réseau de type DarkBloom serait probablement considéré comme un « darknet » IA, où des activités illégales basées sur l’IA pourraient se produire en secret.

Tests divisés

Jusqu’à présent, il y a eu peu de véritables tentatives pour faire ce que suggère un système de type « PiedPiper » ; en soi, DarkBloom se situe à une extrémité, en distribuant des tâches complètes à des machines individuelles plutôt qu’en essayant de les fragmenter sur un réseau, tandis que la plupart des systèmes de production évitent simplement le problème en gardant l’inférence sur un hôte unique.

Il existe cependant une poignée de projets qui représentent quelque chose de plus proche d’une « exécution partagée ».

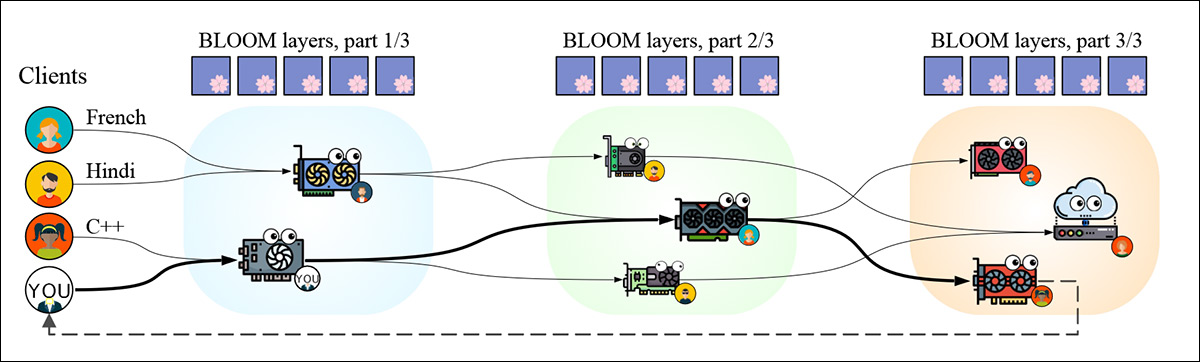

Petals, qui se décrit activement comme un réseau de type « BitTorrent », distribue des blocs de transformateurs sur plusieurs nœuds connectés à Internet, en passant des états intermédiaires entre eux :

Un flux de travail typique de Petals, où une seule demande d’inférence est acheminée via plusieurs nœuds GPU distants, chacun contenant un sous-ensemble de couches de modèle ; contrairement à DarkBloom, l’exécution est fragmentée sur le réseau, avec des états intermédiaires passés entre des nœuds indépendants, augmentant la latence et l’exposition à chaque saut tout en approchant un véritable système de type maillé. Source

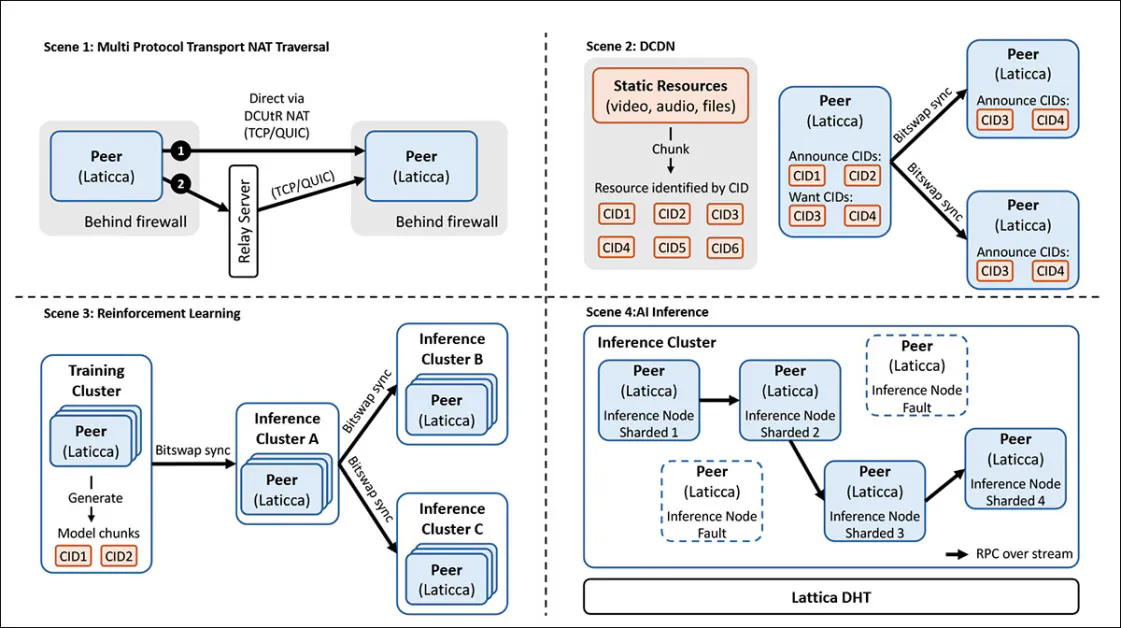

Hivemind expérimente une coordination et une routage d’experts similaires, bien que dans le but de former des modèles plutôt que d’inférence à partir de modèles déjà formés ; et Lattica se concentre sur la couche de réseau sous-jacente nécessaire pour rendre de tels systèmes viables :

Un schéma de Lattica, montrant un substrat pair-à-pair de bas niveau qui gère le traversal NAT, la distribution de contenu et la coordination basée sur DHT, avec une inférence fragmentée émergeant uniquement comme une couche d’application possible ; contrairement à DarkBloom ou Petals, Lattica ne définit pas lui-même un système d’inférence, mais fournit les primitives de réseau et de synchronisation nécessaires pour en construire un. Source –

Tous ces modèles s’approchent de l’idéal du maillage, mais au prix de la latence, de l’instabilité et de l’exposition.

Inversement, exo maintient l’inférence dans un cluster local, en utilisant des interconnexions rapides pour diviser les charges de travail sur des GPU, sans s’appuyer sur Internet public. Dans la pratique, ce type de configuration se comporte moins comme un réseau distribué et plus comme une machine unique étendue, bien qu’il y ait une possibilité claire d’étendre cette approche sur un réseau plus large :

Une vue de cluster à partir d’exo, montrant un petit anneau de machines Apple Silicon locales hébergeant conjointement un modèle unique, avec une distribution de couches ou de tenseurs sur les nœuds ; contrairement aux systèmes basés sur le WAN, exo s’appuie sur des interconnexions locales rapides, ce qui transforme effectivement plusieurs appareils en une machine d’inférence composite unique. Source

Enfin, plusieurs approches couramment citées n’abordent pas du tout l’inférence : le vénérable (2016) FedAvg de Google ; la sortie de MIT en 2018 SplitNN ; et l’offre australienne de 2020 SplitFed, sont préoccupés par la distribution de la formation ou les échanges de données préservant la confidentialité, plutôt que de servir des demandes d’inférence en direct.

Puisque la formation est une perspective beaucoup plus intensive en ressources que l’inférence, tout réseau qui prouve être capable de distribuer une telle charge de manière efficace, sur des grappes ou des nœuds, pourrait avoir une part disproportionnée d’intérêt des amateurs et des entreprises plus tard.

Conclusion

Parce que beaucoup de la technologie dans Silicon Valley était une invention farfelue, nous ne savons pas si PiedPiper était vraiment conduit par hachage (c’est-à-dire en divisant et en distribuant les données en morceaux, de type torrent), ou s’il « réglait » une tâche ou même une session sur n’importe quel nœud à n’importe quel moment, ce que fait DarkBloom.

Cependant, l’effervescence actuelle pour fournir du matériel de formation et d’inférence au niveau des centres de données indique que le secteur de la fourniture s’attend soit à servir tout le monde, de type RunPod, soit à se préparer à la fourniture de niveau d’entreprise le plus lucratif – une perspective tentante sapée par le manque général de tranchées dans le déploiement de l’IA.

Si l’inférence maillée devient une réalité, il est raisonnable de s’attendre que les premières tentatives pour en tirer parti proviendront des acteurs établis, tels qu’OpenAI et Anthropic, qui pourraient soit déployer des systèmes dédiés au sein d’une base d’application existante massive, soit collaborer sur des systèmes open source faciles à installer (puisqu’il s’agit de sociétés de cette taille et de cette portée qui ont l’argent et la motivation pour rationaliser des installations difficiles de ce type).

Quant à savoir si un réseau maillé plus démocratique et impulsé par l’utilisateur pourrait émerger, un véritable équivalent IA de BitTorrent – un certain nombre de facteurs sont opposés à cela.

Premièrement, la poussée mondiale actuelle contre le chiffrement et l’anonymat pourrait supprimer ou miner de nombreux mécanismes qui rendent des systèmes tels que BitTorrent anonymes, tels que le chiffrement de bout en bout et les VPN. Une fois que les flux chiffrés génériques cachant ces protocoles sont ouverts à l’inspection, de nouvelles couches de surveillance et d’interdiction deviennent possibles, et cela peut miner l’attrait d’un système de type DarkBloom.

Deuxièmement, les réglementations émergentes ou proposées contre les « abus » de l’IA, ou contre l’exploitation anonyme de frameworks open source, signifient que le coût de la conformité – négligeable au niveau de l’entreprise – prendrait probablement tous les petits acteurs hors du marché.

Enfin – le pouvoir d’un grand acteur du secteur pour embrasser, étendre et éteindre (EEE, comme Facebook et Twitter l’ont probablement fait avec des communautés Internet plus occasionnelles), signifie que les acteurs majeurs actuels peuvent exploiter et rationaliser le modèle de maillage à leur propre avantage, sur un marché où les utilisateurs finals sont presque totally intolerants à toute friction dans l’adoption.

Publié pour la première fois le jeudi 16 avril 2026