Angle d'Anderson

Suppression d'objets et de personnes dans une vidéo grâce à l'IA

Non, l'enfant ne reste pas dans le tableau, si l'IA a quelque chose à voir avec ça.

La suppression de personnes et d'objets dans les images et les vidéos est un sous-domaine de recherche populaire dans la littérature sur l'IA axée sur les effets visuels, avec un nombre croissant d'ensembles de données et de cadres dédiés pour relever ce défi. Le plus récent d'entre eux, provenant de l'Institut du Big Data de l'Université Fudan en Chine, est Effacement d'effet, un système de suppression d'objets vidéo « sensible aux effets » qui, selon les auteurs, améliore sensiblement l'état de l'art lors des tests :

Voici des exemples de la méthode EffectErase, tirés du site web du projet (veuillez noter que, malgré la présence d'un lien, le site source contient de nombreuses vidéos haute résolution non optimisées avec lecture automatique, ce qui peut affecter la stabilité de votre navigateur. La vidéo YouTube d'accompagnement, plus simple et plus complète, est intégrée à la fin de cet article). Source

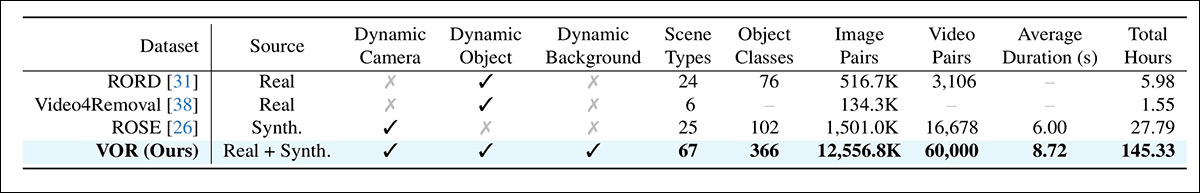

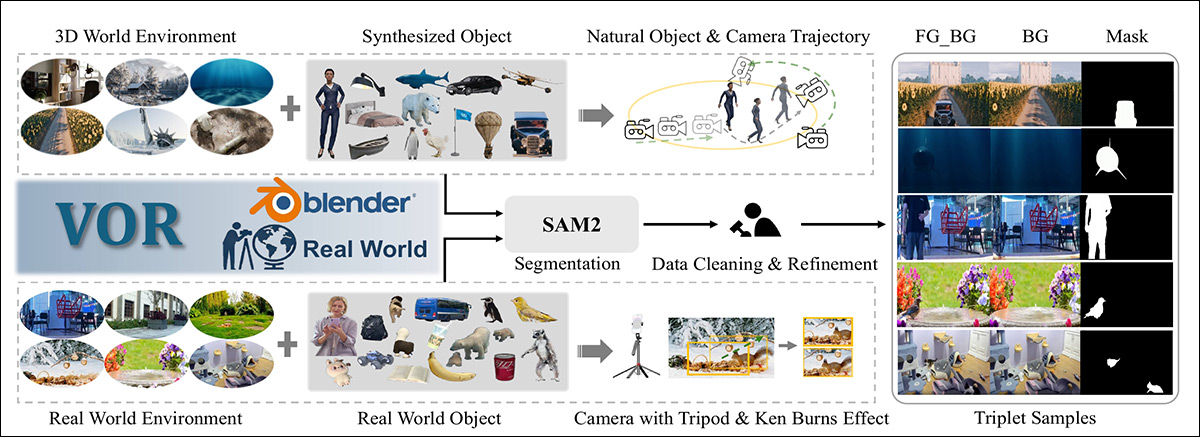

Le nouveau travail impliquait la création/la conservation d'un ensemble de données semi-novateur comprenant près de 350 scènes originales du monde réel et également synthétisées (utilisant des référentiels publics*), soit capturées avec un équipement dédié, soit récupérées et réutilisées dans un flux de travail construit autour du framework open source Blender 3D.

L'ensemble de données hybride de suppression d'objets vidéo (VOR) constitue la base de Effacement d'effet l'application elle-même, qui est construite sur la Wan2.1 Système de génération vidéo. Le système définit également deux nouveaux benchmarks associés : Évaluation VOR VOR Sauvage – respectivement, pour les échantillons avec et sans vérité sur le terrain.

(Bien que le document ait un site du projet associéLe site est assez surchargé de nombreuses vidéos haute résolution et difficile à charger ; veuillez donc vous référer aux extraits que j'ai sélectionnés dans la vidéo intégrée ci-dessus si vous avez des difficultés à utiliser le site du projet.

Une comparaison des quantités à travers des ensembles de données antérieurs comparables, en ce qui concerne la nouvelle offre. Source

Les chercheurs affirment que leur approche permet d'obtenir des performances de pointe, tant en termes de mesures quantitatives que de résultats qualitatifs, tels qu'ils ont été évalués par une étude menée sur des sujets humains.

Ils notent que les travaux antérieurs n'ont pas toujours réussi à supprimer les effets secondaires d'un objet, tels que les ombres et les reflets, et que leur ensemble de données a été soigneusement créé pour remédier à cette lacune :

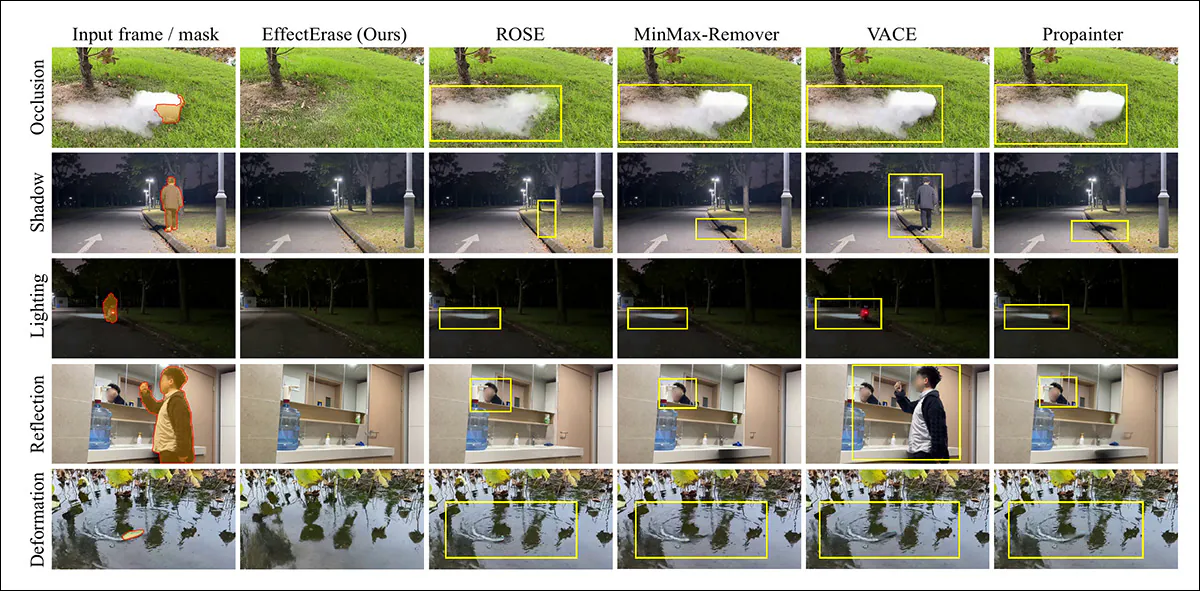

Exemples de l'incapacité des approches précédentes à regarder au-delà de l'objet à supprimer, vers des indications secondaires telles que les reflets et les ombres.

L'espace nouveau papier est intitulé EffectErase : Suppression et insertion conjointes d'objets vidéo pour un effacement d'effets de haute qualité, et provient de quatre chercheurs du Collège d'informatique et d'intelligence artificielle de l'Université Fudan.

Méthode

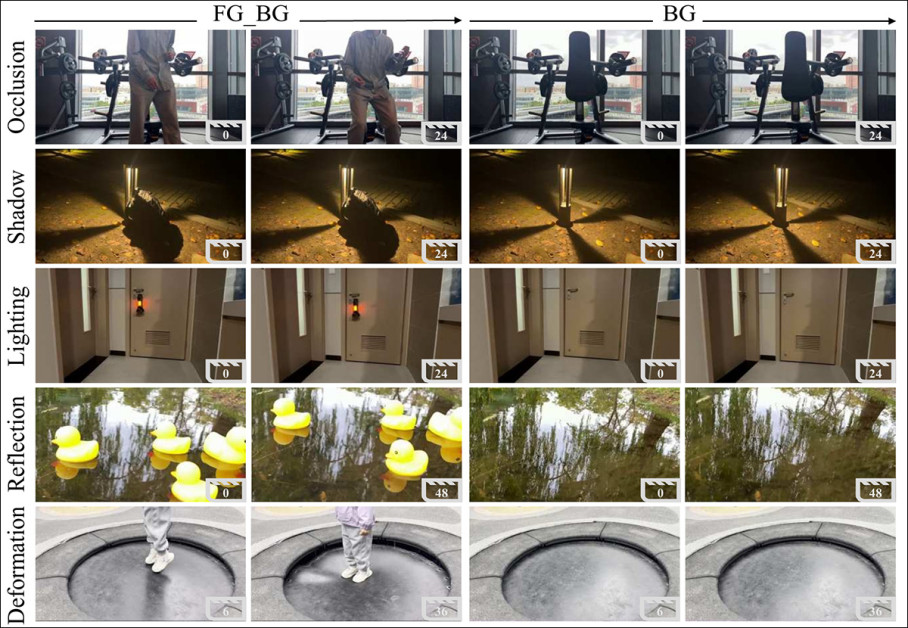

L'ensemble de données hybrides VOR a été conçu pour englober un éventail de scénarios suffisamment large pour couvrir toutes les implications d'une tentative de suppression d'une personne ou d'un objet d'une vidéo :

Des paires d'images issues du jeu de données VOR illustrent comment la suppression d'objets doit prendre en compte non seulement le sujet visible, mais aussi ses effets induits. Des exemples montrent l'occlusion, l'ombre, les variations d'éclairage, les reflets et la déformation physique, chaque élément étant présenté comme image d'entrée (objet présent) et comme image d'arrière-plan nette correspondante après suppression. Pour d'autres exemples, consultez la vidéo YouTube intégrée à la fin de cet article.

Les cinq types représentatifs d’« interférence » à traiter sont définis par les auteurs comme suit : occlusion, y compris différents types de verre et d'occlusion par la fumée ; ombres; éclairage (par exemple, lorsqu'un objet à retirer crée ou modifie le trajet de la lumière) ; réflexionet déformation (par exemple, l'empreinte d'un utilisateur sur un coussin, qui ne devrait pas survivre au départ de la personne).

Le pipeline de construction des jeux de données pour VOR combine des scènes synthétiques générées avec Blender et des captures du monde réel. Les données synthétiques sont construites à partir d'environnements 3D, d'objets et de trajectoires de caméra soigneusement sélectionnés, ainsi que de séquences réelles enregistrées dans diverses scènes, enrichies par un effet de mouvement Ken Burns. La segmentation SAM2 et un affinement manuel produisent ensuite des triplets vidéo alignés (premier plan et arrière-plan) avec les masques correspondants.

Pour obtenir les données originales issues du monde réel, les chercheurs ont utilisé des caméras fixes pour enregistrer des scènes « avec » et « sans » couvrant un large éventail d'environnements, d'heures de la journée et de conditions météorologiques.

Pour les données synthétisées, de multiples points de vue ont été rendus et des scénarios multi-objets créés, présentant des mouvements de caméra délibérément complexes et exigeants, tels qu'on peut les observer dans des séquences réelles. Les chercheurs constatent que cette approche est plus sophistiquée et demande plus d'efforts que celle utilisée pour des données par ailleurs similaires. Supprimer les objets ayant des effets secondaires dans les vidéos (ROSE) base de données.

Pour accroître la diversité des mouvements, le Effet Ken Burns a été appliqué aux paires capturées par caméra, ajoutant des panoramiques contrôlés, des zooms et de légers mouvements de main selon quatorze règles prédéfinies, avec cinq modèles de mouvement échantillonnés par paire tout en conservant le recadrage à l'intérieur du cadre d'origine.

L'échelle et la diversité ont été encore accrues en combinant des objets synthétiques avec plusieurs configurations de caméras. Des masques ont été générés en plaçant des points de repère manuels sur des images clés, propageant ainsi la segmentation. Segment N'importe quoi 2 (SAM2), nettoyage et raffinement des résultats, et assemblage de triplets validés de premier plan, d'arrière-plan et de masque pour l'entraînement.

La collection finale représente 145 heures de vidéo réparties sur 60 000 paires de vidéos, réelles et synthétiques, couvrant 366 classes d'objets dans 443 scènes.

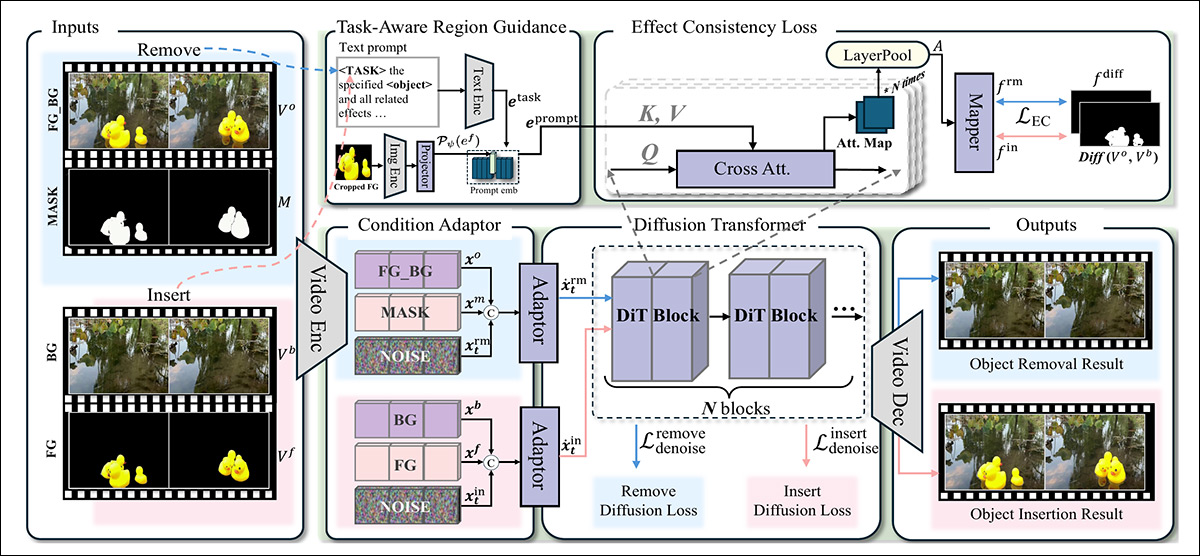

Le réseau EffectErase lui-même ingère le matériel via un auto-encodeur variationnel (VAE†), le débruitage latent étant géré par Wan2.1. Sur cette infrastructure, EffectErase opère Apprentissage conjoint par retrait et insertion, qui entraîne les deux tâches simultanément sur les mêmes régions ; Guidage régional en fonction de la tâche (TARG), qui utilise des jetons d'objet et de tâche avec attention croisée modéliser les liens spatio-temporels entre les objets et leurs effets et permettre le changement de tâche ; et Perte de cohérence de l'effet, qui aligne les régions d'effet alignées entre les tâches de suppression et d'insertion :

Schéma du framework EffectErase. Lors de l'entraînement, les vidéos appariées sont encodées dans un espace latent partagé, fusionnées avec du bruit et traitées par un transformateur de diffusion guidé par une attention croisée sensible à la tâche, tandis qu'une perte de cohérence d'effet aligne les régions de suppression et d'insertion afin que les deux tâches se concentrent sur la même zone.

Les processus de suppression et d'insertion sont entraînés ensemble, à l'aide d'une structure de diffusion commune, de sorte que le modèle apprend à se concentrer sur les mêmes régions affectées et les mêmes indices structurels.

Les vidéos contenant des objets, les vidéos ne comportant que l'arrière-plan et les masques sont d'abord encodées dans un format espace latentDu bruit est ensuite ajouté pour l'entraînement à la diffusion, et le modèle apprend à reconstituer des représentations nettes grâce à un guidage spécifique à la tâche. Un adaptateur léger fusionne alors les caractéristiques bruitées avec des conditions de suppression ou d'insertion, permettant ainsi aux deux tâches de partager la supervision tout en restant contrôlables.

Guidage régional en fonction de la tâche crée un signal spécifique à la tâche en combinant des jetons linguistiques avec des caractéristiques visuelles extraites de l'objet au premier plan, en utilisant CLIPLe modèle remplace un jeton d'objet générique par une représentation intégrée dérivée du contenu réel de l'image. Cette représentation fusionnée est injectée dans le réseau de base via l'attention croisée, permettant ainsi au modèle de suivre l'évolution d'un objet et de ses effets visuels dans l'espace et le temps, tout en autorisant une commutation flexible entre suppression et insertion.

Perte de cohérence de l'effet Les processus de suppression et d'insertion sont ainsi contraints de se concentrer sur les mêmes zones modifiées, puisque les deux tâches portent sur le même objet et ses effets visuels. Les cartes d'attention de chaque branche sont ensuite combinées en cartes de régions floues et alignées avec une carte des différences calculé à partir des vidéos de l'objet et de l'arrière-plan, afin de préserver les variations subtiles comme l'éclairage et les ombres. perte facilite le retrait du guide d'insertion et assure la cohérence des deux tâches.

Données et tests

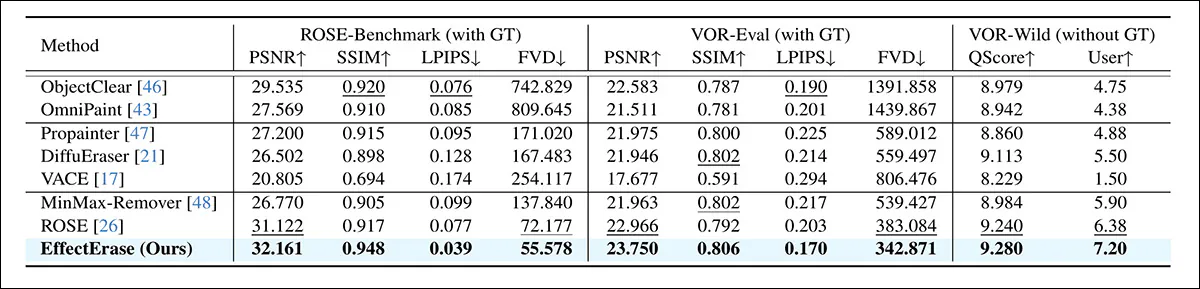

Les chercheurs ont testé leur approche par rapport à diverses méthodes de remplissage d'images, de remplissage vidéo et de suppression d'objets : OmniPaint; Effacer l'objet; VACE; DiffuEraser; ProPainter; ROSEet MiniMax-Remover.

Wan2.1 a été peaufiné avec LoRA† † en utilisant l'ensemble de données VOR à une résolution de 832x480px. 81 images consécutives (le limite effective Pour les réseaux WAN (au-delà desquels des erreurs ont tendance à se produire), des échantillons aléatoires ont été sélectionnés pour l'entraînement, qui a duré 129 000 itérations à une fréquence donnée. taille du lot de 8, sur huit GPU H100, chacun doté de 80 Go de VRAM. taux d'apprentissage a été fixé à 1×102ainsi que, Rang LoRA à 256.

L'espace ROSE-Benchmark Seule la collection synthétique a été testée comme ensemble de données externe ; les deux autres étaient Évaluation VOR, le AVANT test de l'ensemble de données scission; et VOR-Wild, un ensemble de test comprenant 195 vidéos réelles extraites d'Internet, comportant des « objets dynamiques ».

Les mesures utilisées étaient Rapport signal/bruit maximal (PSNR); Indice de similarité structurelle (SSIM); Similarité des patchs d'images perceptuelles apprises (LPIPS); et Distance vidéo Fréchet (FVD). Une étude utilisateur portant sur 195 vidéos générées par VOR-Wild a également été réalisée, en tenant compte des notes moyennes attribuées par 20 volontaires.

De plus, les auteurs ont conçu QScore, une mesure tirant parti de Qwen-VL modèle multimodal, afin d'évaluer la qualité de la sortie vidéo après suppression d'objets, en termes d'artefacts résiduels ou de suppressions environnementales manquées, telles que les ombres et les effets d'éclairage :

Comparaison quantitative sur les benchmarks ROSE et VOR, les meilleurs et les deuxièmes meilleurs résultats étant respectivement indiqués en gras et soulignés.

Concernant ces résultats, les auteurs notent :

« Les méthodes actuelles de remplissage d'images fonctionnent sur des images individuelles à l'aide de modèles 2D sans modélisation temporelle et ne parviennent donc pas à maintenir la cohérence temporelle dans les vidéos. »

Les méthodes récentes de restauration vidéo ne modélisent pas explicitement les effets secondaires des objets, ce qui entraîne des résultats de suppression peu naturels. Les méthodes existantes de suppression d'objets vidéo ne prennent pas en compte la corrélation spatio-temporelle entre l'objet et ses effets secondaires, et produisent par conséquent souvent des artefacts et des traces résiduelles des objets supprimés.

Globalement, EffectErase atteint des performances de pointe sur tous les ensembles de données et pour toutes les métriques d'évaluation. Il obtient les meilleurs scores sur la métrique de qualité vidéo FVD, démontrant une fluidité temporelle et une cohérence supérieures des vidéos générées.

« Notre méthode obtient également les meilleurs scores QScore et les meilleures évaluations des utilisateurs, démontrant ainsi son efficacité à produire des résultats d'élimination visuellement convaincants. »

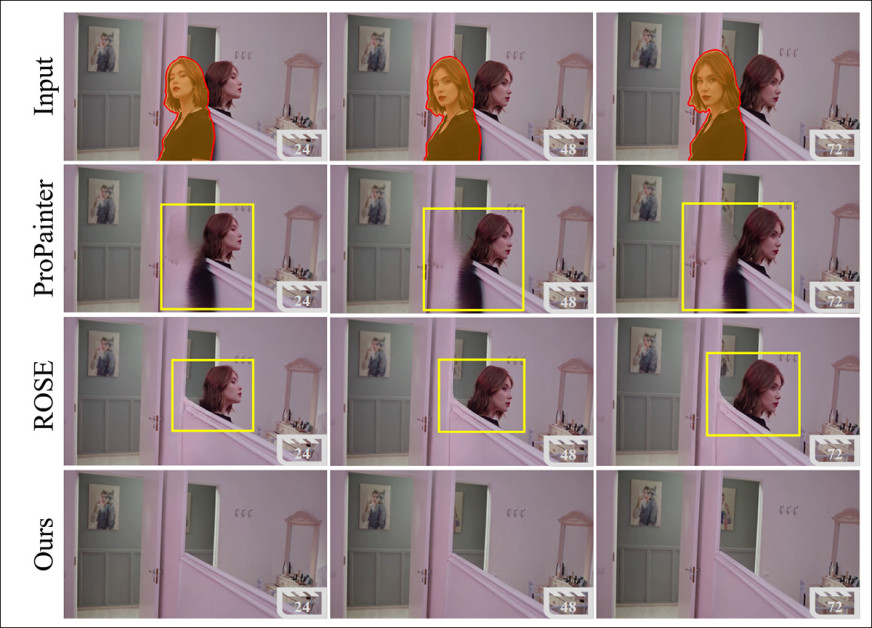

Pour l'évaluation qualitative, les résultats statiques sont présentés dans le document (ci-dessous), tandis que les résultats dynamiques sont disponibles sur le site du projet et dans les documents d'accompagnement. présentation vidéo YouTube:

Comparaison qualitative de VOR-Eval dans différents cas d'occlusion, d'ombre, d'éclairage, de réflexion et de déformation. Les méthodes de remplissage peinent à supprimer les effets situés en dehors du masque, tandis que les modèles de suppression laissent souvent des artefacts visibles. EffectErase supprime plus proprement les objets cibles et leurs effets associés. Veuillez consulter l'article source pour une meilleure résolution et le site du projet pour des exemples vidéo.

Nous renvoyons également le lecteur à divers exemples connexes sur le site du projet, dont un aperçu est présenté ci-dessous, ainsi qu'à la vidéo YouTube officielle intégrée à la fin de cet article :

Cliquez pour jouer. Voici un exemple de comparaison tiré du site web d'EffectErase. Pour une meilleure résolution (en tenant compte des limitations mentionnées précédemment) et pour d'autres exemples, veuillez consulter le site.

Les auteurs commentent :

Les méthodes de restauration vidéo produisent souvent des artefacts dans les zones masquées et ne parviennent pas à éliminer complètement les effets secondaires causés par les objets supprimés. Les approches de suppression d'objets précédentes, telles que ROSE et MinMax-Remover, sont performantes pour la suppression des objets cibles, mais rencontrent toujours des difficultés avec les effets secondaires, notamment en cas d'occlusion, d'ombre, d'éclairage, de réflexion et de déformation.

« À l'inverse, EffectErase supprime efficacement à la fois les objets cibles et leurs effets associés, ce qui donne des résultats nets, cohérents et de haute qualité. »

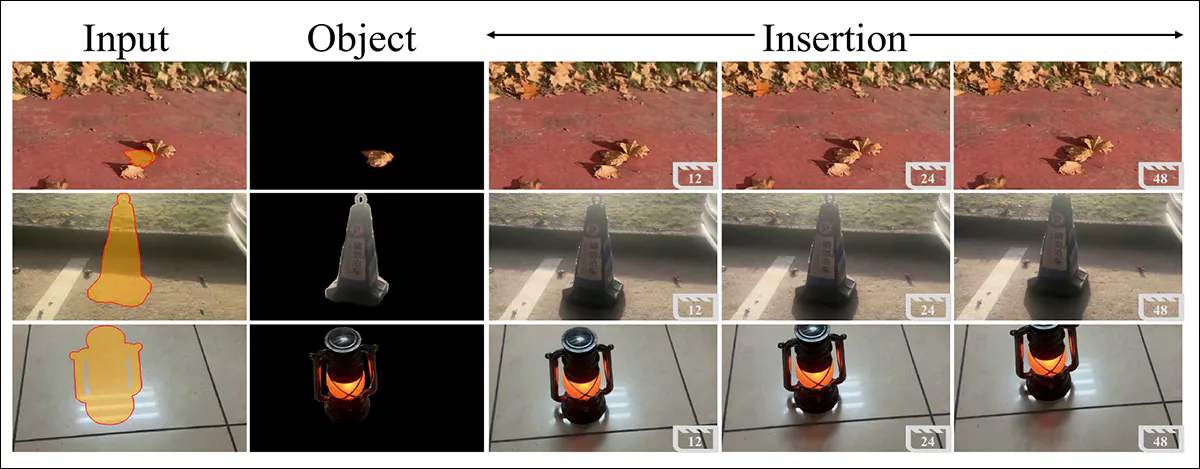

En conclusion, les chercheurs observent que leur méthode peut également être adaptée aux tâches d'insertion plutôt qu'aux tâches de retrait, sans nécessiter de formation supplémentaire :

Résultats de l'insertion d'objets vidéo. EffectErase insère des objets tout en préservant le contenu d'arrière-plan et en générant des effets cohérents induits par les objets, tels que les ombres et les reflets, d'une image à l'autre.

Les résultats vidéo de la tâche d'insertion sont visibles dans le (à un moment précis) vidéo YouTube exemples (également intégrés sans horodatage à la fin de l'article).

Conclusion

Un coup d'œil aux projets similaires dans la littérature révèle que beaucoup espèrent encore que les modèles VFX à usage général pourront un jour intégrer ce type de fonctionnalité dans un modèle de « boîte à outils » général conçu pour une gamme d'effets, plutôt que pour cette seule tâche spécifique.

Toutefois, selon le principe de la polyvalence, il semble raisonnable de supposer que les systèmes spécialisés comme EffectErase continueront de conserver un avantage sur les approches plus générales ; étant entendu que l'écart pourrait finir par se réduire suffisamment pour que la différence ne justifie pas l'effort supplémentaire que représente l'entraînement d'un modèle spécifique.

* On pourrait espérer, compte tenu des préoccupations croissantes concernant la provenance de la propriété intellectuelle, que toutes ces sources seraient citées ; mais si les documents disponibles issus de ce nouveau travail mentionnent la source des modèles 3D, je n'ai pas été en mesure de trouver cette référence.

† La référence fournie semble être une texte explicatif générique à partir de 2013, sans que le VAE spécifique ne soit détaillé.

† † Tirée de l'article, cette description est sémantiquement ambiguë, car le réglage fin et LoRA sont des processus différents avec des exigences très différentes.

Première publication : samedi 21 mars 2026