Financement

Ayar Labs lève 500 millions de dollars lors d'un tour de table de série E, pour une valorisation de 3.75 milliards de dollars, afin de développer des interconnexions optiques pour l'infrastructure d'IA.

Laboratoires Ayar a sécurisé 500 millions de dollars en financement de série E, portant son capital total levé à 870 millions de dollars et en évaluant l'entreprise à 3.75 milliards de dollarsLe tour était dirigé par Neuberger Berman et comprenait la participation de ARK Investir, Partenaires Insight, Autorité d'investissement du Qatar, Actions mondiales de Sequoia et 1789 Capital, aux côtés d'investisseurs stratégiques AMD, MediaTek, Alpuce et NVIDIA.

L'entreprise affirme que ce nouveau financement servira à accroître sa capacité de production et de test à grande échelle pour sa plateforme d'optique co-emballée (CPO), une technologie conçue pour répondre à l'un des défis les plus urgents de l'infrastructure d'IA : comment déplacer efficacement de vastes quantités de données entre les puces.

La contrainte cachée de l'IA : la circulation des données

Alors que les gros titres sur l'IA se concentrent souvent sur des GPU plus rapides et des modèles plus grands, un goulot d'étranglement croissant se situe ailleurs : dans les connexions entre les puces.

Les systèmes d'IA modernes s'appuient sur des milliers de GPU fonctionnant en parallèle. Ces processeurs échangent constamment des données lors de l'entraînement et de l'inférence. Plus leur communication est rapide et efficace, plus le système global est puissant. Mais la majeure partie de cette communication repose encore sur… signaux électriques circulant dans des fils de cuivre.

À petite échelle, le cuivre fonctionne bien. À l'échelle de l'IA hyperscale, il devient problématique :

- Les signaux électriques perdent en intensité avec la distance.

- Une bande passante plus élevée nécessite plus d'énergie.

- L'augmentation du débit de données génère plus de chaleur.

- Les pistes physiques en cuivre occupent un espace précieux sur les cartes et à l'intérieur des boîtiers.

À mesure que les modèles atteignent des milliards de paramètres, l'ajout de GPU supplémentaires ne suffit plus. L'interconnexion — le système qui relie les processeurs entre eux — détermine de plus en plus les performances globales et la rentabilité.

Qu’est-ce que l’interconnexion optique — et pourquoi est-ce important ?

L'interconnexion optique remplace la transmission de données électriques par lumière.

Au lieu de faire circuler des électrons dans des fils de cuivre, les systèmes optiques convertissent les signaux électriques en impulsions lumineuses qui se propagent dans de minuscules guides d'ondes optiques ou des structures semblables à des fibres. À la réception, ces signaux lumineux sont reconvertis en signaux électriques pour être traités.

Cette approche offre plusieurs avantages :

- Puissance par bit réduite transférée

- Capacité de bande passante supérieure

- Dégradation du signal réduite sur la distance

- Efficacité énergétique améliorée par GPU

En termes simples, la lumière peut transporter des données plus rapidement et avec moins de pertes d'énergie que l'électricité lorsque les besoins en bande passante deviennent extrêmes.

Pour les infrastructures d'IA, cette efficacité est cruciale. Les centres de données sont de plus en plus contraints par leurs budgets énergétiques. Si les interconnexions consomment trop d'énergie, le nombre d'accélérateurs déployables dans les limites d'une consommation énergétique donnée s'en trouve limité. L'interconnexion optique vise à atténuer cette contrainte.

Optique intégrée : rapprocher la lumière de la puce

Les réseaux optiques en eux-mêmes ne sont pas nouveaux : la fibre optique est utilisée dans les télécommunications depuis des décennies. Ce qui est nouveau, c’est… optiques co-packagées (CPO).

Traditionnellement, les modules optiques sont placés en périphérie d'une carte serveur ou dans des émetteurs-récepteurs enfichables séparés. L'optique co-intégrée consiste à intégrer les composants optiques directement aux puces de calcul dans un même boîtier. En raccourcissant les trajets électriques et en rapprochant la conversion optique du processeur, le système réduit les pertes d'énergie et la latence.

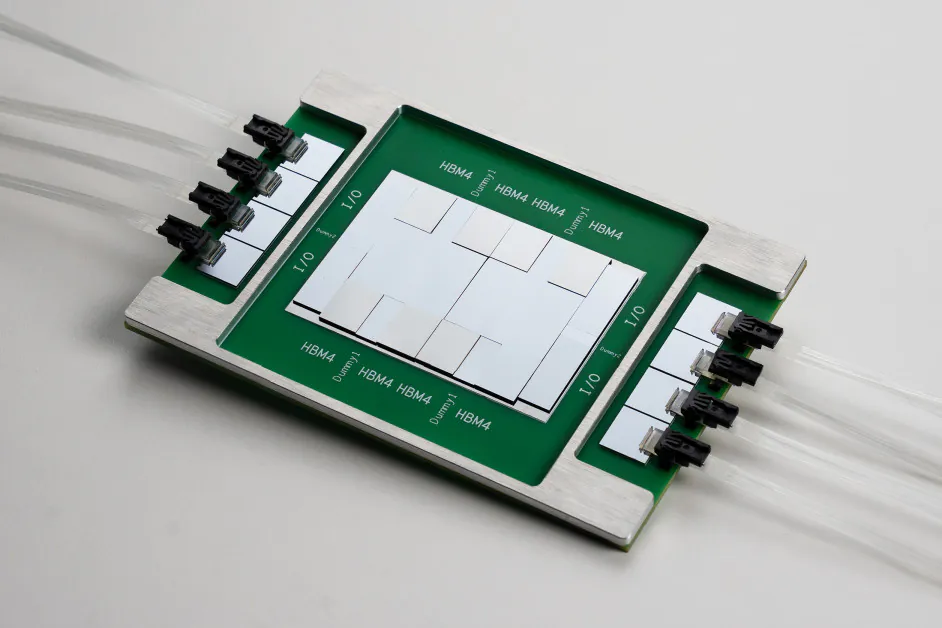

L'approche d'Ayar Labs repose avant tout sur son Moteur optique TeraPHYConçue pour s'intégrer aux processus de fabrication et d'encapsulation standard des semi-conducteurs, cette technologie n'oblige pas les clients à repenser l'intégralité de leurs systèmes. L'entreprise la présente comme compatible avec les conceptions d'accélérateurs et de commutateurs existantes.

L’objectif n’est pas une amélioration progressive, mais de permettre à des milliers de GPU de fonctionner comme un système plus unifié sans nécessiter des budgets énergétiques excessifs.

De la levée de fonds à la mise à l'échelle

La dernière levée de fonds d'Ayar Labs fait suite à son Levée de fonds de série D de 155 millions de dollars fin 2024ce qui a permis à l'entreprise de dépasser la barre du milliard de dollars de valorisation et a soutenu la montée en puissance rapide de la production de sa plateforme d'E/S optiques.

Le financement de série E marque une transition de la validation à la mise à l'échelle. L'entreprise prévoit d'accroître ses capacités de production et de test, de renforcer sa présence dans l'écosystème des semi-conducteurs taïwanais et d'accélérer son déploiement commercial.

La présence de capitaux institutionnels et d'investisseurs stratégiques du secteur des semi-conducteurs dans ce tour de table indique que l'interconnexion optique n'est plus considérée comme purement expérimentale. À mesure que le déploiement des infrastructures d'IA s'intensifie, l'efficacité de l'interconnexion devient un facteur essentiel de performance, de coût et de durabilité énergétique.

Si les GPU représentent les moteurs de l'IA moderne, l'interconnexion optique pourrait déterminer la portée et l'efficacité de leur fonctionnement.