Leaders d’opinion

Les agents autonomes ont besoin de plus que l’observabilité de l’IA

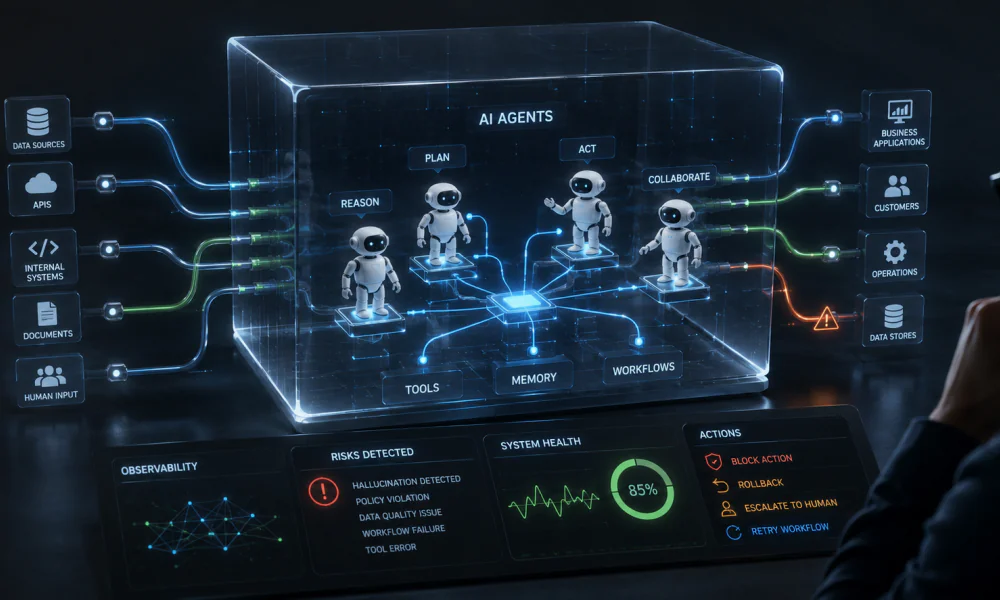

Alors que les entreprises utilisent des agents IA pour réfléchir, agir et initier des flux de travail, il est impératif de développer un plan pour les surveiller et les gérer.

Lorsque les différents composants d’un système IA commencent à prendre leurs propres décisions, l’observabilité seule n’est pas suffisante pour garantir que les opérations resteront stables, sûres ou fiables.

Pour gérer efficacement les agents IA dans l’entreprise, les entreprises doivent combler le fossé entre l’identification des problèmes et l’action. Cela va au-delà de la simple observation des problèmes ; les entreprises doivent prévenir activement les problèmes.

L’émergence des agents autonomes

La première vague de l’IA d’entreprise était basée sur des systèmes à base de requêtes ; un utilisateur posait une question, le modèle répondait et l’échange se terminait là. Bien que ces premières technologies soient essentiellement réactives, elles étaient utiles pour la recherche, les copilotes, la création de contenu et la synthèse.

La vague suivante est différente. Non seulement les agents IA autonomes réagissent, mais ils raisonnent également sur les objectifs, sélectionnent des outils, extraient des informations, prennent des décisions et initient des flux de travail. Ils travaillent parfois en tandem avec d’autres agents ou systèmes et servent de plus en plus de joueurs opérationnels au sein de l’entreprise, plutôt que de simples interfaces pour les instructions humaines.

Ce changement est important car il affecte les caractéristiques opérationnelles de l’IA. Les équipes ne surveillent plus seulement les sorties de modèle. Au lieu de cela, elles gèrent des systèmes dynamiques qui peuvent instantanément affecter les clients, le personnel, les infrastructures, les processus métier et d’autres applications.

Les capacités des agents aujourd’hui

Les talents des agents évoluent avec eux. Les agents peuvent sélectionner ce qu’ils doivent faire ensuite, décomposer un objectif en étapes et effectuer des activités à différents niveaux. En contactant des API, en interrogeant des bases de données, en recherchant des systèmes internes, en mettant à jour des enregistrements et en initiant des actions en aval, ils coordonnent des flux de travail. En intégrant des invites, des mémoires, des règles métier, des informations récupérées et des signaux opérationnels en temps réel, les agents peuvent également prendre des décisions basées sur le contexte.

Des agents plus sophistiqués peuvent identifier lorsqu’un flux de travail échoue, essayer à nouveau, escalader des problèmes ou transmettre des tâches à un réviseur humain. Dans les CRM, les tickets, les infrastructures cloud, les bases de connaissances internes, les plateformes d’observabilité et les applications métier, les agents peuvent fonctionner de manière indépendante. Nous anticipons que ces compétences continueront de s’étendre rapidement.

Comment les entreprises intègrent les agents IA autonomes

Les agents sont intégrés dans un éventail croissant d’opérations organisationnelles et se rapprochent des processus opérationnels où la rapidité, la précision, la sécurité et la gouvernance sont importantes. Certaines de ces opérations incluent : le service client et la gestion des cas, la réponse aux incidents et les opérations IT, les flux de travail pour DevOps et la fiabilité des sites, la correction de code et le développement de logiciels, la planification opérationnelle et de la chaîne d’approvisionnement, et bien plus encore.

Menaces opérationnelles émergentes

Cependant, à mesure que les agents deviennent de plus en plus autonomes, les entreprises doivent faire face à un nouvel type de risque opérationnel.

- Les mauvais choix ne sont pas simplement suggérés ; ils sont souvent mis en œuvre

- Les petites erreurs peuvent se propager rapidement à d’autres systèmes liés

- Les actions réelles peuvent être déclenchées par des hallucinations

- Les agents peuvent s’éloigner de l’intention commerciale, de la politique ou de la conformité

- Les interactions entre plusieurs composants peuvent entraîner des défaillances

- La prise de décision automatisée peut prendre des décisions plus rapidement que l’évaluation humaine

Alors que les équipes peuvent observer les symptômes, elles doivent également être en mesure de comprendre les raisons derrière le comportement du système. L’IA d’entreprise nécessite des contrôles de fiabilité en plus de la visibilité.

Les complexités des systèmes IA

Les systèmes IA actuels sont rarement un seul modèle. Ce sont des systèmes distribués et en couches composés de nombreux composants interactifs qui incluent :

- Les modèles fondamentaux (LLM)

- Les petits modèles de langage affinés ou spécifiques à une tâche (SLM)

- Les modèles d’intégration

- Les bases de données vectorielles

- Les pipelines de récupération et les composants RAG

- Les modèles de gabarit et les couches d’orchestration d’invites

- Les ensembles de données de formation et d’évaluation

- Les garde-fous et les couches de politique

- Les agents et les flux de travail

- Les systèmes d’appel d’outils

- La télémétrie (c’est-à-dire les journaux, les métriques et les traces)

- Les points de contrôle d’approbation humaine dans la boucle

Leurs risques

Chaque composant ajoute un mode de défaillance différent, et la façon dont ils interagissent ajoute une complexité supplémentaire. Même si un système semble solide au niveau de l’infrastructure, il peut toujours prendre de mauvaises décisions et générer des résultats satisfaisants ; tout en accumulant un risque opérationnel en dessous de la surface.

Certains des risques associés incluent : l’introduction d’entrées de mauvaise qualité ou corrompues par les pipelines de données, les goulets d’étranglement d’infrastructure qui réduisent la fiabilité, les résultats nocifs ou erronés, et les goulets d’étranglement opérationnels en réponse à la révision humaine. Les systèmes avec plusieurs agents ou étapes peuvent échouer de manière qui n’est pas immédiatement apparente.

L’observabilité de l’IA

La surveillance traditionnelle est insuffisante pour comprendre le comportement des invites, la qualité de récupération, la dérive des modèles, les canaux d’exécution des agents ou la connexion entre le comportement de l’IA et l’impact commercial ou opérationnel en aval.

C’est là que l’observabilité de l’IA entre en jeu. L’observabilité de l’IA permet aux équipes de comprendre comment les systèmes IA fonctionnent en production en collectant, en corrélant et en évaluant les entrées et les sorties, les comportements souhaités et les signaux de décision générés par ces systèmes. C’est essentiel, car les systèmes IA sont dispersés, non déterministes et extrêmement sensibles au contexte.

L’observabilité de l’IA offre une vision globale des flux de travail IA, de sorte que les équipes qui l’utilisent puissent comprendre comment les invites, les modèles, les couches de récupération, les outils et les systèmes en aval interagissent pendant l’exécution.

L’observabilité de l’IA permet de surveiller les performances et le comportement, y compris la latence, le coût, l’utilisation de jetons, le débit, les taux d’erreur, le comportement du modèle et les indicateurs de qualité de sortie. Elle trace et analyse les chemins d’exécution dans les flux de travail d’agents complexes et montre comment les résultats sont atteints à travers plusieurs étapes et dépendances.

L’observabilité de l’IA trouve également des anomalies à travers les signaux opérationnels et IA en exposant un comportement anormal dans les modèles, les pipelines, les infrastructures ou les résultats orientés vers l’utilisateur avant que les équipes ne les découvrent manuellement. Elle accélère les diagnostics lorsque quelque chose se passe mal et facilite les enquêtes sur les causes profondes en incluant les opérations spécifiques à l’IA dans la télémétrie du système (journaux, métriques, traces et événements).

L’observabilité seule n’est pas suffisante

Malgré le fait qu’il s’agisse d’une pratique commerciale essentielle, l’observabilité de l’IA a des limites inhérentes.

L’observabilité est diagnostique plutôt que préventive ; les équipes peuvent apprendre ce qui s’est passé, mais pas nécessairement comment l’empêcher de se reproduire. Il est important de comprendre que la connaissance des actions passées d’un agent ne se traduit pas automatiquement en contrôle sur les actions futures de l’agent.

Lorsqu’il s’agit de systèmes non déterministes complexes, l’observabilité peut souvent submerger les équipes avec des données qui conduisent à l’incertitude. Plutôt que de fournir une réponse opérationnelle, l’observabilité se termine souvent par une explication. Même si les équipes sont conscientes d’un problème, elles peuvent ne pas avoir l’automatisation, les garde-fous et les boucles de contrôle nécessaires pour prendre des mesures correctives.

Cela crée un fossé opérationnel. Les entreprises peuvent détecter la dérive, les résultats médiocres, le comportement dangereux ou la productivité dégradée, mais elles peuvent toujours être incapables de l’empêcher de se reproduire, d’en atténuer les effets ou de maintenir des systèmes autonomes dans des paramètres de fonctionnement sûrs.

Cela signifie que les équipes continuent à opérer de manière réactive. Elles utilisent l’intervention manuelle lorsqu’il se passe quelque chose, examinent les incidents après coup et s’appuient sur la main-d’œuvre humaine pour compenser les systèmes qui deviennent plus rapides et plus autonomes.

Un aperçu de la fiabilité de l’IA

La fiabilité de l’IA va au-delà de la simple observation des problèmes. C’est la discipline qui garantit que les systèmes IA fonctionnent de manière sûre, cohérente, prévisible et efficace dans des contextes de production réels. La fiabilité de l’IA comprend et gère l’ensemble des systèmes autour de l’IA. Elle ferme la boucle entre la détection et l’action.

La fiabilité de l’IA se concentre sur la question de savoir si l’ensemble du système IA peut fonctionner dans des contraintes opérationnelles raisonnables au fil du temps, et non simplement si un modèle a fourni une réponse précise. La qualité, la sécurité, la résilience, l’explicabilité, la conformité aux politiques, l’efficacité coût-efficacité et la stabilité opérationnelle font toutes partie de l’équation.

La transition de la détection à la prévention

La fiabilité de l’IA réduit le temps entre la reconnaissance d’un problème et la prise en charge de sa solution. Elle déplace la conversation de “ce qui s’est passé” à “comment notre IA peut-elle s’améliorer rapidement ?” L’utilisation des techniques suivantes déplace l’observabilité de l’observation passive à la prévention proactive :

- Corréler les signaux à travers les modèles, les données et les infrastructures pour identifier les problèmes

- Détecter les problèmes de manière proactive avant leur impact

- Vérifier toutes les entrées et les sorties dans les systèmes IA probabilistes pour détecter les changements de comportement subtils

- Créer une boucle de rétroaction entre la détection de sorties indésirables en production et l’utilisation de ces informations pour générer des données de réglage qui améliorent la précision des modèles sous-jacents

- Tracer les flux de travail d’agents multiples pour garantir que vous pouvez relier les points sur la façon dont et pourquoi les données ont évolué pour éclairer des actions complexes

- Définir des flux de travail agents humains dans la boucle pour une réponse sûre et une remédiation automatisée

Combler le fossé entre le contrôle et l’observation

Les entreprises bénéficient de cadres qui intègrent la visibilité et le contrôle et nécessitent plus qu’une simple couche d’observabilité au-dessus de l’IA générative. Dans les systèmes déterministes et non déterministes, une plate-forme de fiabilité peut identifier, anticiper, expliquer et aider à contrôler les problèmes.

Les éléments suivants devraient être inclus dans un cadre viable pour des opérations IA fiables :

- Télémétrie intégrée pour les systèmes IT et les systèmes IA

- Suivi des flux de travail d’agents et des dépendances de système de bout en bout

- Suivi du comportement et de la qualité spécifiques à l’IA (invites et évaluations)

- Détection avancée d’anomalies, quelle que soit la source

- Raisonnement causal et analyse de cause profonde

- Alerte qui s’adapte automatiquement à votre environnement et ne nécessite pas de seuils manuels

- Application de politiques et garde-fous

- Évaluation humaine des actions délicates ou importantes

- Automatisation des flux de travail et coordination de la remédiation

- Utilisation de l’analyse prédictive pour prévenir les problèmes

- Boucles de rétroaction qui relient la détection d’anomalies à l’amélioration de la qualité des modèles IA

Faciliter les fonctions IA

Les systèmes IA dépendent de l’infrastructure, des services, des pipelines de données et des routines opérationnelles ; ils ne défaillent pas seuls. Les équipes obtiennent une vision globale lorsqu’ils combinent la fiabilité de l’IA et de l’IT.

Un wrapper LLM mince ne devrait pas être la base d’une plate-forme fiable. Pour identifier et résoudre les problèmes que d’autres outils IA génératifs ne remarquent pas, une variété de techniques IA devraient être considérées, notamment l’IA non supervisée, l’IA prédictive, l’IA causale et l’IA générative. Ce mélange de techniques est couramment appelé “IA composite”.

L’IA générative est bonne pour résumer le langage naturel. Elle est la mieux adaptée aux situations qui nécessitent un raisonnement à travers des données non structurées ou lors de l’interaction avec les humains. Mais cela ne correspond pas à la forme de la plupart des problèmes de fiabilité en production.

L’IA prédictive se concentre sur l’identification de signaux précoces avant qu’ils ne deviennent des pannes, de mauvaises expériences client ou des défaillances coûteuses en utilisant des algorithmes de détection d’anomalies.

L’IA causale aide à déterminer les véritables causes profondes pour révéler si la qualité de récupération, le comportement du modèle, la lenteur de l’infrastructure, la dérive des données en amont ou la défaillance du système en aval était la cause d’une baisse de performance.

L’IA non supervisée découvre de manière autonome des modèles cachés, des structures ou des anomalies dans les données sans orientation humaine. Elle surpasse l’IA générative pour la fiabilité car elle se concentre sur la recherche de structures cachées dans des données complexes et non classifiées pour regrouper des éléments similaires ou trouver des relations.

Lorsque le risque, l’incertitude ou les effets commerciaux sont importants, les agents IA opérationnels doivent être en mesure d’automatiser la réaction tout en maintenant l’implication humaine pour des opérations fiables.

La compréhension du modèle IA du contexte commercial spécifique peut être améliorée à chaque rencontre en utilisant l’apprentissage par renforcement à partir de données réelles d’utilisateurs en production.

Même les systèmes les plus avancés vont au-delà de l’alerte ; la remédiation en boucle fermée apprend de chaque incident au fil du temps, automatise les réactions reconnues et initie des mesures sûres.

Préparation aux systèmes IA autonomes

Les entreprises peuvent se préparer aux systèmes IA autonomes de plusieurs manières. Tout d’abord, les agents doivent être considérés comme des systèmes opérationnels plutôt que comme des outils de productivité. Une fois qu’un agent a la capacité d’agir, il devient une partie intégrante des opérations de l’entreprise et doit être réglementé en conséquence.

Les équipes peuvent enregistrer des signaux à partir de modèles, d’invites, d’outils, de flux de travail, d’infrastructures et de résultats d’utilisateurs dès le départ en instrumentant les agents. Cette surveillance de base ne doit pas et ne peut pas être retardée jusqu’à ce que les agents deviennent essentiels à l’entreprise.

Établir des normes de fiabilité avant le déploiement généralisé des agents est également crucial. Au lieu d’être introduites après coup, les seuils acceptables pour la sécurité, la latence, les taux d’erreur, le risque d’hallucination, la conformité aux politiques et l’impact commercial devraient être intégrés dans leur conception.

Relier le comportement de l’IA aux systèmes et procédures sous-jacents qui le soutiennent permet aux entreprises d’intégrer les opérations IA et IT. Utiliser différents outils pour l’infrastructure et la surveillance des modèles crée des angles morts.

Les équipes d’ingénierie de plateforme, de SRE, de sécurité, de données, d’IA et les propriétaires commerciaux doivent travailler ensemble pour fournir des opérations IA fiables, et les systèmes autonomes dépassent les silos traditionnels.

Chaque incident, anomalie et quasi-accident améliorera le système en intégrant des boucles de rétroaction dans les opérations, permettant aux entreprises d’apprendre en continu du comportement de production.

Enfin, il est crucial de sélectionner des plateformes conçues pour le contrôle plutôt que pour la simple observation. Les entreprises bénéficieront de systèmes qui intègrent l’observabilité, la prévision, l’explication et l’action à mesure que les agents IA deviennent plus autonomes. Les organisations qui parviennent à faire la transition de l’identification des problèmes au contrôle sécurisé des résultats seront les gagnantes.

Le fond du problème

L’IA dans les entreprises est maintenant un système opérationnel dans les environnements d’entreprise plutôt qu’un outil. Dans les contextes de production réels, l’ajout de fiabilité aux systèmes IA garantit des opérations sûres, cohérentes, prévisibles et efficaces. Les entreprises qui parviennent à faire la transition de l’identification des problèmes à la maîtrise sécurisée des résultats seront les gagnantes. L’IA dans les entreprises est maintenant un système opérationnel dans les environnements d’entreprise plutôt que dans un outil. Dans les contextes de production réels, l’ajout de fiabilité aux systèmes IA garantit des opérations sûres, cohérentes, prévisibles et efficaces.