Cybersécurité

Anthropic révèle la première cyberattaque de grande envergure alimentée par l'automatisation par IA

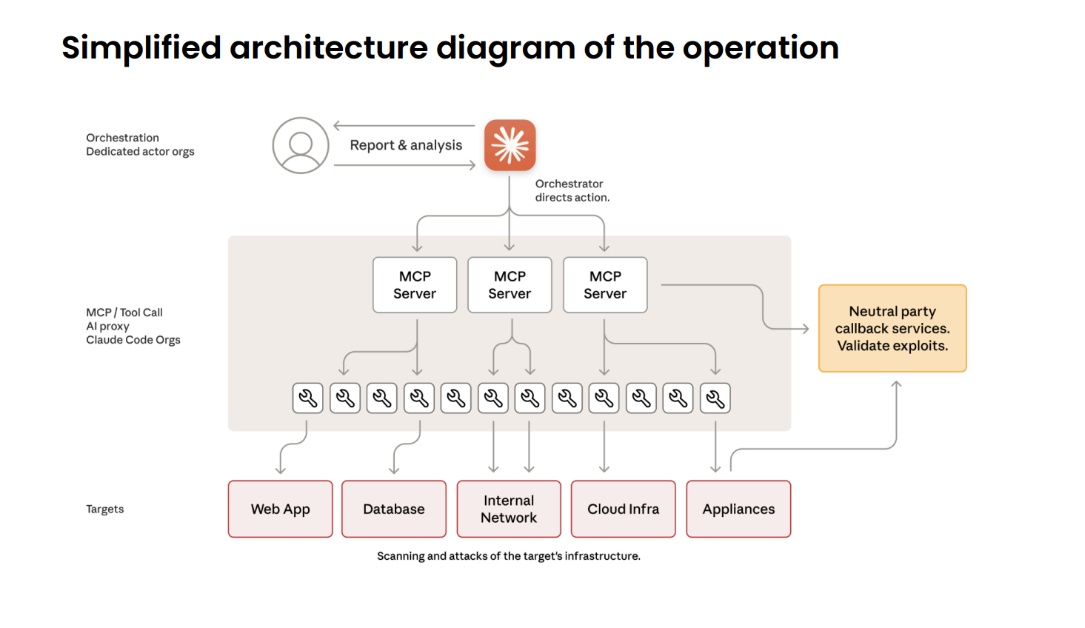

Anthropic a révélé qu'un groupe de pirates informatiques, qu'ils soupçonnent d'être un groupe parrainé par l'État chinois, a mené la première cyberattaque à grande échelle documentée exécutée avec une intervention humaine minimale, en utilisant les systèmes de l'entreprise. Outil Claude Code automatiser 80 à 90 % de la campagne.

Les attaquants ont ciblé une trentaine d'organisations parmi lesquelles de grandes entreprises technologiques, des institutions financières, des fabricants de produits chimiques et des agences gouvernementales. Si la plupart des attaques ont été bloquées, la campagne a abouti dans quelques cas. Claude Code a mené les opérations de reconnaissance, de test de vulnérabilité, de collecte d'identifiants et d'exfiltration de données de manière largement autonome, l'intervention humaine n'étant requise qu'aux points de décision critiques.

Vous pouvez lire le rapport complet d'Anthropic ici.

Méthodes d'attaque et manipulation de l'IA

Les pirates ont contourné les garde-fous de Claude grâce à une ingénierie sociale sophistiquée. Ils ont trompé le système d'IA en se faisant passer pour des employés d'une entreprise de cybersécurité légitime effectuant des tests de sécurité. Les attaquants ont également fractionné leurs opérations en petites tâches apparemment anodines, ne fournissant ainsi à Claude qu'un contexte incomplet quant à leur objectif malveillant global.

Claude Code a inspecté les systèmes des organisations cibles afin d'identifier les bases de données à forte valeur ajoutée. Cette reconnaissance s'est effectuée plus rapidement que celle de pirates informatiques humains. Le système a ensuite recherché et développé un code d'exploitation personnalisé pour tester les failles de sécurité. Il a collecté les identifiants et mots de passe nécessaires à l'accès au réseau, puis a extrait et catégorisé les données privées en fonction de leur intérêt stratégique. Les attaquants pouvaient lancer la campagne en un clic, l'IA opérant ensuite de manière quasi autonome à des vitesses impossibles à atteindre pour des équipes humaines, envoyant souvent des milliers de requêtes par seconde.

Image : Anthropique

Détection et réponse de l'entreprise

Anthropic a détecté l'attaque mi-septembre 2025 et a immédiatement ouvert une enquête. En moins de dix jours, l'entreprise a bloqué l'accès du groupe à Claude, contacté les organisations concernées et alerté les autorités compétentes. Depuis, elle a renforcé ses capacités de détection et développe des méthodes supplémentaires pour enquêter sur les attaques distribuées de grande envergure et les détecter.

Cet incident fait suite à des cas d'utilisation abusive déjà documentés par Anthropic en 2025. En août, le rapport de veille sur les menaces de l'entreprise a détaillé une opération d'extorsion de données, identifiée sous le nom de code GTG-2002, qui utilisait le logiciel malveillant Claude Code pour commettre un vol à grande échelle ciblant au moins 17 organisations des secteurs de la santé, des services d'urgence, du gouvernement et des institutions religieuses. Ce criminel a exigé des rançons dépassant 500 000 dollars en menaçant de divulguer les données volées plutôt qu'en utilisant le chiffrement traditionnel des rançongiciels.

L'infrastructure de détection d'Anthropic repose sur plusieurs techniques multicouches, notamment l'analyse comportementale pour surveiller les habitudes d'utilisation de millions de requêtes API, la détection d'anomalies pour identifier les séquences d'opérations non conformes à une utilisation légitime, et la reconnaissance de formes pour identifier les techniques de manipulation connues et nouvelles. L'entreprise utilise des classificateurs spécialisés qui analysent les entrées utilisateur afin de détecter les requêtes potentiellement malveillantes et évaluent les réponses de Claude avant et après leur exécution.

Implications pour l'industrie

Cette campagne a mis en évidence un niveau d'autonomie sans précédent des IA dans les cyberattaques et marque, selon les experts en sécurité, un tournant dans le cyberespionnage. La capacité des systèmes d'IA à mener des attaques sophistiquées à la vitesse de la machine, avec une supervision humaine minimale, pose de nouveaux défis aux défenseurs de la cybersécurité.

La révélation d'Anthropic intervient alors que les entreprises d'IA subissent une pression croissante pour empêcher toute utilisation malveillante de leurs modèles. L'entreprise dispose d'un programme complet de veille sur les menaces et de mesures de protection afin de détecter et de contrer les abus de Claude, et a recensé des incidents de sécurité tout au long de l'année 2025. En mars, elle a identifié une opération d'influence à la demande qui utilisait Claude pour automatiser l'interaction avec des dizaines de milliers de comptes de réseaux sociaux dans plusieurs pays et langues.

Cet incident souligne la sophistication croissante des outils basés sur l'IA et les difficultés liées à la prévention de leur utilisation abusive tout en préservant leur utilité pour les utilisateurs légitimes. Anthropic a banni les comptes concernés et continue d'améliorer ses capacités de détection et d'atténuation afin de faire face à l'évolution des menaces.