Intelligence artificielle

Le langage généré par l’IA commence à polluer la littérature scientifique

Les chercheurs de France et de Russie ont publié une étude indiquant que l’utilisation de générateurs de texte probabilistes basés sur l’IA tels que GPT-3 introduit un langage ‘torturé’, des citations de littérature inexistante et une réutilisation d’images ad hoc sans crédit dans des canaux précédemment respectables pour la publication de nouvelle littérature scientifique.

Peut-être ce qui est le plus préoccupant est que les articles étudiés contiennent également un contenu scientifiquement inexact ou non reproductible présenté comme le fruit d’une recherche objective et systématique, indiquant que les modèles de langage génératifs sont utilisés non seulement pour améliorer les compétences limitées en anglais des auteurs des articles, mais également pour effectuer le travail difficile impliqué (et, invariablement, pour le faire mal).

Le rapport, intitulé Phrases torturées : un style d’écriture douteux émergeant dans la science, a été compilé par des chercheurs du département d’informatique de l’Université de Toulouse et le chercheur Yandex Alexander Magazinov, actuellement à l’Université de Tel Aviv.

L’étude se concentre particulièrement sur la croissance de publications scientifiques sans sens générées par l’IA dans le journal Elsevier Microprocesseurs et systèmes embarqués.

Sous un autre nom

Les modèles de langage autoregressifs tels que GPT-3 sont formés sur de grands volumes de données et sont conçus pour paraphraser, résumer, compiler et interpréter ces données contributives en modèles de langage génératifs cohérents capables de reproduire des modèles de parole et d’écriture naturels, tout en conservant l’intention originale des données de formation.

Puisque de tels cadres sont fréquemment pénalisés au stade de la formation du modèle pour offrir une régurgitation directe et « non absorbée » des données originales, ils cherchent inévitablement des synonymes – même pour des phrases bien établies.

Les soumissions scientifiques apparemment créées ou aidées par l’IA mises au jour par les chercheurs comprennent un nombre extraordinaire de tentatives ratées de synonymes créatifs pour des phrases connues dans le secteur de l’apprentissage automatique :

rseau neuronal profond : ‘organisation neuronale profonde’

rseau neuronal artificiel : ‘(faux | contrefait) organisation neuronale’

rseau mobile : ‘organisation versatile’

attaque de rseau : ‘organisation (embuscade | assaut)’

connexion de rseau : ‘association d’organisation’

données massives : ‘(énormes | énormes | immenses | colossales) informations’

entrepôt de données : ‘informations (entrepôt | centre de distribution)’

intelligence artificielle (IA) : ‘(contrefait | créé par l’homme) conscience’

calcul hautes performances : ‘calcul élite’

calcul de brouillard / brume / nuage : ‘calcul de brume’

unité de traitement graphique (GPU) : ‘unité de préparation de conception’

unité centrale de traitement (CPU) : ‘unité de préparation focale’

moteur de workflow : ‘moteur de processus de travail’

reconnaissance faciale : ‘reconnaissance faciale’

reconnaissance vocale : ‘reconnaissance de discours’

erreur quadratique moyenne : ‘erreur quadratique moyenne (erreur | gaffe)’

erreur absolue moyenne : ‘erreur absolue moyenne (erreur | gaffe)’

signal / bruit : ‘(mouvement | signal | indicateur | signe) / (clamour | agitation | bruit)’

paramètres globaux : ‘paramètres mondiaux’

accès aléatoire : ‘(aléatoire | irrégulier) accès’

forêt aléatoire : ‘(aléatoire | irrégulier) (forêt | territoire boisé | région luxuriante)’

valeur aléatoire : ‘(aléatoire | irrégulier) valeur’

colonie de fourmis : ‘(colonie de fourmis | région | province | zone | établissement) sous-terrain’

colonie de fourmis : ‘(colonie de fourmis | région | province | zone | établissement) insecte souterrain’

énergie restante : ‘énergie restante’

énergie cinétique : ‘énergie motrice’

Bayes naïf : ‘(crédule | innocent | naïf) Bayes’

assistant numérique personnel (PDA) : ‘assistant informatique personnel’

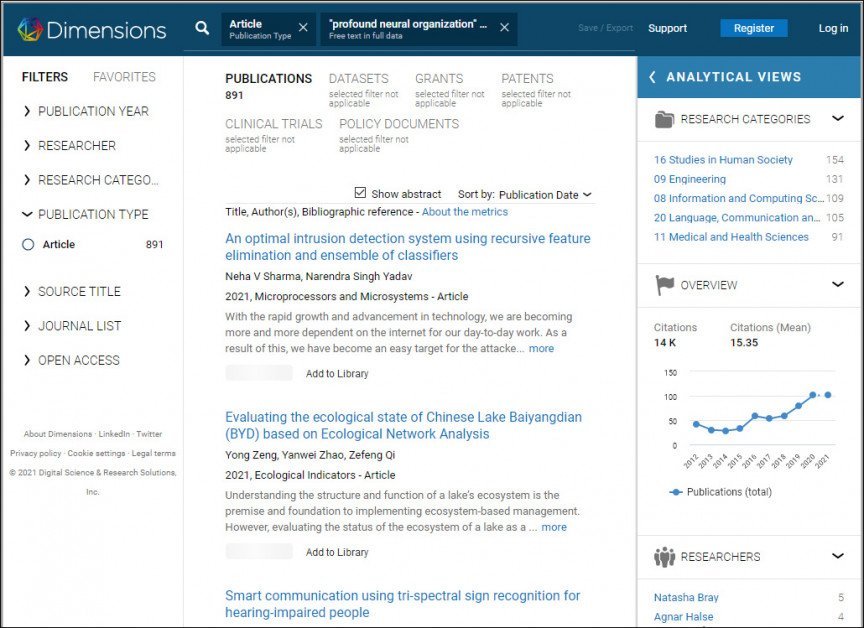

En mai 2021, les chercheurs ont interrogé le moteur de recherche académique Dimensions à la recherche de ce type de langage automatisé déformé, en prenant soin d’exclure des phrases légitimes telles que ‘informations énormes’ (qui est une phrase valide et non un synonyme raté pour ‘données massives’). À ce stade, ils ont observé que Microprocesseurs et systèmes embarqués avait le plus grand nombre d’occurrences de paraphrasage mal géré.

Actuellement, il est toujours possible de récupérer (archive snapshot, 15/07/2021) un certain nombre d’articles scientifiques pour la phrase sans sens ‘organisation neuronale profonde’ (c’est-à-dire ‘rseau neuronal profond’), et d’autres dans la liste ci-dessus donnent des résultats similaires.

Résultats de recherche pour ‘organisation neuronale profonde’ (‘rseau neuronal profond’) sur Dimensions. Source : https://app.dimensions.ai/

Le journal Microprocesseurs a été fondé en 1976 et renommé Microprocesseurs et systèmes embarqués deux ans plus tard.

Une croissance de langage sans sens

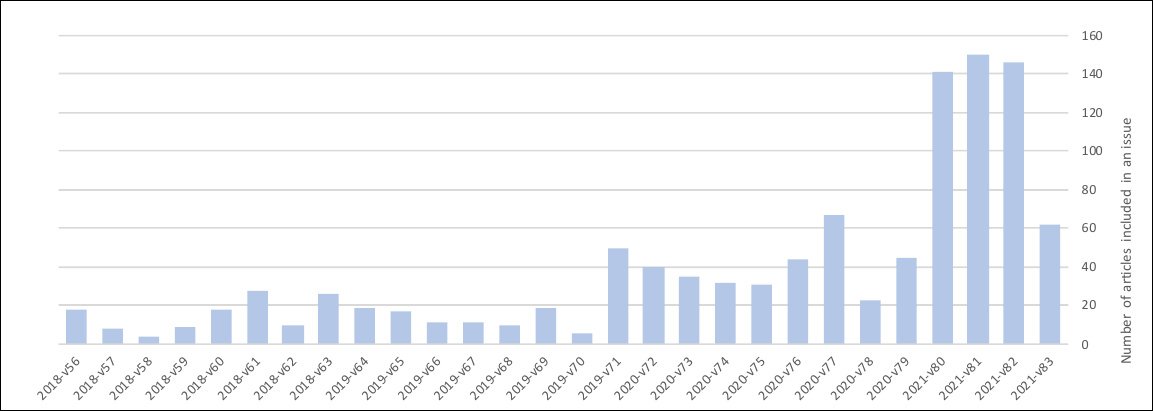

Les chercheurs ont étudié une période allant de février 2018 à juin 2021 et ont observé une augmentation importante du volume de soumissions au cours des deux dernières années, et en particulier au cours des 6-8 derniers mois :

Corrélation ou causalité ? L’augmentation des soumissions au journal Microprocesseurs et systèmes embarqués semble coïncider avec la croissance de ‘langage sans sens’ et de synonymes dans des soumissions apparemment respectables. Source : https://arxiv.org/pdf/2107.06751.pdf

L’ensemble de données final rassemblé par les collaborateurs contient 1 078 articles complets obtenus via l’abonnement Elsevier de l’Université de Toulouse.

Diminution de la surveillance éditoriale pour les articles scientifiques chinois

L’article observe que la période allouée pour l’évaluation éditoriale des soumissions signalées devient radicalement raccourcie en 2021, tombant à moins de 40 jours ; une diminution six fois plus rapide que le temps standard pour la révision par les pairs, évidente à partir de février 2021.

Le plus grand nombre d’articles signalés proviennent d’auteurs ayant des affiliations avec la Chine continentale : sur 404 articles acceptés en moins de 30 jours, 97,5 % sont liés à la Chine. À l’inverse, dans les cas où le processus éditorial a dépassé 40 jours (615 articles), les soumissions affiliées à la Chine représentaient seulement 9,5 % de cette catégorie – un déséquilibre dix fois plus important.

Le rapport attribue l’infiltration des articles signalés à des lacunes dans le processus éditorial et à un manque possible de ressources face à un nombre croissant de soumissions.

Les chercheurs supposent que des modèles de langage génératifs de type GPT, et des cadres de génération de langage similaires, ont été utilisés pour produire une grande partie du texte des articles signalés ; cependant, la façon dont un modèle génératif abstrait ses sources rend cela difficile à prouver, et la principale preuve réside dans une évaluation commune des synonymes inutiles et une examination minutieuse de la cohérence logique de la soumission.

Les chercheurs observent en outre que les modèles de langage génératifs qu’ils croient contribuer à cette marée de nonsens sont capables non seulement de créer les textes problématiques, mais également de les reconnaître et de les signaler systématiquement, de la même manière que les chercheurs eux-mêmes ont effectué manuellement. Le travail décrit une telle mise en œuvre, en utilisant GPT-2, et propose un cadre pour que les futurs systèmes identifient les soumissions scientifiques problématiques.

L’incidence de soumissions ‘polluées’ est nettement plus élevée dans le journal Elsevier (72,1 %) par rapport aux autres journaux étudiés (13,6 % maximum).

Plus que de la sémantique

Les chercheurs soulignent que de nombreux articles en question ne se contentent pas d’utiliser le mauvais langage, mais contiennent également des déclarations scientifiquement inexactes, indiquant la possibilité que les modèles de langage génératifs ne soient pas seulement utilisés pour améliorer les compétences linguistiques limitées des scientifiques contributeurs, mais puissent également être utilisés pour formuler au moins certaines des théories et des données fondamentales de l’article.

Dans d’autres cas, les chercheurs supposent une ‘résynthèse’ ou ‘réécriture’ effective d’un travail antérieur abstrait (et supérieur) afin de répondre aux pressions de la recherche académique ‘publier ou périr’ et, possiblement, d’améliorer les classements nationaux pour la prééminence mondiale dans la recherche en IA, grâce à un volume important.

Contenu sans sens dans un article soumis. Dans ce cas, les chercheurs ont constaté que le texte a été dérivé, ad hoc, d’un article EDN, d’où l’illustration accompagnante est également empruntée sans attribution. La réécriture du contenu original est si extrême qu’elle le rend sans signification.

En analysant plusieurs des articles soumis à Elsevier, les chercheurs ont trouvé des phrases pour lesquelles ils n’ont pas pu déduire de sens ; des références à une littérature inexistante ; des références à des variables et des théorèmes dans des formules qui n’apparaissent pas réellement dans le matériel de soutien (suggérant une abstraction basée sur le langage ou une ‘hallucination’ de données apparemment factuelles) ; et une réutilisation d’images sans reconnaissance de leurs sources (que les chercheurs critiquent non d’un point de vue de droit d’auteur, mais plutôt en tant qu’indicateur d’un manque de rigueur scientifique).

Échecs de citation

Les citations destinées à soutenir les arguments dans un article scientifique ont été trouvées dans de nombreux exemples de soumissions signalées comme étant ‘cassées ou menant à des publications non liées’.

En outre, les références à des ‘travaux liés’ comprennent souvent des auteurs que les chercheurs croient avoir été ‘hallucinés’ par un système de type GPT.

Attention errante

Un autre défaut même des modèles de langage les plus avancés, tels que GPT-3, est leur tendance à perdre le fil sur un long discours. Les chercheurs ont constaté que les articles signalés abordent souvent un sujet au début de l’article qui n’est jamais repris après avoir été évoqué dans des notes préliminaires ou ailleurs.

Ils théorisent également que certains des pires exemples se produisent par le biais de multiples parcours de texte source à travers une série de moteurs de traduction, chacun déformant le sens davantage.

Sources et raisons

En tentant de discerner ce qui se cache derrière ce phénomène, les auteurs du rapport suggèrent un certain nombre de possibilités : que le contenu des ‘moulins à papier’ est utilisé comme matériau source, introduisant des inexactitudes très tôt dans un processus qui produira inévitablement davantage d’inexactitudes ; que des outils de spinning d’articles tels que Spinbot sont utilisés pour masquer le plagiat ; et que la pression écrasante pour publier régulièrement amène des chercheurs sous-équipés à utiliser des systèmes de type GPT-3 pour soit améliorer, soit générer entièrement de nouveaux articles universitaires.

Les chercheurs concluent avec un appel à l’action pour une surveillance et des normes améliorées dans un domaine de publication universitaire qui, apparemment, devient la proie de son propre sujet – les systèmes d’apprentissage automatique. Ils adjurent également Elsevier et d’autres éditeurs à introduire des procédures de contrôle et d’examen plus rigoureuses et critiquent largement les normes et les pratiques actuelles à cet égard, suggérant que ‘La tromperie avec des textes synthétiques menace l’intégrité de la littérature scientifique.’