Inteligencia Artificial

Incrustación de código: una guía completa

Las incrustaciones de código son una forma transformadora de representar fragmentos de código como vectores densos en un espacio continuo. Estas incorporaciones capturan las relaciones semánticas y funcionales entre fragmentos de código, lo que permite aplicaciones potentes en programación asistida por IA. De manera similar a las incrustaciones de palabras en el procesamiento del lenguaje natural (NLP), las incrustaciones de código colocan fragmentos de código similares muy juntos en el espacio vectorial, lo que permite que las máquinas comprendan y manipulen el código de manera más efectiva.

¿Qué son las incrustaciones de código?

Las incrustaciones de código convierten estructuras de código complejas en vectores numéricos que capturan el significado y la funcionalidad del código. A diferencia de los métodos tradicionales que tratan el código como secuencias de caracteres, las incrustaciones capturan las relaciones semánticas entre partes del código. Esto es crucial para diversas tareas de ingeniería de software impulsadas por IA, como búsqueda de código, finalización, detección de errores y más.

Por ejemplo, considere estas dos funciones de Python:

def add_numbers(a, b):

return a + b

def sum_two_values(x, y):

result = x + y

return result

Si bien estas funciones tienen un aspecto sintáctico diferente, realizan la misma operación. Una buena incrustación de código representaría estas dos funciones con vectores similares, capturando su similitud funcional a pesar de sus diferencias textuales.

¿Cómo se crean las incrustaciones de código?

Existen diferentes técnicas para crear incrustaciones de código. Un enfoque común implica el uso de redes neuronales para aprender estas representaciones a partir de un gran conjunto de datos de código. La red analiza la estructura del código, incluidos tokens (palabras clave, identificadores), sintaxis (cómo está estructurado el código) y potencialmente comentarios para conocer las relaciones entre diferentes fragmentos de código.

Analicemos el proceso:

- Código como secuencia: En primer lugar, los fragmentos de código se tratan como secuencias de tokens (variables, palabras clave, operadores).

- Entrenamiento de redes neuronales: Una red neuronal procesa estas secuencias y aprende a asignarlas a representaciones vectoriales de tamaño fijo. La red considera factores como la sintaxis, la semántica y las relaciones entre los elementos del código.

- Capturando similitudes: La capacitación tiene como objetivo colocar fragmentos de código similares (con funcionalidad similar) muy juntos en el espacio vectorial. Esto permite tareas como encontrar código similar o comparar funcionalidades.

A continuación se muestra un ejemplo simplificado de Python de cómo se podría preprocesar el código para incrustarlo:

import ast

def tokenize_code(code_string):

tree = ast.parse(code_string)

tokens = []

for node in ast.walk(tree):

if isinstance(node, ast.Name):

tokens.append(node.id)

elif isinstance(node, ast.Str):

tokens.append('STRING')

elif isinstance(node, ast.Num):

tokens.append('NUMBER')

# Add more node types as needed

return tokens

# Example usage

code = """

def greet(name):

print("Hello, " + name + "!")

"""

tokens = tokenize_code(code)

print(tokens)

# Output: ['def', 'greet', 'name', 'print', 'STRING', 'name', 'STRING']

Esta representación tokenizada luego se puede introducir en una red neuronal para su integración.

Enfoques existentes para la incrustación de código

Los métodos existentes para la incrustación de código se pueden clasificar en tres categorías principales:

Métodos basados en tokens

Los métodos basados en tokens tratan el código como una secuencia de tokens léxicos. Técnicas como Frecuencia de términos-Frecuencia de documentos inversa (TF-IDF) y modelos de aprendizaje profundo como CódigoBERT Caer en esta categoría.

Métodos basados en árboles

Los métodos basados en árboles analizan el código en árboles de sintaxis abstracta (AST) u otras estructuras de árbol, capturando las reglas sintácticas y semánticas del código. Los ejemplos incluyen redes neuronales basadas en árboles y modelos como código2vec ASNN.

Métodos basados en gráficos

Los métodos basados en gráficos construyen gráficos a partir de código, como gráficos de flujo de control (CFG) y gráficos de flujo de datos (DFG), para representar el comportamiento dinámico y las dependencias del código. Código gráficoBERT es un ejemplo notable.

TransformCode: un marco para la incrustación de código

Código de transformación es un marco que aborda las limitaciones de los métodos existentes mediante el aprendizaje de incrustaciones de código de una manera de aprendizaje contrastante. Es independiente del codificador y del lenguaje, lo que significa que puede aprovechar cualquier modelo de codificador y manejar cualquier lenguaje de programación.

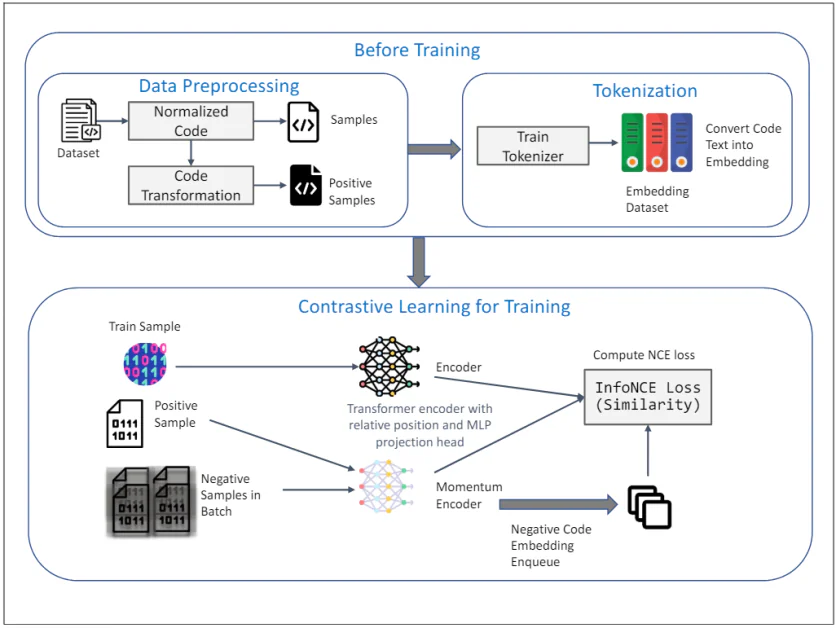

El diagrama anterior ilustra el marco de TransformCode para el aprendizaje no supervisado de la incrustación de código mediante el aprendizaje contrastivo. Consta de dos fases principales: Antes de entrenar Aprendizaje contrastivo para la formaciónAquí hay una explicación detallada de cada componente:

Antes de entrenar

1. Preprocesamiento de datos:

- Conjunto de datos: La entrada inicial es un conjunto de datos que contiene fragmentos de código.

- Código normalizado: Los fragmentos de código se normalizan para eliminar comentarios y cambiar el nombre de las variables a un formato estándar. Esto ayuda a reducir la influencia de la denominación de variables en el proceso de aprendizaje y mejora la generalización del modelo.

- Transformación de código: Luego, el código normalizado se transforma mediante varias transformaciones sintácticas y semánticas para generar muestras positivas. Estas transformaciones garantizan que el significado semántico del código permanezca sin cambios, proporcionando muestras diversas y sólidas para el aprendizaje contrastivo.

2. Tokenización:

- Tokenizador de tren: Se entrena un tokenizador en el conjunto de datos del código para convertir el texto del código en incrustaciones. Esto implica dividir el código en unidades más pequeñas, como tokens, que el modelo puede procesar.

- Incrustar conjunto de datos: El tokenizador entrenado se utiliza para convertir todo el conjunto de datos del código en incrustaciones, que sirven como entrada para la fase de aprendizaje contrastivo.

Aprendizaje contrastivo para la formación

3. Proceso de formación:

- Muestra de tren: Se selecciona una muestra del conjunto de datos de entrenamiento como representación del código de consulta.

- Muestra Positiva: La muestra positiva correspondiente es la versión transformada del código de consulta, obtenida durante la fase de preprocesamiento de datos.

- Muestras negativas en lote: Las muestras negativas son todas las demás muestras de código del minilote actual que son diferentes de la muestra positiva.

4. Codificador y codificador de impulso:

- Codificador de transformador con posición relativa y cabezal de proyección MLP: Tanto la consulta como las muestras positivas se introducen en un codificador Transformer. El codificador incorpora codificación de posición relativa para capturar la estructura sintáctica y las relaciones entre tokens en el código. Se utiliza un cabezal de proyección MLP (perceptrón multicapa) para asignar las representaciones codificadas a un espacio de dimensiones inferiores donde se aplica el objetivo de aprendizaje contrastivo.

- Codificador de impulso: También se utiliza un codificador de momento, que se actualiza mediante una media móvil de los parámetros del codificador de consulta. Esto ayuda a mantener la consistencia y diversidad de las representaciones, evitando el colapso de la pérdida contrastiva. Las muestras negativas se codifican utilizando este codificador de momento y se ponen en cola para el proceso de aprendizaje contrastivo.

5. Objetivo de aprendizaje contrastivo:

- Calcular la pérdida de InfoNCE (similitud): El Pérdida de InfoNCE (estimación contrastiva de ruido) se calcula para maximizar la similitud entre la consulta y las muestras positivas y al mismo tiempo minimizar la similitud entre la consulta y las muestras negativas. Este objetivo garantiza que las incorporaciones aprendidas sean discriminativas y sólidas, capturando la similitud semántica de los fragmentos de código.

Todo el marco aprovecha las fortalezas del aprendizaje contrastivo para aprender incorporaciones de código sólidas y significativas a partir de datos sin etiquetar. El uso de transformaciones AST y un codificador de impulso mejora aún más la calidad y eficiencia de las representaciones aprendidas, lo que convierte a TransformCode en una herramienta poderosa para diversas tareas de ingeniería de software.

Características clave de TransformCode

- Flexibilidad y adaptabilidad: Se puede ampliar a diversas tareas posteriores que requieren representación de código.

- Eficiencia y escalabilidad: No requiere un modelo grande ni datos de entrenamiento extensos, y admite cualquier lenguaje de programación.

- Aprendizaje supervisado y no supervisado: Se puede aplicar a ambos escenarios de aprendizaje incorporando etiquetas u objetivos específicos de tareas.

- Parámetros ajustables: La cantidad de parámetros del codificador se puede ajustar según los recursos informáticos disponibles.

TransformCode presenta una técnica de aumento de datos llamada transformación AST, que aplica transformaciones sintácticas y semánticas a los fragmentos de código originales. Esto genera muestras diversas y robustas para el aprendizaje contrastivo.

Aplicaciones de incrustaciones de código

Las incrustaciones de código han revolucionado varios aspectos de la ingeniería de software al transformar el código de un formato textual a una representación numérica utilizable por modelos de aprendizaje automático. A continuación se muestran algunas aplicaciones clave:

Búsqueda de código mejorada

Tradicionalmente, la búsqueda de códigos se basaba en la concordancia de palabras clave, lo que a menudo conducía a resultados irrelevantes. Las incrustaciones de código permiten la búsqueda semántica, donde los fragmentos de código se clasifican según su similitud en funcionalidad, incluso si usan palabras clave diferentes. Esto mejora significativamente la precisión y eficiencia a la hora de encontrar código relevante dentro de grandes bases de código.

Finalización de código más inteligente

Las herramientas de finalización de código sugieren fragmentos de código relevantes según el contexto actual. Al aprovechar las incrustaciones de código, estas herramientas pueden proporcionar sugerencias más precisas y útiles al comprender el significado semántico del código que se está escribiendo. Esto se traduce en experiencias de codificación más rápidas y productivas.

Corrección de código automatizada y detección de errores

Las incrustaciones de código se pueden utilizar para identificar patrones que a menudo indican errores o ineficiencias en el código. Al analizar la similitud entre fragmentos de código y patrones de errores conocidos, estos sistemas pueden sugerir automáticamente correcciones o resaltar áreas que podrían requerir una inspección más detallada.

Resumen de código mejorado y generación de documentación

Las bases de código grandes a menudo carecen de la documentación adecuada, lo que dificulta que los nuevos desarrolladores comprendan su funcionamiento. Las incrustaciones de código pueden crear resúmenes concisos que capturan la esencia de la funcionalidad del código. Esto no sólo mejora la capacidad de mantenimiento del código sino que también facilita la transferencia de conocimientos dentro de los equipos de desarrollo.

Revisiones de código mejoradas

Las revisiones de código son cruciales para mantener la calidad del código. Las incrustaciones de código pueden ayudar a los revisores al resaltar problemas potenciales y sugerir mejoras. Además, pueden facilitar las comparaciones entre diferentes versiones de código, haciendo que el proceso de revisión sea más eficiente.

Procesamiento de código multilingüe

El mundo del desarrollo de software no se limita a un único lenguaje de programación. Las incrustaciones de código son prometedoras para facilitar las tareas de procesamiento de código en varios idiomas. Al capturar las relaciones semánticas entre el código escrito en diferentes lenguajes, estas técnicas podrían permitir tareas como la búsqueda y el análisis de código en todos los lenguajes de programación.